Command Palette

Search for a command to run...

Kang Liao Size Wu Zhonghua Wu Linyi Jin Chao Wang Yikai Wang Fei Wang Wei Li Chen Change Loy

초록

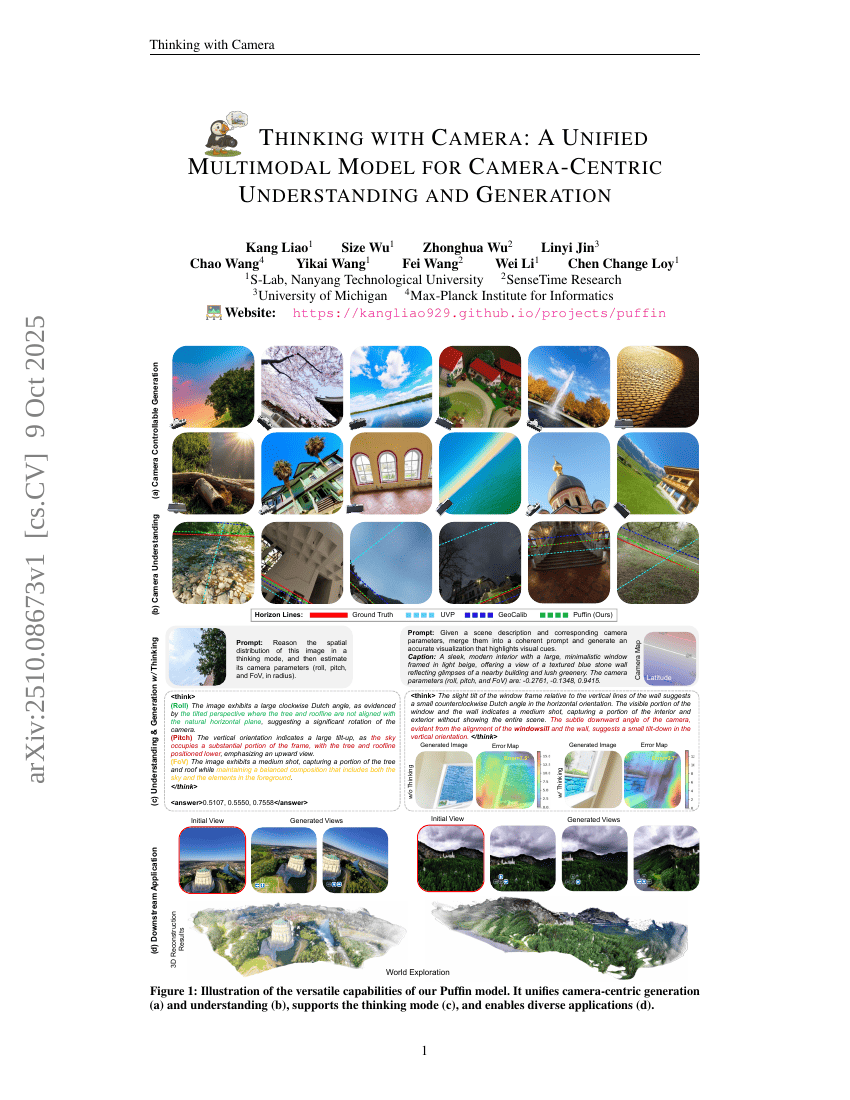

카메라 중심의 이해와 생성은 공간 지능의 두 핵심 요소이지만, 일반적으로 별개로 연구되어 왔다. 본 연구에서는 공간 인식을 카메라 차원으로 확장하는 통합적인 카메라 중심 다중모달 모델인 Puffin을 제안한다. Puffin은 언어 회귀와 확산 기반 생성을 통합하여 임의의 시점에서 장면을 해석하고 생성할 수 있다. 카메라와 비전-언어 간의 모달리티 격차를 극복하기 위해, 카메라를 언어처럼 취급하는 새로운 패러다임을 도입함으로써 '카메라를 활용한 사고'를 가능하게 한다. 이는 기하학적 맥락을 넘나들며 공간적으로 기반을 둔 시각적 단서를 사진 기술 용어와 정렬하도록 모델을 안내한다. Puffin은 400만 개의 비전-언어-카메라 삼중항으로 구성된 대규모 데이터셋인 Puffin-4M을 기반으로 훈련되었다. 전역 카메라 파라미터와 픽셀 단위 카메라 맵을 함께 활용함으로써, 유연하고 신뢰할 수 있는 공간 생성이 가능해졌다. 실험 결과, Puffin은 카메라 중심의 생성 및 이해에 특화된 기존 모델들보다 뛰어난 성능을 보였다. 지시어 튜닝을 통해 Puffin은 공간적 상상, 세계 탐색, 사진 촬영 안내 등 다양한 크로스뷰 작업으로 일반화할 수 있었다. 본 연구에서는 코드, 모델, 데이터셋 파이프라인 및 벤치마크를 공개하여 다중모달 공간 지능 연구의 발전을 촉진할 예정이다.