Command Palette

Search for a command to run...

Siyoon Jin Seongchan Kim Dahyun Chung Jaeho Lee Hyunwook Choi Jisu Nam Jiyoung Kim Seungryong Kim

초록

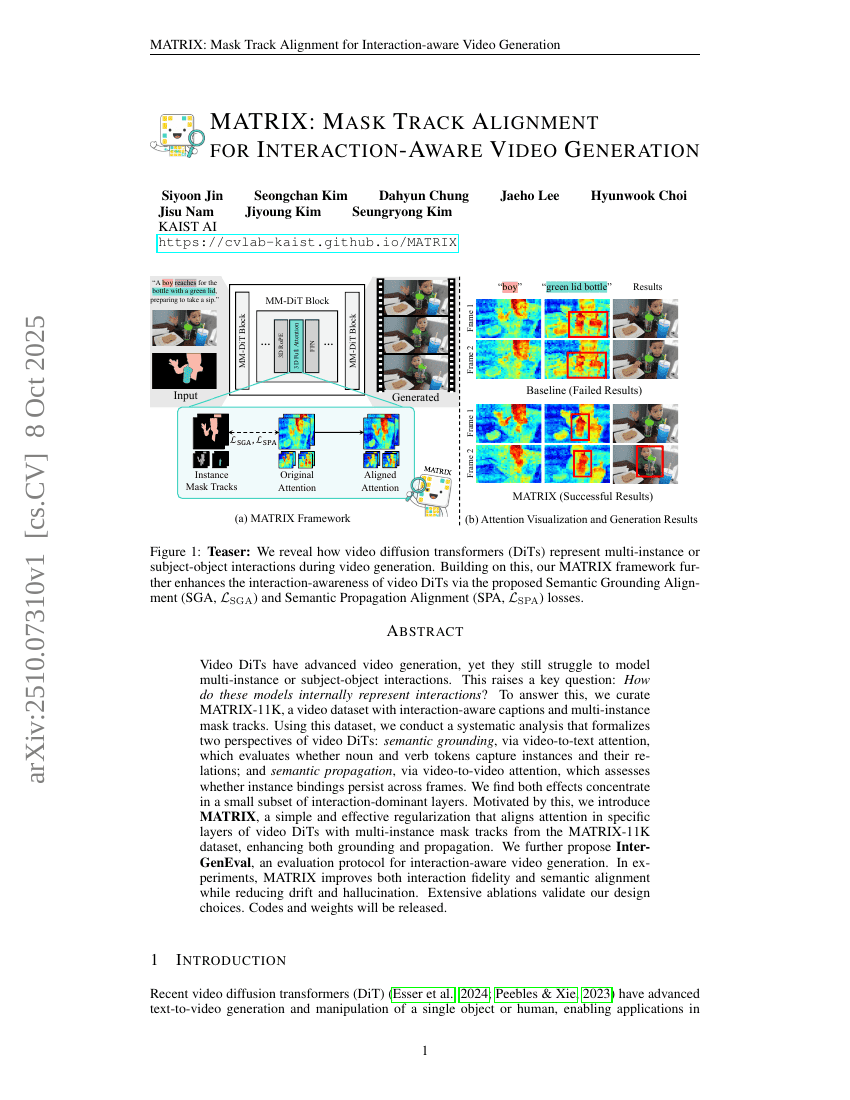

비디오 DiT는 영상 생성 기술을 크게 발전시켰지만, 다중 인스턴스 또는 주체-객체 간 상호작용을 효과적으로 모델링하기에는 여전히 어려움을 겪고 있다. 이로 인해 핵심적인 질문이 제기된다. 이러한 모델들은 내부적으로 어떻게 상호작용을 표현하는가? 이를 해결하기 위해, 상호작용 인식 캡션과 다중 인스턴스 마스크 트랙을 포함한 비디오 데이터셋 MATRIX-11K를 구축하였다. 이 데이터셋을 활용해, 비디오 DiT의 두 가지 관점을 체계적으로 분석하였다. 첫째, 영상-텍스트 어텐션을 통한 의미 기반(semantic grounding) 분석은 명사 및 동사 토큰이 인스턴스와 그 관계를 얼마나 잘 포착하는지를 평가한다. 둘째, 영상-영상 어텐션을 통한 의미 전파(semantic propagation) 분석은 인스턴스 연결이 프레임 간 지속적으로 유지되는지를 평가한다. 분석 결과, 이러한 효과는 상호작용 중심의 레이어들 중 소수의 특정 레이어에 집중되어 있음을 확인하였다. 이러한 발견을 바탕으로, MATRIX-11K 데이터셋의 다중 인스턴스 마스크 트랙과 일치하도록 비디오 DiT의 특정 레이어의 어텐션을 정규화하는 간단하면서도 효과적인 방법인 MATRIX를 제안한다. 이는 의미 기반과 전파 모두를 향상시킨다. 또한, 상호작용 인식 영상 생성을 평가하기 위한 평가 프로토콜인 InterGenEval을 제안한다. 실험 결과, MATRIX는 상호작용 정확도와 의미 일치도를 향상시키면서 드리프트와 환각 현상을 감소시켰다. 광범위한 아보레이션 실험을 통해 제안된 설계 선택의 타당성을 검증하였다. 코드 및 모델 가중치는 향후 공개될 예정이다.