Command Palette

Search for a command to run...

Ziqi Huang Ning Yu Gordon Chen Haonan Qiu Paul Debevec Ziwei Liu

초록

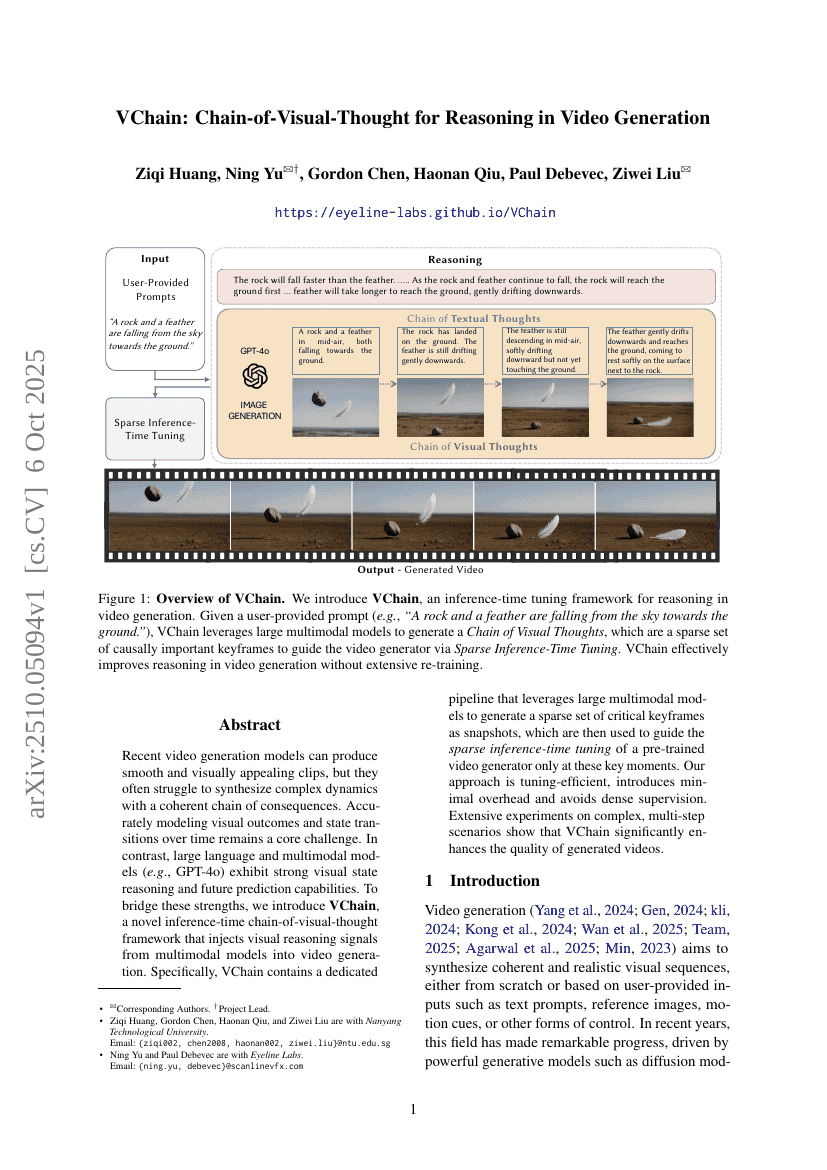

최근의 비디오 생성 모델은 부드럽고 시각적으로 매력적인 클립을 생성할 수 있지만, 일련의 인과적 결과를 갖는 복잡한 동역학을 효과적으로 합성하는 데 어려움을 겪는다. 시간에 따라 시각적 결과와 상태 전이를 정확히 모델링하는 것은 여전히 핵심적인 과제로 남아 있다. 반면, 대규모 언어 및 멀티모달 모델(예: GPT-4o)은 강력한 시각적 상태 추론 및 미래 예측 능력을 보여준다. 이러한 장점을 연결하기 위해, 우리는 멀티모달 모델로부터 시각적 추론 신호를 비디오 생성 과정에 주입하는 새로운 추론 시점(chain-of-visual-thought) 프레임워크인 VChain을 제안한다. 구체적으로 VChain은 대규모 멀티모달 모델을 활용하여 중요한 핵심 프레임(키프레임)의 희소 집합을 생성하는 전용 파이프라인을 포함하며, 이 키프레임들은 사전 훈련된 비디오 생성 모델의 추론 시점에서 단지 해당 키프레임 순간에만 조정을 수행하도록 안내하는 데 사용된다. 본 방법은 조정 효율성이 높으며, 최소한의 부가 부담만을 수반하고 밀도 높은 감독을 피한다. 복잡하고 다단계적인 시나리오에 대한 광범위한 실험 결과를 통해 VChain이 생성된 비디오의 품질을 상당히 향상시킴을 확인하였다.