Command Palette

Search for a command to run...

Alexia Jolicoeur-Martineau

초록

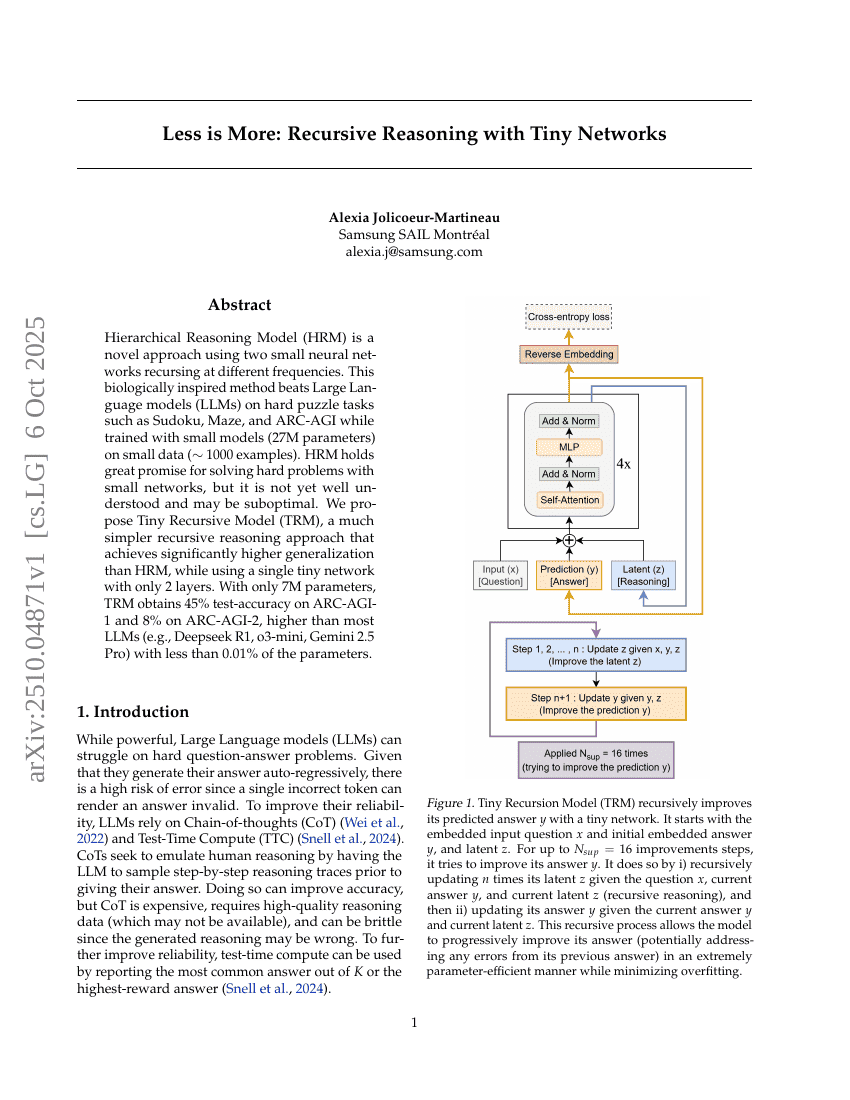

계층적 추론 모델(Hierarchical Reasoning Model, HRM)은 서로 다른 주기로 반복 작동하는 두 개의 소규모 신경망을 활용하는 새로운 접근법이다. 이 생물학적으로 영감을 받은 방법은 수수께끼 해결 과제인 수수께끼(Sudoku), 미로(Maze), ARC-AGI 등에서 대규모 언어 모델(Large Language Models, LLMs)을 능가하지만, 소규모 모델(2700만 파라미터)과 소규모 데이터(약 1000개 예시)로 학습된 점이 특징이다. HRM은 소규모 네트워크로 어려운 문제를 해결할 수 있는 큰 잠재력을 지니고 있으나, 아직 충분히 이해되지 않았으며, 최적화되지 않은 상태일 수 있다. 이에 우리는 단일의 매우 작은 네트워크(2층 구조)만을 사용하는 훨씬 간단한 반복 추론 접근법인 '작은 반복 모델(Tiny Recursive Model, TRM)'을 제안한다. TRM은 HRM보다 훨씬 높은 일반화 성능을 달성하며, 파라미터 수가 단 700만 개에 불과하다. 이로써 TRM은 ARC-AGI-1에서 45%의 테스트 정확도, ARC-AGI-2에서는 8%의 정확도를 기록했으며, 이는 파라미터 수가 TRM의 0.01% 미만인 대부분의 LLMs(예: Deepseek R1, o3-mini, Gemini 2.5 Pro)보다 높은 성능을 달성한 것이다.