Command Palette

Search for a command to run...

Yifan Wang Binbin Liu Fengze Liu Yuanfan Guo Jiyao Deng Xuecheng Wu Weidong Zhou Xiaohuan Zhou Taifeng Wang

초록

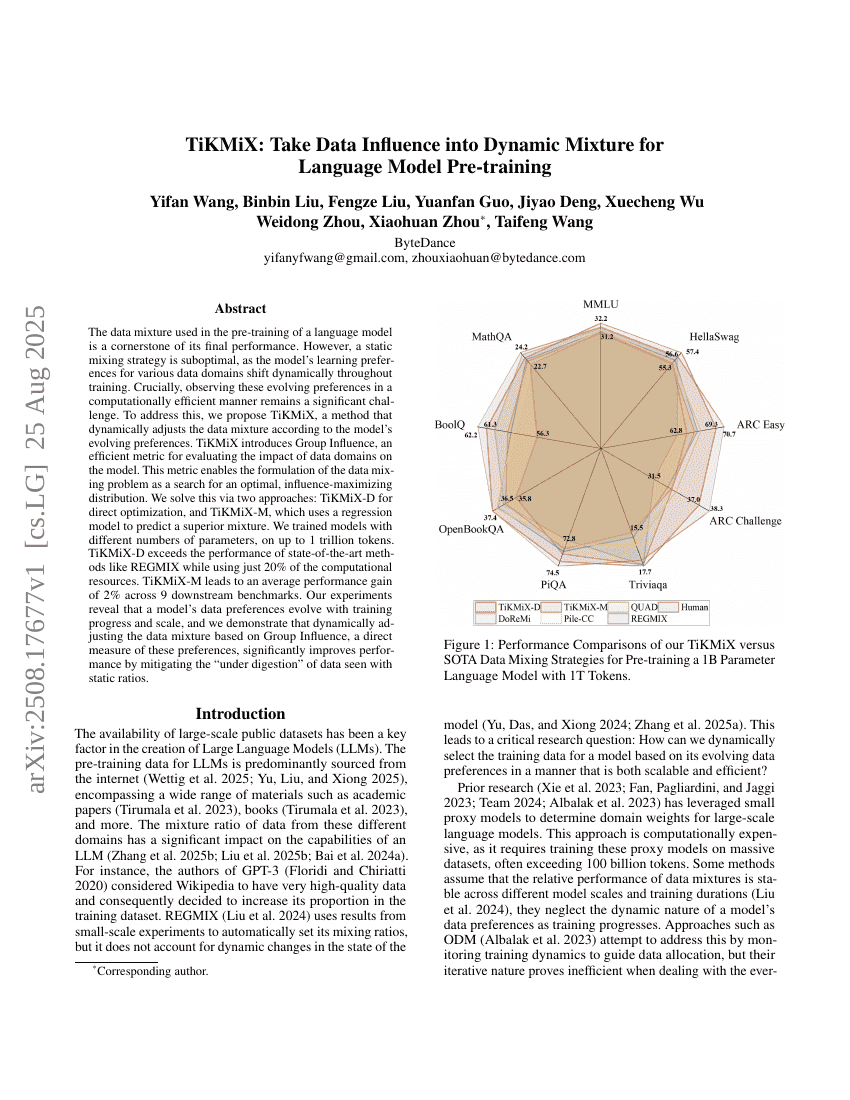

언어 모델의 사전 훈련에서 사용되는 데이터 혼합 방식은 최종 성능의 핵심 요소이다. 그러나 모델이 훈련 과정에서 다양한 데이터 도메인에 대해 학습 선호도를 동적으로 변화시키기 때문에, 고정된 혼합 전략은 최적화되지 않은 상태이다. 특히, 이러한 변화하는 학습 선호도를 계산적으로 효율적으로 관측하는 것은 여전히 큰 도전 과제이다. 이를 해결하기 위해 우리는 모델의 변화하는 선호도에 따라 데이터 혼합 방식을 동적으로 조정하는 TiKMiX를 제안한다. TiKMiX는 데이터 도메인의 모델에 미치는 영향을 효율적으로 평가할 수 있는 '그룹 영향(Group Influence)'이라는 메트릭을 도입한다. 이 메트릭을 통해 데이터 혼합 문제를 영향력 최대화를 추구하는 최적 분포 탐색 문제로 재정의할 수 있다. 우리는 이를 두 가지 접근 방식으로 해결한다: 직접 최적화를 위한 TiKMiX-D와, 회귀 모델을 활용해 더 우수한 혼합 방식을 예측하는 TiKMiX-M이다. 우리는 최대 1조 토큰까지의 데이터를 사용하여 파라미터 수가 다양한 모델을 훈련시켰다. TiKMiX-D는 REGMIX와 같은 최신 기법보다 뛰어난 성능을 보였으며, 계산 자원은 단 20%만 사용하였다. TiKMiX-M은 9개의 다운스트림 벤치마크에서 평균 2%의 성능 향상을 달성하였다. 실험 결과, 모델의 데이터 선호도는 훈련 진행 과정과 모델 규모에 따라 변화함을 확인하였으며, 이러한 선호도를 직접 측정하는 그룹 영향을 기반으로 데이터 혼합을 동적으로 조정함으로써, 고정된 비율에 따른 데이터의 부족한 처리(underdigestion) 문제를 효과적으로 완화하고 성능을 크게 향상시킬 수 있음을 입증하였다.