WeThink: 강화학습을 통한 일반 목적의 시각-언어 추론으로 나아가기

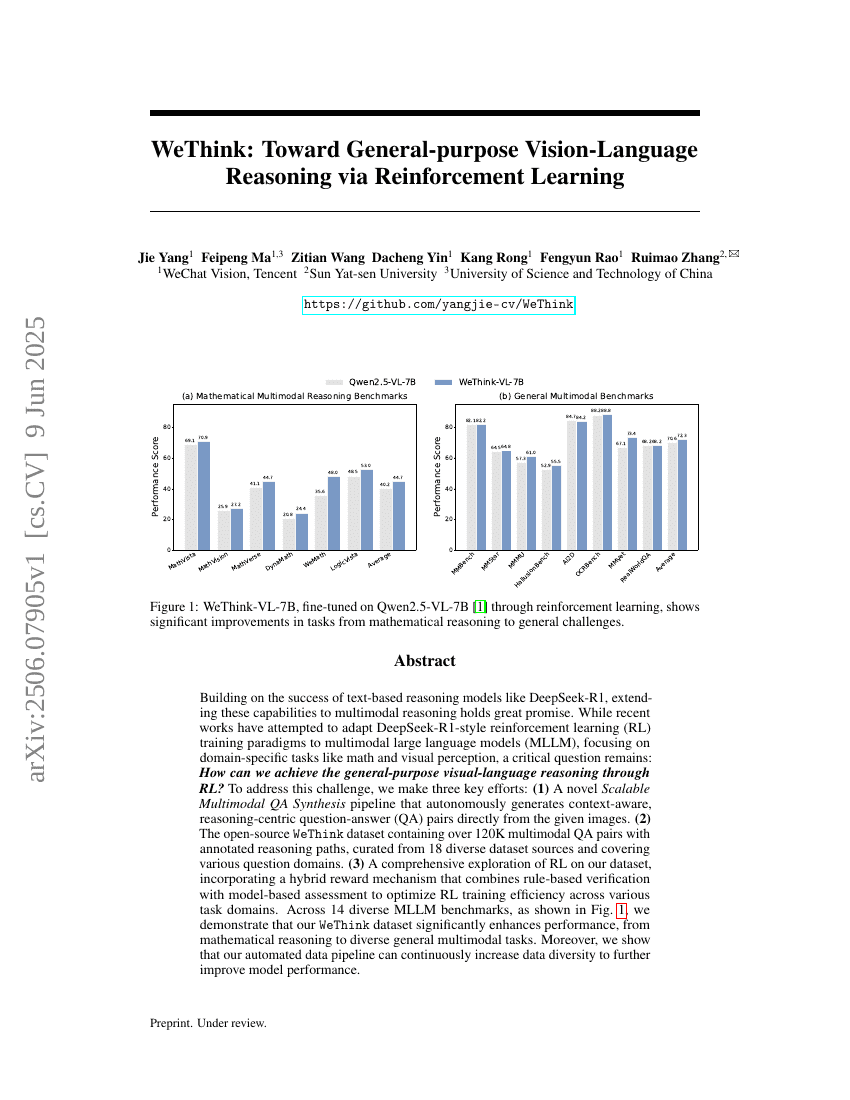

텍스트 기반 추론 모델인 DeepSeek-R1의 성공을 바탕으로, 이러한 능력을 다중 모달 추론으로 확장하는 것은 큰 전망을 가지고 있다. 최근 연구들은 DeepSeek-R1 스타일의 강화 학습(RL) 학습 프레임워크를 수학 및 시각 인지와 같은 도메인 특화 작업에 적용해 보았지만, 여전히 중요한 질문이 남아 있다. 즉, 어떻게 하면 일반 목적의 시각-언어 추론을 RL을 통해 달성할 수 있을까? 이 도전 과제를 해결하기 위해 우리는 세 가지 핵심 기여를 한다. (1) 주어진 이미지로부터 자동으로 맥락 인식형이고 추론 중심의 질문-답변(QA) 쌍을 생성하는 새로운 확장 가능한 다중 모달 QA 생성 파이프라인. (2) 18개의 다양한 데이터셋 출처에서 수집하여 정제한 12만 개 이상의 다중 모달 QA 쌍을 포함하는 오픈소스 WeThink 데이터셋으로, 각 질문에 대해 추론 경로가 명시되어 있으며 다양한 질문 도메인을 커버한다. (3) 본 데이터셋을 기반으로 한 RL에 대한 종합적 탐구로서, 규칙 기반 검증과 모델 기반 평가를 결합한 하이브리드 보상 메커니즘을 도입하여 다양한 작업 도메인에서 RL 학습 효율을 최적화한다. 14개의 다양한 다중 모달 대형 언어 모델(MLLM) 벤치마크에서 WeThink 데이터셋이 수학적 추론에서부터 다양한 일반적인 다중 모달 작업에 이르기까지 모델 성능을 크게 향상시킴을 입증한다. 더불어, 본 자동화된 데이터 파이프라인은 지속적으로 데이터 다양성을 증가시켜 모델 성능을 더욱 향상시킬 수 있음을 보여준다.