SAT: 3D 포인트 클라우드 세분화를 위한 크기 인지 트랜스포머

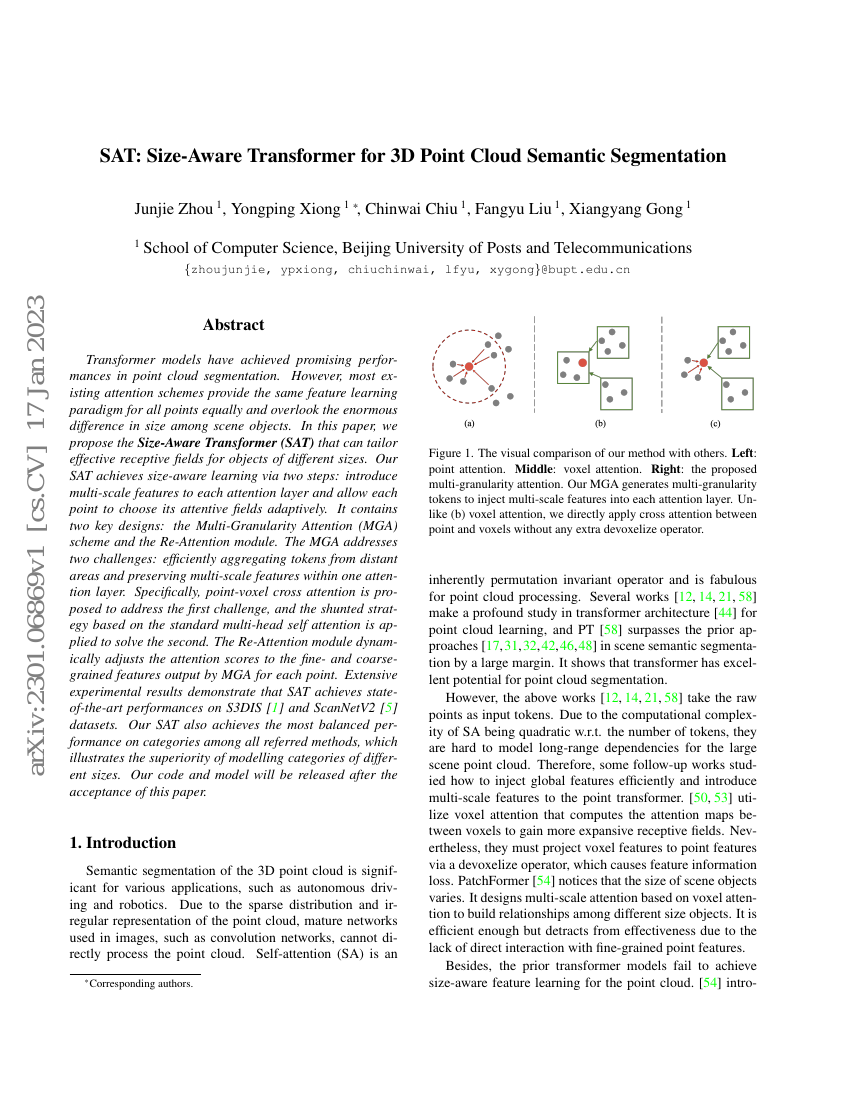

Transformer 모델은 점군 분할(task)에서 탁월한 성능을 달성하고 있다. 그러나 기존의 대부분의 주의 메커니즘은 모든 점에 대해 동일한 특징 학습 패러다임을 제공하며, 장면 내 객체들 사이의 크기 차이에 대한 고려를 간과하고 있다. 본 논문에서는 서로 다른 크기의 객체에 대해 효과적인 수용 영역을 적절히 조정할 수 있는 크기 인지 Transformer(SAT, Size-Aware Transformer)를 제안한다. 본 SAT는 두 가지 단계를 통해 크기 인지 학습을 실현한다. 첫째, 각 주의 레이어에 다중 해상도 특징을 도입하고, 둘째, 각 점이 자기만의 주의 영역을 적응적으로 선택할 수 있도록 한다. 본 모델은 두 가지 핵심 설계 요소를 포함한다: 다중 정밀도 주의(MGA, Multi-Granularity Attention) 방식과 재주의(Re-Attention) 모듈이다. MGA는 두 가지 과제를 해결한다. 첫째, 멀리 떨어진 영역의 토큰을 효율적으로 집계하는 것, 둘째, 하나의 주의 레이어 내에서 다중 해상도 특징을 유지하는 것이다. 구체적으로, 첫 번째 과제를 해결하기 위해 점-복셀 교차 주의(point-voxel cross attention)를 제안하고, 두 번째 과제를 해결하기 위해 표준 다중 헤드 자기 주의의 병렬 전달 전략(shunted strategy)을 도입한다. 재주의 모듈은 MGA로부터 출력된 세밀한 및 거시적인 특징에 대해 각 점의 주의 점수를 동적으로 조정한다. 광범위한 실험 결과를 통해 SAT가 S3DIS 및 ScanNetV2 데이터셋에서 최신 기준(SOTA, state-of-the-art) 성능을 달성함을 입증하였다. 또한, 제시된 모든 기법들 중에서 카테고리 간 성능의 균형이 가장 우수함을 보여주며, 다양한 크기의 객체를 모델링하는 데 있어 본 모델의 우수성을 입증한다. 본 논문이 수락된 후, 코드 및 모델은 공개될 예정이다.