FGAHOI: 인간-객체 상호작용 탐지를 위한 세분화된 앵커

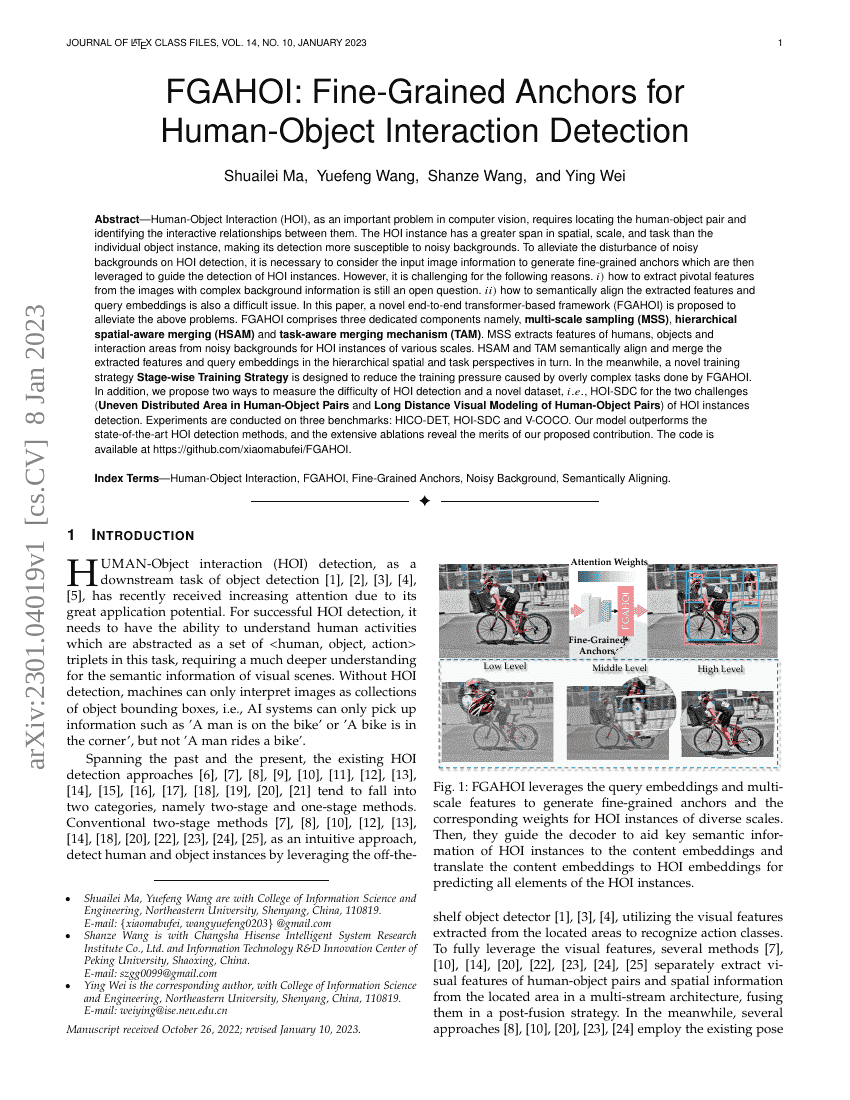

인간-객체 상호작용(Human-Object Interaction, HOI)은 컴퓨터 비전 분야에서 중요한 문제로, 인간-객체 쌍의 위치를 식별하고 그 사이의 상호작용 관계를 파악하는 것을 요구한다. HOI 인스턴스는 개별 객체 인스턴스보다 공간적 범위, 스케일, 그리고 작업 복잡도 측면에서 더 큰 확장을 가지며, 이로 인해 노이즈가 많은 배경에 더 취약하게 된다. 이러한 노이즈 배경의 영향을 완화하기 위해 입력 이미지 정보를 고려하여 세밀한 앵커를 생성하고, 이를 통해 HOI 인스턴스 탐지 과정을 안내하는 것이 필요하다. 그러나 다음과 같은 이유로 이를 구현하는 것은 여전히 도전적인 과제이다. i) 복잡한 배경 정보를 가진 이미지로부터 핵심적인 특징을 효과적으로 추출하는 방법은 여전히 열린 문제이다. ii) 추출된 특징과 쿼리 임베딩 간의 의미적 정렬 방식 역시 어려운 과제이다. 본 논문에서는 위 문제들을 완화하기 위해 새로운 엔드투엔드 트랜스포머 기반의 프레임워크인 FGAHOI(Fine-Grained Anchor-based HOI)를 제안한다. FGAHOI는 다중 스케일 샘플링(Multi-scale Sampling, MSS), 계층적 공간 인지 병합(Hierarchical Spatial-aware Merging, HSAM), 그리고 작업 인지 병합 메커니즘(Task-aware Merging, TAM)의 세 가지 전용 구성 요소로 구성된다. MSS는 다양한 스케일의 HOI 인스턴스에 대해 노이즈가 많은 배경 속에서 인간, 객체 및 상호작용 영역의 특징을 추출한다. HSAM과 TAM은 각각 계층적 공간적 관점과 작업적 관점에서 추출된 특징과 쿼리 임베딩을 의미적으로 정렬하고 병합한다. 동시에, FGAHOI가 수행하는 과도하게 복잡한 작업으로 인한 학습 부담을 줄이기 위해 새로운 학습 전략인 단계별 학습 전략(Stage-wise Training Strategy)을 제안한다. 더불어, HOI 탐지의 난이도를 측정하기 위한 두 가지 새로운 방법과, 두 가지 주요 과제(인간-객체 쌍의 비균일 분포 영역, 인간-객체 쌍의 장거리 시각 모델링)를 해결하기 위한 새로운 데이터셋인 HOI-SDC(HOI with Spatial and Distance Challenges)도 제안한다.