3달 전

REVEAL: 다중 소스 다중 모달 지식 메모리 기반의 검색 증강형 시각-언어 사전 학습

Ziniu Hu, Ahmet Iscen, Chen Sun, Zirui Wang, Kai-Wei Chang, Yizhou Sun, Cordelia Schmid, David A. Ross, Alireza Fathi

초록

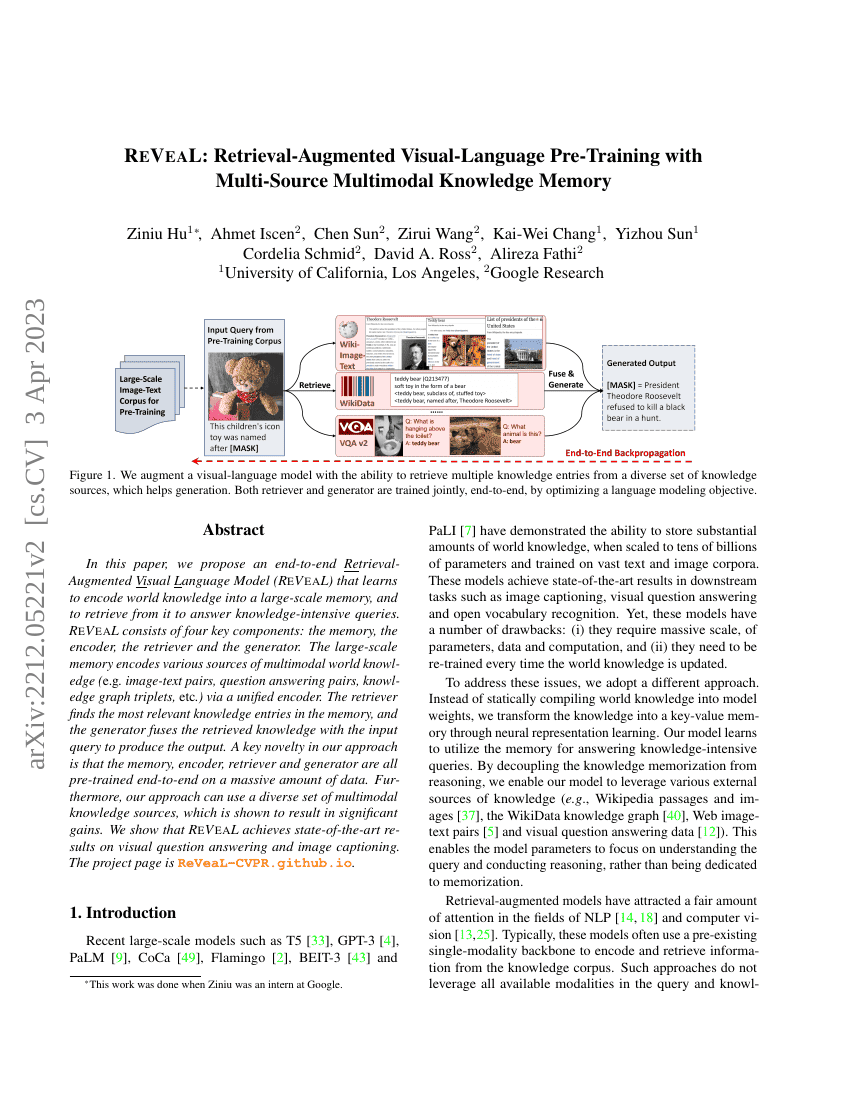

이 논문에서는 지식 집약적인 질의에 답하기 위해 세계 지식을 대규모 메모리에 인코딩하고, 이를 검색하는 것을 학습하는 엔드투엔드 검색 보강형 시각언어 모델(REVEAL)을 제안한다. REVEAL은 메모리, 인코더, 검색기, 생성기의 네 가지 핵심 구성 요소로 구성된다. 대규모 메모리는 통합 인코더를 통해 다양한 다중모달 세계 지식(예: 이미지-텍스트 쌍, 질의응답 쌍, 지식 그래프 삼중항 등)을 인코딩한다. 검색기는 메모리 내에서 가장 관련성이 높은 지식 항목을 찾고, 생성기는 검색된 지식을 입력 질의와 융합하여 출력을 생성한다. 본 연구의 핵심적 혁신점은 메모리, 인코더, 검색기, 생성기가 대량의 데이터에 대해 모두 엔드투엔드로 사전 학습된다는 점이다. 더불어 본 방법은 다양한 다중모달 지식 소스를 활용할 수 있으며, 이는 상당한 성능 향상을 가져온다는 것이 입증되었다. 실험을 통해 REVEAL이 시각 질의응답 및 이미지 설명 생성에서 최고 수준의 성능을 달성함을 보였다.