4달 전

작은 변화가 큰 차이를 만든다: 세부적인 대조 학습을 통한 다단계 응답 선택 개선

Yuntao Li; Can Xu; Huang Hu; Lei Sha; Yan Zhang; Daxin Jiang

초록

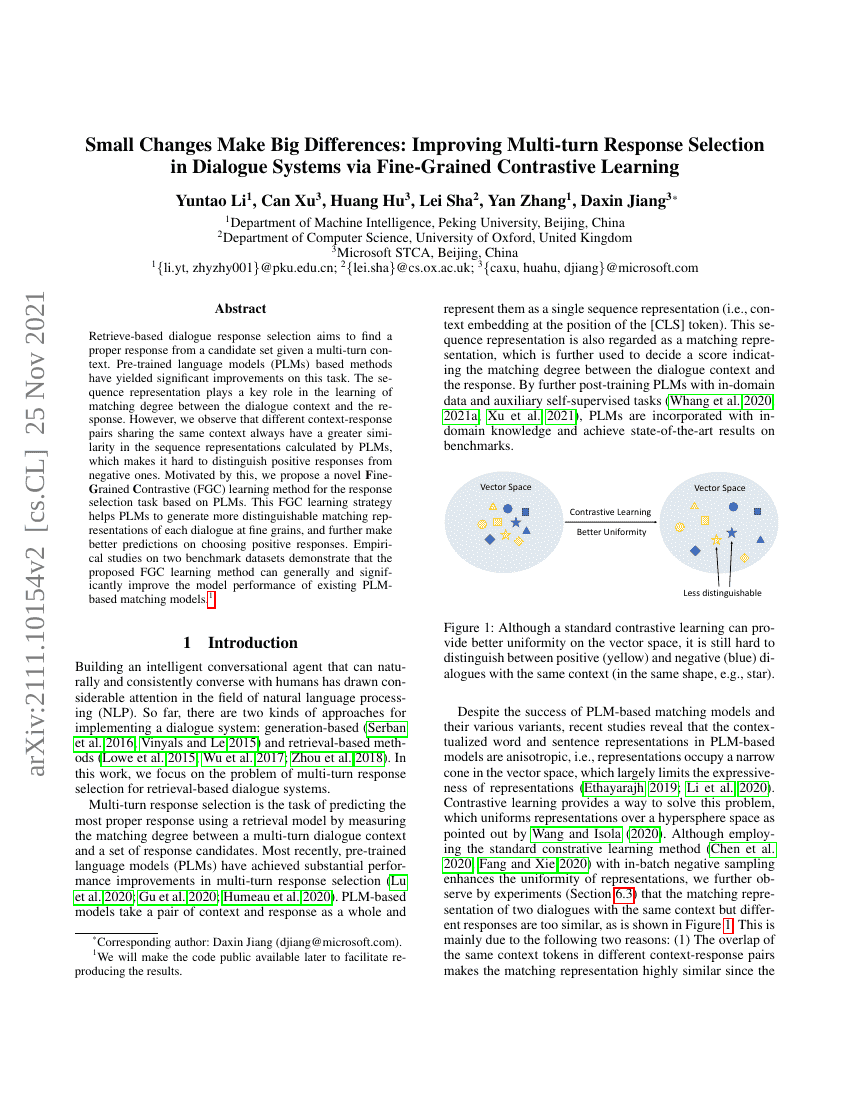

다중 턴 대화 맥락이 주어졌을 때 후보 집합에서 적절한 응답을 선택하는 것이 목적인 검색 기반 대화 응답 선택은 사전 학습된 언어 모델(PLM) 기반 방법으로 인해 상당한 개선을 이루어냈습니다. 시퀀스 표현은 대화 맥락과 응답 간의 일치도를 학습하는 데 중요한 역할을 합니다. 그러나 우리는 동일한 맥락을 공유하는 다른 맥락-응답 쌍들이 PLM에 의해 계산된 시퀀스 표현에서 항상 더 큰 유사성을 가짐을 관찰하였습니다. 이는 긍정적인 응답과 부정적인 응답을 구별하기 어렵게 만듭니다. 이러한 동기로, 우리는 PLM 기반 응답 선택 작업을 위해 새로운 세부 대조 학습(Fine-Grained Contrastive, FGC) 방법을 제안합니다. 이 FGC 학습 전략은 PLM이 각 대화의 세부 단위에서 더 구별 가능한 일치 표현을 생성하도록 도와주며, 이를 통해 긍정적인 응답 선택에 대한 예측 성능을 더욱 향상시킵니다. 두 벤치마크 데이터셋에 대한 경험적 연구는 제안된 FGC 학습 방법이 기존의 PLM 기반 일치 모델의 성능을 일반적으로 그리고 상당히 개선할 수 있음을 입증하였습니다.