픽셀 단위의 일대일 대응 매칭을 통한 비디오 객체 세그멘테이션

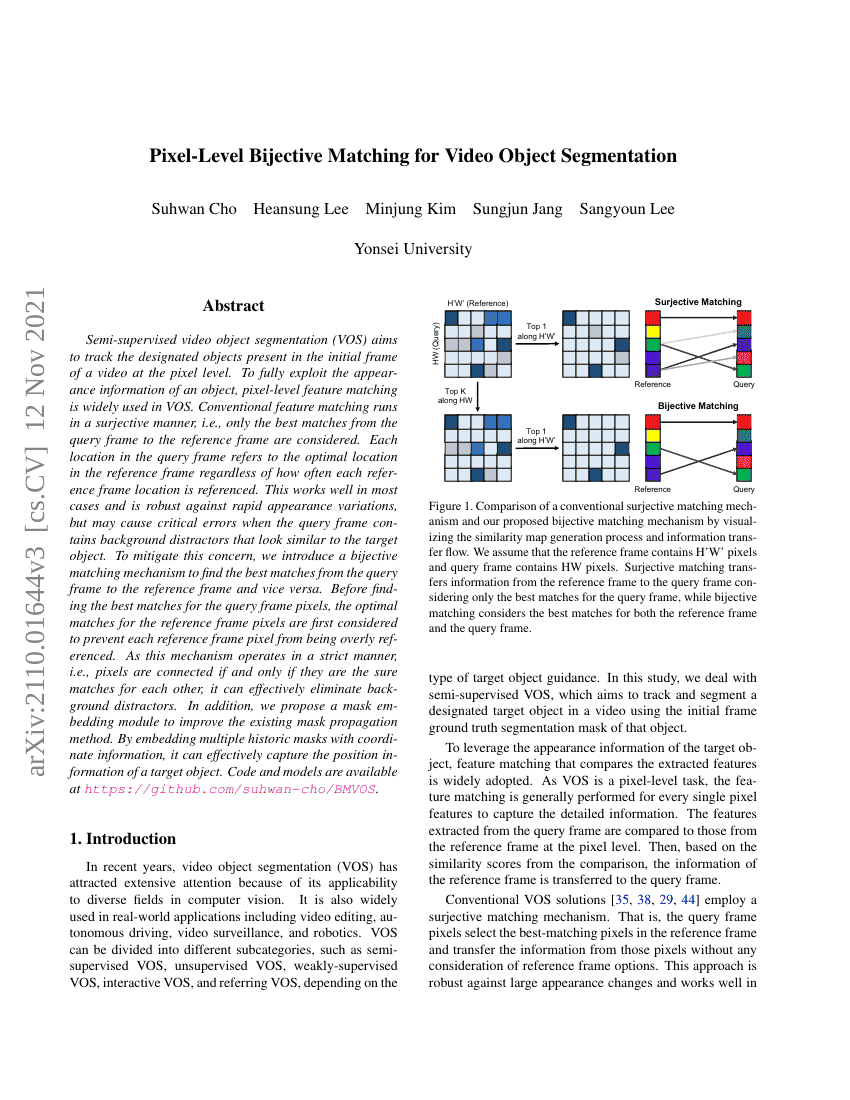

반감독 학습 기반 영상 객체 분할(VOS)은 영상의 초기 프레임에 존재하는 지정된 객체를 픽셀 단위로 추적하는 것을 목표로 한다. 객체의 외형 정보를 최대한 활용하기 위해, VOS에서는 일반적으로 픽셀 단위 특성 매칭 기법이 사용된다. 기존의 특성 매칭 방법은 단사적(surjective) 방식으로 작동하며, 쿼리 프레임에서 참조 프레임으로의 최적 매칭만을 고려한다. 이 방식에서는 쿼리 프레임의 각 위치가 참조 프레임에서의 최적 위치와 매칭되며, 참조 프레임의 각 위치가 얼마나 자주 참조되는지에 대한 고려 없이 처리된다. 이는 대부분의 경우에 효과적이며 급격한 외형 변화에 대해 강건하지만, 쿼리 프레임에 타깃 객체와 유사한 배경 방해 요소가 존재할 경우 심각한 오류를 유발할 수 있다. 이러한 문제를 완화하기 위해, 쿼리 프레임에서 참조 프레임으로의 매칭뿐 아니라 반대로 참조 프레임에서 쿼리 프레임으로의 최적 매칭도 고려하는 이중사상적(bijective) 매칭 메커니즘을 제안한다. 쿼리 프레임 픽셀의 최적 매칭을 찾기 전에, 먼저 참조 프레임 픽셀에 대한 최적 매칭을 고려함으로써, 참조 프레임의 각 픽셀이 과도하게 참조되는 것을 방지한다. 이 메커니즘은 엄격한 방식으로 작동하며, 두 픽셀이 서로 확실한 매칭 관계에 있을 때만 연결되므로, 배경 방해 요소를 효과적으로 제거할 수 있다. 또한 기존의 마스크 전파 방식을 개선하기 위해 마스크 임베딩 모듈을 제안한다. 이 모듈은 좌표 정보와 함께 여러 이력 마스크를 임베딩함으로써, 타깃 객체의 위치 정보를 효과적으로 포착할 수 있다.