초록

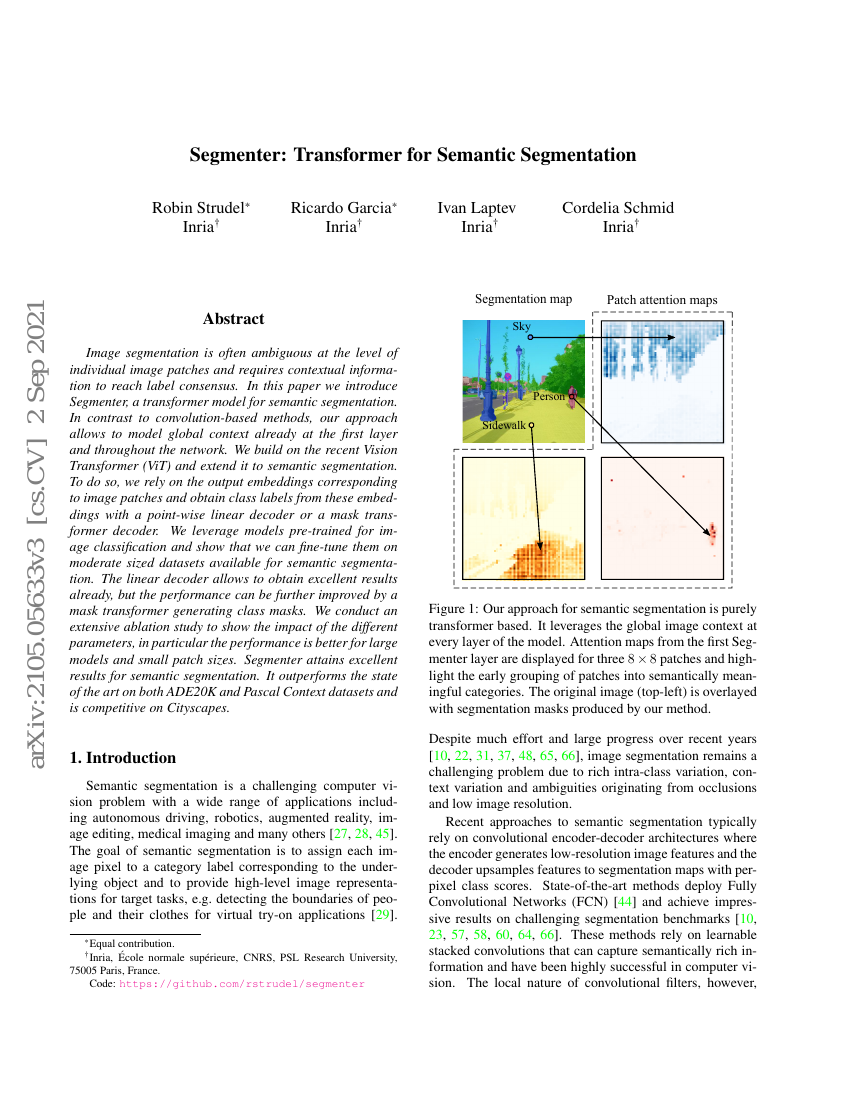

이미지 세그멘테이션은 개별 이미지 패치 수준에서 종종 모호하며, 레이블의 일치를 도출하기 위해 맥락 정보가 필요하다. 본 논문에서는 의미적 세그멘테이션을 위한 트랜스포머 모델인 Segmenter를 제안한다. 기존의 컨볼루션 기반 방법과 달리, 본 방법은 첫 번째 레이어부터 네트워크 전반에 걸쳐 전역적 맥락을 모델링할 수 있다. 최근에 등장한 비전 트랜스포머(Vision Transformer, ViT)를 기반으로 하여, 이를 의미적 세그멘테이션에 확장하였다. 이를 위해 이미지 패치에 대응하는 출력 임베딩을 활용하며, 이 임베딩에서 포인트와이즈 선형 디코더 또는 마스크 트랜스포머 디코더를 통해 클래스 레이블을 추출한다. 이미지 분류를 위해 사전 훈련된 모델을 활용하여, 의미적 세그멘테이션에 사용 가능한 중간 규모 데이터셋에서 이를 미세 조정할 수 있음을 보였다. 선형 디코더만으로도 우수한 성능을 달성할 수 있으나, 클래스 마스크를 생성하는 마스크 트랜스포머를 도입함으로써 성능을 추가로 향상시킬 수 있다. 다양한 파라미터의 영향을 평가하기 위해 광범위한 아블레이션 연구를 수행하였으며, 특히 대규모 모델과 작은 패치 크기에서 성능이 더욱 우수함을 확인하였다. Segmenter는 의미적 세그멘테이션에서 뛰어난 성능을 기록하였으며, ADE20K 및 Pascal Context 데이터셋에서 기존 최고 성능을 초월하였으며, Cityscapes에서도 경쟁력 있는 성능을 보였다.