3달 전

주의 기반 다중 모달 융합 네트워크를 활용한 의미론적 장면 완성

Siqi Li, Changqing Zou, Yipeng Li, Xibin Zhao, Yue Gao

초록

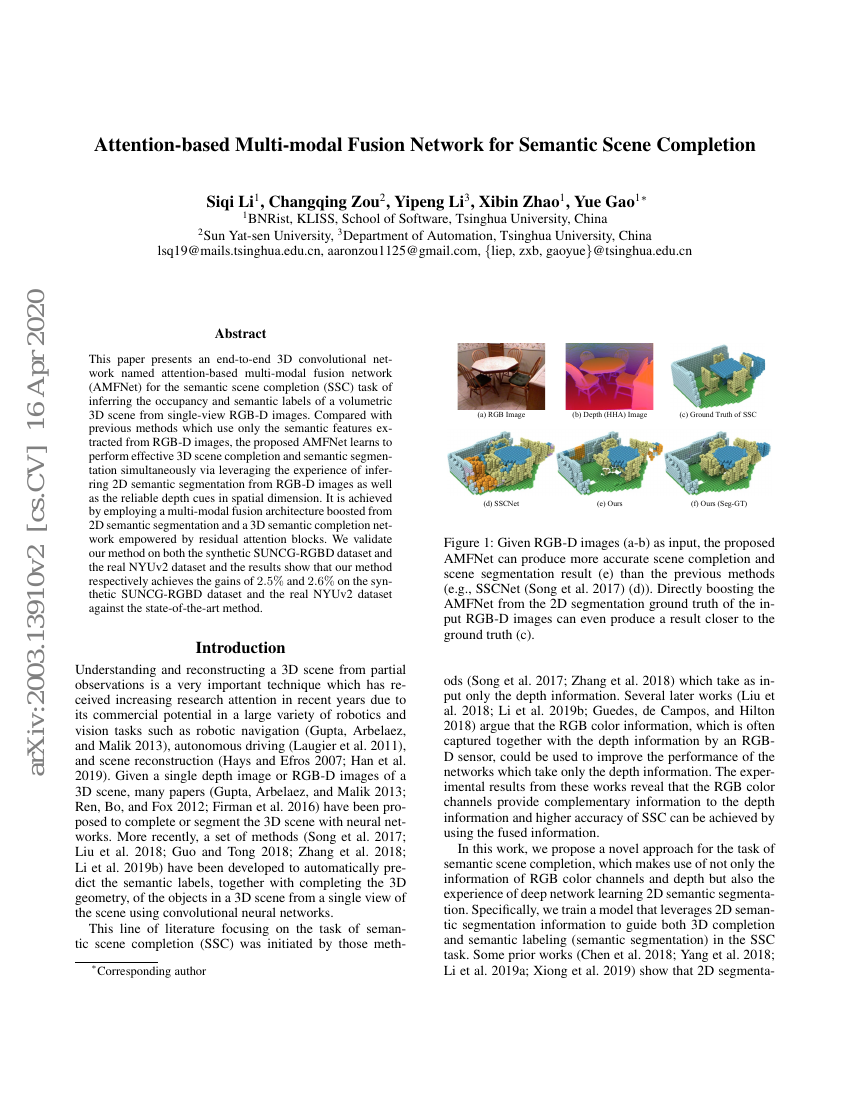

이 논문은 단일 뷰 RGB-D 이미지에서 볼륨형 3D 장면의 점유율 및 세분적 레이블을 추론하는 세분적 장면 완성(Semantic Scene Completion, SSC) 작업을 위한 엔드 투 엔드 3D 컨볼루션 네트워크인 주의 기반 다중 모달 융합 네트워크(Attention-based Multi-modal Fusion Network, AMFNet)를 제안한다. 기존의 RGB-D 이미지에서 추출한 세분적 특징만을 사용하는 방법들과 달리, 제안하는 AMFNet은 RGB-D 이미지로부터 2D 세분적 분할을 추론하는 경험과 공간 차원에서 신뢰할 수 있는 깊이 신호를 활용하여, 효과적인 3D 장면 완성과 세분적 분할을 동시에 수행할 수 있도록 학습한다. 이는 2D 세분적 분할에서 유래된 다중 모달 융합 아키텍처와 잔차 주의 블록을 통해 강화된 3D 세분적 완성 네트워크를 사용함으로써 달성된다. 제안한 방법은 합성된 SUNCG-RGBD 데이터셋과 실제 촬영된 NYUv2 데이터셋을 대상으로 검증되었으며, 최신 기술 대비 각각 합성된 SUNCG-RGBD 데이터셋에서 2.5%, 실제 NYUv2 데이터셋에서 2.6%의 성능 향상을 달성함을 실험을 통해 입증하였다.