4달 전

한 번에 여러 관계 추출하기: 사전 학습된 트랜스포머를 이용한 방법

Haoyu Wang; Ming Tan; Mo Yu; Shiyu Chang; Dakuo Wang; Kun Xu; Xiaoxiao Guo; Saloni Potdar

초록

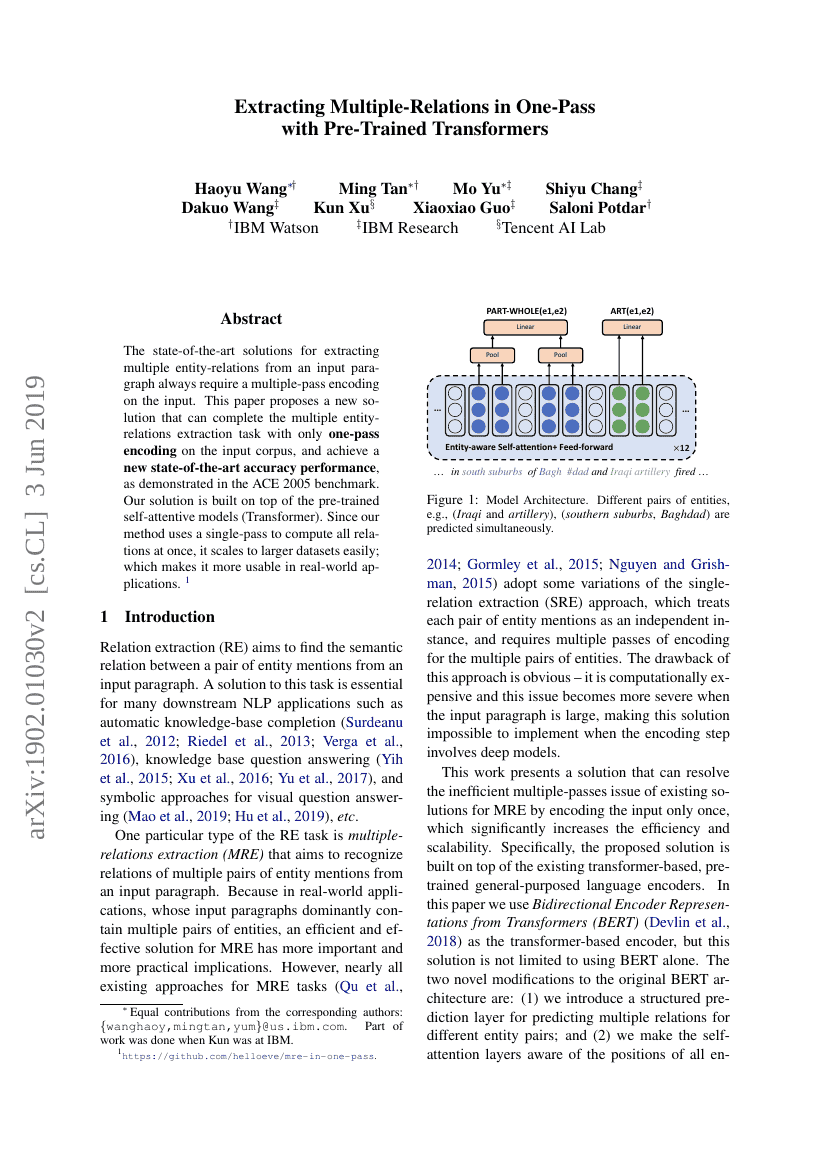

대부분의 문단에서 여러 관계를 추출하는 접근 방식은 문단을 여러 번 스캔해야 합니다. 실제로, 여러 번의 스캔은 계산적으로 비용이 많이 들며, 이는 긴 문단과 더 큰 텍스트 코퍼스로 확장하는 것을 어렵게 만듭니다. 본 연구에서는 문단을 단 한 번만 인코딩(원 패스)하여 여러 관계를 추출하는 작업에 집중하였습니다. 우리는 사전 학습된 자기 주의(트랜스포머) 모델을 기반으로 하여, 먼저 구조화된 예측 레이어를 추가하여 여러 엔티티 쌍 간의 추출을 처리하고, 그 다음 엔티티 인지 주의 기술을 사용하여 각 엔티티와 관련된 다수의 관계 정보를 포착하기 위해 문단 임베딩을 강화하였습니다. 실험 결과, 우리의 접근 방식이 확장성뿐만 아니라 표준 벤치마크인 ACE 2005에서도 최신 수준의 성능을 보임을 입증하였습니다.