Command Palette

Search for a command to run...

온라인 튜토리얼: SpikingBrain-1.0: 100배 속도 향상: 추론 효율성 100배 향상 달성

인공지능의 급속한 발전은 핵심 아키텍처인 트랜스포머(Transformer)와 불가분의 관계에 있습니다. 2017년 출시 이후, 병렬 컴퓨팅 기능과 강력한 모델링 성능을 갖춘 트랜스포머는 대규모 모델 아키텍처의 주류 표준으로 자리 잡았습니다. GPT 시리즈, LLaMA, 그리고 국내 Qwen 시리즈 등 모든 플랫폼이 트랜스포머 기반을 기반으로 구축되었습니다.

그러나 모델 크기가 계속 커지면서 Transformer는 점차 무시하기 어려운 몇 가지 문제를 노출시킵니다.예를 들어, 훈련 오버헤드는 시퀀스 길이에 따라 2차적으로 증가하고, 추론 중 메모리 사용량은 시퀀스 길이에 따라 선형적으로 증가하여 리소스 소모가 발생하고 매우 긴 시퀀스를 처리하는 능력이 제한됩니다.

극명한 대조적으로, 생물학적 뇌는 에너지 효율성과 유연성에 대해 완전히 다른 접근 방식을 취합니다. 인간의 뇌는 약 20와트의 전력만 소비하지만 지각, 기억, 언어, 복잡한 추론 등 광범위한 작업을 처리할 수 있습니다. 이러한 대조는 연구자들에게 다음과 같은 고민을 불러일으켰습니다. 만약 대형 모델이 뇌와 더 유사하게 설계되고 계산된다면, 트랜스포머가 야기하는 병목 현상을 극복할 수 있을까요?

이러한 탐색을 바탕으로,중국과학원 자동화연구소는 국가뇌인지 및 뇌모사지능중점실험실(National Key Laboratory of Brain Cognition and Brain-Inspired Intelligence) 및 기타 연구기관들과 협력하여 뇌 뉴런의 복잡한 작동 메커니즘을 활용하여 "내생적 복잡성 기반" 대규모 모델 아키텍처를 제안했습니다. 올해 9월, 그들은 국내에서 자체 제작하고 독립적으로 제어 가능한 뇌모사 펄스 대규모 모델인 "SpikingBrain-1.0"을 출시했습니다.이 모델은 스파이킹 뉴런의 내재적 동역학과 선형 어텐션 모델 간의 연관성을 이론적으로 확립하여, 기존 선형 어텐션 메커니즘이 수상돌기 연산의 특화된 단순화임을 밝히고, 모델 복잡도와 성능을 지속적으로 개선할 수 있는 새롭고 실행 가능한 방향을 제시합니다. 또한, R&D 팀은 선형 및 혼합 선형 복잡도를 갖는 스파이킹 뉴런 기반의 새로운 뇌 기반 모델을 구축하고 오픈소스화했습니다. 또한, 국내 GPU 클러스터, Triton 연산자 라이브러리, 모델 병렬화 전략, 그리고 클러스터 통신 기본 요소를 위한 효율적인 학습 및 추론 프레임워크를 개발했습니다.

실험적 검증을 통해,SpikingBrain-1.0은 네 가지 성능 측면에서 획기적인 성과를 거두었습니다. 극히 적은 데이터 볼륨으로 효율적인 학습을 달성하고, 추론 효율성을 획기적으로 개선하고, 국내에서 제작한 독립적이고 제어 가능한 대규모 뇌 유사 모델 생태계를 구축하고, 동적 임계값 펄싱을 기반으로 하는 다중 규모 희소성 메커니즘을 제안했습니다.SpikingBrain-7B 모델은 400만 토큰 시퀀스에서 첫 토큰 생성 시간(TTF)이 100배 향상되었습니다. SpikingBrain-7B 모델 훈련은 수백 개의 MetaX C550 GPU에서 수 주 동안 안정적으로 실행되었으며, 23.41 TP3T의 FLOP 활용률을 달성했습니다.제안된 펄스 방식은 69.15%의 희소성을 달성하여 저전력 작동이 가능합니다.

주목할 점은 다음과 같습니다.우리나라에서 대규모 뇌 유사 선형 기본 모델 아키텍처를 제안한 것은 이번이 처음이며, 대규모 뇌 유사 펄스 모델에 대한 학습 및 추론 프레임워크가 국내 GPU 컴퓨팅 클러스터에 구축된 것도 이번이 처음입니다.초장거리 시퀀스 처리 기능은 법률 및 의료 문서 분석, 복잡한 다중 에이전트 시뮬레이션, 고에너지 입자 물리학 실험, DNA 시퀀스 분석, 분자 동역학 궤적과 같은 초장거리 시퀀스 작업 모델링 시나리오에서 상당한 잠재적 효율성 이점을 제공합니다.

현재 HyperAI 공식 웹사이트의 "튜토리얼" 섹션에서 "SpikingBrain-1.0: 내재적 복잡성 기반 뇌 유사 스파이킹 모델"을 이용하실 수 있습니다. 아래 링크를 클릭하여 원클릭 배포 튜토리얼을 경험해 보세요. ⬇️

튜토리얼 링크:

데모 실행

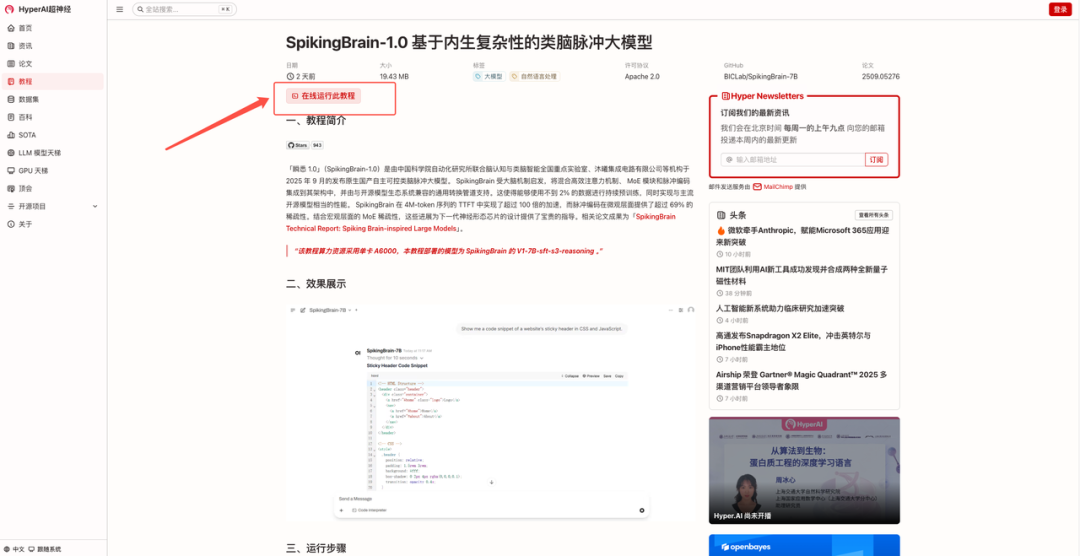

1. hyper.ai 홈페이지를 방문한 후 "튜토리얼" 페이지를 선택하고 "SpikingBrain-1.0: 내재적 복잡성을 기반으로 한 대규모 뇌 유사 스파이킹 모델"을 선택한 후 "이 튜토리얼을 온라인으로 실행"을 클릭합니다.

2. 페이지가 이동한 후 오른쪽 상단의 "복제"를 클릭하여 튜토리얼을 자신의 컨테이너로 복제합니다.

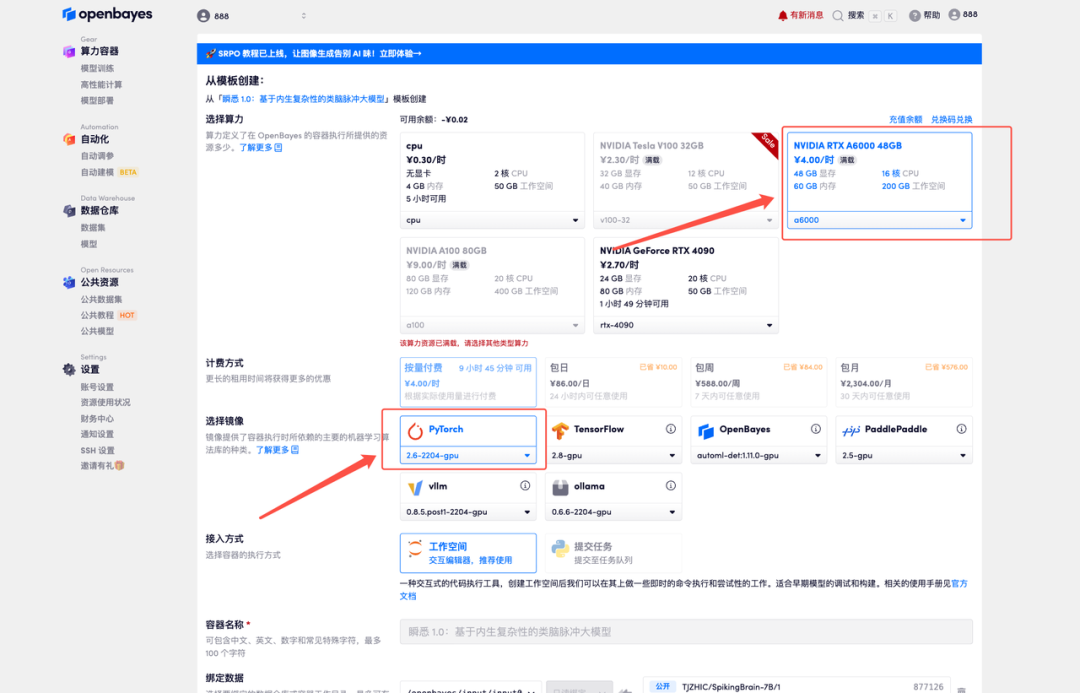

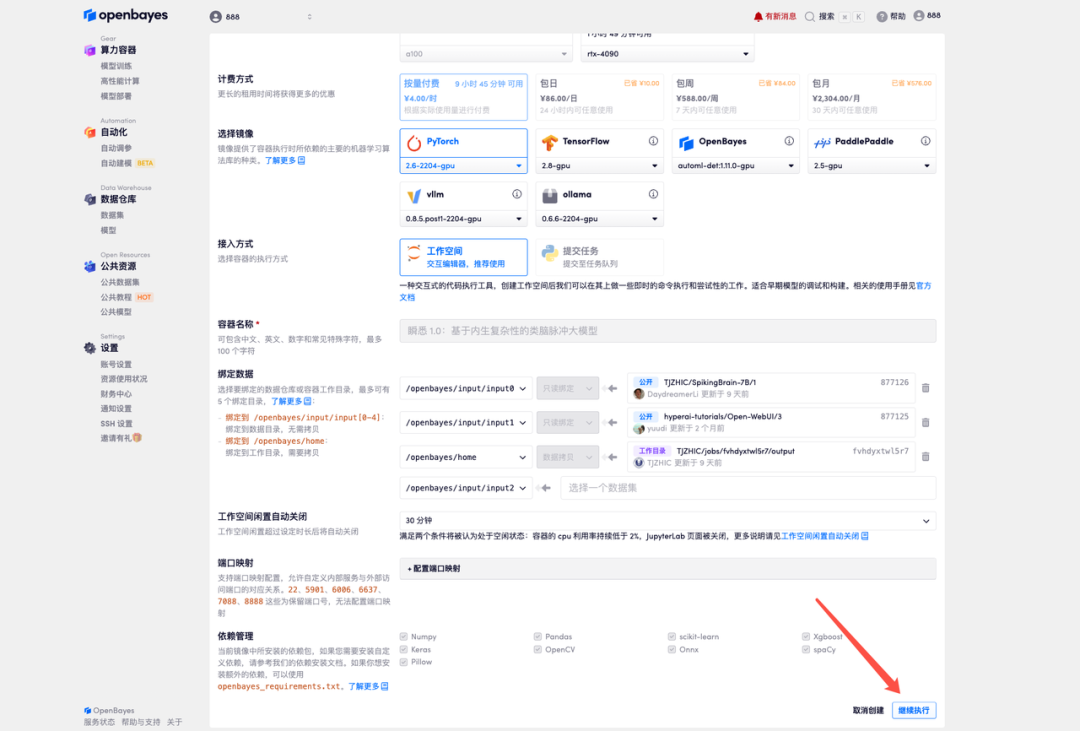

3. NVIDIA RTX A6000 48GB 및 PyTorch 이미지를 선택하고 "계속"을 클릭하세요. OpenBayes 플랫폼은 사용량 기반 요금제 또는 일일/주간/월간 요금제 등 네 가지 결제 옵션을 제공합니다. 신규 사용자는 아래 초대 링크를 통해 등록하시면 RTX 4090 4시간과 CPU 5시간 무료 이용권을 받으실 수 있습니다!

HyperAI 독점 초대 링크(복사하여 브라우저에서 열기):

https://openbayes.com/console/signup?r=Ada0322_NR0n

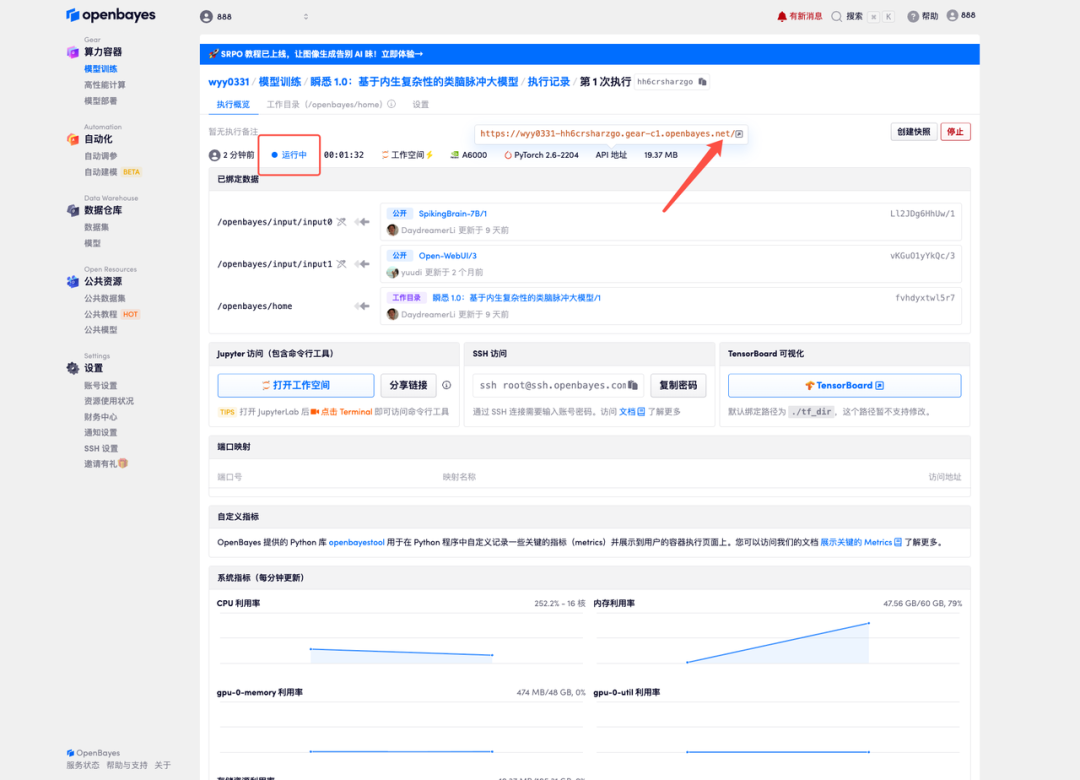

4. 리소스가 할당될 때까지 기다리세요. 첫 번째 복제 프로세스는 약 3분 정도 소요됩니다. 상태가 "실행 중"으로 변경되면 "API 주소" 옆의 화살표를 클릭하여 데모 페이지로 이동하세요. API 주소를 사용하려면 실명 인증을 완료해야 합니다.

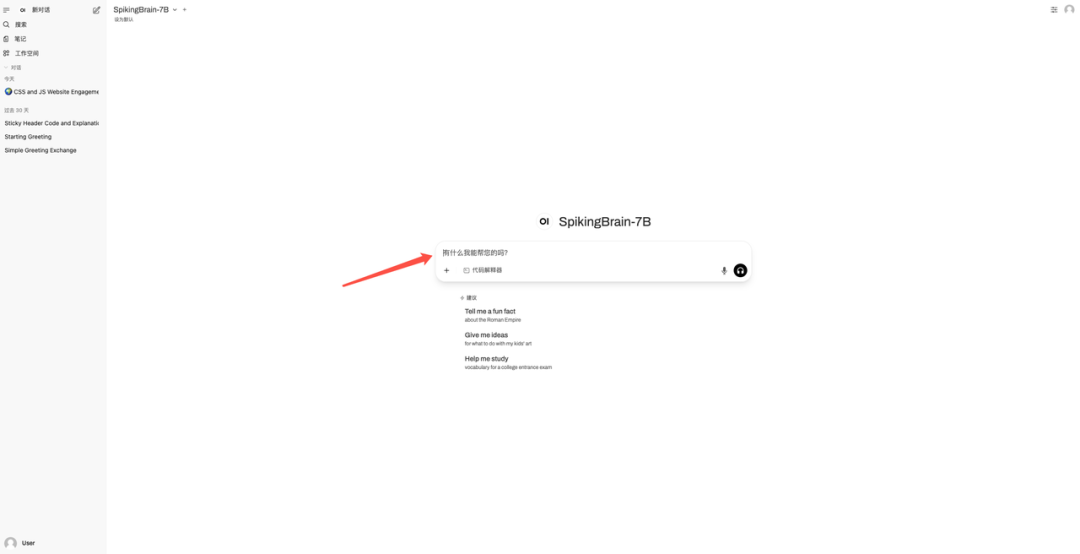

5. 대화 상자에 질문을 입력하여 답변을 시작하세요.

효과 시연

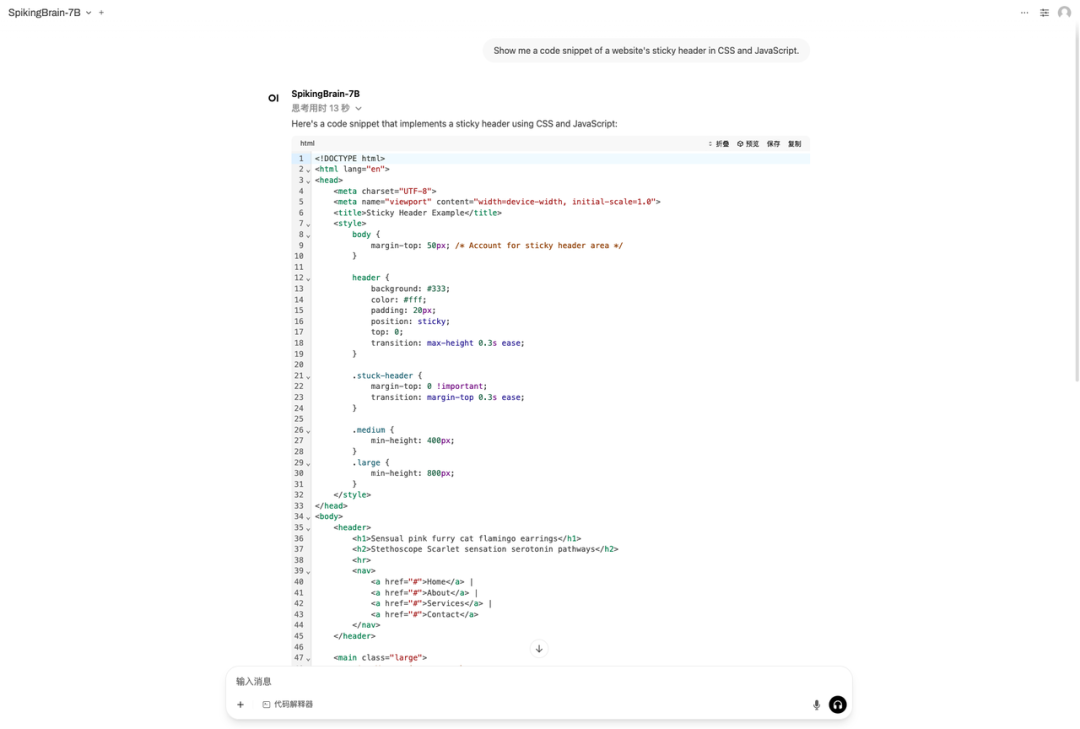

"CSS와 JavaScript로 작성된 웹사이트 고정 헤더 코드 조각을 보여주세요."라는 질문을 예로 들었습니다. 결과는 아래 그림과 같습니다.

위는 HyperAI가 이번에 추천하는 튜토리얼입니다. 누구나 와서 체험해 보세요!

튜토리얼 링크: