Command Palette

Search for a command to run...

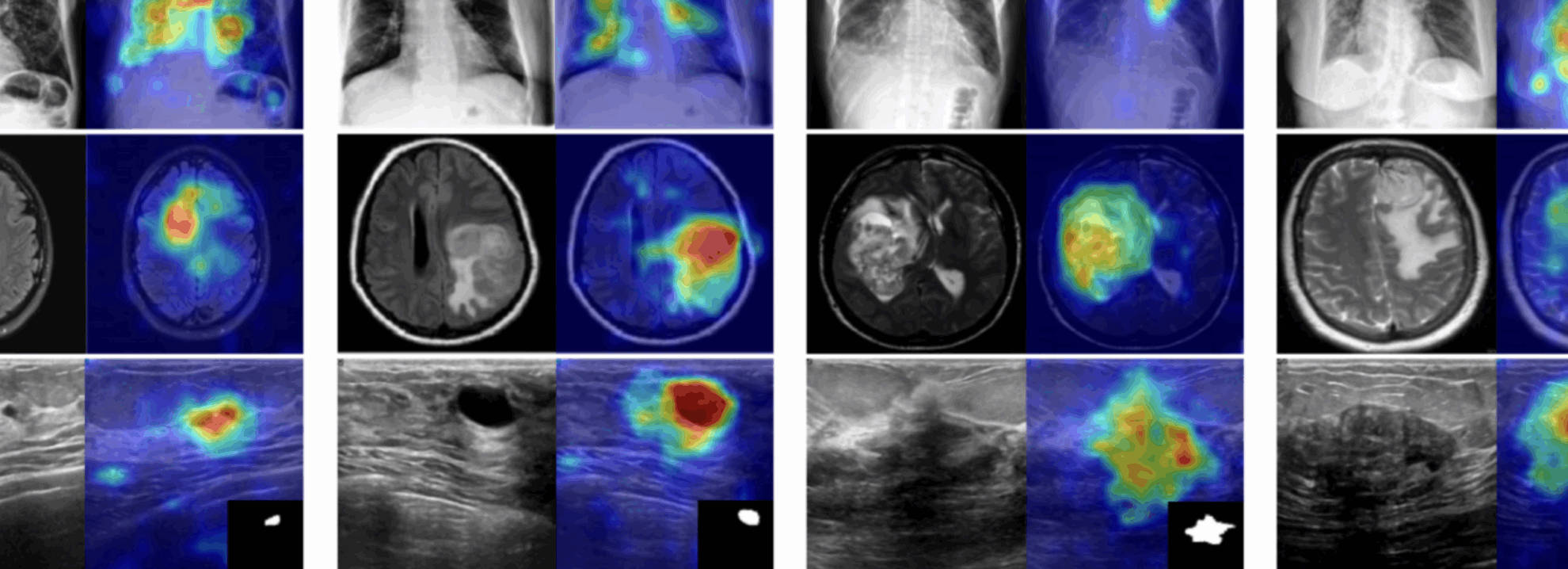

MediCLIP은 최소한의 의료 영상 데이터를 사용하여 이상 탐지 및 위치 파악에서 최첨단 결과를 달성합니다.

임상 진단 및 치료에서 의료 영상 기술(예: 엑스레이, CT 스캔, 초음파)은 의사의 진단에 매우 중요합니다. 환자가 영상 검사를 완료하면 일반적으로 영상의학과 전문의나 초음파 전문의가 영상을 판독합니다. 이러한 전문적인 판독은 이상 소견을 파악하고, 병변을 찾아내고, 진단 보고서를 작성하여 임상적 의사결정에 중요한 도움을 제공합니다.

인공지능 기술의 발전으로 의료영상 분석은 새로운 변화를 가져오고 있습니다.현재 머신 러닝은 의료 영상에서 이상을 감지하는 작업, 즉 정상 영상과 병변이 있는 비정상 영상을 구별하고 병변 영역의 위치를 식별하는 작업을 수행할 수 있습니다.이러한 유형의 기술은 의학적 의사 결정 지원에 핵심적인 역할을 합니다. 일부 고급 감지 모델은 특정 작업에서 전문 임상의만큼 뛰어난 성능을 발휘하여 의사 결정 위험을 줄이는 동시에 의료진의 업무 효율성을 향상시킵니다.

그러나 기존의 의료 영상 이상 탐지 방법은 일반적으로 학습을 위해 대규모 데이터셋에 의존합니다. 이는 더 높은 성능을 얻을 수 있지만, 개발 비용이 크게 증가한다는 단점이 있습니다.

범용 CLIP 모델은 제로샷 전이(zero-shot transfer)에서는 우수한 성능을 보이지만, 의료 영상 이상 탐지에 직접 적용하는 것은 도메인 차이와 부족한 주석으로 인해 제한적입니다. 2022년, 일리노이 대학교 어바나-샴페인 캠퍼스 연구팀은 MedCLIP 방법을 제안했습니다. CLIP과 같은 시각-텍스트 대조 학습 모델에서 영감을 얻은 이 접근법은 이미지-텍스트 대조 학습을 분리하고 의학 지식을 통합하여 위음성을 제거함으로써 이러한 패러다임을 의료 영상 분류 및 교차 모달 검색으로 확장합니다. 이 방법은 데이터 양이 상당히 감소했음에도 불구하고 탁월한 성능을 발휘합니다.

MedCLIP은 데이터 의존성 완화에 상당한 성과를 거두었지만, 분류 및 검색 작업을 위해 설계되었기 때문에 이상 탐지, 특히 병변 위치 파악에는 적합하지 않습니다. 한편, 최근 연구에서는 제로샷/스몰샷 이상 탐지에 CLIP을 적용하여 인상적인 결과를 얻었습니다. 그러나 이러한 방법은 모델 학습을 위해 실제 이상 이미지와 픽셀 단위로 주석이 추가된 보조 데이터셋을 필요로 하는 경우가 많은데, 이는 의료 분야에서는 확보하기 어렵습니다.

이러한 문제를 해결하기 위해 베이징 대학 연구팀은 소규모 표본 의료 이미지 이상 탐지를 위한 효율적인 솔루션인 MediCLIP을 제안했습니다.이 방법은 소량의 정상적인 의료 이미지만 필요로 하며 이상 탐지 및 위치 파악 작업에서 선도적인 성능을 달성합니다.이 기술은 다양한 의료 영상 유형에서 다양한 질병을 효과적으로 감지하여 놀라운 제로 샘플 일반화 기능을 보여줍니다.

"MediCLIP: CLIP을 이용한 소규모 의료 영상에서의 이상 탐지"HyperAI 공식 웹사이트(hyper.ai)의 튜토리얼 섹션에서 매우 효과적인 지능형 의료 영상 진단 방법을 경험해 보세요.

튜토리얼 링크:

데모 실행

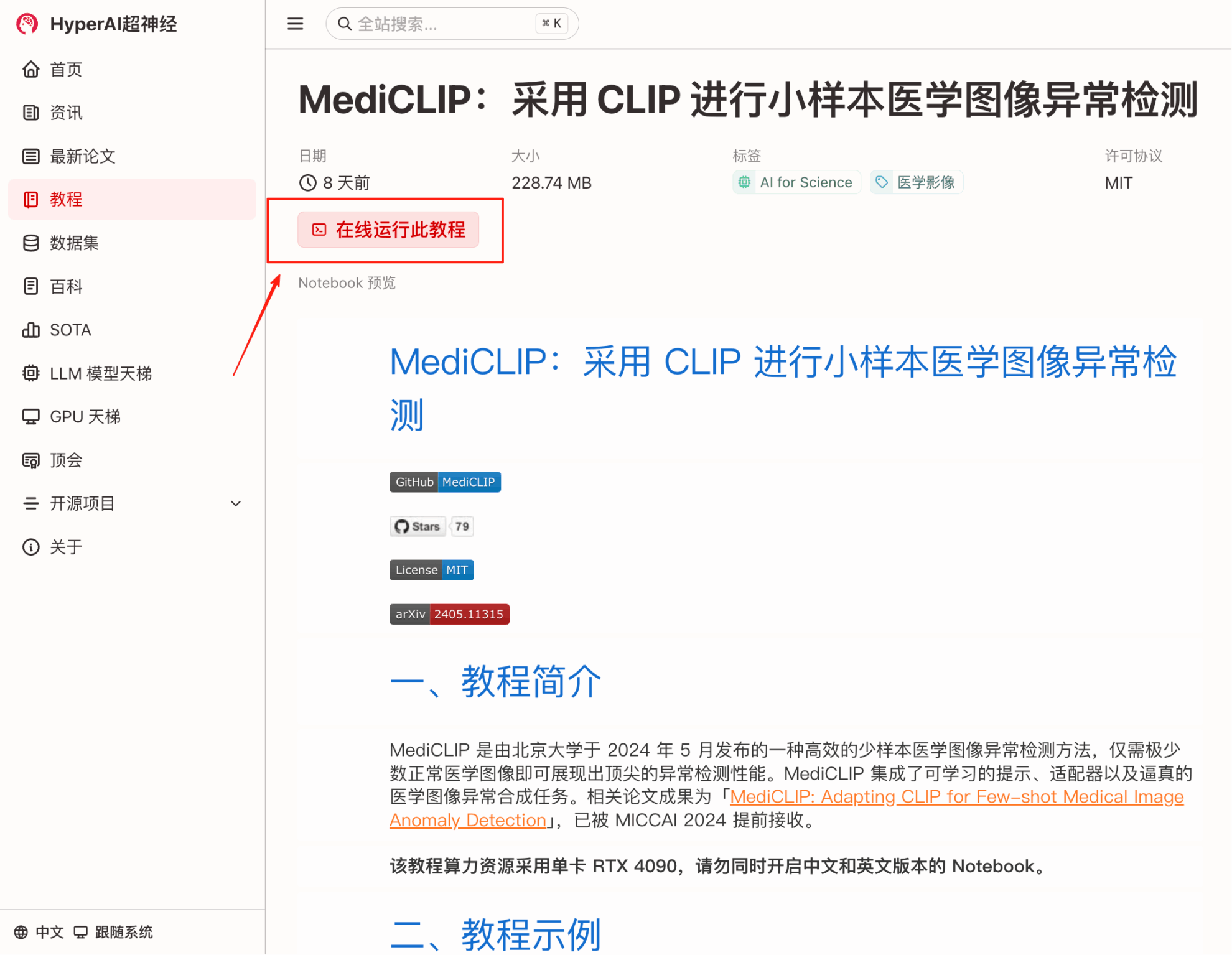

1. hyper.ai 홈페이지에서 튜토리얼 페이지를 선택하고, MediCLIP: CLIP을 사용하여 소규모 샘플 의료 이미지에서 이상 감지를 선택한 후, 이 튜토리얼을 온라인으로 실행을 클릭합니다.

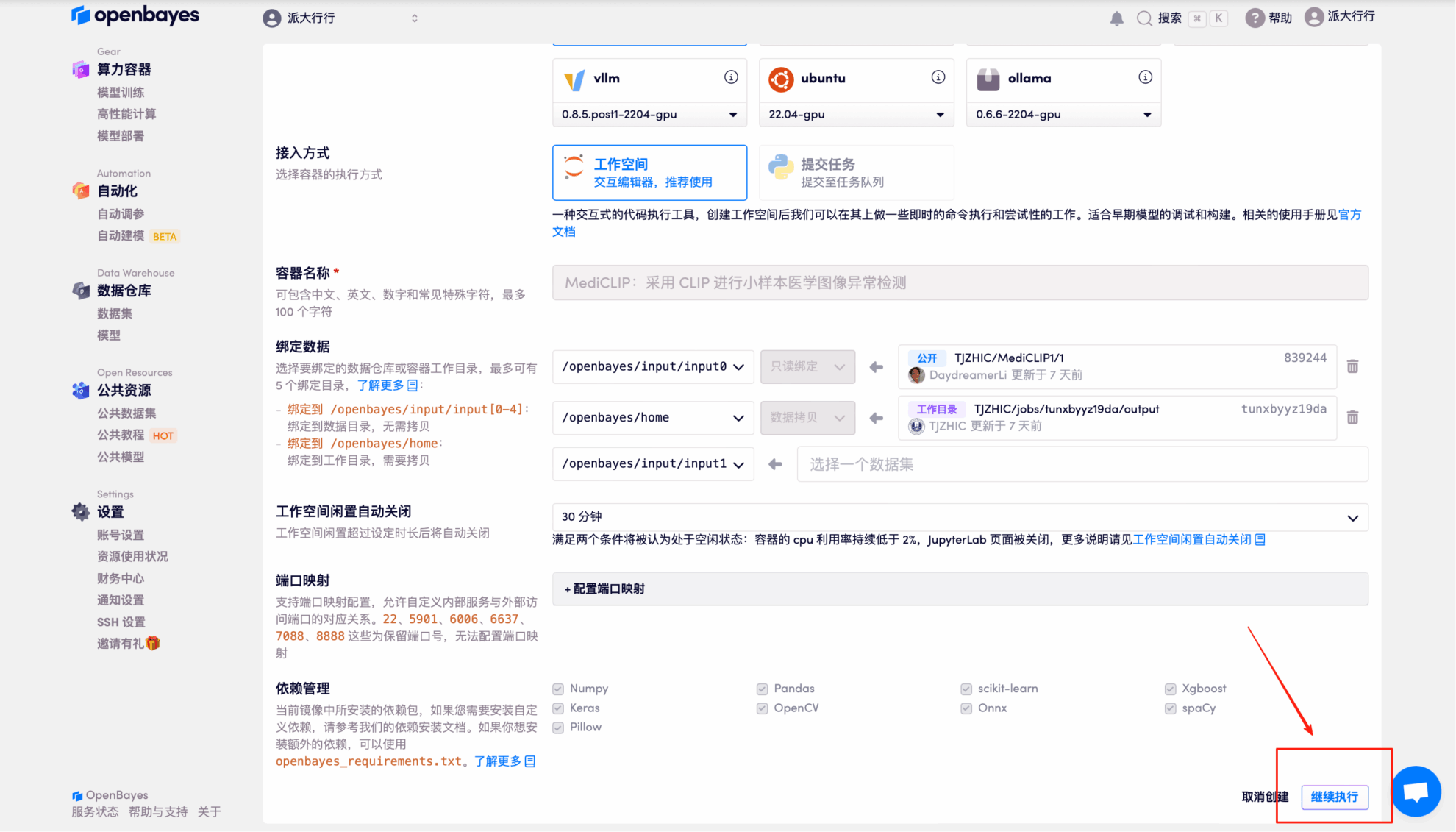

2. 페이지가 이동한 후 오른쪽 상단의 "복제"를 클릭하여 튜토리얼을 자신의 컨테이너로 복제합니다.

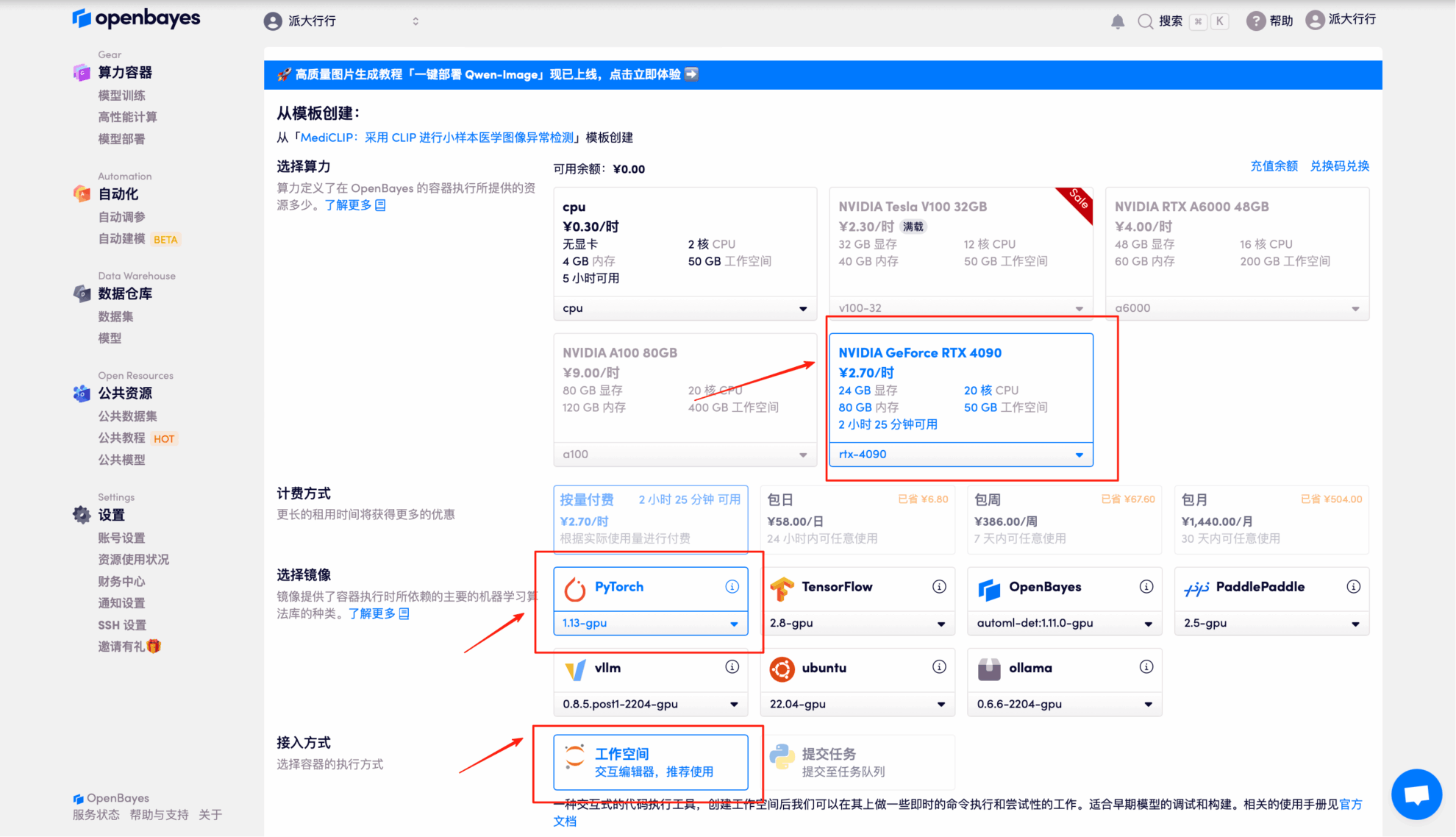

3. NVIDIA GeForce RTX 4090 및 PyTorch 이미지를 선택하고 계속을 클릭합니다. OpenBayes 플랫폼은 4가지 청구 방법을 제공합니다. 귀하의 요구 사항에 따라 "사용 후 결제" 또는 "일일/주간/월간 결제"를 선택할 수 있습니다. 신규 사용자는 아래 초대 링크를 사용하여 등록하고 RTX 4090 4시간 + CPU 자유 시간 5시간을 받으세요!

HyperAI 독점 초대 링크(복사하여 브라우저에서 열기):

https://openbayes.com/console/signup?r=Ada0322_NR0n

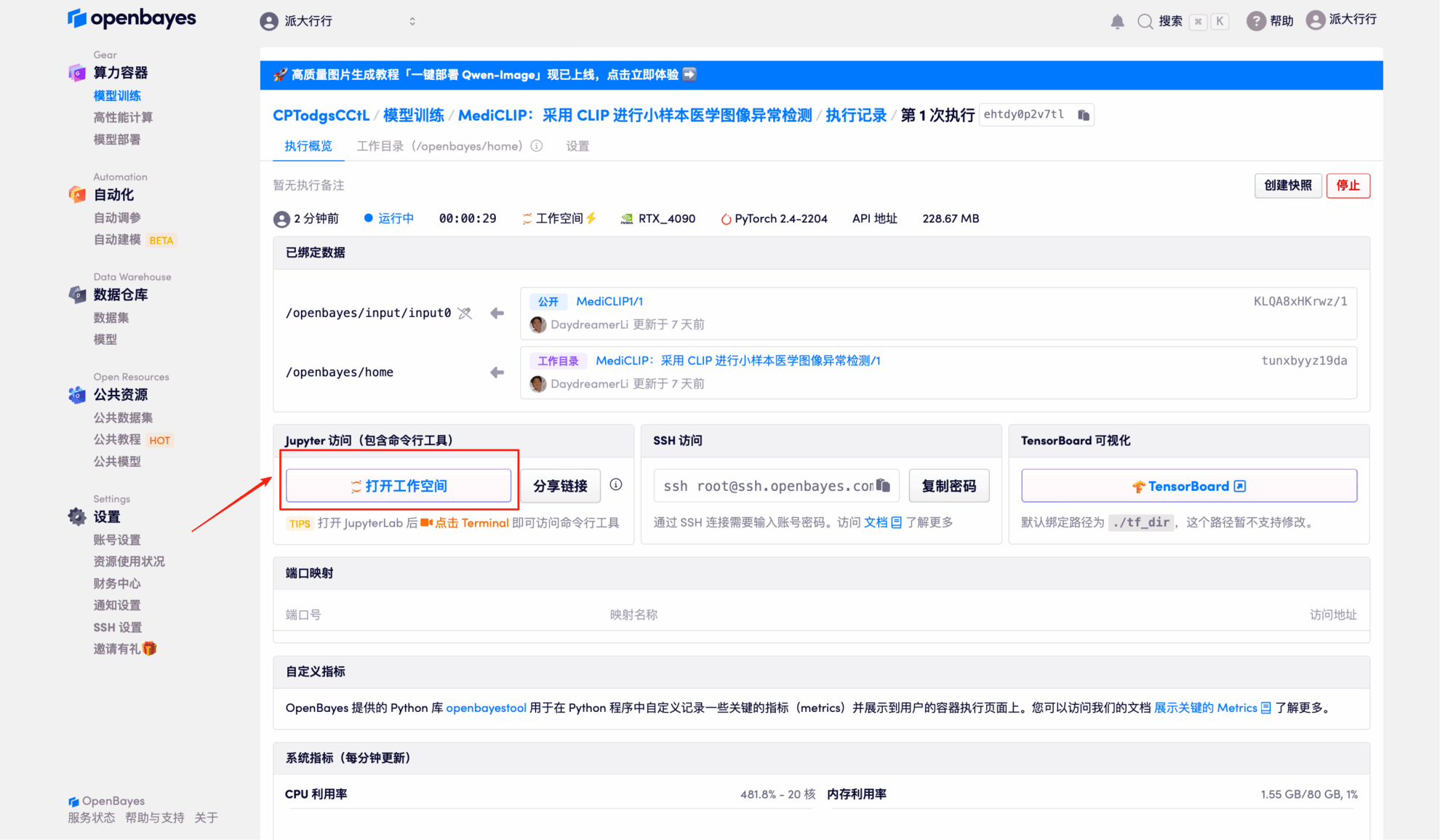

4. 리소스가 할당될 때까지 기다리세요. 첫 번째 복제에는 약 2분 정도 걸립니다. 상태가 "실행 중"으로 변경되면 "작업 공간 열기"를 클릭하세요.

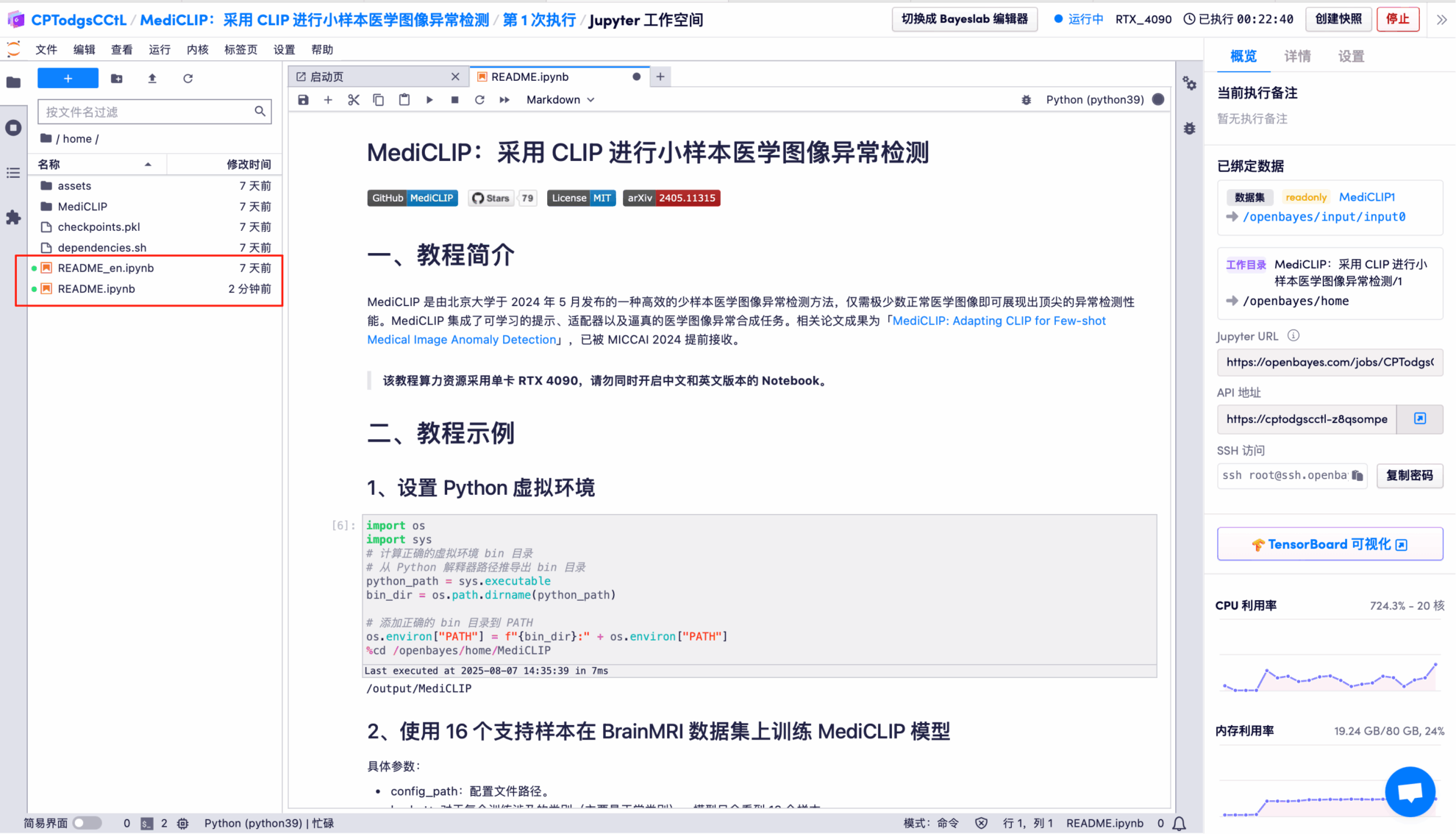

5. 왼쪽 디렉터리에서 프로젝트 이름을 두 번 클릭하여 사용을 시작하세요. 참고: 이 튜토리얼에서는 RTX 4090 GPU 하나를 사용합니다. Notebook의 중국어 버전과 영어 버전을 동시에 열지 말고, 하나만 여세요. README.ipynb 파일을 사용하는 것이 좋습니다(중국어 버전이 읽기 더 쉽습니다).

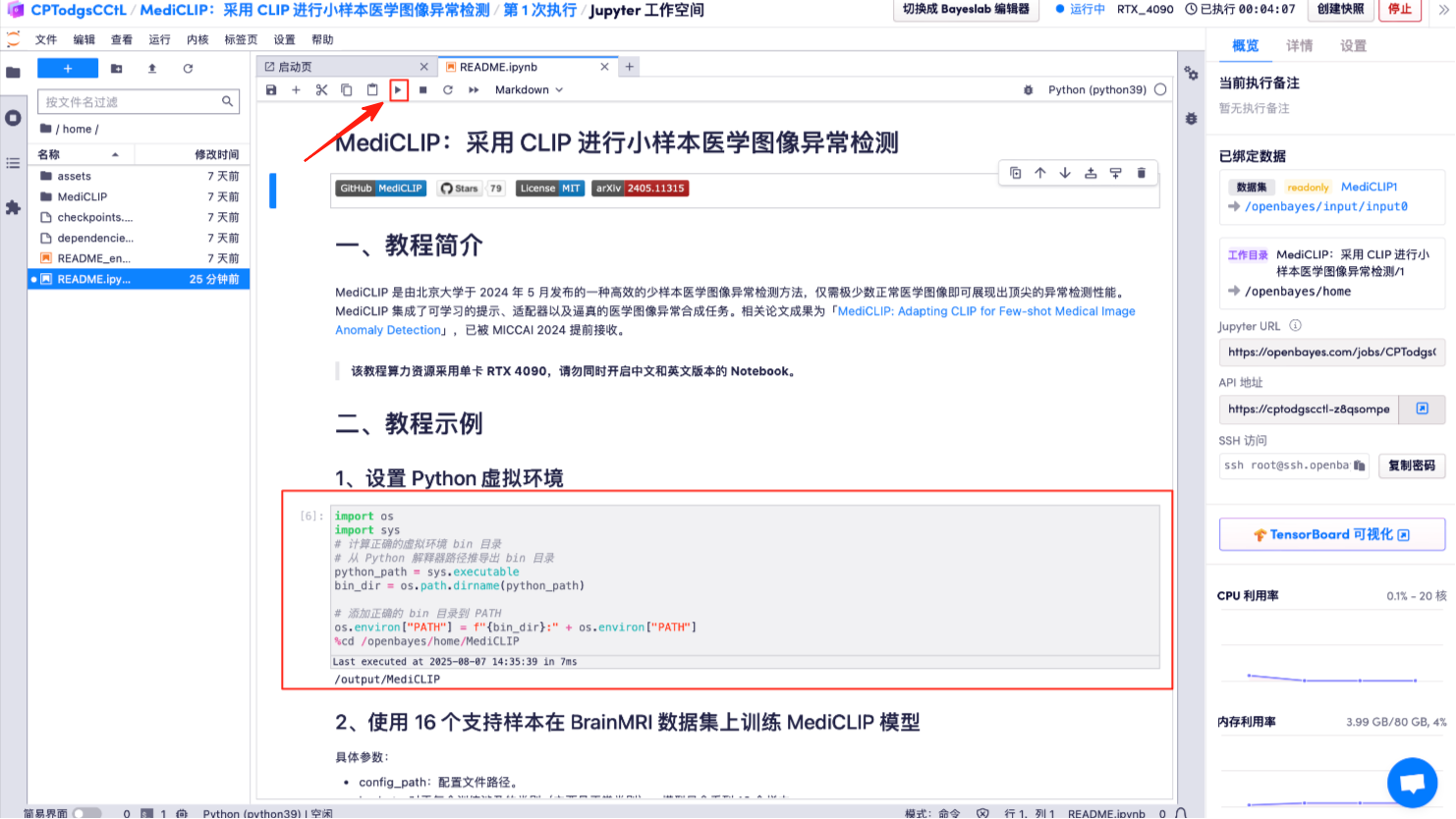

6. 위의 "실행 버튼"을 클릭하세요: Python 가상 환경을 설정합니다.

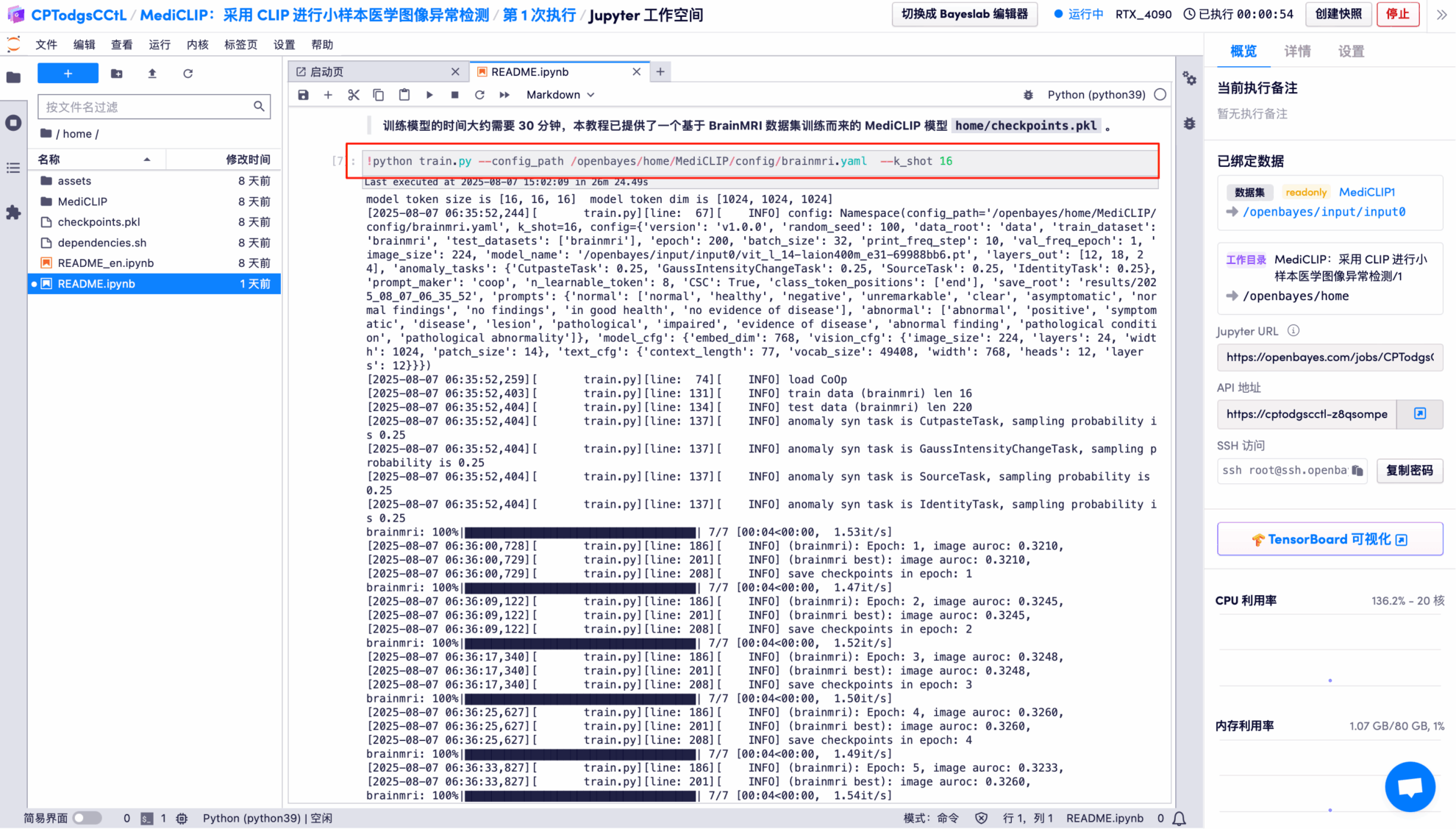

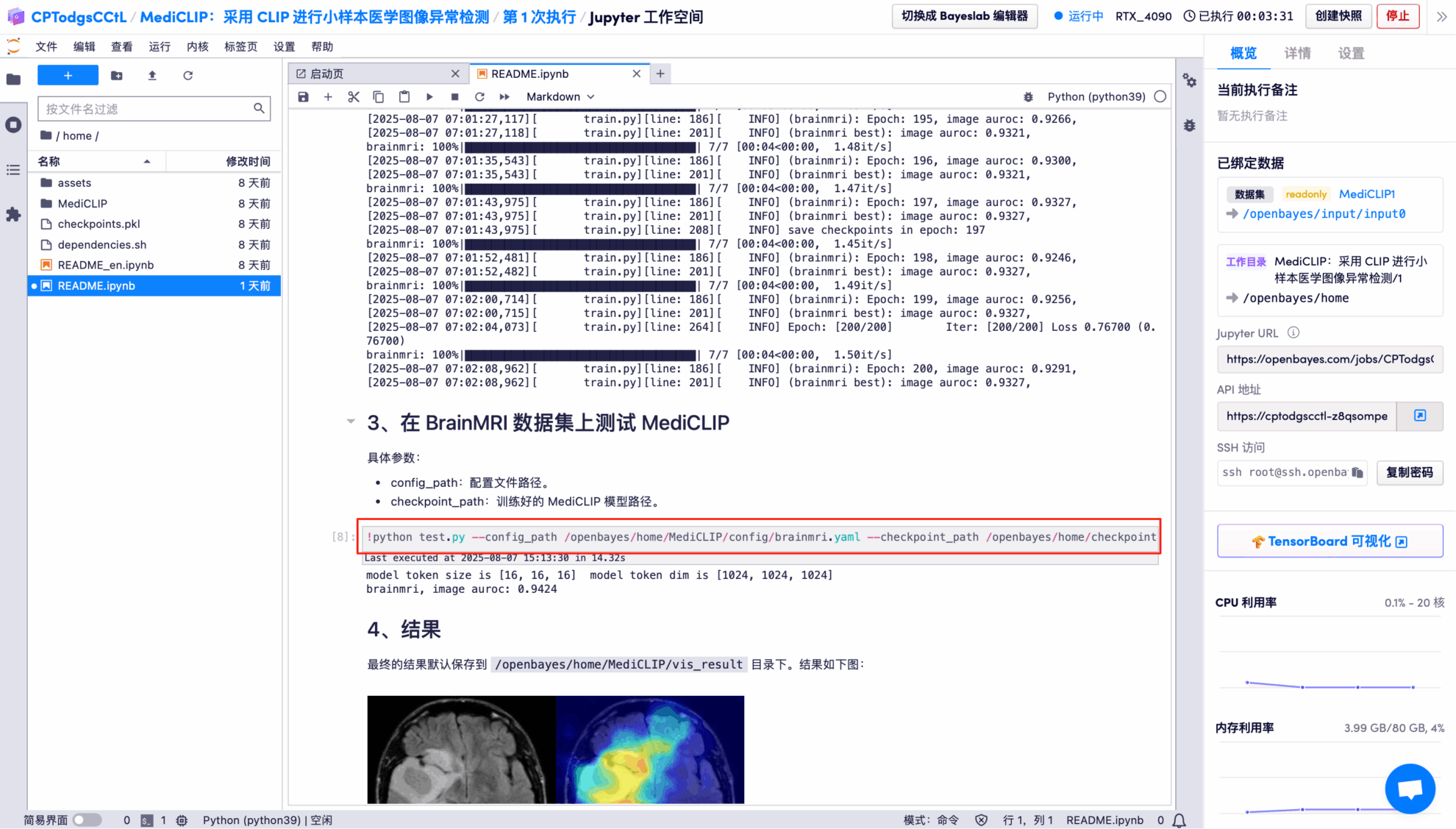

7. 16개의 지원 샘플을 사용하여 BrainMRI 데이터 세트에서 학습된 MediCLIP 모델.

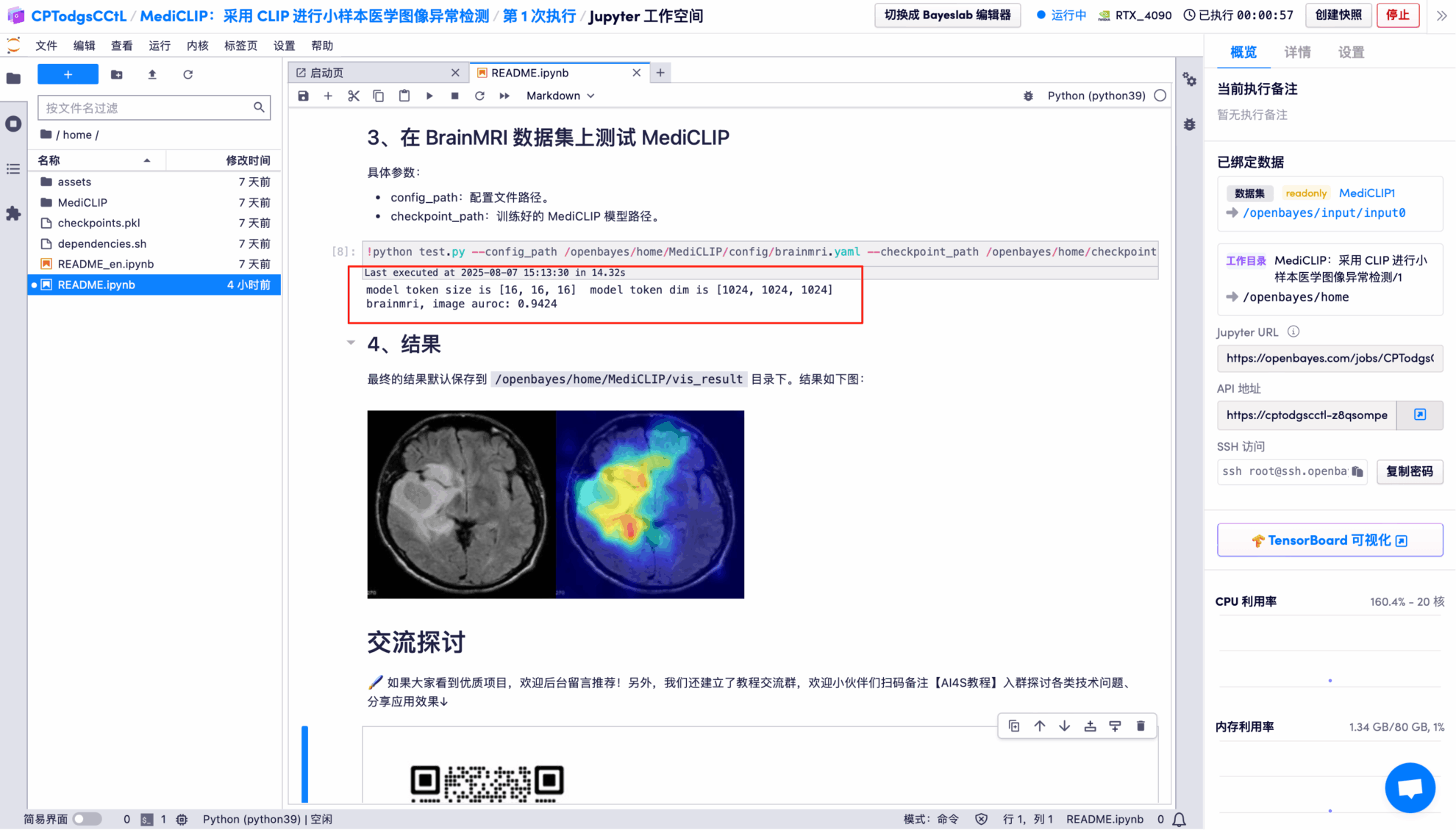

8. 훈련된 모델을 사용하여 BrainMRI 데이터 세트를 테스트합니다.

효과 시연

출력 결과는 해당 모델이 BrainMRI 테스트 세트의 이미지에 대한 이진 분류에서 매우 우수한 성능을 보이며, AUROC는 0.9424(1의 만점에 가까움)입니다.

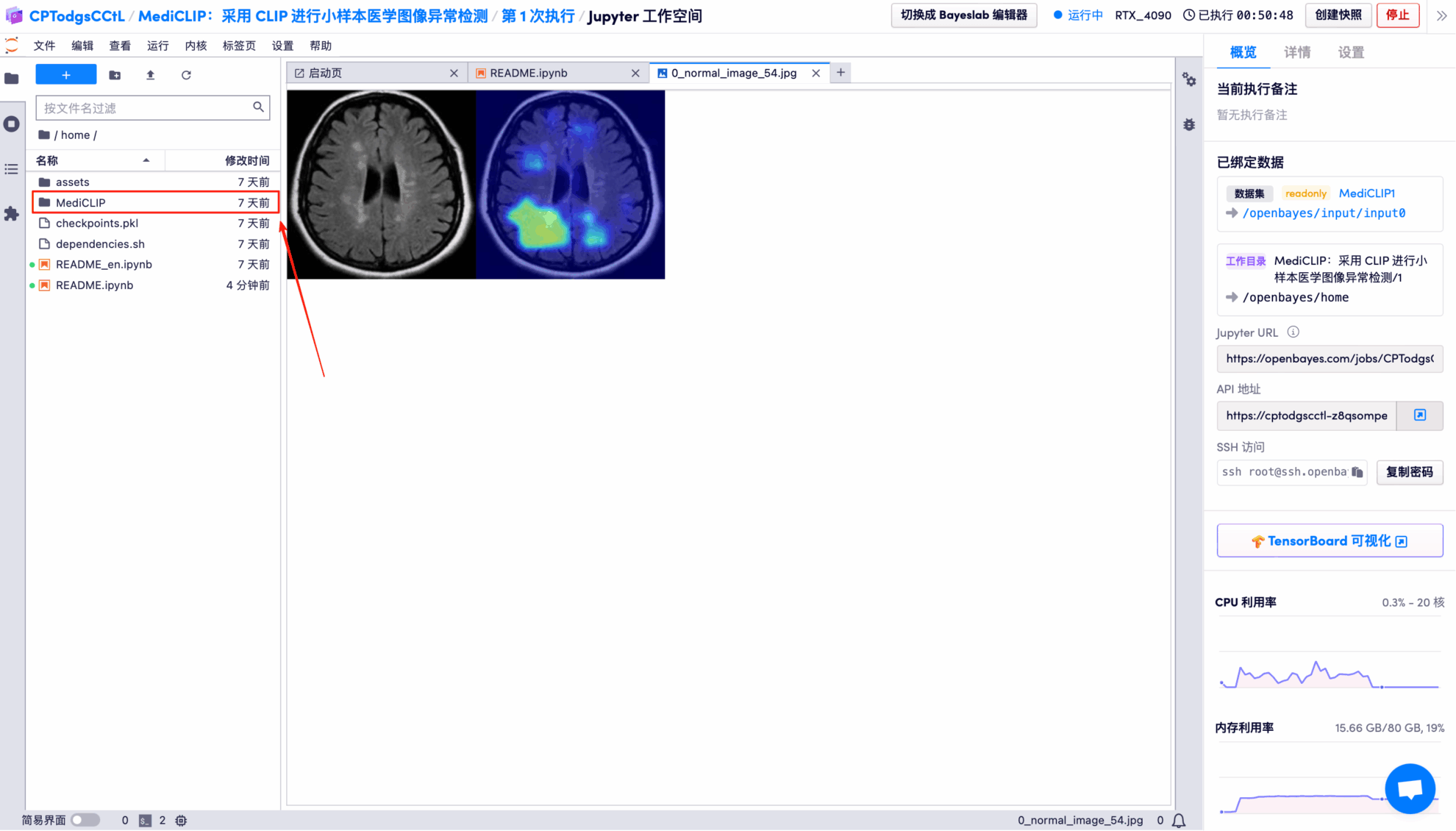

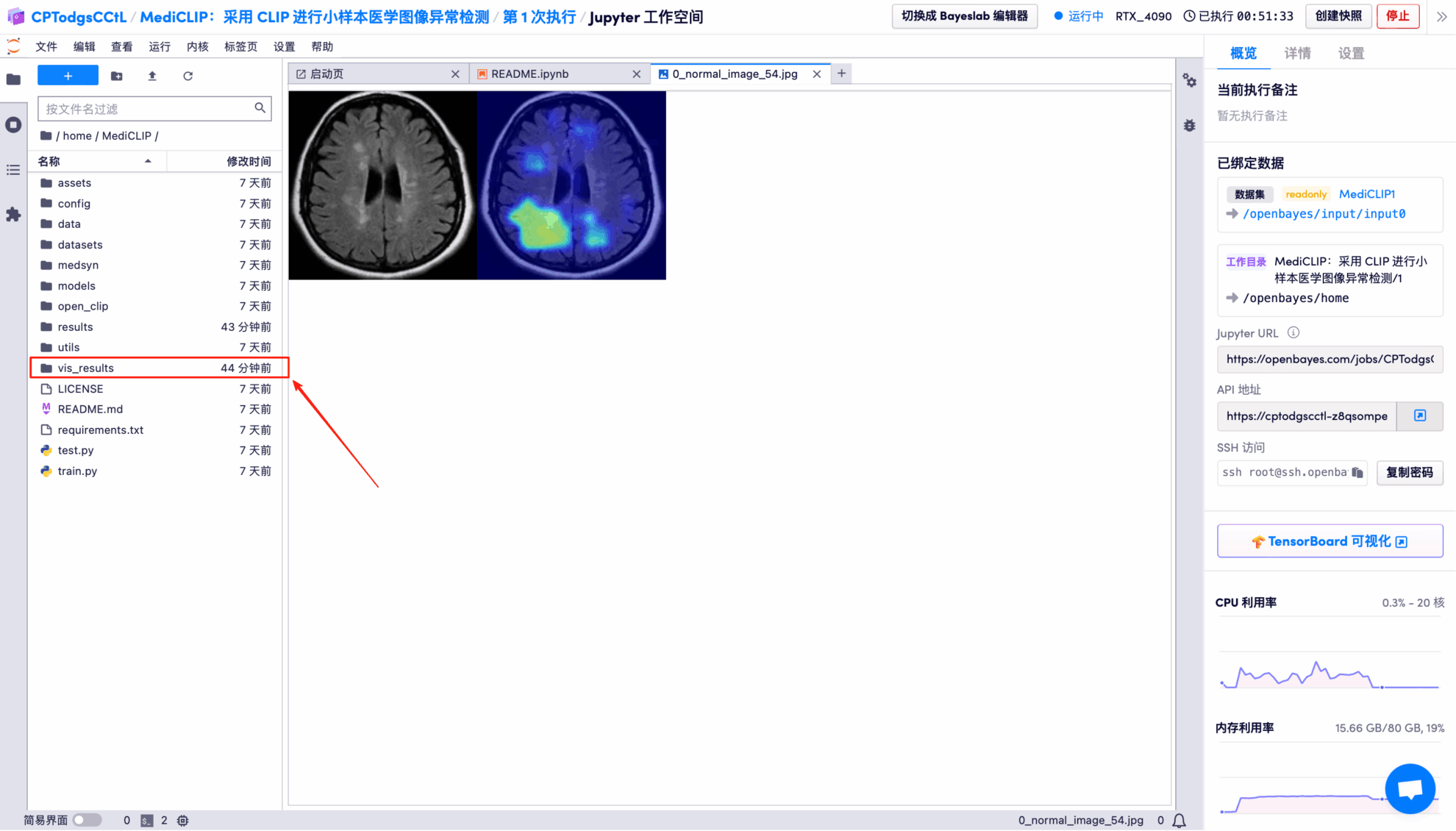

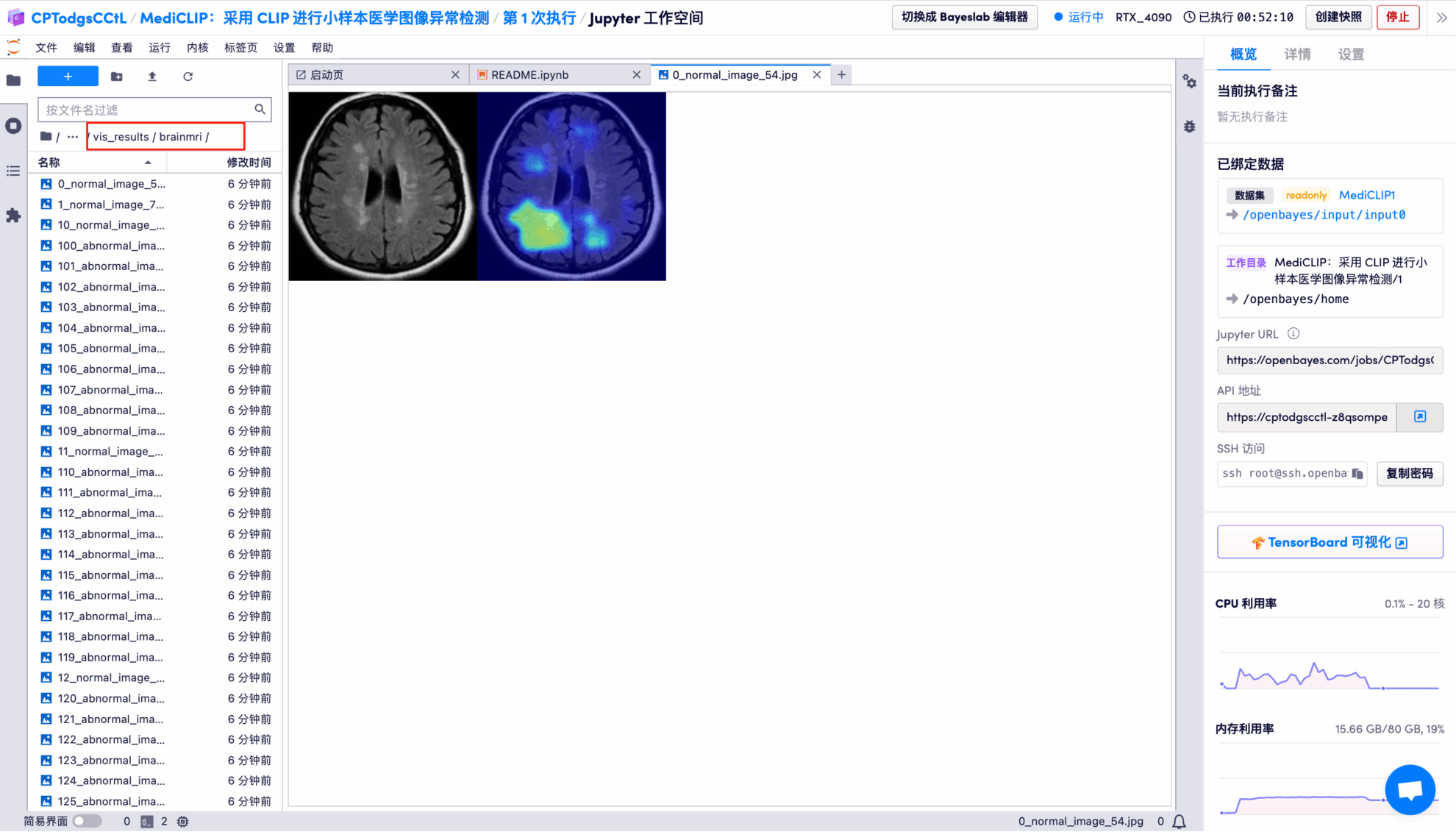

각 테스트 이미지에 대한 모델의 시각적 감지 결과는 기본적으로 openbayes//home/MediCLIP/vis_result 디렉터리에 저장됩니다. 자세한 위치는 아래 그림과 같습니다.

무작위로 테스트 결과 사진을 열어 보세요. 명확하고 직관적으로 표시됩니다.

* 왼쪽: 원본 뇌 이미지

* 오른쪽: 강조된 "비정상 영역"

위는 HyperAI가 이번에 추천하는 튜토리얼입니다. 누구나 와서 체험해 보세요!

튜토리얼 링크: