Command Palette

Search for a command to run...

튜토리얼 포함: 의료 VLM의 새로운 혁신! HealthGPT는 복잡한 MRI 모달리티 이해에서 99.7% 정확도를 달성하며, 단일 모델로 여러 세대 작업을 처리할 수 있습니다.

현대 의학 진단 및 연구는 의료 영상의 해석 및 생성에 크게 의존합니다. X-레이 병변 식별부터 MRI에서 CT로의 영상 변환까지, 각 연결은 AI 시스템의 다중 모드 처리 능력에 엄격한 요건을 부과합니다. 그러나 현재 의료 시각 언어 모델(LVLM) 개발은 두 가지 병목 현상에 직면해 있습니다.의료 데이터의 특수성으로 인해 대규모의 고품질 주석 데이터가 부족합니다.공개적으로 이용 가능한 의료 영상 데이터 세트의 크기는 일반적으로 일반 데이터 세트의 1만 분의 1에 불과하므로, 처음부터 통합 모델을 구축해야 할 필요성을 뒷받침하기 어렵습니다. 반면,이해와 업무 생성 사이의 본질적인 모순은 조화하기 어렵습니다.——이해 작업은 추상적인 의미론적 일반화를 필요로 하는 반면, 생성 작업은 세부 정보를 정확하게 기억해야 합니다. 기존의 하이브리드 학습은 "한 가지에 집중하다가 다른 것을 놓치는" 현상으로 인해 성능 저하를 초래하는 경우가 많습니다.

기술 진화의 관점에서 볼 때, Med-Flamingo와 LLaVA-Med와 같은 초기 의료용 LVLM은 주로 시각적 이해 작업에 집중하여 이미지-텍스트 정렬을 통해 의료 이미지의 의미론적 해석을 달성했지만, "시각화" 생성 기능이 부족했습니다. Unified-IO 2와 Show-o와 같은 범용 통합 LVLM은 생성 기능이 있지만, 의료 데이터 적응이 부족하여 전문적인 작업에서는 성능이 떨어집니다. 2024년 노벨 화학상은 AI 단백질 구조 예측 분야의 획기적인 발전에 수여되었는데, 이는 생명과학 분야에서 AI의 잠재력을 간접적으로 확인시켜 주었으며, 학계는 이해와 생성 기능을 모두 갖춘 의료용 LVLM을 구축하는 것이 현재 의료 AI 응용 분야의 병목 현상을 해결하는 열쇠가 되었음을 깨닫게 되었습니다.

이와 관련하여,저장대학교와 중국 전자과학기술대학교가 공동으로 HealthGPT 모델을 제안했습니다.혁신적인 이기종 지식 적응 프레임워크를 통해의료적 다중 모드 이해와 생성을 통합하는 최초의 대규모 시각 언어 모델을 성공적으로 구축했습니다.이는 의료 AI 개발에 새로운 길을 열었으며, 관련 결과는 ICML 2025에 선정되었습니다.

서류 주소:

연구팀은 의료 데이터 제한과 업무 충돌이라는 두 가지 주요 과제에 대응하여 3단계의 점진적 솔루션을 제안했습니다.

첫째, 이종 저랭크 적응(H-LoRA) 기술이 설계되었습니다.작업 게이팅 분리 메커니즘을 통해 이해와 생성 지식은 독립적인 "플러그인"에 저장되므로 기존 공동 최적화의 충돌 문제를 피할 수 있습니다.

둘째, 계층적 시각 인식(HVP) 프레임워크를 개발합니다.Vision Transformer의 계층적 특징 추출 기능을 활용하여 작업을 이해하기 위한 추상적인 의미적 특징을 제공하고 생성 작업을 위한 세부적인 시각적 특징을 유지함으로써 "주문형" 특징 조절을 달성합니다.

마지막으로, 3단계 학습 전략(TLS)이 구성됩니다.다중 모드 정렬에서 이기종 플러그인 융합, 그리고 시각적 지침 미세 조정에 이르기까지 이 모델은 점차적으로 특수화된 다중 모드 처리 기능을 갖추게 됩니다.

데이터 세트: VL-Health의 다중 모달 의료 지식 그래프

HealthGPT 교육을 지원하기 위해연구팀은 의료적 다중 모드 이해 및 생성을 위해 최초의 포괄적인 데이터 세트인 VL-Health를 구축했습니다.이 데이터 세트는 11가지 의료 방식(CT, MRI, X선, OCT 등)과 여러 질병 시나리오(폐 질환에서 뇌종양까지)를 포괄하여 765,000개의 이해 작업 샘플과 783,000개의 생성 작업 샘플을 통합했습니다.

데이터 세트 주소:

https://hyper.ai/cn/datasets/40990

이해 작업 측면에서, VL-Health는 VQA-RAD(방사선학 질문), SLAKE(의미적 주석 지식 강화), PathVQA(병리학 질문 답변)와 같은 전문 데이터 세트를 통합하고, LLaVA-Med 및 PubMedVision과 같은 대규모 멀티모달 데이터를 보완하여 모델이 기본 이미지 인식부터 복잡한 병리 추론까지 모든 역량을 학습하도록 보장합니다. 생성 작업은 주로 모달리티 변환, 초고해상도, 텍스트-이미지 생성, 그리고 이미지 재구성의 네 가지 주요 방향에 중점을 둡니다.

* 모달 변환:SynthRAD2023의 CT-MRI 쌍 데이터를 기반으로 모델의 모달리티 간 변환 기능을 훈련합니다.

* 초고해상도:IXI 데이터 세트의 고해상도 뇌 MRI를 사용하여 이미지 세부 재구성의 정확도를 향상시킵니다.

* 텍스트-이미지 생성:MIMIC-CXR을 기반으로 한 X선 영상 및 보고서, 텍스트 설명으로부터 영상 생성을 실현합니다.

* 이미지 재구성:모델의 이미지 인코딩-디코딩 기능을 훈련하기 위해 LLaVA-558k 데이터 세트를 조정했습니다.

데이터 처리 단계에서 팀은 슬라이스 추출, 이미지 등록, 데이터 향상을 포함한 의료 이미지의 표준화된 전처리를 수행했습니다.그리고 모든 샘플을 "명령-응답" 형식으로 통합합니다.모델 훈련 후 교육을 용이하게 합니다.

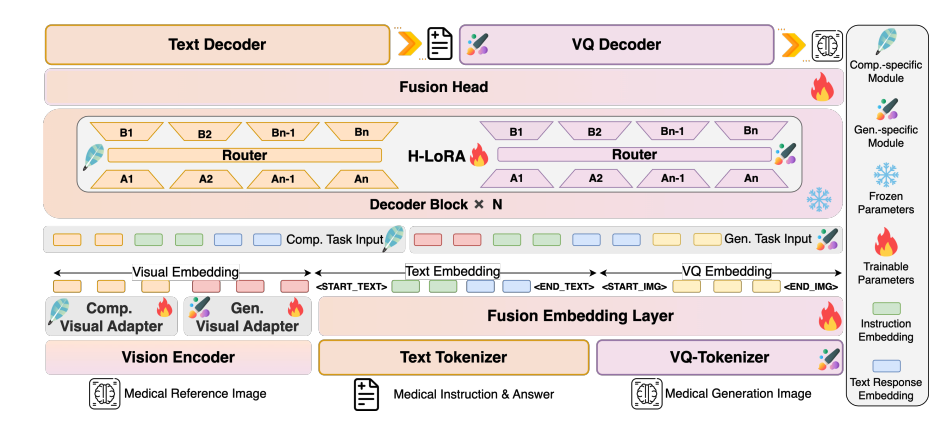

모델 아키텍처: 시각적 인식에서 자기 회귀 생성까지의 전체 체인 설계

HealthGPT는 멀티모달 정보의 효율적인 처리를 위해 "비주얼 인코더-LLM 코어-H-LoRA 플러그인"의 계층적 아키텍처를 채택합니다.

모델 아키텍처 다이어그램

시각적 인코딩 계층: 계층적 특징 추출

CLIP-L/14는 얕은(두 번째 레이어) 특징과 깊은(마지막 레이어에서 두 번째 레이어) 특징을 추출하는 시각적 인코더로 사용됩니다. 얕은 특징은 이미지 세부 정보를 보존하기 위해 2-레이어 MLP 어댑터를 통해 특정 세분된 특징으로 변환되고, 깊은 특징은 의미적 개념을 포착하기 위해 어댑터에 의해 추상 세분된 특징으로 처리됩니다. 이 이중 트랙 특징 추출 메커니즘은 후속 이해 및 생성 작업을 위한 적응형 시각적 표현을 제공합니다.

LLM Core: 일반 지식 기반

Phi-3-mini와 Phi-4를 기반으로 서로 다른 매개변수를 갖는 두 가지 모델, 즉 HealthGPT-M3(모델 매개변수 용량 3.8B)과 HealthGPT-L14(모델 매개변수 용량 14B)가 구축되었습니다. LLM 코어는 텍스트 이해 및 생성을 담당할 뿐만 아니라, 자기회귀 메커니즘을 통해 시각적 토큰 시퀀스를 균일하게 처리합니다. 즉, 이해 작업을 위한 텍스트 응답을 출력하고 생성 작업을 위한 VQGAN 인덱스 시퀀스를 출력한 후, VQGAN 디코더를 통해 이미지를 재구성합니다.

H-LoRA 플러그인: 임무별 어댑터

LLM의 각 Transformer 블록에 H-LoRA 플러그인을 삽입합니다. 여기에는 이해와 생성이라는 두 가지 유형의 하위 모듈이 포함됩니다. 각 하위 모듈에는 여러 LoRA 전문가가 포함되어 있으며, 작업 유형 및 입력 히든 상태의 동적 라우팅을 통해 지식의 선택적 활성화가 이루어집니다. 이 플러그인은 LLM의 고정된 가중치와 결합되어 "일반 지식 + 작업 전문성"의 하이브리드 추론 모드를 형성합니다.

실험 결론: HealthGPT는 의료 시각적 이해 및 생성 작업에서 상당히 앞서 있습니다.

사명 이해: 전문적 역량 선도

의료 시각 이해 과제에서 HealthGPT는 기존 모델을 크게 능가합니다. HealthGPT를 다른 의료 특화 모델 및 일반 모델(예: Med-Flamingo, LLA-VA-Med, HuatuoGPT-Vision, BLIP-2 등)과 비교한 결과, 다음과 같은 결과가 나타났습니다.HealthGPT는 의학적 시각적 이해 작업에서 우수한 성과를 보이며, 다른 의학적 특수 모델과 일반 모델보다 훨씬 우수한 성능을 보입니다.

VQA-RAD 데이터셋에서 HealthGPT-L14는 77.7%의 정확도를 달성하여 LLaVA-Med보다 29.1% 향상되었습니다. OmniMedVQA 벤치마크 테스트에서 평균 점수는 74.4%였으며, CT, MRI, OCT를 포함한 7개 하위 작업 중 6개에서 가장 우수한 결과를 달성했습니다. 특히 복잡한 MRI 모달리티 이해 정확도는 최대 99.7%로 매우 어려운 의료 영상에 대한 깊이 있는 이해를 보여주었습니다.

생성 과제: 모달리티 변환 및 초고해상도의 획기적인 발전

생성 작업 실험 결과, HealthGPT는 의료 영상 변환 및 향상에서 우수한 성능을 보였습니다. CT-MRI 변환 작업에서 HealthGPT-M3의 SSIM 지수는 79.38(Brain CT2MRI)로 기존 방식인 Pix2Pix보다 11.6% 높았으며, 골반과 같은 복잡한 영역에서의 변환 정확도 또한 우수했습니다. 초고해상도 작업에서는 SSIM이 78.19, PSNR이 32.76으로 SRGAN, DASR 및 기타 전용 모델을 능가하는 세부 복구 성능을 보였으며, 특히 뇌 구조의 미세 재구성에서 뛰어난 성능을 보였습니다.

주목할 점은 다음과 같습니다.HealthGPT는 단일 모델에서 여러 생성 작업을 처리할 수 있습니다.기존 방식에서는 각 하위 작업에 대해 독립적인 모델을 학습해야 하는데, 이는 통합 프레임워크의 효율성 이점을 잘 보여줍니다.

방법 검증: H-LoRA의 가치와 3단계 전략

절제 실험은 핵심 기술의 필요성을 확인했습니다. H-LoRA를 제거한 후, 이해 및 생성 작업의 평균 성과는 18.7%만큼 감소했습니다. 3단계 전략 대신 하이브리드 훈련을 채택했을 때, 작업 충돌로 인해 성과가 23.4%만큼 저하되었습니다.

H-LoRA와 MoELoRA를 비교한 결과, 4명의 전문가를 사용할 경우 H-LoRA의 학습 시간은 MoELoRA의 67%에 불과하지만, 성능은 5.2% 향상되어 계산 효율성과 작업 성능 모두에서 H-LoRA가 두 가지 장점을 가지고 있음을 보여줍니다. 또한, 계층적 시각 인식의 역할도 검증되었습니다.추상적 특징을 이해 과제에 사용하면 수렴 속도가 40%만큼 향상되고, 특정 특징을 생성 과제에 사용하면 이미지 충실도가 25%만큼 향상됩니다.

임상 적용 가능성: 연구에서 실무로의 다리

인간 평가 실험에서, 5명의 임상의가 1,000개의 개방형 질문에 대한 응답을 맹검 방식으로 평가했습니다.HealthGPT-L14 답변 중 "최상의 답변"으로 선정된 비율은 65.7%에 달했습니다.LLaVA-Med(34.08%) 및 HuatuoGPT-Vision(21.94%)을 훨씬 능가합니다.

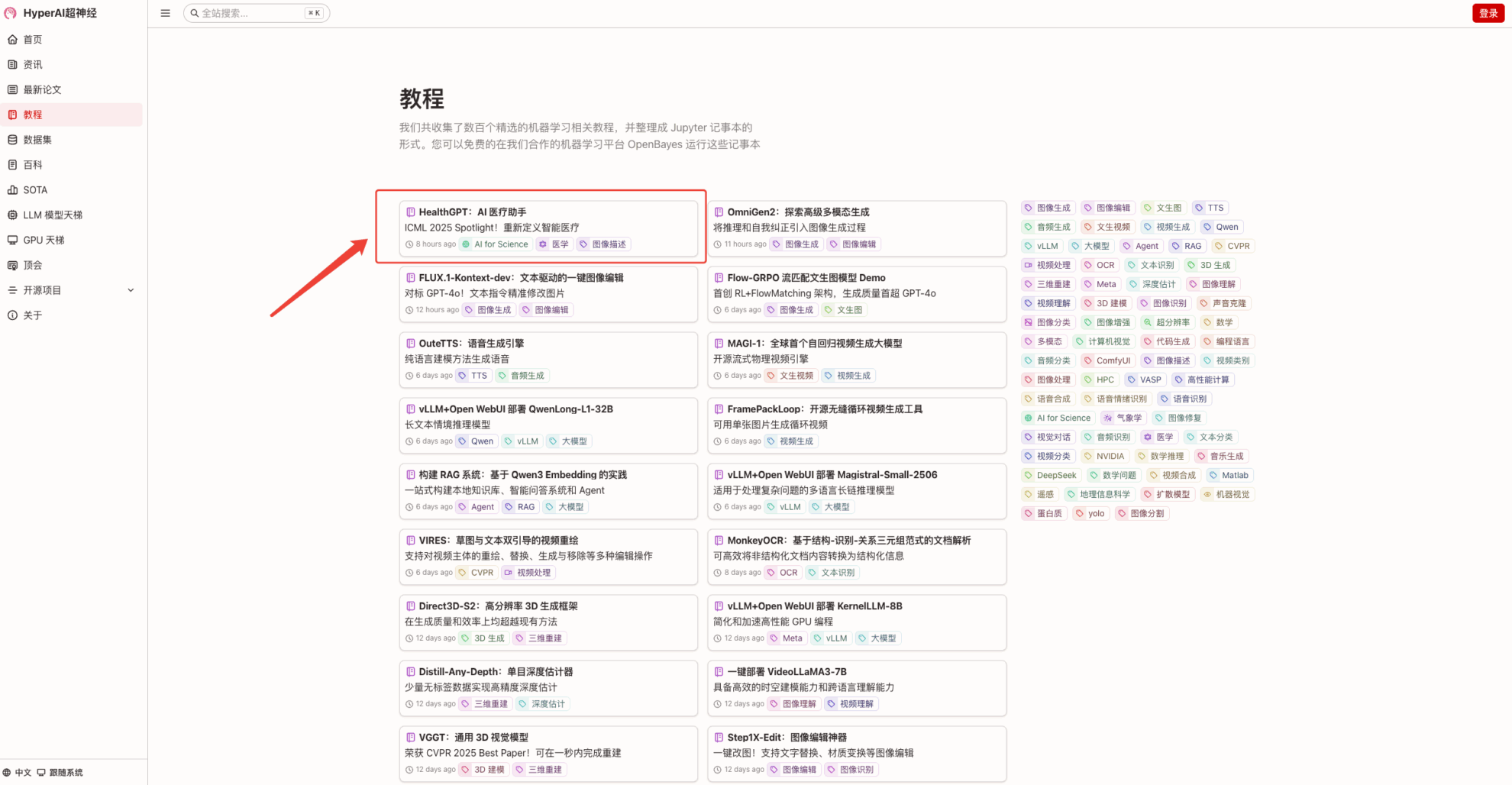

현재,하이퍼AI 하이퍼.ai"HealthGPT: AI 의료 조수" 튜토리얼이 이제 튜토리얼 섹션에서 제공됩니다.의료 이미지를 업로드하여 전문 의사와 같은 상담을 시작하세요. 지금 바로 경험해 보세요!

튜토리얼 링크:

데모 실행

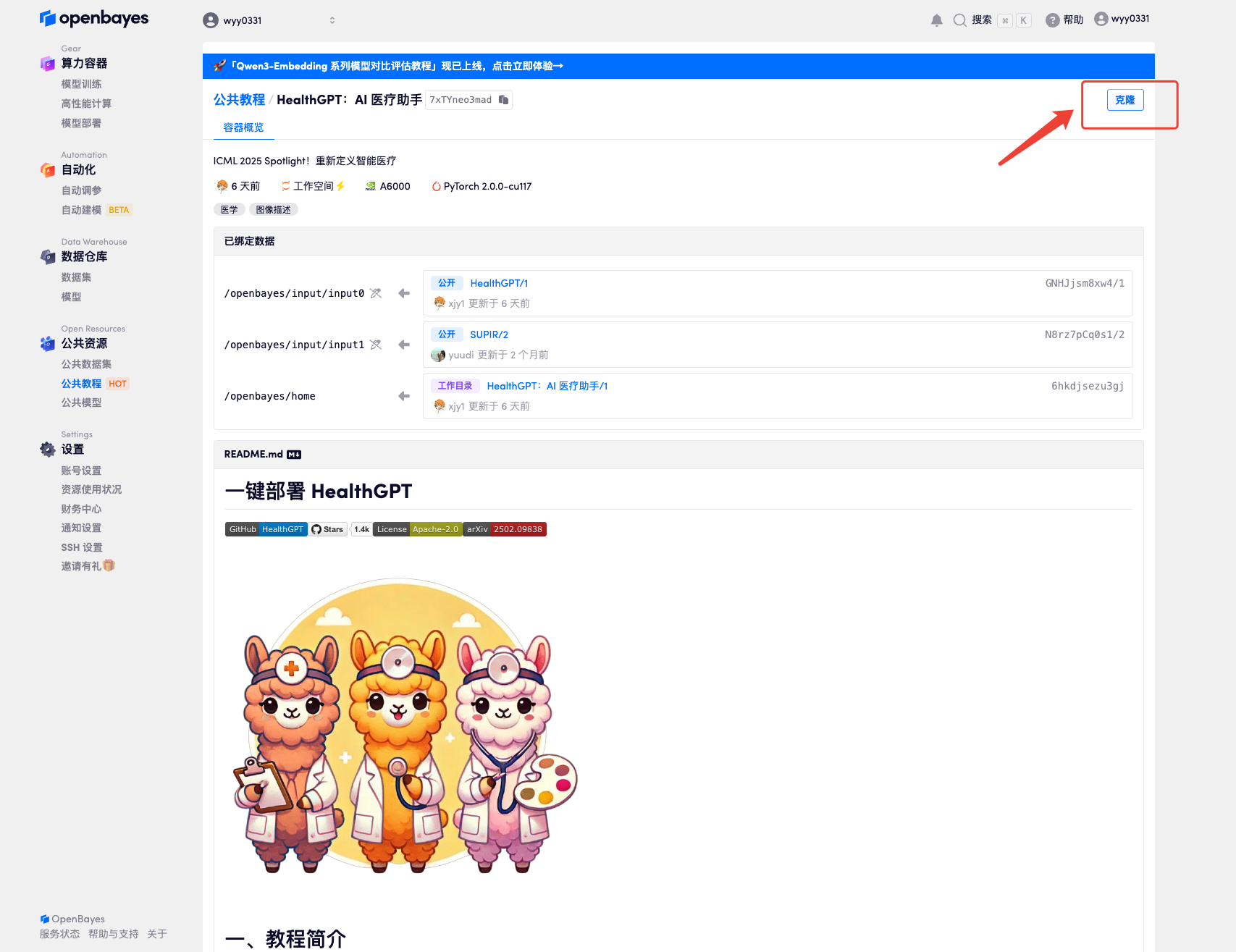

1. hyper.ai 홈페이지에 접속한 후, "튜토리얼" 페이지를 선택하고, "HealthGPT: AI 의료 조수"를 선택한 후, "이 튜토리얼을 온라인으로 실행"을 클릭하세요.

2. 페이지가 이동한 후 오른쪽 상단의 "복제"를 클릭하여 튜토리얼을 자신의 컨테이너로 복제합니다.

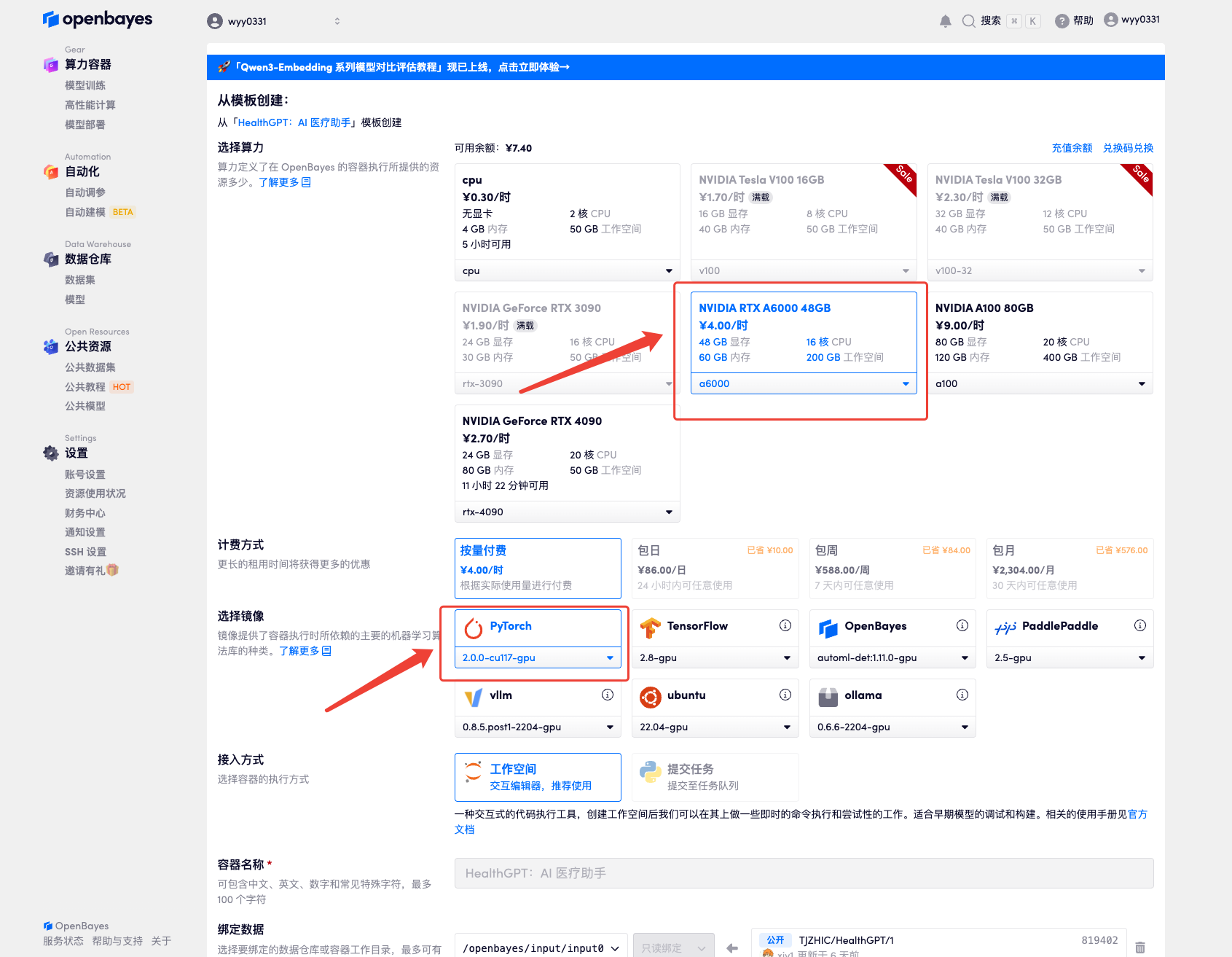

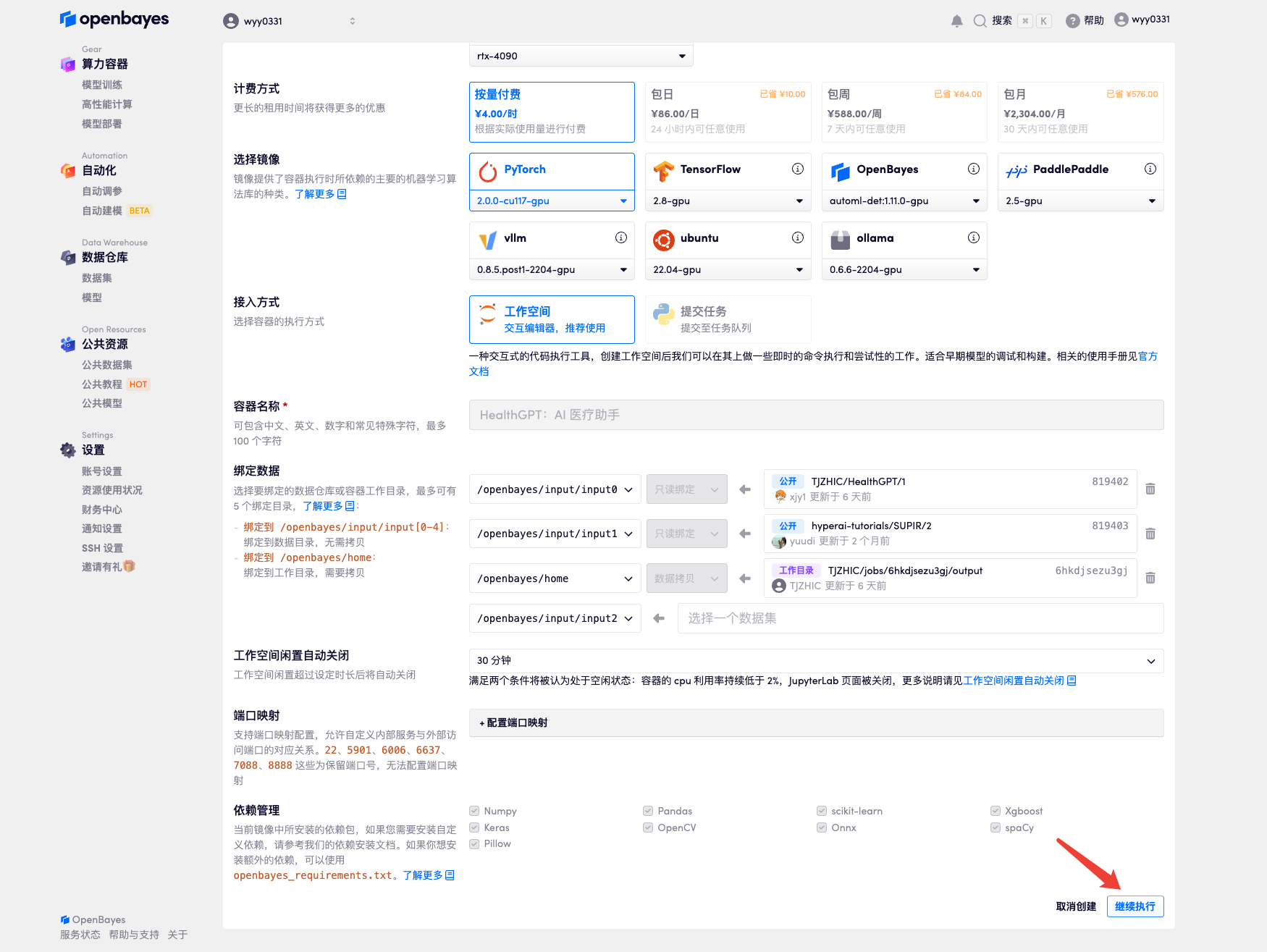

3. "NVIDIA RTX A6000" 및 "PyTorch" 이미지를 선택하세요. OpenBayes 플랫폼은 4가지 결제 방식을 제공합니다. 필요에 따라 "종량제" 또는 "일일/주간/월간" 결제 방식을 선택할 수 있습니다. "계속"을 클릭하세요. 신규 사용자는 아래 초대 링크를 통해 등록하시면 RTX 4090 4시간 + CPU 무료 사용 시간 5시간을 이용하실 수 있습니다!

HyperAI 독점 초대 링크(복사하여 브라우저에서 열기):

https://openbayes.com/console/signup?r=Ada0322_NR0n

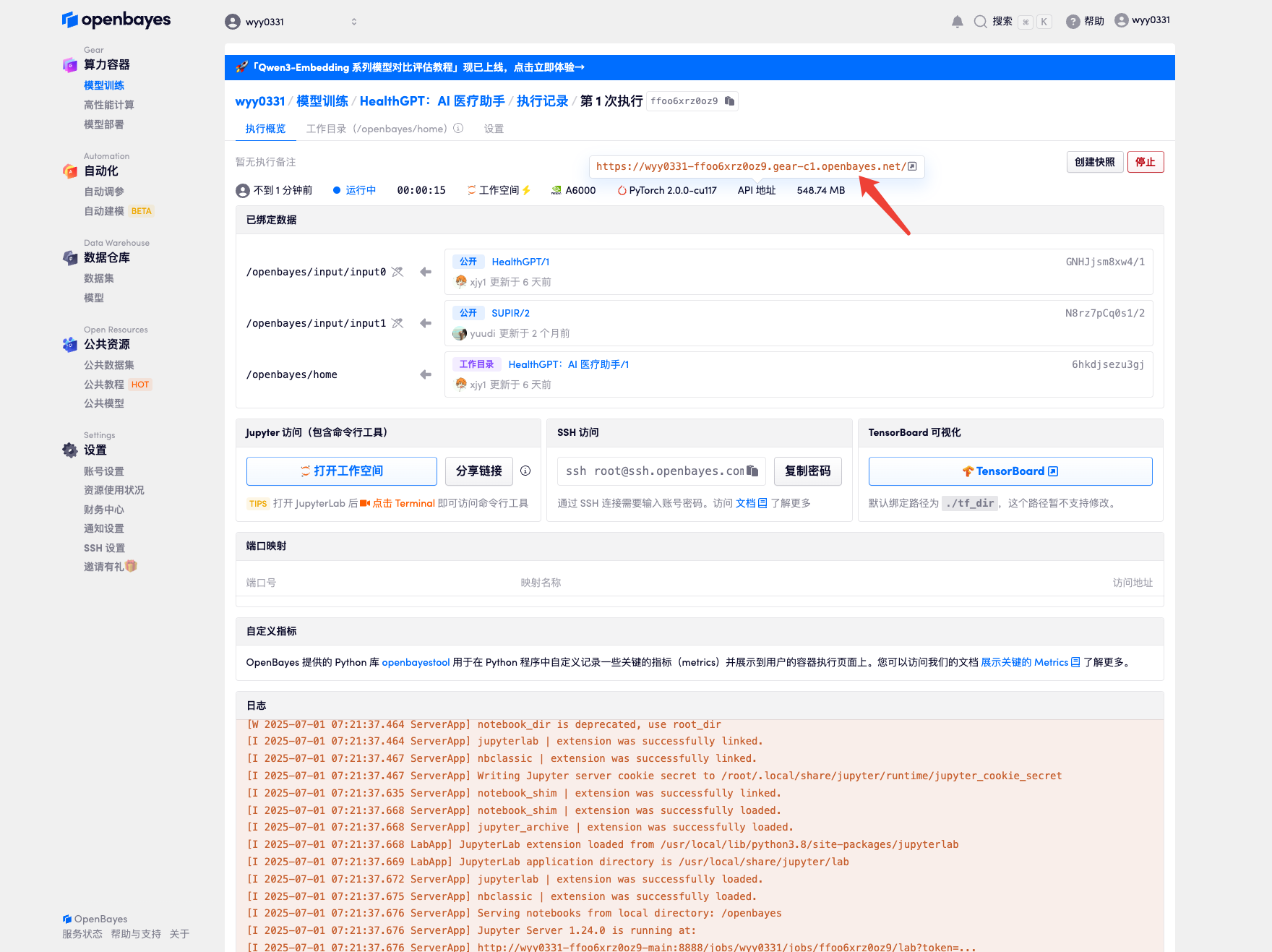

4. 리소스가 할당될 때까지 기다리세요. 첫 번째 클로닝 과정은 약 2분이 걸립니다. 상태가 "실행 중"으로 변경되면 "API 주소" 옆에 있는 점프 화살표를 클릭하여 데모 페이지로 이동합니다. 모델이 크기 때문에 WebUI 인터페이스를 표시하는 데 약 3분이 걸리며, 그렇지 않으면 "잘못된 게이트웨이"가 표시됩니다. API 주소 접근 기능을 이용하기 위해서는 이용자가 실명인증을 완료해야 합니다.

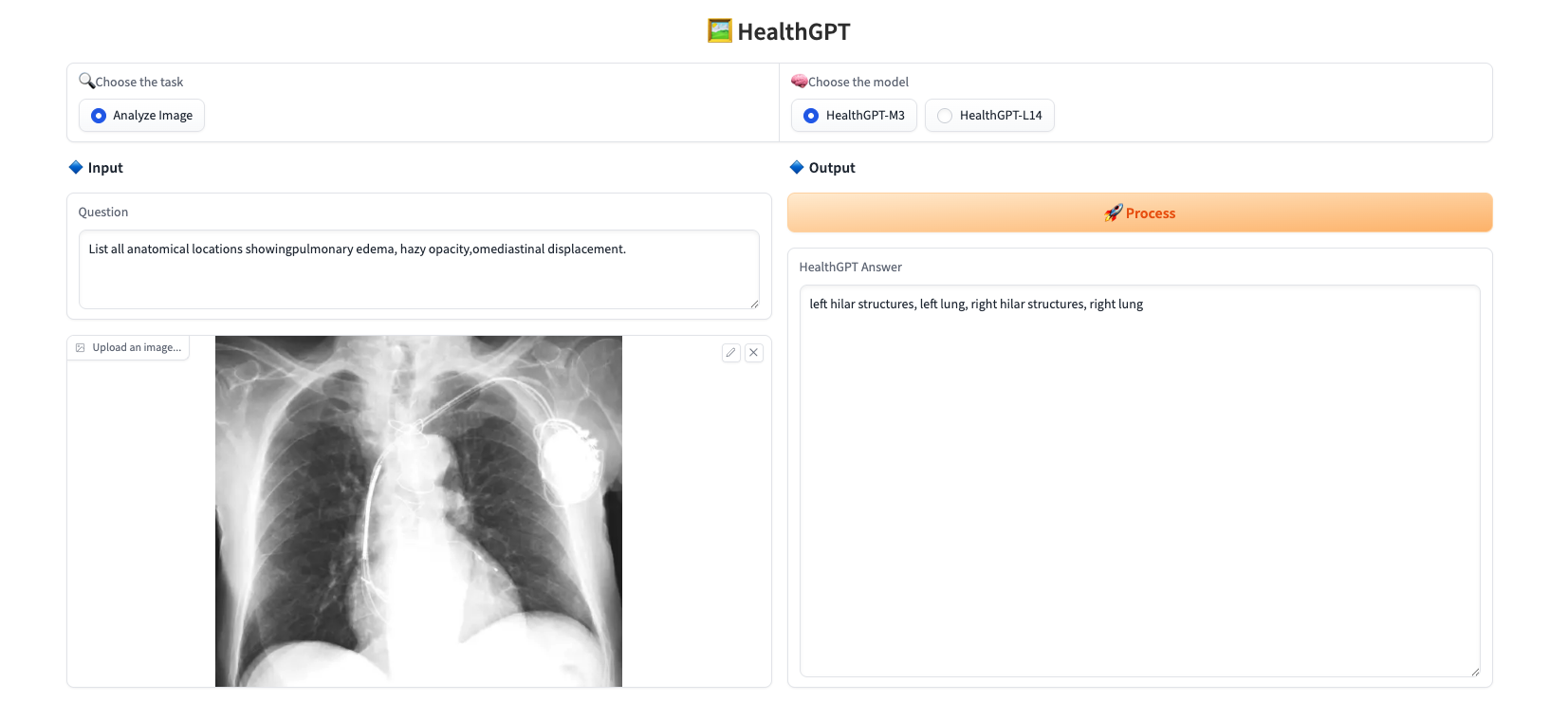

효과 시연

사진을 업로드하고, "질문"에 묻고 싶은 질문을 입력하고, "모델 선택"에서 모델을 선택한 후 "처리"를 클릭하면 실시간으로 답변할 수 있습니다. 이 프로젝트는 두 가지 모델을 제공합니다.

* HealthGPT-M3: 속도와 메모리 사용량 감소에 최적화된 소형 버전입니다.

* HealthGPT-L14: 더 높은 성능과 더 복잡한 작업을 위해 설계된 대형 버전입니다.

응답 예는 아래와 같습니다.

위는 HyperAI가 추천하는 튜토리얼입니다. 관심 있는 분들은 직접 체험해 보세요⬇️

튜토리얼 링크: