Command Palette

Search for a command to run...

최대 규모의 오픈 소스 로봇 데이터 세트! DeepMind는 21개 기관과 협력하여 60개의 데이터 세트를 통합하고 Open X-Embodiment를 출시하여 구체화된 지능 시대를 열었습니다.

최근, '태산에서 짐꾼 역할을 하는 로봇 개'를 담은 영상이 인터넷에 급속도로 퍼졌습니다.이 "로봇 개"는 무거운 짐을 쉽게 운반할 수 있을 뿐만 아니라, 태산의 가파른 산길을 "빠르게 걸어" 단 2시간 만에 산기슭에서 산 정상에 도달할 수 있습니다! 중국 외교부 부부장 화춘잉도 "로봇견은 장엄한 태산의 짐꾼 역할을 하며, 기술은 인류에게 이바지한다"고 칭찬했습니다.

타이산 문화관광그룹의 부동산 회사가 도입한 이 로봇견의 주요 임무는 쓰레기를 치우고 상품을 운반하는 것으로 알려져 있습니다. 과거에는 태산경관지구의 특수한 지형으로 인해 쓰레기 청소 작업을 인력으로 운반하는 것에만 의존할 수 있었고, 승객이 가장 많은 기간에는 쓰레기 청소 및 운반이 불가능한 경우가 많았습니다. 실험에 참여한 '로봇견'은 지형 적응력이 강하고 안정성과 균형 감각이 뛰어날 뿐만 아니라 장애물도 쉽게 넘을 수 있다. 최대 하중 용량은 120kg으로 쓰레기 제거 문제를 해결하고 작업 효율성을 향상시킬 수 있습니다.

구글 RT-2, 엔비디아 GR00T, 피규어 02 로봇, 테슬라 옵티머스, 샤오미 사이버원... 최근 몇 년 동안 로봇이 점점 더 많이 등장하면서 이러한 로봇을 운반체로 활용한 체현된 지능도 화제가 되고 있습니다.주변 환경을 감지하고, 학습하고, 상호작용할 수 있으며, 인간의 실제 삶에 직접 참여할 수 있는 이러한 로봇은 시장에서 큰 잠재력을 가지고 있습니다.

산업 분야의 검사, 용접, 취급, 분류 및 조립부터, 가정 분야의 가사 서비스와 노인 돌봄, 의료 분야의 수술 지원 및 일상 관리, 그리고 농업 분야의 심기, 비료 공급 및 수확에 이르기까지 구체화된 지능의 적용 시나리오는 광범위하고 다양합니다.

그러나 현재 로봇이 특정한 작업에서는 좋은 성과를 보이지만 여전히 다재다능함이 부족합니다. 즉, 각 작업, 각 로봇, 심지어 각 응용 프로그램 시나리오에 대해 모델을 훈련해야 한다는 뜻입니다. 자연어 처리 및 컴퓨터 비전과 같은 분야에서의 성공적인 경험을 바탕으로, 로봇이 광범위하고 다양한 데이터 세트로부터 학습하도록 하여 로봇이 더욱 일반적으로 행동하도록 훈련할 수 있을 것입니다. 하지만,기존 로봇 데이터 세트는 종종 단일 환경, 객체 집합 또는 특정 작업에 초점을 맞춥니다. 로봇 상호작용을 위한 방대하고 다양한 데이터 세트를 확보하는 것은 어렵습니다.

이에 대응하여 구글 딥마인드는 스탠포드 대학, 상하이 교통 대학, 엔비디아, 뉴욕 대학, 컬럼비아 대학, 도쿄 대학, 리켄(RIKEN), 카네기 멜론 대학, 취리히 연방 공과대학, 런던 임페리얼 칼리지 등 국제적으로 유명한 21개 기관과 협력하여 기존 로봇 데이터 세트 60개를 통합했습니다.개방형, 대규모, 표준화된 로봇 학습 데이터 세트인 Open X-Embodiment를 만들었습니다.

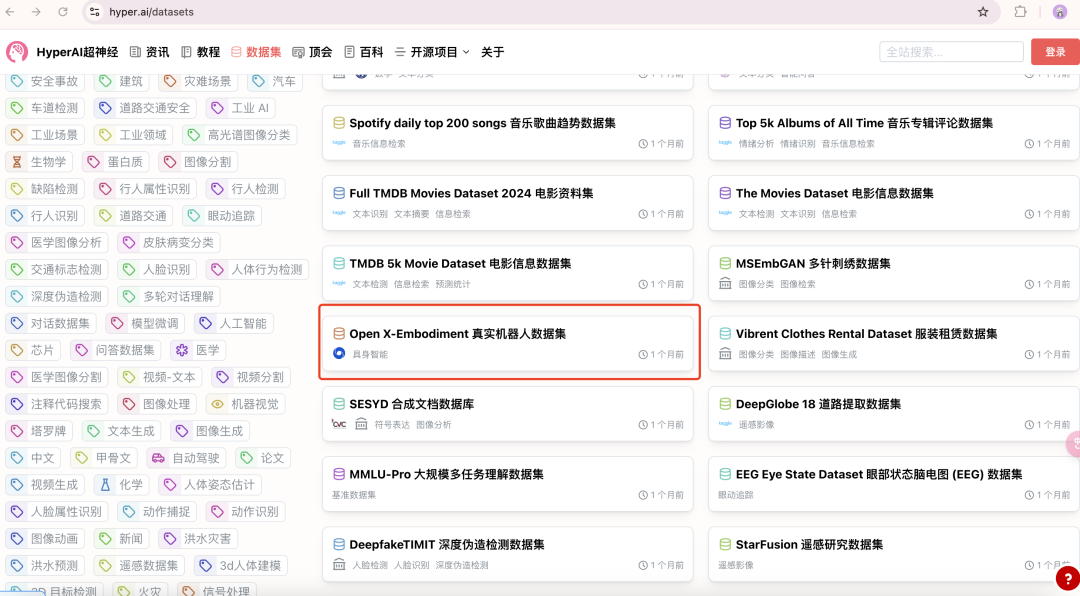

Open X-Embodiment 데이터 세트는 다양한 환경과 로봇 변화를 포괄하며 현재 연구 커뮤니티에 공개되어 있는 것으로 알려졌습니다. 연구진은 사용자가 쉽게 다운로드하여 사용할 수 있도록 다양한 출처의 데이터 세트를 통합된 데이터 형식으로 변환했습니다. 앞으로 그들은 로봇 학습 커뮤니티와 협력하여 이 데이터 세트의 성장을 공동으로 촉진할 계획입니다. HyperAI는 공식 웹사이트에 "Open X-Embodiment Real Robot Dataset"을 출시했습니다. 클릭 한 번으로 다운로드할 수 있습니다!

X-Embodiment 실제 로봇 데이터 세트 열기:

https://go.hyper.ai/JAeHn

현재까지 가장 큰 오픈소스 로봇 데이터 세트

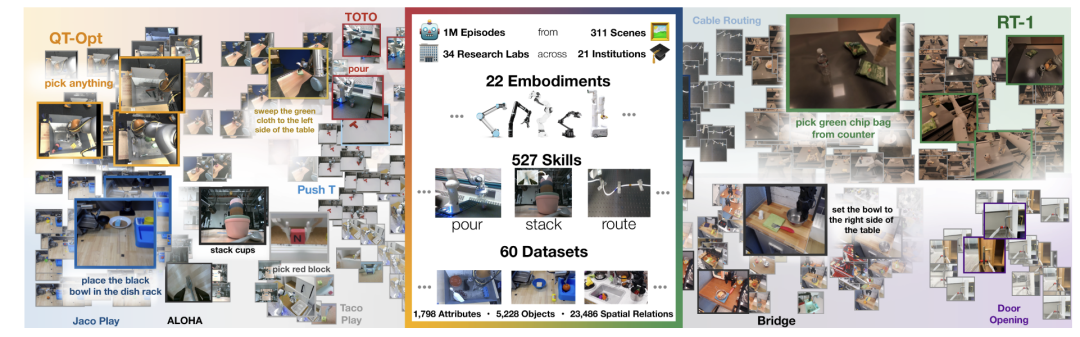

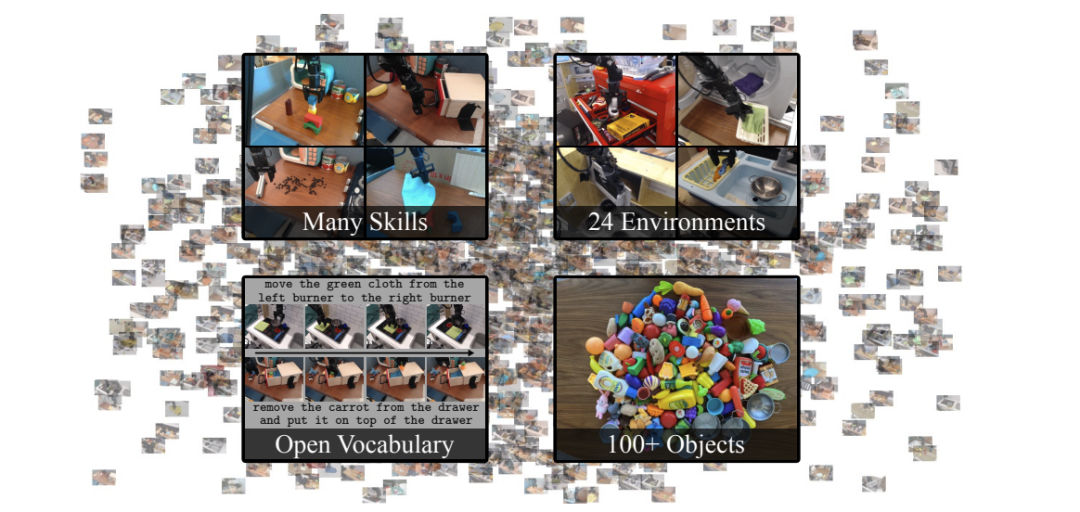

Open X-Embodiment는 현재까지 가장 큰 오픈소스 실제 로봇 데이터 세트라고 합니다.여기에는 단일 팔 로봇부터 이중 팔 로봇, 사족 로봇까지 22가지 유형의 로봇이 포함되며, 총 100만 개 이상의 로봇 궤적과 527개의 기술(160,266개 작업)이 수록되어 있습니다. 연구자들은 여러 로봇 유형의 데이터를 사용하여 훈련된 모델이 단일 로봇 유형의 데이터를 사용하여 훈련된 모델보다 더 나은 성능을 보인다는 것을 보여주었습니다.

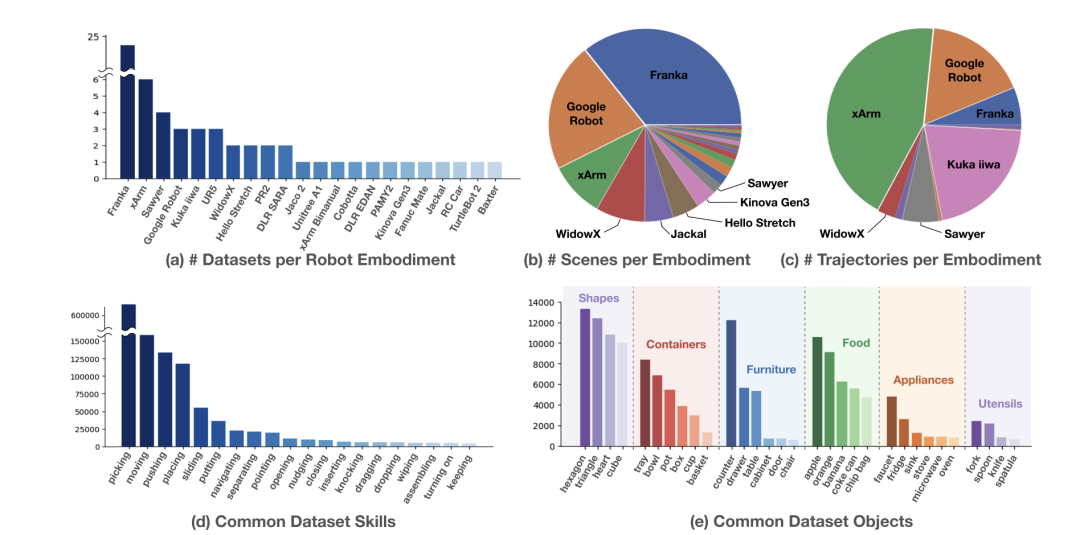

Open X-Embodiment 데이터 세트의 분포는 아래 그림과 같습니다.그림 (a)는 22개의 로봇 형태학 데이터 세트의 분포를 보여주는데, 그 중 Franka 로봇이 가장 일반적이다. 그림 (b)는 다양한 시나리오에서 로봇의 분포를 보여주는데, Franka 로봇이 가장 많고, 그 뒤를 Google 로봇이 따릅니다. 그림 (c)는 각 로봇 형태의 궤적 분포를 보여주는데, 그 중 xArm과 Google Robot이 가장 많은 궤적을 제공합니다. 그림 (d, e)는 각각 로봇이 보유한 기술과 사용하는 물건을 보여줍니다. 해당 기술에는 줍기, 옮기기, 밀기, 놓기 등이 포함되며, 해당 사물에는 가전제품, 음식, 식기 등 다양한 종류가 있습니다.

로봇 기술의 광범위한 적용을 촉진하기 위해 최고의 기관 자원을 하나로 모으다

Open X-Embodiment 데이터 세트는 60개의 독립적인 데이터 세트로 구성되어 있습니다.HyperAI는 여러분을 위해 특별히 일부 데이터 세트를 선택했습니다. 다음과 같이 간략하게 소개합니다.

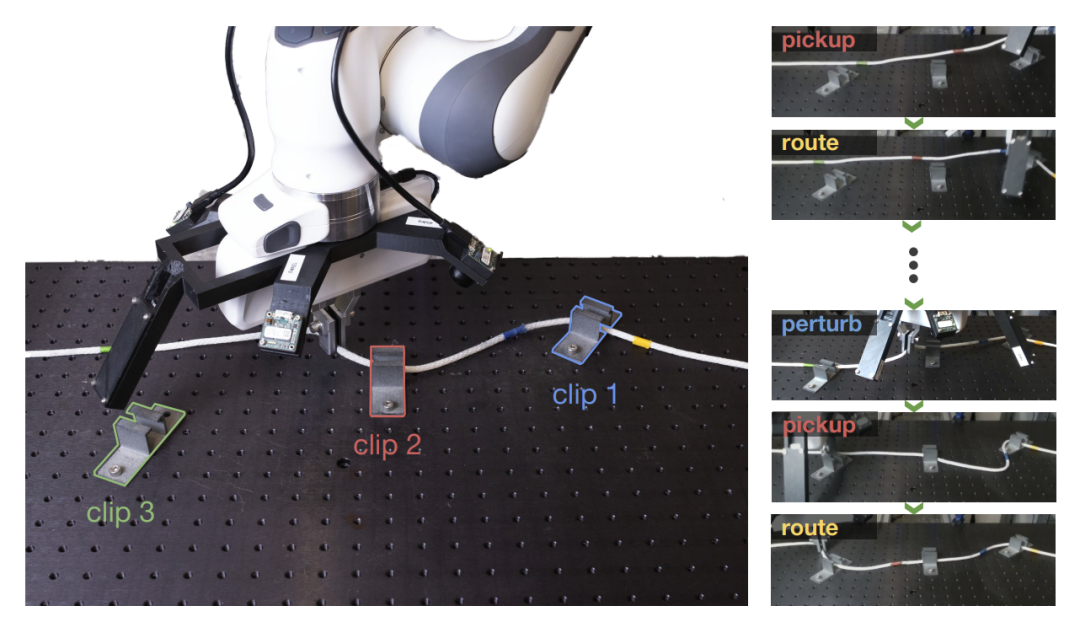

버클리 케이블 라우팅 다단계 로봇 케이블 라우팅 작업 데이터 세트

버클리 케이블 라우팅 데이터 세트는 캘리포니아 대학교 버클리와 Intrinsic Innovation LLC 연구팀에 의해 공개되었습니다. 총 27.92GB이고 다단계 로봇 조작 작업을 연구하는 데 사용됩니다.특히 케이블 라우팅 작업에 사용됩니다.이 작업은 로봇이 일련의 클램프에 케이블을 끼우고, 변형 가능한 물체를 다루고, 시각적 인식 루프를 닫고, 여러 단계로 구성된 확장된 동작을 처리해야 하는 복잡한 다단계 로봇 조작 시나리오를 나타냅니다.

직접 사용:https://go.hyper.ai/igi9x

CLVR Jaco Play 데이터 세트 원격 제어 로봇 클립 데이터 세트

CLVR Jaco Play 데이터세트는 원격 제어 로봇 분야에 초점을 맞춘 데이터세트입니다.총 14.87GB에 달하는 이 자료는 남부 캘리포니아 대학과 KAIST의 연구팀이 공개했으며, 원격 조종 로봇인 자코 2의 영상 1,085개와 해당 언어 주석을 담고 있습니다. 이 데이터 세트는 로봇 원격 제어, 자연어 처리, 인간-컴퓨터 상호 작용 등의 분야에서 일하는 과학자와 개발자에게 귀중한 리소스입니다.

직접 사용:https://go.hyper.ai/WPxG8

RT-1 Robot Action 실제 로봇 데이터 세트

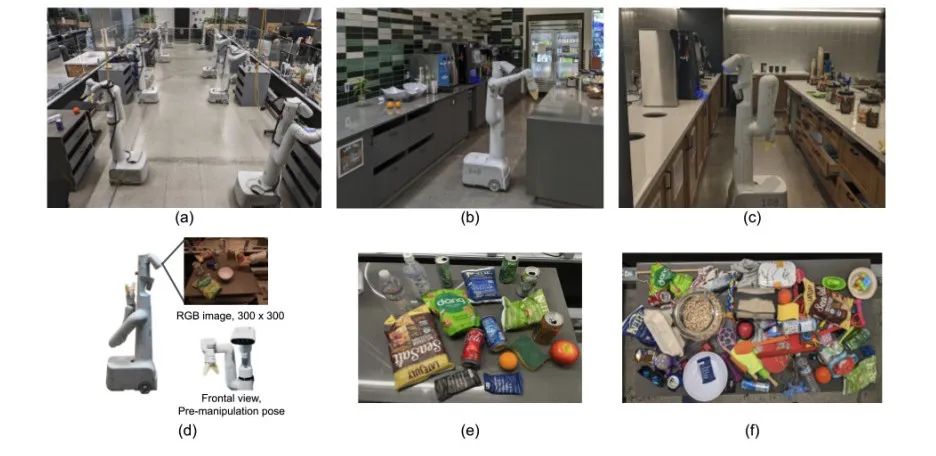

Google 연구진은 멀티태스크 모델인 Robotics Transformer(RT-1)를 제안했는데, 이는 새로운 작업, 환경 및 객체에 대한 제로샷 일반화에서 상당한 개선을 이루었으며, 뛰어난 확장성과 사전 학습된 모델 특성을 보여주었습니다.

RT-1 모델은 7자유도 팔, 2개 손가락 그리퍼, 모바일 베이스가 장착된 13개의 EDR 로봇 팔을 사용하여 대규모 실제 로봇 데이터 세트(RT-1 로봇 동작 데이터 세트)를 통해 학습되었습니다.17개월 동안 13만 개의 클립이 수집되었습니다.총 111.06GB이며, 각 조각에는 로봇 실행 지침에 대한 텍스트 설명이 주석으로 달려 있습니다. 데이터 세트에 포함된 고급 기술에는 물건을 집어 올리고 놓는 것, 서랍을 열고 닫는 것, 서랍에서 물건을 꺼내고 넣는 것, 길고 얇은 물건을 똑바로 세우는 것, 물건을 밀어 넘기는 것, 냅킨을 잡아당기는 것, 병을 여는 것 등이 포함됩니다.다양한 객체를 사용하는 700개 이상의 작업이 포함됩니다.

직접 사용:https://go.hyper.ai/V9gL0

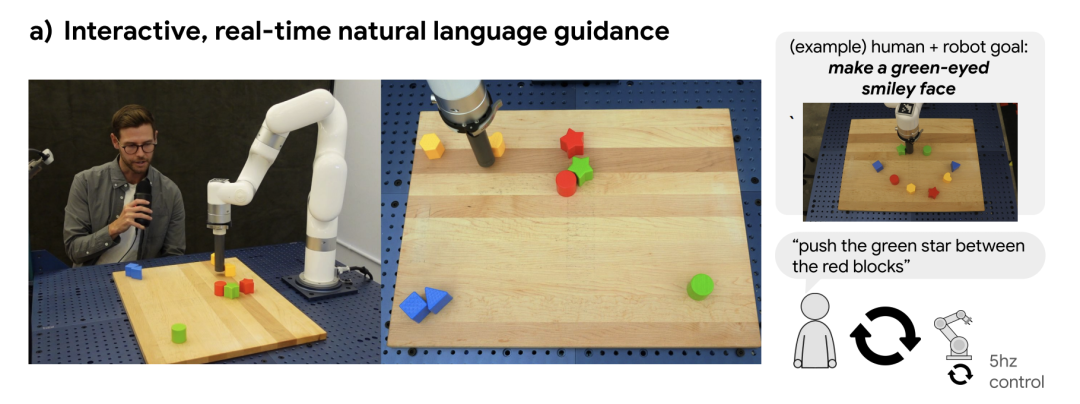

언어표 로봇 언어 라벨 궤적 데이터 세트

Google 로봇공학팀은 자연어 명령을 사용하여 실제 세계에서 실시간으로 상호작용할 수 있는 로봇을 만드는 프레임워크를 제안했습니다. 연구진은 언어적으로 주석이 달린 수십만 개의 궤적 데이터 세트를 사용하여 학습한 결과, 생성된 정책이 이전에 가능했던 것보다 10배 더 많은 명령을 실행할 수 있음을 발견했으며, 이는 현실 세계의 엔드투엔드 시청각 운동 기술을 설명합니다. 연구자들은 연구에 사용된 Language-Table 데이터 세트를 오픈 소스로 공개했습니다.이 데이터 세트에는 언어 레이블이 있는 약 60만 개의 궤적이 포함되어 있습니다.자연어로 상호작용할 수 있는 더욱 진보되고 유능한 로봇의 개발을 촉진하는 데 사용됩니다.

직접 사용:https://go.hyper.ai/9zvRk

BridgeData V2 대규모 로봇 학습 데이터 세트

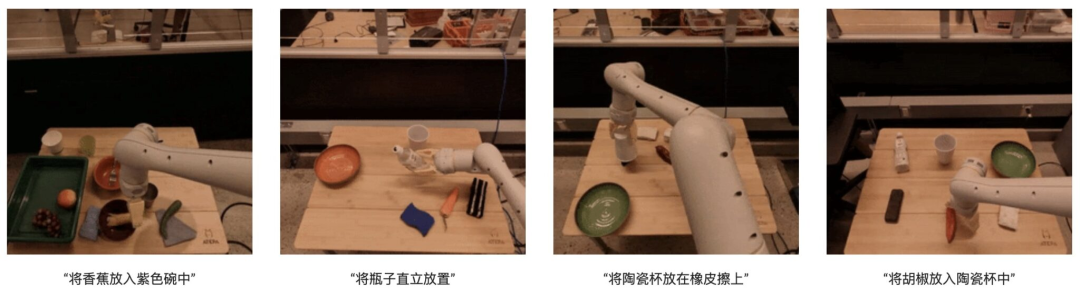

UC 버클리, 스탠퍼드 대학교, Google DeepMind, CMU는 확장 가능한 로봇 연구를 촉진하기 위해 BridgeData V2 데이터 세트를 공동으로 출시했습니다.24개의 다양한 환경에서 수집된 60,096개의 로봇 궤적을 담고 있습니다.그 중 24개의 환경은 4개의 카테고리로 구분됩니다. 대부분의 데이터는 싱크대, 스토브, 전자레인지 등 다양한 장난감 주방에서 나옵니다. 나머지 환경에는 다양한 책상, 장난감 싱크대, 장난감 세탁실 등이 있습니다. 데이터 세트에 포함된 작업으로는 집어서 놓기, 밀기 및 쓸기, 문과 서랍을 열고 닫기, 블록 쌓기, 세탁물 접기, 입자가 큰 매체 쓸기와 같은 더 복잡한 작업 등이 있으며, 일부 데이터 조각에는 이러한 기술이 결합되어 있습니다.

로봇의 일반화 능력을 개선하기 위해 연구진은 다양한 환경에서 서로 다른 물체, 카메라 위치, 작업 공간 위치를 사용하여 대량의 작업 데이터를 수집했습니다.각 경로에는 로봇의 작업에 해당하는 자연어 지침이 함께 제공됩니다.이 데이터에서 얻은 기술은 새로운 사물과 환경에 적용할 수 있으며, 심지어 기관 간에도 활용할 수 있어 연구자들에게 유용한 리소스가 됩니다.

직접 사용:https://go.hyper.ai/mGXA1

BC-Z 로봇 학습 데이터 세트

BC-Z 데이터 세트는 Google, Everyday Robots, 캘리포니아 대학교 버클리, 스탠포드 대학교가 공동으로 공개했습니다. 이 대규모 로봇 학습 데이터 세트는 로봇 모방 학습 분야의 개발을 촉진하는 것을 목표로 하며, 특히 제로 샘플 작업 일반화를 지원하는 것을 목표로 합니다. 즉, 로봇이 사전 경험 없이 모방 학습을 통해 새로운 작업 작업을 수행할 수 있도록 하는 것입니다.

이 데이터 세트에는 100가지의 다양한 작업을 포괄하는 25,877개 이상의 다양한 운영 작업 시나리오가 포함되어 있습니다.이러한 작업은 12대의 로봇과 7명의 작업자가 참여하는 전문가 원격 조작과 공유 자율 프로세스를 통해 수집되었으며, 누적 로봇 작동 시간은 125시간이었습니다. 이 데이터 세트는 작업에 대한 구두 설명이나 작업을 수행하는 사람의 비디오를 기반으로 특정 작업을 수행하도록 조정할 수 있는 7자유도 멀티태스크 정책을 훈련하는 데 사용할 수 있습니다.

직접 사용:https://go.hyper.ai/MdnFu

위의 내용은 이번 호에서 HyperAI가 추천하는 데이터 세트입니다. 고품질 데이터세트 리소스를 보셨다면 메시지를 남기시거나 기사를 제출해 알려주세요!

더 많은 고품질 데이터 세트를 다운로드하세요:https://go.hyper.ai/P5Mtc