Command Palette

Search for a command to run...

ACL2024 메인 컨퍼런스에 선정됨 | InstructProtein: 지식 지침을 사용하여 단백질 언어를 인간 언어에 맞추기

단백질은 세포 생존의 기초로 인체를 포함한 모든 생물체에 존재합니다. 그것은 조직과 기관을 구성하는 뼈대이자 주요 물질이며, 생명에 필수적인 화학 반응에서 핵심적인 역할을 합니다.

단백질 구조의 복잡성과 다양성으로 인해, 전통적인 실험 방법으로는 단백질 구조를 분석하는 데 시간이 많이 걸리고 노력이 많이 듭니다. 단백질 언어 모델(PLM)이 등장했습니다. 이러한 전문가 모델은 아미노산 서열을 입력으로 사용하여 단백질 기능을 예측하고 완전히 새로운 단백질을 설계할 수도 있습니다. 하지만,PLM은 아미노산 서열을 이해하는 데는 뛰어나지만, 인간의 언어를 이해할 수는 없습니다.

마찬가지로 자연어 처리에 효과적인 ChatGPT와 Claude-2와 같은 대규모 언어 모델(LLM)은 단백질 서열의 기능을 설명하거나 특정 속성을 가진 단백질을 생성해야 할 때는 성능이 부족합니다. 그 이유는,현재의 단백질-텍스트 데이터 세트에는 두 가지 주요 결함이 있습니다. 하나는 명확한 지시 신호가 부족하다는 것입니다. 다른 하나는 데이터 주석의 불균형입니다. 요약하자면, LLM에 대한 현재 연구에는 해결되지 않은 격차가 있는데, 바로 인간 언어와 단백질 언어 사이를 빠르게 전환할 수 없다는 점입니다.

이런 종류의 문제를 해결하려면,저장대학의 천화준과 장치앙이 이끄는 팀은 지식 지침을 사용하여 단백질 언어를 인간 언어에 맞추는 InstructProtein 모델을 제안했습니다.우리는 단백질 언어와 인간 언어 사이의 양방향 생성 능력을 탐구하여 두 언어 사이의 격차를 효과적으로 메우고 생물학적 시퀀스를 대규모 언어 모델로 통합하는 능력을 보여주었습니다.

이 연구의 제목은 "InstructProtein: 지식 교육을 통해 인간과 단백질 언어의 정렬"입니다.ACL 2024 본회의에서 승인됨.

연구 하이라이트:

* InstructProtein은 지식 지시를 통해 인간 언어와 단백질 언어를 일치시키는 연구입니다.

* 단백질 언어와 인간 언어 간의 양방향 생성 기능을 탐색하여 두 언어 간의 격차를 효과적으로 메웠습니다.

* 다수의 양방향 단백질 텍스트 생성 작업에 대한 실험은 InstructProtein이 기존 최첨단 LLM보다 성능이 우수함을 보여줍니다.

서류 주소:

https://arxiv.org/abs/2310.03269

오픈소스 프로젝트인 "awesome-ai4s"는 100개가 넘는 AI4S 논문 해석을 모아 방대한 데이터 세트와 도구를 제공합니다.

https://github.com/hyperai/awesome-ai4s

데이터 세트: 포괄적인 과학 데이터 세트

모델 사전 학습 단계의 코퍼스에는 UniRef100의 단백질 시퀀스와 PubMed 초록의 문장이 포함되어 있습니다.연구진은 이 데이터를 바탕으로 280만 개의 데이터 포인트가 포함된 지침 데이터 세트를 생성했습니다.

모델의 미세 조정 단계에서는 UniProt/Swiss-Prot에서 제공한 주석을 사용하여 단백질 지식 그래프를 구성했습니다. 여기에는 단백질 슈퍼패밀리, 패밀리, 도메인, 보존 부위, 활성 부위, 결합 부위, 위치, 기능 및 관련된 생물학적 과정이 포함되었습니다. 지식 인과 모델링을 위한 데이터는 InterPro 및 Gene Ontology 데이터베이스에서 가져왔습니다.

모델 평가 단계에서 연구진은 단백질 기능 주석에 대한 모델의 능력을 평가하기 위해 Gene Ontology(GO) 데이터 세트를 선택한 다음 Hu et al. 금속 이온 결합(MIB) 예측에서 모델의 능력을 평가하기 위한 데이터 세트입니다.

모델 아키텍처: 단백질 지식 교육 데이터 세트를 구축하여 사전 학습된 모델을 미세 조정

LLM이 단백질 언어를 이해하는 능력을 갖추도록 하기 위해 InstructProtein은 2단계 학습 방식을 채택합니다. 먼저 단백질과 자연어 코퍼스에 대한 사전 학습을 실시하고, 다음으로 확립된 단백질 지식 교육 데이터 세트로 미세 조정을 실시합니다.

사전 훈련 단계

다국어 사전 훈련 단계에서 이 연구는 대규모 생물학 관련 텍스트 데이터베이스를 사용하여 모델의 언어 이해력과 생물학 분야에 대한 지식 배경을 강화했습니다. 다국어 능력은 자연어(예: 영어 초록)와 생물학적 서열 언어(예: 단백질 서열)를 모두 처리할 수 있는 능력을 말합니다.

모델 미세 조정 단계

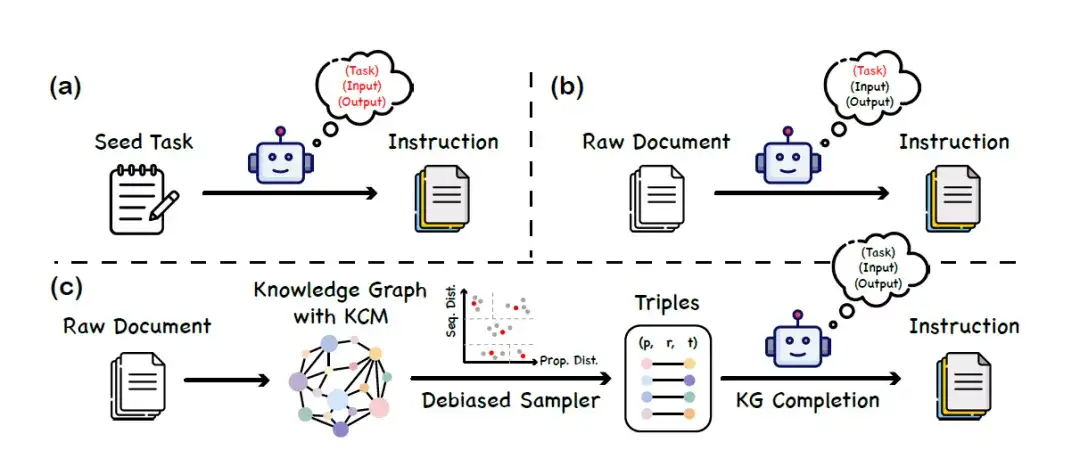

모델 미세 조정 단계 동안본 연구에서는 "지식 교육"이라는 데이터셋 구축 방법을 제안한다.지식 그래프(KG)와 대규모 언어 모델을 함께 사용하여 균형 잡히고 다양한 지침 데이터 세트를 구축합니다. 이 방법은 대규모 언어 모델이 단백질 언어를 이해하는 능력에 의존하지 않으므로 모델 편향이나 환각으로 인해 잘못된 정보가 유입되는 것을 방지합니다. 구체적인 건설 과정은 다음 그림에서 볼 수 있듯이 3가지 주요 단계로 나뉩니다.

에이. 시드 작업 세트가 주어지면 LLM이 새로운 지침 데이터를 생성하도록 합니다.

비. LLM을 사용하여 원시 문서의 내용에 해당하는 지침 데이터를 생성합니다.

기음. 지식 그래프(KG) 기반 명령어 생성 프레임워크

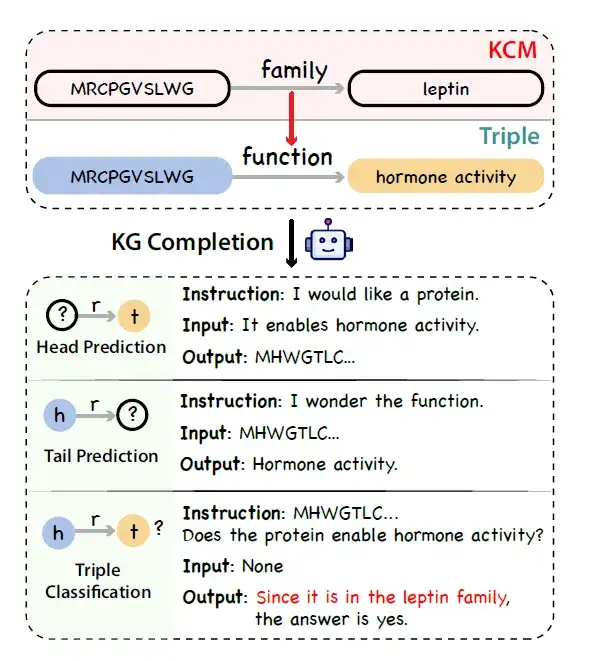

* 지식 그래프 구성:연구진은 UniProtKB를 데이터 소스로 사용하여 단백질 지식 그래프를 구축했습니다. 연구자들은 사슬적 사고의 개념을 빌려, 단백질 주석에도 논리적 사슬이 존재한다는 것을 깨달았습니다. 예를 들어, 단백질이 참여할 수 있는 생물학적 과정은 분자 기능 및 세포 내 위치와 밀접한 관련이 있으며, 분자 기능 자체는 단백질 도메인 구조의 영향을 받습니다.

이 단백질 지식의 인과 사슬을 표현하려면,연구자들은 지식 인과 모델링(KCM)이라는 새로운 개념을 도입했습니다.구체적으로, 지식 인과 모델은 방향성 비순환 그래프로 구성된 여러 개의 상호 연결된 삼중항으로 구성되며, 여기서 모서리의 방향은 인과 관계를 나타냅니다. 그래프는 단백질 서열의 특징(구조 등)을 다루는 미시적 수준에서 생물학적 기능을 다루는 거시적 수준까지 삼중항을 구성합니다. 아래 그림은 지식 그래프와 결합된 대규모 언어 모델을 사용하여 KCM이 포함된 트리플이 주어졌을 때 사실적, 논리적이며 다양한 지침을 생성하는 프로세스를 보여줍니다. 이를 통해 작업을 완료합니다.

* 지식 그래프 트리플 샘플링:연구자들은 지식 그래프의 주석 불균형 문제를 고려하여 균일 샘플링을 대체하는 대안 전략으로 편향된 샘플링 전략을 제안했습니다. 구체적으로, 먼저 단백질을 서열과 속성 유사성에 따라 그룹화한 다음, 각 그룹에서 3중체를 균일하게 추출합니다.

* 지시 데이터 생성:연구진은 지식 그래프 완성 작업을 시뮬레이션하고 일반적인 LLM(예: ChatGPT)을 사용하여 KCM이 적용된 지식 그래프 트리플을 명령어 데이터로 변환했습니다.

이 접근 방식을 사용하면 단백질 언어를 이해하기 위해 미리 정의된 모델에 의존하지 않고도 단백질 기능 및 위치에 대한 지침의 풍부하고 균형 잡힌 데이터 세트를 효율적으로 생성할 수 있습니다.이후의 단백질 기능 연구와 응용을 위해 더욱 신뢰할 수 있는 데이터 지원을 제공합니다.

사전 학습과 미세 조정을 결합하여 InstructProtein이라는 결과 모델을 만들면 단백질 서열과 관련된 다양한 예측 및 주석 작업을 더 잘 수행할 수 있습니다.예를 들어, 단백질의 기능을 정확하게 예측하거나 이를 특정 세포 내 위치로 국한시키는 것은 단백질 공학, 신약 개발, 그리고 보다 광범위한 생물의학 연구에 중요한 의미를 갖습니다.

연구 결과: InstructProtein은 기존 최첨단 LLM보다 성능이 뛰어납니다.

이 연구에서는 InstructProtein의 단백질 서열 이해 및 설계 역량을 종합적으로 평가했습니다.

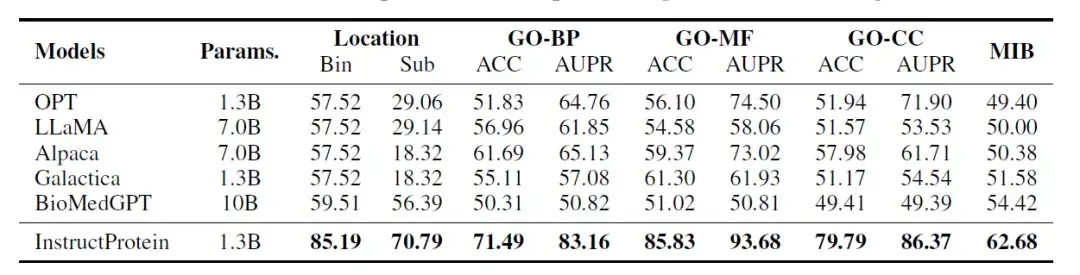

단백질 서열 이해

연구자들은 다음의 세 가지 분류 작업에 대한 InstructProtein 모델의 성능을 평가했습니다.단백질 위치 예측, 단백질 기능 예측, 단백질 금속 이온 결합 능력 예측. 이러한 과제는 자연어로 된 독해 문제와 유사하게 설계되었습니다. 각 데이터에는 단백질 서열과 질문이 포함되어 있으며, 모델은 예/아니요 유형의 질문에 답해야 합니다. 모든 평가는 제로샷 설정에서 수행됩니다.

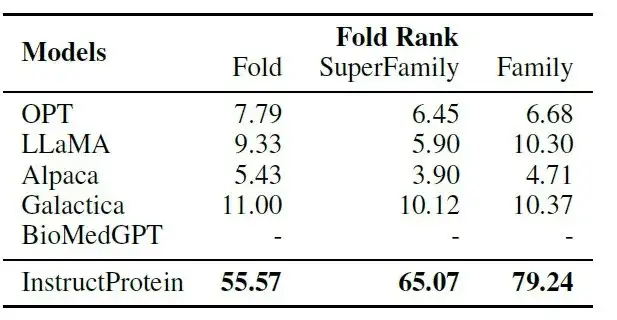

평가 결과는 다음 표에 나와 있습니다.InstructProtein은 모든 기준 모델과 비교했을 때 모든 작업에서 최첨단 성능을 달성했습니다.

또한, 두 가지 주요 연구 결과는 주목할 만합니다. 첫째, InstructProtein은 자연어 학습 코퍼스(예: OPT, LLaMA, Alpaca)에서 파생된 LLM보다 훨씬 우수한 성과를 보입니다. 이는 다음을 보여줍니다단백질과 자연어를 모두 포함하는 코퍼스로 훈련하는 것은 LLM에게 유익하며 단백질 언어 이해 능력을 향상시킵니다.

두 번째로, Galactica와 BioMedGPT는 둘 다 자연어 및 단백질 정렬을 위한 코퍼스로 UniProtKB를 활용하지만, InstructProtein이 지속적으로 두 회사보다 우수한 성과를 보입니다. 결과는 다음과 같습니다.이 연구의 고품질 지침 데이터는 제로샷 설정에서 성과를 향상시킬 수 있습니다.

또한, 단백질 세포 내 위치(bin) 작업에서 LLM(OPT, LLaMA, Alpaca, Galactica)이 심하게 편향되어 모든 단백질이 같은 그룹으로 분류되어 정확도가 57.52%가 되었습니다.

단백질 서열 설계

단백질 설계 측면에서 연구자들은 "지침 단백질 페어링" 과제를 설계했습니다. 단백질과 그에 대한 설명이 주어지면, 모델은 해당 설명과 9개의 대응하지 않는 설명 중에서 가장 적절한 단백질을 선택해야 합니다.

다음 표에서 볼 수 있듯이:InstructProtein은 명령어-단백질 페어링 작업에서 모든 기준 모델보다 상당히 우수한 성능을 보였습니다.

그 중 BioMedGPT는 단백질을 텍스트로 변환하는 데 중점을 두고 있으며 단백질 설계 기능이 부족합니다. 갈락티카는 단백질에 대한 지침을 정렬하는 제로샷 설정에서 성능이 제한적입니다. 그 이유는 내러티브 단백질 코퍼스를 기반으로 훈련되었기 때문입니다.이러한 결과는 단백질 생산에 있어서 InstructProtein 모델의 지시 따르기 능력이 우수하다는 것을 확인시켜 줍니다.

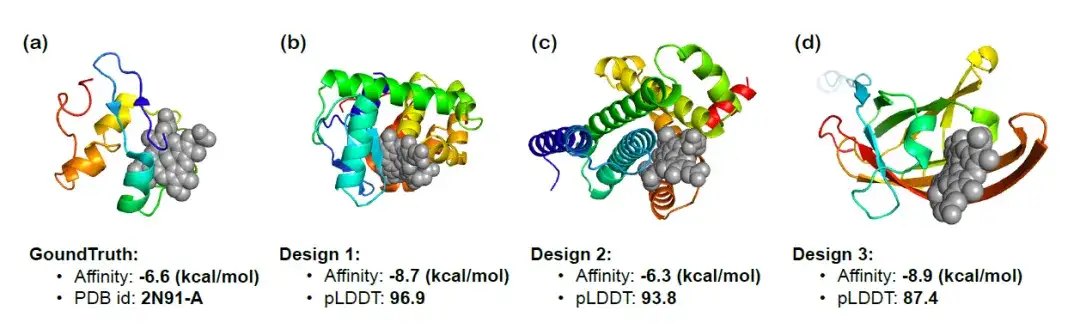

연구진은 InstructProtein이 기능적으로 관련된 지침을 따라 단백질을 설계하는 능력을 더욱 검증하기 위해 InstructProtein을 사용하여 특정 화합물에 결합할 수 있는 헴 결합 단백질을 설계하고 생성된 세 가지 단백질의 3D 구조를 시각화했습니다. 아래 그림은 도킹 결과, 결합 친화도 예측(낮을수록 좋음), pLDDT 점수(절대값이 높을수록 좋음)를 보여줍니다. 생성된 단백질은 상당한 결합 친화력을 나타냈음이 관찰되었습니다.헴 결합 단백질 설계에 있어서 InstructProtein의 효과가 확인되었습니다.

단백질 모델 탐색의 길은 이제 막 시작되었습니다

최근 몇 년 동안 대규모 언어 모델은 자연어 처리 분야에 혁명적인 변화를 가져왔습니다. 이러한 모델은 언어 번역, 정보 수집, 코드 생성 등 일상생활의 여러 측면에서 널리 사용됩니다. 그러나 이러한 언어 모델은 자연어 처리와 언어 코딩에는 우수한 성능을 보이지만 생물학적 순서(예: 단백질 순서)에는 대처할 수 없습니다.이러한 맥락에서 단백질 대언어 모델의 등장은 시기적절하다고 할 수 있다.

단백질 빅 언어 모델은 아미노산 서열, 단백질 접힘 패턴 및 단백질과 관련된 기타 생물학적 데이터를 포함한 단백질 관련 데이터에 맞게 특별히 훈련됩니다. 따라서 단백질의 구조, 기능, 상호작용을 정확하게 예측할 수 있는 능력을 갖추고 있습니다. 단백질 언어 모델은 생물학에서 AI 기술을 최첨단으로 적용한 사례입니다. 단백질 서열의 패턴과 구조를 학습함으로써 단백질의 기능과 형태를 예측할 수 있는데, 이는 신약 개발, 질병 치료 및 기초 생물학 연구에 매우 중요합니다.

2023년 4월, Science에 발표된 연구에 따르면 메타 AI 팀의 연구진은 진화 정보를 도출할 수 있는 대규모 언어 모델을 사용하여 시퀀스-구조 예측기인 ESMFold를 개발했습니다. 단일 서열 단백질의 예측 정확도는 AlphaFold2를 능가했고, 상동 서열을 가진 단백질의 예측 정확도는 AlphaFold2와 비슷했으며, 속도는 수십 배나 빨라졌습니다. 이 모델은 6억 개 이상의 메타게놈 단백질을 예측하여 천연 단백질의 폭과 다양성을 보여주었습니다.

2023년 7월, 바이두 바이오와 청화대학교는 매개변수 수가 최대 1000억(100B)인 xTrimo 단백질 일반 언어 모델(xTrimoPGLM)이라는 모델을 공동으로 제안했습니다. xTrimoPGLM은 다양한 단백질 이해 과제에서 이해 과제 측면에서 다른 고급 기준 모델보다 상당히 우수한 성과를 보였습니다. 생성 작업 측면에서 xTrimoPGLM은 자연 단백질 구조와 유사한 새로운 단백질 서열을 생성할 수 있습니다.

논문 링크:

https://www.biorxiv.org/content/10.1101/2023.07.05.547496v3

2024년 7월청화대학교 지능산업연구소의 연구원인 저우하오는 베이징대학교, 난징대학교, 슈이무 분자팀과 협력하여 다중 스케일 단백질 언어 모델인 ESM-AA(ESM All Atom)를 제안했습니다.잔류물 확장 및 다중 스케일 위치 인코딩과 같은 훈련 메커니즘을 설계함으로써 원자 스케일 정보를 처리하는 능력이 확장되었습니다. 타겟 리간드 결합과 같은 작업에서 ESM-AA의 성능은 크게 향상되어 ESM-2와 같은 현재의 SOTA 단백질 언어 모델을 능가하고 Uni-Mol과 같은 현재의 SOTA 분자 표현 학습 모델보다 뛰어납니다. 관련 연구는 "ESM All-Atom: Multi-scale Protein Language Model for Unified Molecular Modeling"이라는 제목으로 최고의 머신 러닝 컨퍼런스 ICML에 게재되었습니다.

서류 주소:

https://icml.cc/virtual/2024/poster/35119

단백질 대언어 모델 연구에서 상당한 진전이 이루어졌지만, 우리는 여전히 단백질 서열 공간의 복잡성을 완전히 이해하는 초기 단계에 있다는 점을 강조할 가치가 있습니다. 예를 들어, 위에서 언급한 InstructProtein 모델은 수치적 작업을 처리하는 데 있어 과제에 직면하는데, 이는 3차원 구조 확립, 안정성 평가, 기능 평가 등 정량적 분석이 필요한 단백질 모델링 분야에서 특히 중요합니다. 미래,관련 연구는 양적 설명을 포함한 더 광범위한 지침을 포함하도록 확장될 것입니다.모델의 양적 출력을 제공하는 능력을 향상시켜 단백질 언어와 인간 언어의 통합을 발전시키고 다양한 응용 시나리오에서 실용성을 확장합니다.

참고문헌:

1.https://arxiv.org/abs/2310.03269

2.https://mp.weixin.qq.com/s/UPsf9y9dcq_brLDYhIvz-w

3.https://hic.zju.edu.cn/ibct/2024/0228/c58187a2881806/page.htm