Command Palette

Search for a command to run...

CVPR에서 최우수 학생 논문을 수상했습니다! 1,000만 개의 이미지와 45만 개 이상의 종을 포함하는 대규모 데이터 세트인 멀티모달 모델 BioCLIP은 제로샷 학습을 가능하게 합니다.

저널 출판을 중시하는 전통적인 학술 분야와 달리, 컴퓨터 세계, 특히 머신 러닝, 컴퓨터 비전, 인공지능 등의 분야에서는 최고의 학회가 주요 관심사입니다. 여기서 수많은 "핫한 연구 방향"과 "혁신적인 방법"이 쏟아져 나올 것입니다.

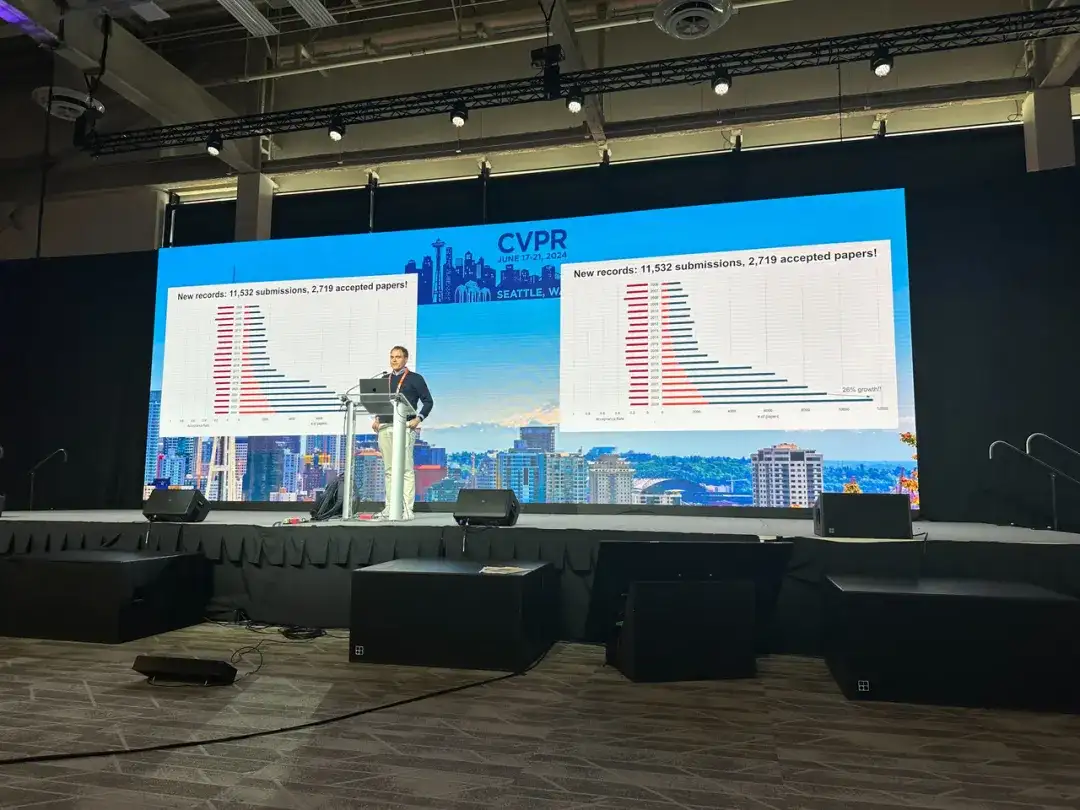

컴퓨터 비전과 인공지능 분야에서 학문적으로 가장 영향력 있는 3대 학회 중 하나인 올해의 컴퓨터 비전 및 패턴 인식 국제 학회(CVPR)는 학회 규모와 채택된 논문 수 측면에서 이전 기록을 경신했습니다.

CVPR의 최신 공식 발표에 따르면,CVPR 2024는 역사상 가장 규모가 크고 참석자가 가장 많은 컨퍼런스가 되었습니다.6월 19일 현재 현장 참여자 수가 1만 2천 명을 넘어섰습니다.

또한, CVPR은 선도적인 컴퓨터 비전 행사로서 매년 현재 시각 분야의 최신 연구 결과를 수용합니다. 올해 제출된 11,532편의 유효 논문 중 2,719편이 채택됐는데, 이는 CVPR 2023보다 많은 수치입니다.접수된 논문 수는 20.6% 증가한 반면, 승인율은 2.2% 감소했습니다.이 데이터는 CVPR 2024의 인기, 경쟁, 수상 논문의 질이 높아졌음을 보여줍니다.

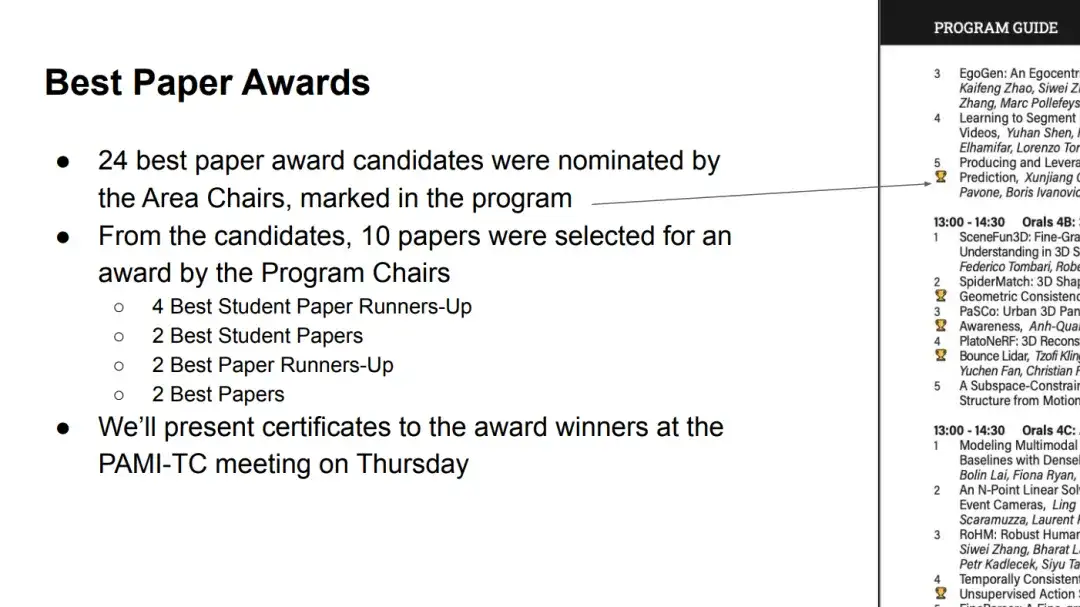

6월 20일 이른 아침(베이징 시간), CVPR 2024는 공식적으로 이번 세션의 최우수 논문 및 기타 상을 발표했습니다. 통계에 따르면 총 10편의 논문이 수상했습니다.그중에는 최우수 논문 2편, 최우수 학생 논문 2편, 최우수 논문 후보 2편, 최우수 학생 논문 후보 4편이 있습니다.

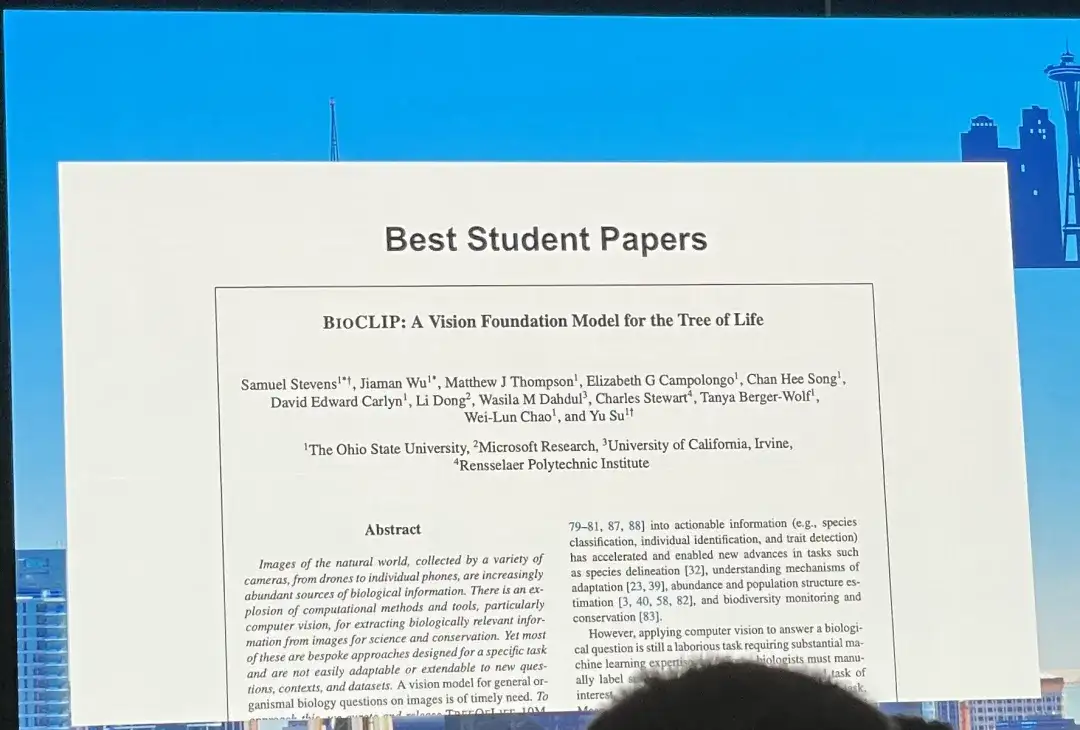

안에,“BIoCLIP: 생명나무를 위한 비전 기반 모델”이 최우수 학생 논문으로 선정되었습니다.이와 관련하여 MIT 컴퓨터 과학 및 인공지능 연구실의 조교수인 사라 비리는 저자와 팀이 "합당한" 수상자라고 언급했으며, 논문의 첫 번째 저자인 새뮤얼 스티븐스가 플랫폼에서 가장 먼저 감사의 마음을 표했습니다.

HyperAI는 "BIoCLIP: 생명 나무를 위한 비전 기반 모델"을 데이터 세트, 모델 아키텍처, 모델 성능 등의 측면에서 종합적으로 해석하고, 모든 사람을 위해 샘 스티븐스의 다른 업적을 요약합니다.

다운로드 주소:

https://arxiv.org/pdf/2311.18803

가장 크고 다양한 생물학적 이미지 데이터 세트 생성

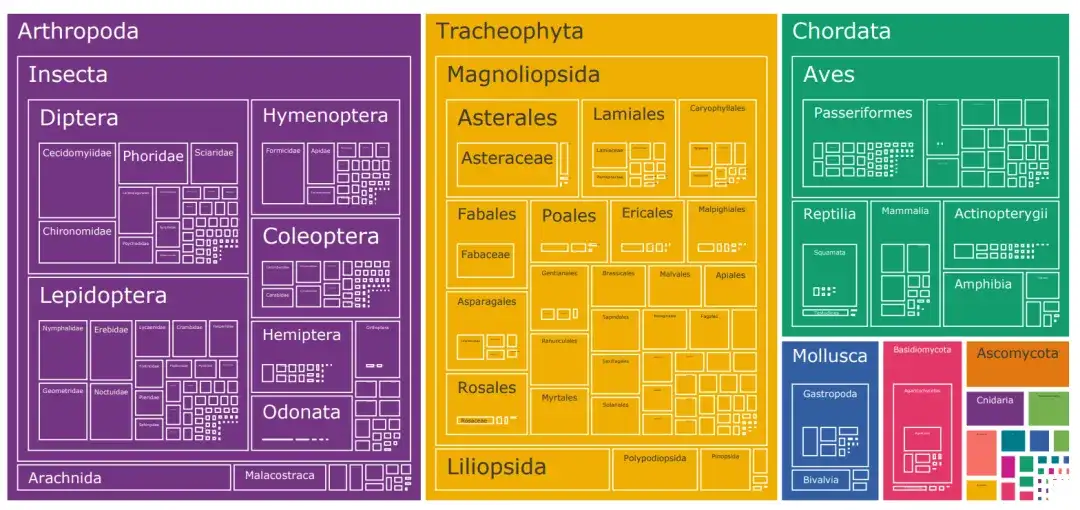

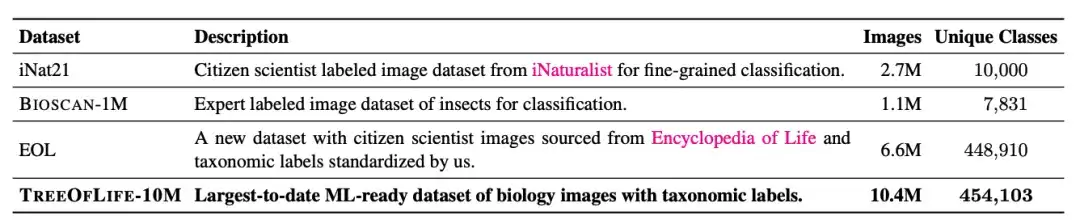

현재 머신러닝을 위한 가장 큰 생물학적 이미지 데이터 세트는 iNat21로, 270만 개의 이미지를 포함하고 있으며 10,000개 종을 다룹니다. iNat21의 분류 폭은 ImageNet-1k와 같은 일반 도메인 데이터 세트에 비해 크게 개선되었지만 생물학에서는 여전히 10,000종이 드뭅니다. 국제자연보전연맹(IUCN)은 2022년에 알려진 종이 200만 종이 넘으며, 이 중 조류와 파충류만 10,000종이 넘는다고 보고했습니다.

생물학적 이미지 데이터 세트의 종 범주 제한 문제를 해결하려면연구자들은 1,000만 개의 이미지를 포함하는 TreeOfLife-10M이라는 데이터 세트를 구축했습니다.45만 종 이상의 데이터를 다루면서 데이터 세트 크기와 종 다양성 측면에서 획기적인 진전을 이루었습니다.

이 데이터 세트는 iNaturalist, BIOSCAN-1M, Encyclopedia of Life(EOL)의 생물학적 이미지를 결합한 것입니다.

연구진은 iNat21이 다루는 10,000개 종 범주 외에도 EOL에서 660만 개의 이미지를 다운로드하여 TreeOfLife-10M을 확장하여 추가로 440,000개 분류군을 다루었습니다. 동시에 연구진은 기본 모델이 곤충에 대한 매우 세밀한 시각적 표현을 학습하도록 돕기 위해 최근 데이터 세트인 BIOSCAN-1M을 통합했습니다. 이 데이터 세트에는 494개의 서로 다른 과와 7,831개의 종 분류를 다루는 100만 개의 실험실 곤충 이미지가 들어 있습니다.

TreeOfLife-10M 다운로드 주소:

https://go.hyper.ai/Gliol

멀티모달 모델 BioCLIP: CLIP 기반 일반화 능력 향상

일반적인 작업에 비해 생물학적 컴퓨터 비전의 레이블 공간은 더 풍부합니다. 분류 주석의 수가 엄청날 뿐만 아니라, 주석들은 계층적 분류 시스템에서 서로 연결되어 있습니다. 이는 의심할 여지 없이 높은 종 범위와 강력한 일반화 기능을 갖춘 기본 모델을 훈련하는 데 엄청난 어려움을 안겨줍니다.

수백 년간의 생물학 연구 경험을 바탕으로, 연구진은 기본 모델이 주석 공간의 구조를 성공적으로 인코딩할 수 있다면, 특정 종이 관찰되지 않았더라도 모델이 해당 속이나 과를 식별하고 이에 상응하는 표현을 제공할 수 있을 것이라고 믿습니다. 이러한 계층적 표현은 새로운 분류군에 대한 소수의 학습이나 심지어는 제로샷 학습을 달성하는 데 도움이 됩니다.

이를 바탕으로 연구진은 OpenAI가 개발한 다중 모드 모델 아키텍처인 CLIP을 선택했습니다.그리고 CLIP의 다중 모드 대조 학습 목표를 사용하여 TREEOFLIFE-10M에 대한 지속적인 사전 학습을 실시합니다.

구체적으로, CLIP은 시각적 인코더와 텍스트 인코더라는 두 개의 단일 모드 임베딩 모델을 학습하여 양성 쌍 간의 피처 유사성을 최대화하고 음성 쌍 간의 피처 유사성을 최소화합니다. 여기서 양성 쌍은 학습 데이터에서 나오고 음성 쌍은 배치의 다른 모든 가능한 쌍입니다.

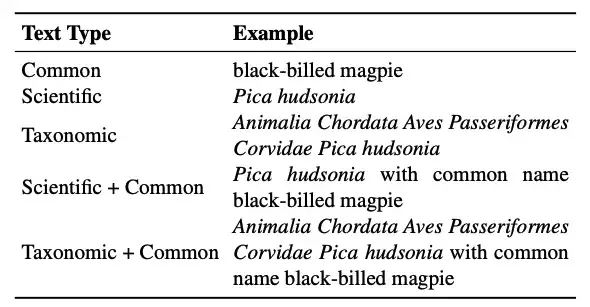

또한, CLIP의 중요한 장점 중 하나는 텍스트 인코더가 자유형 텍스트를 수용하여 생물학 분야의 다양한 클래스 이름 형식을 처리할 수 있다는 것입니다. 이 연구에서 텍스트 형식과 관련하여 연구자들은 주로 다음 사항을 고려했습니다.

* 분류학적 이름:표준적인 7단계 생물학적 분류는 높은 것부터 낮은 것까지 다음과 같습니다: 계, 문, 강, 목, 과, 속, 종. 각 종에 대해 뿌리부터 잎까지 모든 라벨을 하나의 문자열로 연결하여 분류법을 "평평하게" 만들었는데, 이것이 분류학적 이름입니다.

* 학명:속과 종으로 구성됨.

* 일반 이름:클래스 이름은 일반적으로 라틴어로 되어 있는데, 이는 일반적인 이미지-텍스트 사전 학습 데이터 세트에서는 일반적이지 않습니다. 대신, "검은부리까치"와 같은 일반적인 이름이 더 일반적입니다. 일반 이름과 분류군 사이에 일대일 대응이 없을 수도 있다는 점에 유의하세요. 한 종이 여러 개의 일반 이름을 가질 수도 있고, 같은 일반 이름이 여러 종을 지칭할 수도 있습니다.

실제 적용에서는 주석 입력 유형이 한 가지뿐일 수 있습니다. 추론 중 유연성을 높이기 위해연구자들은 혼합 텍스트 유형의 훈련 전략을 제안했습니다.즉, 각 학습 단계에서 각 입력 이미지는 사용 가능한 모든 텍스트 유형에서 무작위로 샘플링된 텍스트와 쌍을 이룹니다. 실험 결과, 이러한 훈련 전략은 분류 이름의 일반화 이점을 유지할 뿐만 아니라 추론 중에 더 많은 유연성을 제공한다는 것이 밝혀졌습니다.

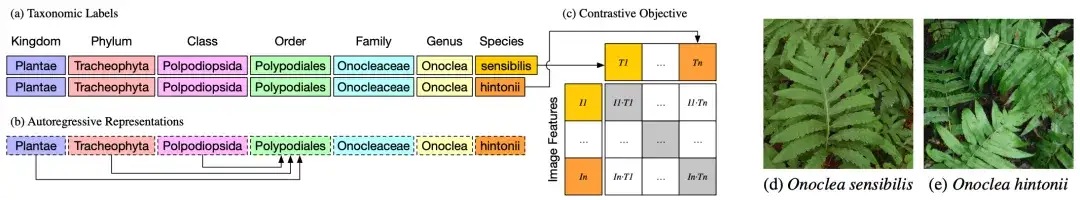

위의 그림 a에서 볼 수 있듯이, 두 가지 다른 식물, Onoclea sensibilis(d)와 Onoclea hintonii(e)의 분류군 또는 분류 라벨은 종을 제외하고는 정확히 동일합니다.

위의 그림 2b에서 보인 것처럼, 텍스트 인코더는 분류학의 계층적 표현을 자연스럽게 인코딩할 수 있는 자기회귀 언어 모델입니다. 여기서 Polypodiales의 순서 표현은 더 높은 순서에만 의존하고 계, 문, 강 토큰의 정보를 흡수할 수 있습니다. 분류 라벨의 이러한 계층적 표현은 표준 대조 사전 훈련 목표에 입력되고 이미지 표현(d) 및 (e)와 일치합니다.

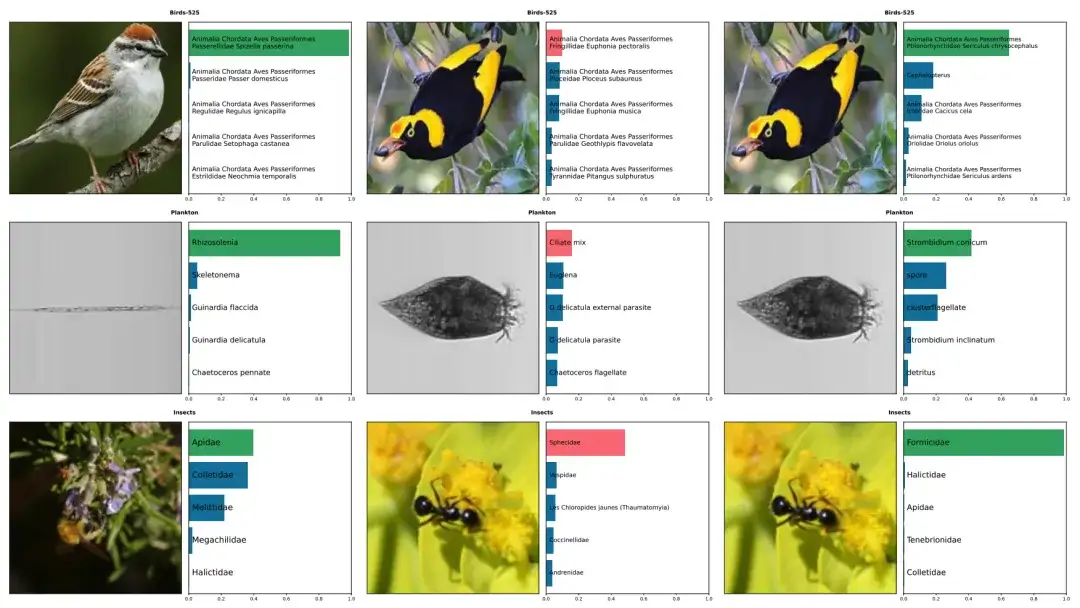

위 그림은 조류 525, 플랑크톤, 곤충을 포함한 5개 종에 대해 BioCLIP과 CLIP이 내린 예측의 예를 보여줍니다. 정답은 녹색으로 표시되고, 틀린 정답은 빨간색으로 표시됩니다. 왼쪽 열은 BioCLIP의 정확한 예측을 보여줍니다. 가운데와 오른쪽에는 CLIP에서는 잘못 주석이 달렸지만 BioCLIP에서는 올바르게 주석이 달린 이미지가 있습니다.

BioCLIP은 제로샷 및 퓨샷 작업에서 좋은 성능을 발휘합니다.

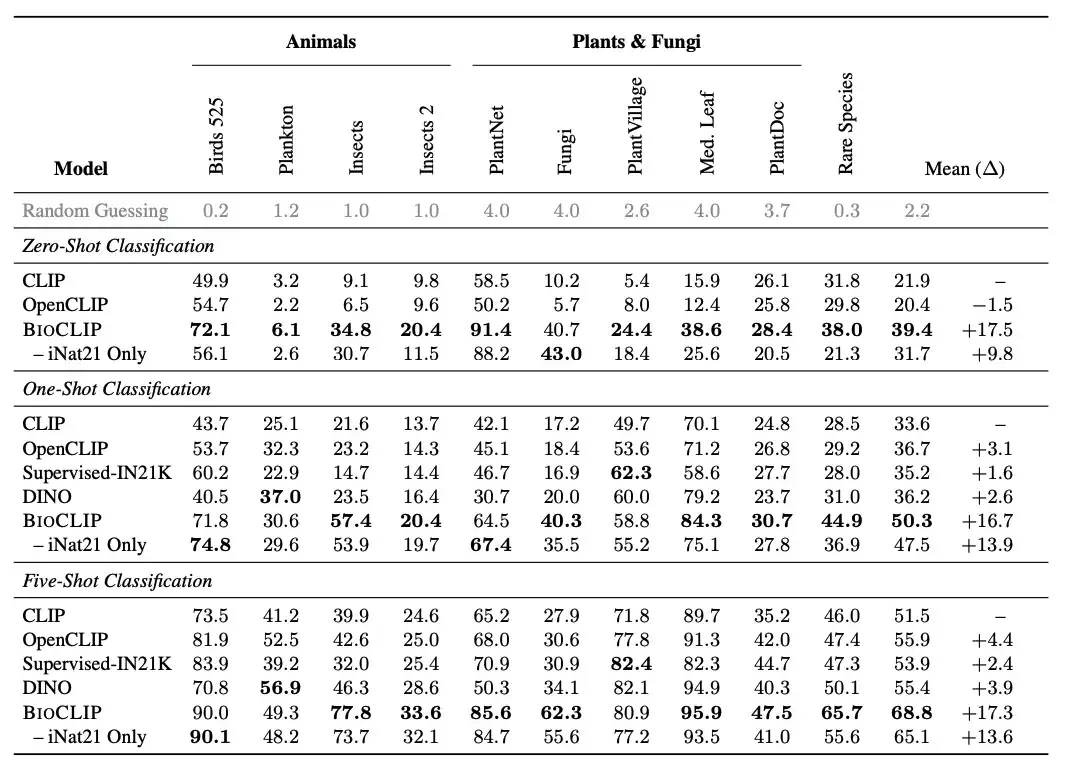

연구자들은 BioCLIP을 일반적인 시각 모델과 비교했습니다. 결과BioCLIP은 제로샷 및 퓨샷 작업 모두에서 우수한 성능을 발휘하며 CLIP보다 훨씬 뛰어납니다. 오픈클립,제로샷 및 퓨샷 작업의 평균 절대 개선은 각각 17% 및 16%입니다. 내재적 분석은 BioCLIP이 생명의 나무와 일치하는 더욱 세분화된 계층적 표현을 학습했음을 보여주었으며, 이는 BioCLIP의 뛰어난 일반화 능력을 설명합니다.

구체적으로 연구진은 IUCN 적색 목록에서 멸종위기종, 취약종, 멸종위기종, 심각한 멸종위기종, 야생에서 멸종으로 분류되는 약 25,000종의 종을 수집하여 새로운 평가 과제인 "희귀종"을 도입했습니다. 연구진은 EOL 데이터 세트에서 최소 30개의 이미지가 있는 400개의 종을 선택하여 TreeOfLife-10M에서 제거했습니다.희귀종의 새로운 테스트 세트를 생성했습니다.각 종마다 30개의 이미지가 있습니다.

위 그림에서 볼 수 있듯이, BioCLIP은 기준 CLIP 모델과 iNat21로 훈련된 CLIP 모델보다 제로샷 분류에서 상당히 우수한 성능을 보이며, 특히 눈에 띄지 않는 분류에서 그 성능이 뛰어납니다(희귀종 열 참조).

최고의 BioCLIP에 대한 과학적 연구를 탐구하여 유익한 결과를 얻으세요

"BioCLlP: 생명나무를 위한 비전 기반 모델"은 오하이오 주립대학교, 마이크로소프트 연구소, 캘리포니아 대학교 어바인 캠퍼스, 렌슬러 폴리테크닉 연구소가 공동으로 발표했습니다.이 논문의 첫 번째 저자인 사무엘 스티븐스 박사와 교신 저자인 지아만 우는 모두 오하이오 주립 대학 출신입니다.

사뮤엘 스티븐스는 자신의 개인 웹사이트에서 자신을 "자신을 그다지 진지하게 받아들이지 않는 사람"이라고 겸손하게 표현했지만, 최근 몇 년간의 유익한 과학 연구 결과와 끊임없는 노력으로 미루어 볼 때, 그는 분명히 과학 연구를 진지하게 받아들이는 사람입니다.

Samuel Stevens는 2017년부터 컴퓨터 작업에 종사해 온 것으로 알려졌습니다. 다중 모드 모델 BioCLlP는 그가 2023년 12월에 발표한 연구 결과이며, 2024년 2월에 CVPR 2024에 수락되었습니다.

사실, BioCLIP와 같은 컴퓨터 비전 작업은 그의 연구 방향 중 하나일 뿐입니다. 그는 광범위한 관심사를 가지고 있으며 암호화를 위한 AI와 다양한 LLM 프로젝트와 같은 분야에서 일련의 연구를 수행했습니다.

예를 들어, 그는 "MMMU: 전문가 AGI를 위한 대규모 다학문적 다중 모드 이해 및 추론 벤치마크"에 참여했습니다.새로운 벤치마크인 MMMU(Massive Multi-Task Language Understanding)가 제안되었습니다.업계에서 가장 영향력 있는 대규모 모델 평가 벤치마크 중 하나인 MMMU는 고급 인식 및 추론을 위해 특정 분야(과학, 건강 및 의학, 인문학 등)의 지식을 활용하는 데 중점을 두고 있으며, 전문가가 직면한 것과 유사한 작업을 수행할 수 있는 다중 모드 모델이 필요합니다.

연구진은 이를 사용해 오픈소스 LMM 14개와 독점 GPT-4V(ision)를 평가한 결과, 고급 GPT-4V조차도 56%의 정확도만 달성한 것으로 나타났습니다. 이는 모델 개선의 여지가 여전히 많다는 것을 보여줍니다. 이에 대해 연구진은 이 벤치마크가 커뮤니티가 전문가 수준의 인공 일반 지능을 달성하기 위한 차세대 다중 모드 기반 모델을 구축하도록 영감을 줄 수 있기를 기대한다고 밝혔습니다.

MMMU: https://mmmu-benchmark.github.io

물론, 과학 연구에 대한 그의 열정과 개방적인 태도도 그의 성공에 중요한 요인이었습니다. 어제 BioCLlP가 최우수 학생 논문으로 선정되었다는 소식이 전해지자, 사무엘 스티븐스 박사는 소셜 플랫폼을 통해 즉시 자신의 견해를 외부에 표명했습니다. "동물의 컴퓨터 비전, 다중 모드 기본 모델, 과학을 위한 AI 등에 대해 이야기하고 싶으시다면 개인 메시지를 보내주세요!"

사뮤엘 스티븐스 박사는 과학 연구를 선도할 뿐만 아니라, 젊은 세대를 지원하는 일도 잊지 않는다는 점도 언급할 가치가 있습니다. 그의 개인 웹사이트에는 초보자를 위한 조언도 나와 있습니다. "머신러닝과 인공지능을 시작하고 싶다면 Coursera의 머신러닝 강좌와 Andrej Karpathy의 신경망: 초보자부터 전문가까지(Neural Networks: Zero to Hero)부터 시작해 보세요. 두 강좌 모두 매우 높은 품질을 자랑하며 다른 무료 자료에 비해 훨씬 더 많은 가치를 제공할 것입니다."

참고문헌:

1. https://samuelstevens.me/#news

마지막으로, 활동을 추천해드릴게요!

QR코드를 스캔하여 "AI 컴파일러 만나기" 기술 살롱 5기 오프라인 모임에 등록하세요↓