무엇! 이런 방식으로 머신러닝을 사용할 수 있나요?

우리는 일본인이 세계에서 가장 발달된 상상력을 가지고 있다는 것을 인정해야 합니다. 주류 사회의 거의 대부분이 2차원의 이상한 분위기, 장난, 오타쿠에 잠겨 있습니다.

강철 같은 사람처럼 직설적인 기술인 머신 러닝은 일반적으로 보안, 금융, 자율 주행, 물류와 같은 고강도 분야에 먼저 사용되며, 이는 미국과 중국을 중심으로 한 선진국에서도 마찬가지입니다. 인상적이지 않나요?

이 직설적인 남자의 머신 러닝이 일본에 적용되자 스타일이 갑자기 바뀌었습니다.

도쿄의 데이터 과학자인 켄지 도이는 머신 러닝 모델과 Google의 AutoML Vision을 사용하여 라면을 분류했습니다.

맞습니다. 진짜 라면이에요.

이 프로젝트의 목적 또한 놀랍습니다. Kenji Doi는 머신 러닝을 사용하여이 국수 한 그릇이 유명한 일본 라면 레스토랑인 라멘 지로의 여러 지점 중 어느 지점에서 나온 것인지 확인하세요. 지금까지 이 모델의 정확도는 95 %라고 합니다.

이 애니메이션 그림을 통해 이 모델의 데이터 세트를 살펴보겠습니다.

라멘 지로는 도쿄에만 41개의 지점을 두고 있는 일본에서 가장 인기 있는 레스토랑 중 하나입니다. 각 식당은 동일한 메뉴를 공유하고, 국수를 담는 그릇도 거의 동일합니다. 저는 일본인의 꼼꼼함, 정밀함, 그리고 업무에 있어서의 장인정신을 더해 각 분야마다 생산 기술과 표준에 대한 엄격한 요구 사항이 있다고 믿습니다.

그래서 사진만 봐서는 국수 한 그릇이 어느 종류인지 알아내기가 정말 어렵습니다. 심지어 요리사 본인도 그렇게 하는 게 어렵다고 생각합니다.

하지만 켄지는 딥러닝이 가장 작은 차이점을 식별함으로써 이 문제를 해결할 수 있다고 믿습니다.

RML(라면 머신러닝)

이를 위해 그는 각 매장의 음식을 깊이 있게 맛보기 시작했습니다. (오류)

그는 라면을 분류하는 머신러닝 모델을 구축했고, Google의 AutoML Vision을 사용하여 작업을 더욱 효율적으로 수행할 수 있는지 알아보고 싶어했습니다.

AutoML Vision은 야생 동물이나 제품 유형을 식별하기 위한 맞춤형 ML 모델을 생성하므로 이론상 라면을 분류하는 데 사용될 수 있습니다. 사용하기도 간편합니다. 잘 태그된 사진을 업로드하고 확인을 클릭하기만 하면 됩니다.

켄지의 경우, 그는 라멘 지로 도쿄 매장의 그릇 사진 48,000장과 각 매장의 라벨을 수집하여 AutoML Vision에 업로드했습니다. 이 모델은 인식을 수행하는 데 약 24시간 동안 실행되었고, 유망한 결과를 얻었습니다. 켄지의 모델은 사진에서 매장 위치를 예측하는 데 94.5%의 정확도를 달성했습니다.

AutoML이 라면의 차이를 감지하는 방식은 맛과 전혀 관련이 없습니다. 결국 GPU에는 혀가 없습니다.

켄지의 첫 번째 가설은 모델이 그릇과 테이블의 색깔이나 모양으로 식별되었지만, 각 지점의 디자인은 매우 유사하다는 것이었습니다. 이에 대해 켄지의 두 번째 시도는 재료의 양과 표현, 고기의 두께, 양념장의 색깔을 활용하는 것이었습니다. 이런 차이점은 일반인에게는 감지하기 어렵고, 육안으로는 판단하기 어렵습니다. 하지만 머신러닝을 통해 이를 간단하고 정량화할 수 있게 됐습니다.

AutoML Vision은 사용하기 쉬워서 프로그래밍 지식이 없어도 쉽게 사용할 수 있습니다. 이는 컴퓨터 과학 분야가 아닌 전문가의 연구도 용이하게 해줍니다. 더욱 흥미로운 시도를 기대해 보자.

일본에서는 AI를 플레이하는 부적절한 방법이 너무 많습니다.

사실, 라멘과 비교해보면 일본은 인공지능 기술이 더 흥미로운데, 이 모든 기술이 2차원 문화에 적용돼 있습니다.

한 번의 클릭으로 고양이 귀를 추가하세요

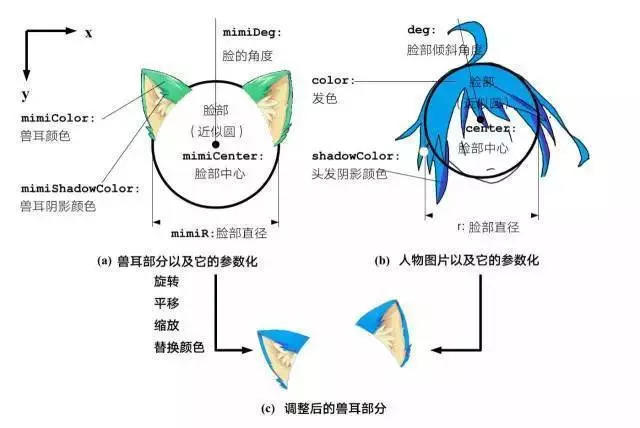

이 가젯에서는사용자는 그림을 웹 페이지로 끌어다 놓기만 하면, 알고리즘이 그림의 전반적인 스타일과 캐릭터 머리의 기울기 각도를 기반으로 적합한 동물 귀를 자동으로 추가합니다.

귀의 색깔은 캐릭터의 머리 색깔에 따라 바뀔 수도 있습니다.고양이 귀 외에도 토끼 귀, 개 귀, 여우 귀 등으로도 바꿀 수 있습니다.

딥러닝은 확실히 이미지 인식 단계를 사용합니다. 이 프로젝트는 2차원 얼굴 인식 라이브러리인 AnimeFace가 제공하는 일부 매개변수를 사용합니다. AnimeFace는 얼굴 인식의 정확도를 높이기 위해 7만 장의 얼굴 이미지와 3억 장의 비얼굴 이미지 학습 데이터를 축적하여 최종적으로 얼굴, 피부, 머리카락, 눈 색깔을 정확하게 식별하는 효과를 얻었습니다.

아내의 사진은 아무리 커도 왜곡되지 않습니다.

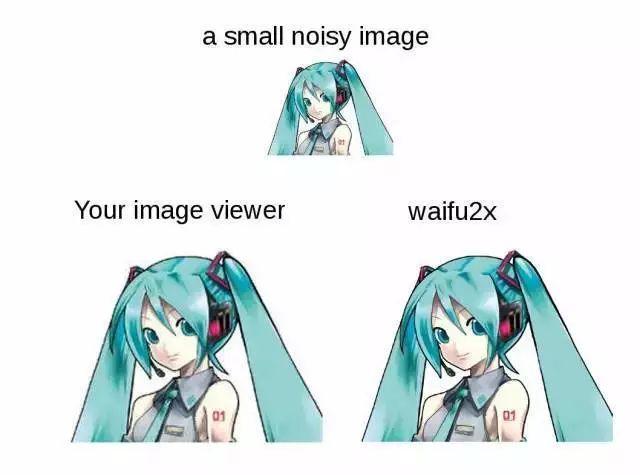

이 도구 "Waifu2x"는 재미있고 직접적인 이름과 실용성으로 2D 엔지니어들 사이에서 잘 알려져 있습니다. 일본어 발음으로는 "아내"는 "와이후"로 발음되고, 2x는 2를 곱한다는 뜻입니다.

Waifu2x는 애니메이션 스타일의 이미지에만 사용할 수 있는 이미지 확대 도구입니다. 흐릿한 작은 이미지를 손실 없이 두 배로 확대하고, 노이즈를 줄이고, 곡선을 부드럽게 만들 수 있습니다.이름에서도 작가의 2차원 미소녀에 대한 사랑이 느껴진다.

Waifu2x의 알고리즘은 합성곱 신경망 기술을 기반으로 합니다. 저자는 수만 장의 애니메이션 소녀 사진과 원본 사진에 대응하는 수만 개의 썸네일을 절반의 너비와 높이로 학습하고, 원본 사진을 최대한 복원하기 위해 썸네일을 확대하는 방법을 학습시켰습니다.

이런 창의성과 상상력이 있다면, 어쩌면 언젠가는 2차원 세계가 정말로 세상을 구할 수도 있을 것입니다.