Command Palette

Search for a command to run...

스캔들에 연루된 페이스북, AI 봇 활용해 직원들 입 통제 시도

홍보 위기는 기업 경영에 있어서 늘 주요 문제였다. 기업의 규모가 확대되고 영향력이 커짐에 따라, 직원들의 외부 의견을 통합하는 것도 중요한 과제로 떠올랐습니다. 모든 직원을 대상으로 회의를 조직하고 그룹 내에서 뉴스 초안을 연구하는 것에서부터, AI는 이제 직원의 내부 교육을 위한 강력한 도구가 되었습니다.

홍보 위기에 대해 이야기할 때, 많은 독자의 첫 번째 반응은 온라인에 많은 게시물을 올리고 삭제하는 것입니다. 사실, 여론 모니터링은 회사 홍보부서의 일상 업무 중 하나일 뿐입니다.

기업의 규모와 영향력이 커짐에 따라 홍보 부서의 역할이 중요해집니다. 위기에 직면했을 때 정확하고 신속하게 의견을 표명하고, 회사 내에서 의견을 통합하며, 2차 피해를 피하는 것도 매우 중요합니다.

엘레미, "갱신 잊으면" 홍보 재앙

2016년 3월 15일, CCTV의 315 갈라는 음식 배달 플랫폼 Ele.me에서 여러 건의 부정직한 작업장이 운영되고 있음을 폭로했습니다.

보고서는 Ele.me 플랫폼의 불규칙한 관리에 많은 문제가 있다고 직접 지적했습니다. 여기에는 상인들에게 주소를 조작하도록 유도하고, 가짜 실체 사진을 업로드하고, 심지어 무허가 블랙 작업장이 입주하도록 허용하는 것도 포함됩니다.

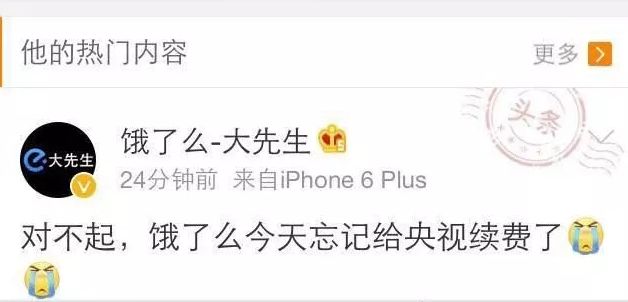

해당 보도가 나오자마자 공식 웨이보 계정에서는 성명을 발표할 시간이 없었다. Ele.me 직원이 웨이보에서 앞장서서 목소리를 냈습니다. "죄송합니다. Ele.me가 오늘 CCTV 구독을 갱신하는 걸 잊었습니다."

이 직설적인 "미스터 빅"의 인증된 웨이보 신원은 그가 Ele.me의 온라인 음식 주문 부문의 수석 마케팅 매니저라는 것입니다.

단 하나의 돌이 수천 개의 파장을 일으킬 수 있다. 다 씨의 행동은 인터넷에서 금세 퍼졌습니다. 네티즌들은 315 갈라를 시청하기도 전에 엘레미를 비난하기 시작했습니다.

그는 잘못을 저질렀을 때, 자신의 실수를 인정하고 빨리 보상하는 대신, 바로 책임을 전가하고 CCTV를 비방하려고 했습니다. 그 결과 Ele.me는 "훌륭한" 직원인 다 씨의 부적절한 발언으로 인해 더욱 심각한 홍보 위기를 겪었습니다.

Liam Bot: AI를 사용하여 직원들에게 동일한 방식으로 답변하도록 가르치기

페이스북은 지난 2년 동안 여러 차례 "홍보 위기"를 겪었습니다.

작년에 사용자 개인정보가 유출되어 50억 달러의 벌금을 물었던 케임브리지 애널리티카 사건부터, 올해는 중국 직원이 엄청난 압박으로 인해 건물에서 뛰어내리는 사건, 그리고 블록체인 프로젝트 리브라가 여러 국가에서 거부당한 사건까지.

세계에서 8번째로 부유한 사람인 주커버그는 "세계를 연결하자"라는 기치를 내걸고 페이스북을 여론의 늪으로 몰아넣어 앞으로 나아가기 어렵게 만들었다.

압박을 받는 사람은 주커버그와 페이스북의 홍보부뿐만이 아니다. 기초 조직 직원들은 주변의 친척과 친구들이 제기한 민감한 질문에 어떻게 대답해야 할지 모른다고 말했습니다.

회사가 홍보 위기에 직면하게 되면 홍보팀은 정부와 언론의 질의에 대응하기 위해 경영진에게 적극적으로 조언을 제공하게 되며, 고위 경영진이 잘못된 말을 하거나 잘못된 태도를 보일 가능성은 크게 줄어들 것입니다.

하지만 풀뿌리 직원들은 그렇게 안전하지 않습니다. 홍보팀을 제대로 관리하지 못하면, 하부 조직의 직원들이 불편함을 표출하면 그것이 "전국적 십자군 운동"의 원동력이 될 수 있습니다.

Facebook은 이 문제의 긴급성을 인식하고 회사의 입장과 관련된 논란이 되는 문제를 직원들이 처리할 수 있도록 돕기 위해 AI 질의응답 로봇인 Liam Bot을 개발했습니다.

뉴욕 타임스에 따르면, Liam Bot이 제공한 답변은 Facebook의 홍보 부서에서 제공한 것입니다. 리암 봇은 주커버그와 다른 임원들의 공개 연설을 바탕으로 특정 질문에 대한 일련의 의견과 답변을 출력할 수도 있으며, 이를 통해 직원들이 휴일 모임에서 가족 및 친구 사이에서 발생하는 까다로운 질문에 답하도록 안내할 수 있습니다.

Facebook은 이번 봄에 Liam Bot에 대한 내부 테스트를 시작하여 추수감사절 전날에 출시했습니다. 이 테스트에서는 직원들에게 증오 표현, 가짜 뉴스에 대한 Facebook의 태도와 관행, 사용자 개인정보 유출, 선거 간섭 및 기타 문제를 다루는 질문에 답하도록 안내했습니다. 회사가 직원에 대해 정말로 관심을 갖고 있다고 할 수 있습니다.

예를 들어, 직원들에게 Facebook이 증오 표현을 어떻게 처리하는지 묻는 경우 Liam Bot은 다음을 포함하여 네 가지 다른 답변을 직원들에게 제공합니다.

① 페이스북, 관련 전문가들과 협력해 해결책 모색

② 회사는 증오 표현을 적시에 감지하고 처리하기 위해 인공지능 기술을 개발하고 있습니다.

③ 회사는 콘텐츠 모니터링을 돕기 위해 검열관을 고용했습니다.

④ 이 문제를 해결하려면 관련 법규의 개선이 필요하다.

또한 Liam Bot은 직원들에게 Facebook을 인용하도록 제안할 것입니다. 분기 보고서그리고 설득력을 높이기 위한 다른 데이터도 있습니다.

홍보 입장을 통일하는 것이 정치적으로 올바른가?

Liam Bot의 주장에 대해 소셜 네트워크에 수많은 댓글이 달렸습니다.반대하다소리.

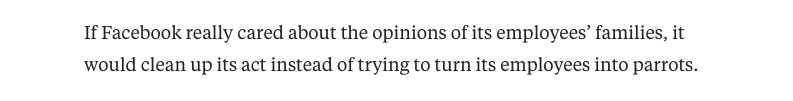

번역: 페이스북이 직원 가족의 의견을 정말로 신경 쓴다면, 직원을 앵무새처럼 훈련시키는 대신, 스스로 행동을 규제할 것입니다.

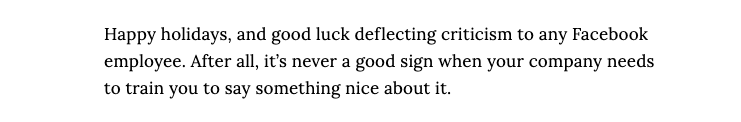

번역: Facebook 직원 여러분, 즐거운 휴일 보내세요. 하지만 회사에서 직원들에게 회사에 대한 좋은 이야기를 하도록 교육시키고 싶어 할 때는 결코 좋은 일이 아닙니다.

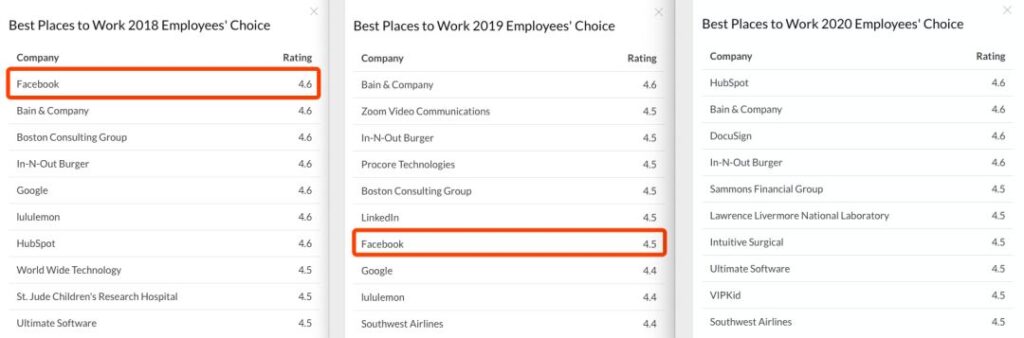

Glassdoor는 최근 직원들이 선정한 2020년 가장 이상적인 회사를 발표했습니다. 2018년 1위에서 2019년 7위, 2020년 톱10 탈락, 직원들의 눈에 비친 Facebook의 이미지는 점점 더 하락세를 보이고 있습니다.

네티즌들이 지적했듯이, AI 챗봇을 통해 직원들의 대외적 발언을 통합하는 것보다, 증오 표현을 처리하고 사용자 정보 유출을 통제하는 데 더 많은 에너지를 투자하는 게 나을 것입니다.

-- 위에--