Command Palette

Search for a command to run...

MINT-1T 텍스트-이미지 쌍 다중 모드 데이터세트

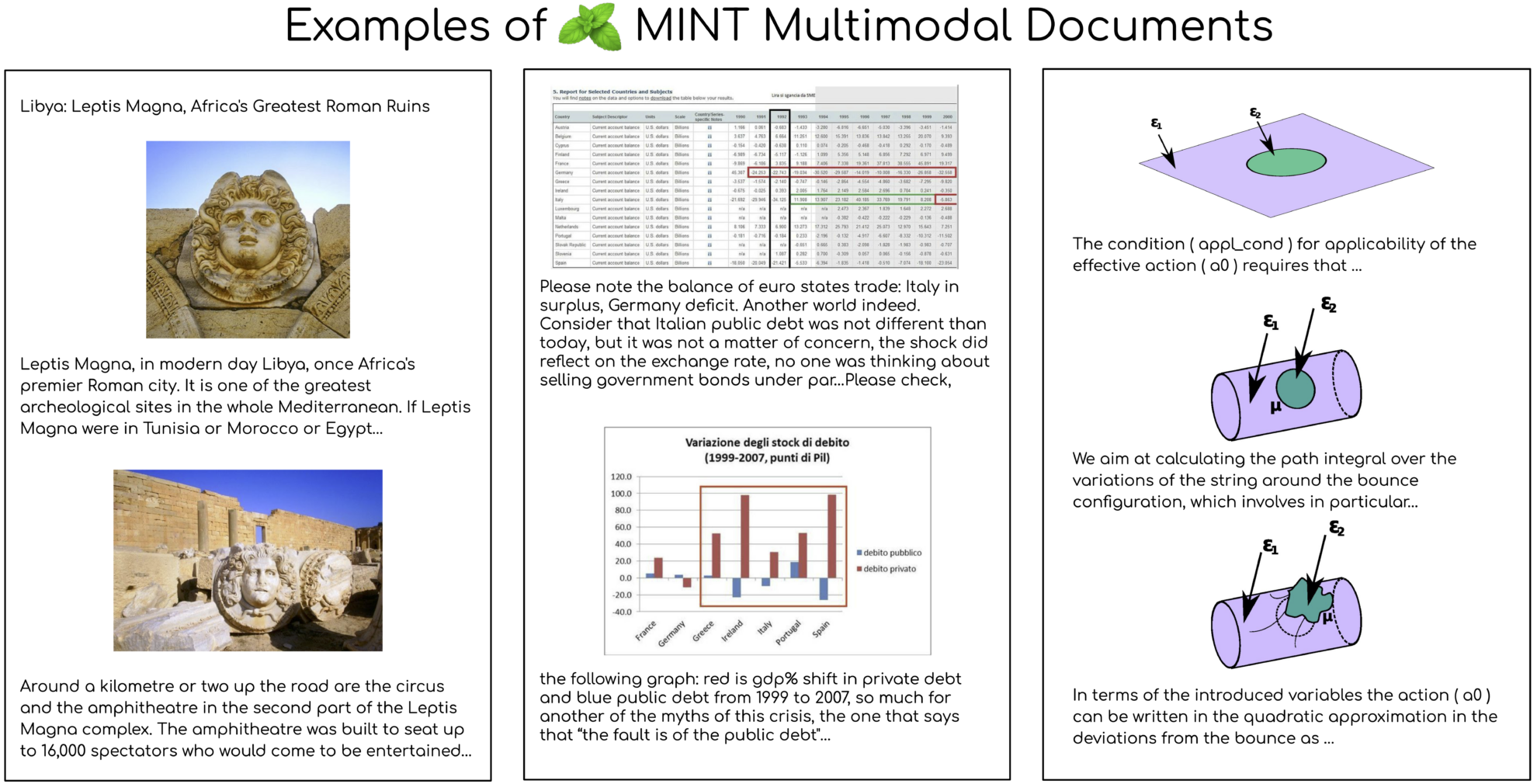

MINT-1T 데이터 세트는 Salesforce AI와 여러 기관이 2024년에 공동으로 오픈소스화한 멀티모달 데이터 세트입니다. 규모가 상당히 확장되어 1조 개의 텍스트 태그와 34억 개의 이미지에 이르며, 이는 이전에 가장 큰 오픈소스 데이터 세트의 10배에 달하는 규모입니다. 관련 논문 결과는 "MINT-1T: 오픈소스 멀티모달 데이터를 10배 확장: 1조 개의 토큰이 포함된 멀티모달 데이터 세트". 이 데이터셋은 규모와 다양성이라는 핵심 원칙을 따릅니다. HTML 문서뿐만 아니라 PDF 문서와 ArXiv 논문도 포함됩니다. 이러한 다양성은 과학 문서의 커버리지를 크게 향상시킵니다. MINT-1T의 데이터 소스는 웹 페이지, 학술 논문, 그리고 이전에는 멀티모달 데이터셋에서 충분히 활용되지 않았던 문서 등 다양합니다.

모델 실험 측면에서, MINT-1T에서 사전 학습된 XGen-MM 멀티모달 모델은 이미지 설명과 시각적 질의응답 벤치마크에서 우수한 성능을 보이며, 이전의 주요 데이터 세트인 OBELICS를 능가했습니다. 분석을 통해 MINT-1T는 규모, 데이터 소스 다양성, 품질 면에서 상당한 개선을 이루었습니다. 특히 PDF 및 ArXiv 문서의 경우 평균 길이가 훨씬 길고 이미지 밀도가 더 높습니다. 또한, LDA 모델을 통한 문서 주제 모델링의 결과는 MINT-1T의 HTML 하위 집합이 더 넓은 도메인 커버리지를 보이는 반면, PDF 하위 집합은 주로 과학 및 기술 분야에 집중되어 있음을 보여줍니다.

MINT-1T는 ArXiv 및 PDF 문서에서 해당 분야의 인기가 높아 특히 과학 및 기술 분야에서 여러 작업에서 뛰어난 성능을 보여줍니다. 모델의 상황적 학습 성능은 다양한 개수의 예를 사용하여 평가됩니다. MINT-1T로 학습된 모델은 모든 수의 예제에서 기준 모델 OBELICS보다 성능이 뛰어납니다. MINT-1T의 출시는 연구자와 개발자에게 대규모 멀티모달 데이터 세트를 제공할 뿐만 아니라, 멀티모달 모델의 훈련과 평가를 위한 새로운 과제와 기회를 제공합니다.