Command Palette

Search for a command to run...

HealthGPT : Assistant Médical IA

Date

Taille

600.63 MB

Licence

Apache 2.0

GitHub

URL du document

1. Introduction au tutoriel

HealthGPT, un modèle de langage visuel médical à grande échelle (Med-LVLM) développé conjointement le 16 mars 2025 par l'Université du Zhejiang, l'Université des sciences et technologies électroniques de Chine, Alibaba, l'Université des sciences et technologies de Hong Kong et l'Université nationale de Singapour, propose un cadre unifié pour la compréhension et la génération de données visuelles médicales grâce à une technologie d'adaptation des connaissances hétérogènes. Il utilise une technique innovante d'adaptation hétérogène de faible rang (H-LoRA), stockant les connaissances nécessaires aux tâches de compréhension et de génération visuelles dans des modules indépendants afin d'éviter les conflits entre les tâches. HealthGPT est disponible en deux versions : HealthGPT-M3 (3,8 milliards de paramètres) et HealthGPT-L14 (14 milliards de paramètres), basées respectivement sur les modèles de langage pré-entraînés Phi-3-mini et Phi-4. Le modèle introduit la perception visuelle hiérarchique (HVP) et une stratégie d'apprentissage en trois étapes (TLS) pour optimiser l'apprentissage des caractéristiques visuelles et l'adaptation aux tâches. Des articles de recherche associés sont disponibles. HealthGPT : un modèle médical de vision et de langage à grande échelle pour unifier la compréhension et la génération via l'adaptation de connaissances hétérogènes Elle a été incluse dans ICML 2025 et sélectionnée comme projet phare.

Ce tutoriel utilise les ressources d'une seule carte RTX A6000. L'anglais est recommandé.

Le projet propose deux modèles de modèles :

- HealthGPT-M3 : une version plus petite optimisée pour la vitesse et une utilisation réduite de la mémoire.

- HealthGPT-L14 : une version plus grande conçue pour des performances supérieures et des tâches plus complexes.

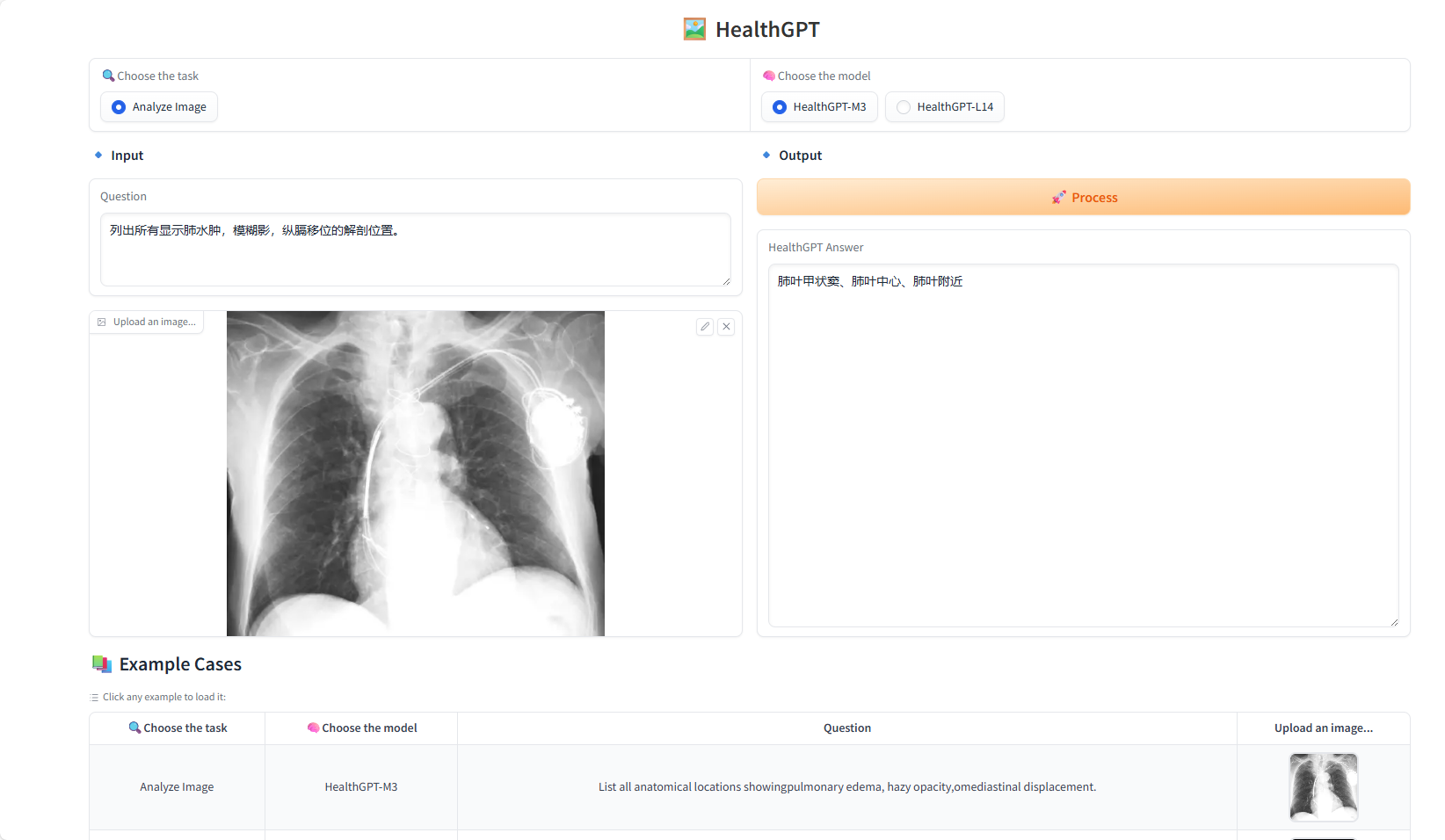

2. Exemples de projets

3. Étapes de l'opération

1. Après avoir démarré le conteneur, cliquez sur l'adresse API pour accéder à l'interface Web

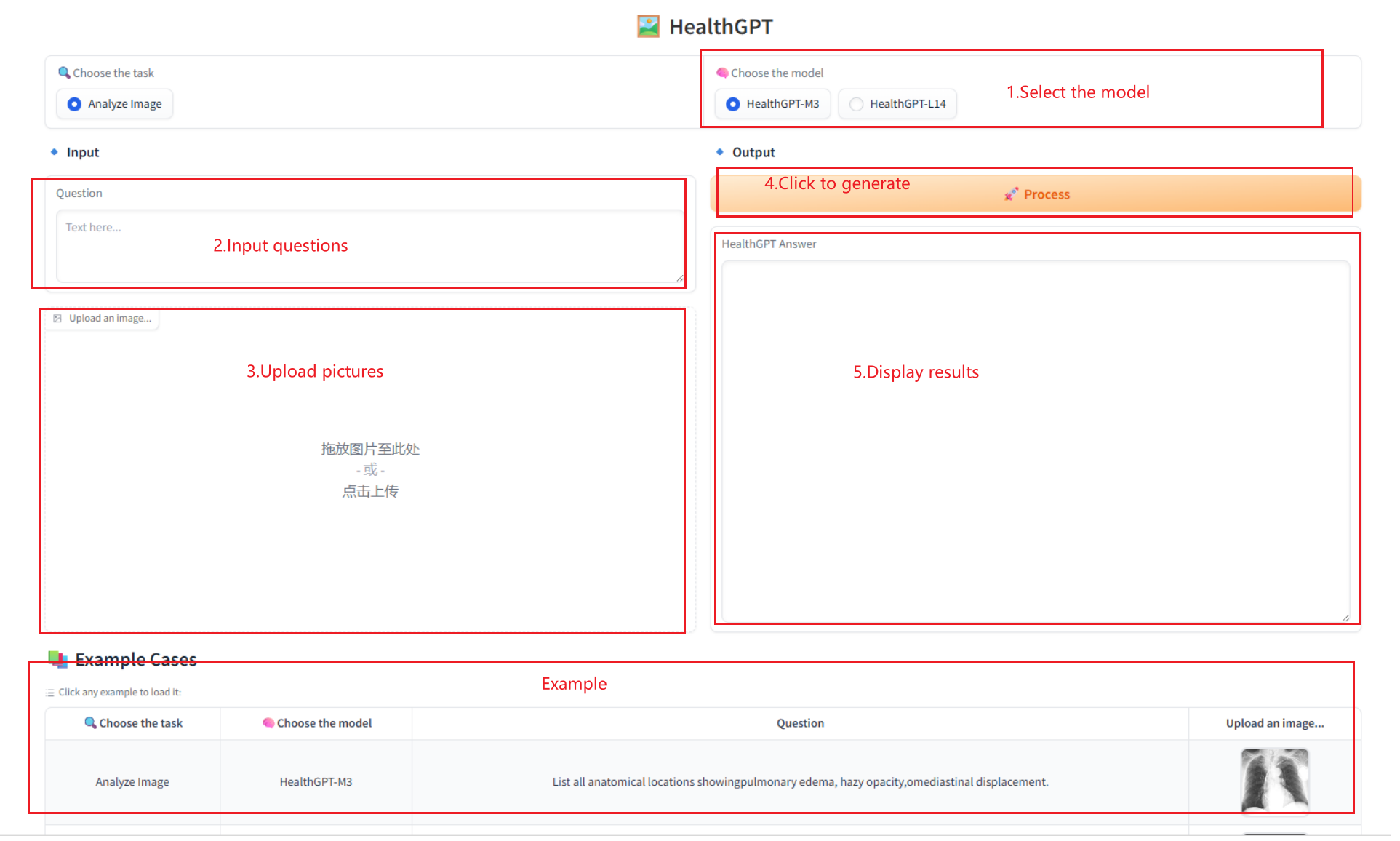

2. Étapes d'utilisation

Si « Bad Gateway » s'affiche, cela signifie que le modèle est en cours d'initialisation. Étant donné que le modèle est grand, veuillez patienter environ 2 à 3 minutes et actualiser la page.

4. Discussion

🖌️ Si vous voyez un projet de haute qualité, veuillez laisser un message en arrière-plan pour le recommander ! De plus, nous avons également créé un groupe d’échange de tutoriels. Bienvenue aux amis pour scanner le code QR et commenter [Tutoriel SD] pour rejoindre le groupe pour discuter de divers problèmes techniques et partager les résultats de l'application↓

Informations sur la citation

Merci à l'utilisateur Github xxxjjjyyy1 Déploiement de ce tutoriel. Les informations de citation pour ce projet sont les suivantes :

@misc{lin2025healthgptmedicallargevisionlanguage,

title={HealthGPT: A Medical Large Vision-Language Model for Unifying Comprehension and Generation via Heterogeneous Knowledge Adaptation},

author={Tianwei Lin and Wenqiao Zhang and Sijing Li and Yuqian Yuan and Binhe Yu and Haoyuan Li and Wanggui He and Hao Jiang and Mengze Li and Xiaohui Song and Siliang Tang and Jun Xiao and Hui Lin and Yueting Zhuang and Beng Chin Ooi},

year={2025},

eprint={2502.09838},

archivePrefix={arXiv},

primaryClass={cs.CV},

url={https://arxiv.org/abs/2502.09838},

}Créer de l'IA avec l'IA

De l'idée au lancement — accélérez votre développement IA avec le co-codage IA gratuit, un environnement prêt à l'emploi et le meilleur prix pour les GPU.