Command Palette

Search for a command to run...

Déployer GLM-4-32B À l'aide De vLLM Et d'Open-WebUI

1. Introduction au tutoriel

Le projet GLM4 a été lancé par l'organisation THUDM en 2025, et le rapport technique correspondant est « ChatGLM : une famille de modèles de langage complets, de GLM-130B à GLM-4 (tous les outils) ».

La famille GLM accueille un nouveau membre, le modèle de la série GLM-4-32B-0414, qui possède 32 milliards de paramètres, des performances comparables à celles de la série GPT d'OpenAI et de la série V3/R1 de DeepSeek, et prend en charge des fonctions de déploiement local très conviviales. GLM-4-32B-Base-0414 a été pré-entraîné sur 15T de données de haute qualité, y compris une grande quantité de données synthétiques pour le raisonnement, jetant les bases d'une expansion ultérieure de l'apprentissage par renforcement. Dans la phase post-formation, l’équipe de recherche a introduit l’alignement des préférences homme-machine pour les scénarios de dialogue. De plus, l'équipe de recherche a utilisé des techniques telles que l'échantillonnage par rejet et l'apprentissage par renforcement pour améliorer les performances du modèle en matière de suivi des instructions, d'ingénierie de code et d'appel de fonctions, améliorant ainsi les capacités atomiques requises pour les tâches proxy. GLM-4-32B-0414 a obtenu de bons résultats en ingénierie de code, génération d'artefacts, appel de fonctions, réponse aux questions basées sur la recherche et génération de rapports. En particulier, sur plusieurs benchmarks tels que la génération de code ou des tâches de réponse à des questions spécifiques, GLM-4-32B-Base-0414 atteint des performances comparables à des modèles plus grands tels que GPT-4o et DeepSeek-V3-0324(671B).

Ce tutoriel utilise les ressources du A6000 double SIM.

👉 Ce projet fournit un modèle de :

- Modèle GLM-4-32B-0414

Exemples de projets

Dessin d'animation

| GLM-Z1-32B-0414 | GLM-4-32B-0414 |

| écrivez un programme Python qui montre une balle rebondissant à l'intérieur d'un hexagone en rotation. La balle doit être affectée par la gravité et la friction, et elle doit rebondir de manière réaliste sur les parois rotatives. | Utilisez HTML pour simuler une petite balle libérée du centre d'un hexagone en rotation. Considérez la collision entre la balle et la bordure hexagonale et la gravité sur la balle, et supposez que la collision est complètement élastique. |

Conception de sites Web

| GLM-4-32B-0414 | GLM-4-32B-0414 |

Génération SVG

| GLM-4-32B-0414 | GLM-4-32B-0414 |

Analyse, recherche et rédaction

Analyse du développement de l’IA dans les villes chinoises : une étude comparative de Pékin et de Hangzhou. Parallèlement, nous étudions des cas de villes étrangères utilisant l’IA pour la gouvernance urbaine.

2. Étapes de l'opération

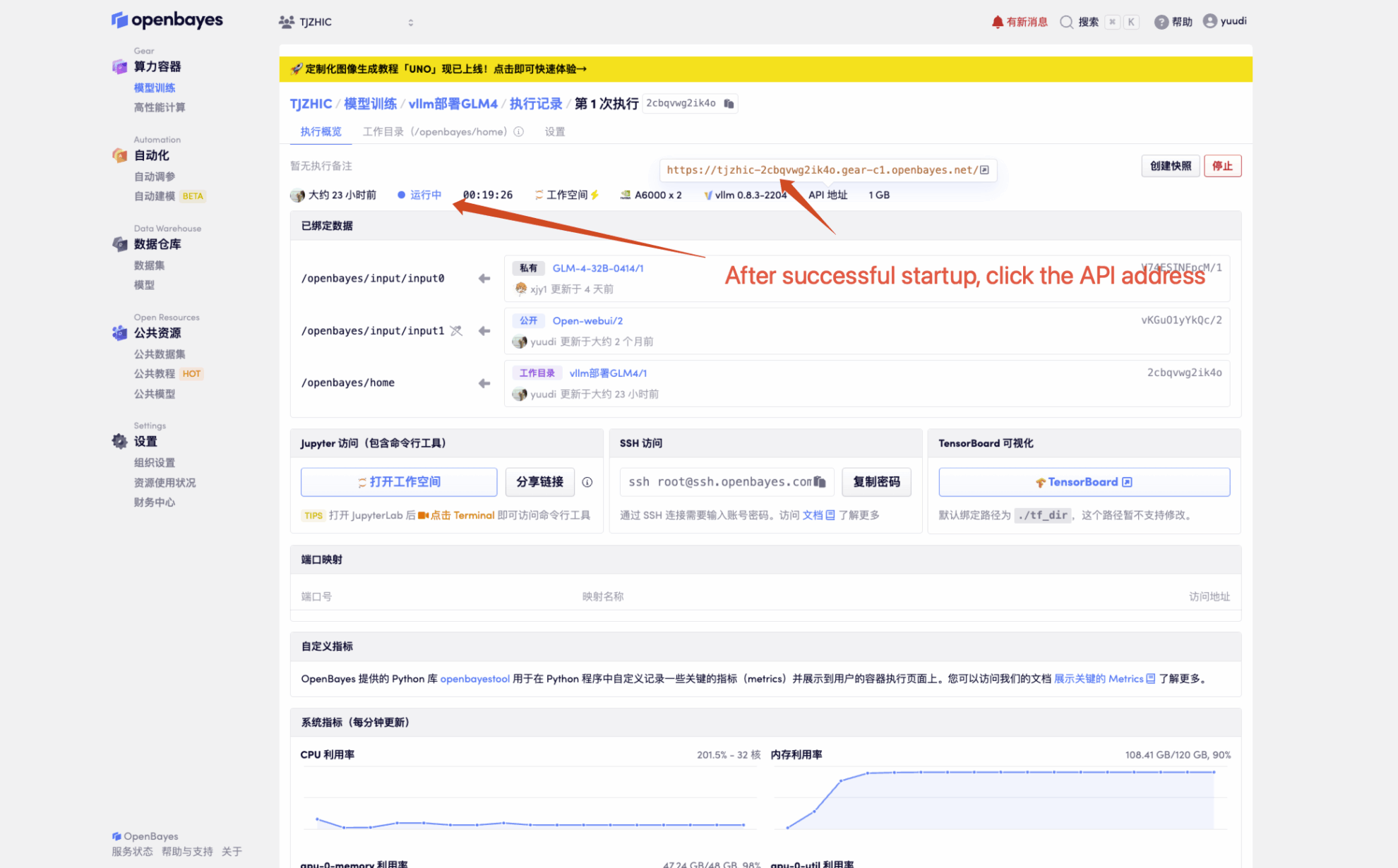

1. Après avoir démarré le conteneur, cliquez sur l'adresse API pour accéder à l'interface Web

Si « Modèle » n'est pas affiché, cela signifie que le modèle est en cours d'initialisation. Étant donné que le modèle est grand, veuillez patienter environ 1 à 2 minutes et actualiser la page.

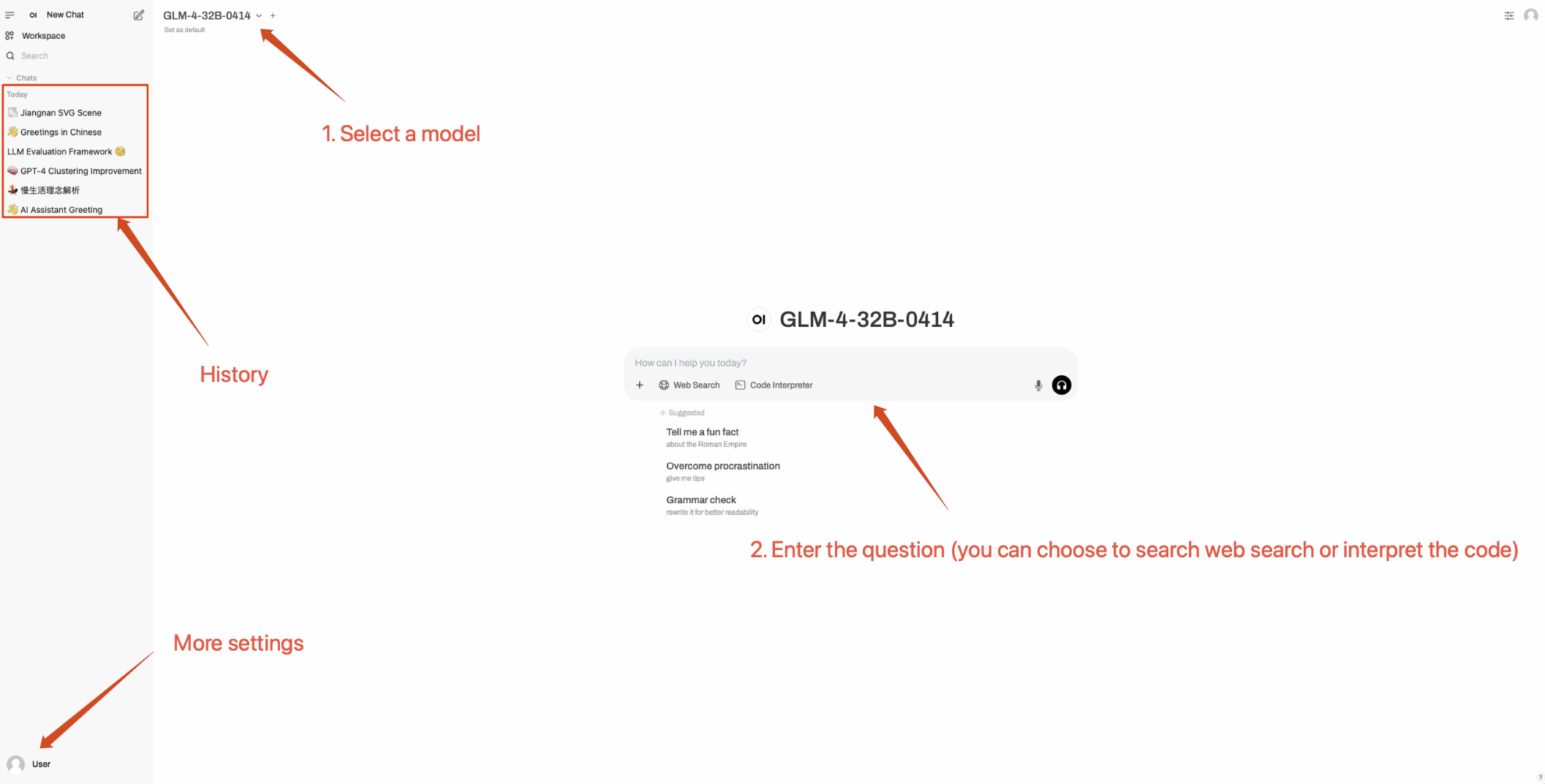

2. Après être entré sur la page Web, vous pouvez démarrer une conversation avec le modèle

Comment utiliser

Échange et discussion

🖌️ Si vous voyez un projet de haute qualité, veuillez laisser un message en arrière-plan pour le recommander ! De plus, nous avons également créé un groupe d’échange de tutoriels. Bienvenue aux amis pour scanner le code QR et commenter [Tutoriel SD] pour rejoindre le groupe pour discuter de divers problèmes techniques et partager les résultats de l'application↓

Informations sur la citation

reconnaissant ZV-Liu Pour le déploiement de ce tutoriel, les informations de référence du projet sont les suivantes :

@misc{glm2024chatglm,

title={ChatGLM: A Family of Large Language Models from GLM-130B to GLM-4 All Tools},

author={Team GLM and Aohan Zeng and Bin Xu and Bowen Wang and Chenhui Zhang and Da Yin and Diego Rojas and Guanyu Feng and Hanlin Zhao and Hanyu Lai and Hao Yu and Hongning Wang and Jiadai Sun and Jiajie Zhang and Jiale Cheng and Jiayi Gui and Jie Tang and Jing Zhang and Juanzi Li and Lei Zhao and Lindong Wu and Lucen Zhong and Mingdao Liu and Minlie Huang and Peng Zhang and Qinkai Zheng and Rui Lu and Shuaiqi Duan and Shudan Zhang and Shulin Cao and Shuxun Yang and Weng Lam Tam and Wenyi Zhao and Xiao Liu and Xiao Xia and Xiaohan Zhang and Xiaotao Gu and Xin Lv and Xinghan Liu and Xinyi Liu and Xinyue Yang and Xixuan Song and Xunkai Zhang and Yifan An and Yifan Xu and Yilin Niu and Yuantao Yang and Yueyan Li and Yushi Bai and Yuxiao Dong and Zehan Qi and Zhaoyu Wang and Zhen Yang and Zhengxiao Du and Zhenyu Hou and Zihan Wang},

year={2024},

eprint={2406.12793},

archivePrefix={arXiv},

primaryClass={id='cs.CL' full_name='Computation and Language' is_active=True alt_name='cmp-lg' in_archive='cs' is_general=False description='Covers natural language processing. Roughly includes material in ACM Subject Class I.2.7. Note that work on artificial languages (programming languages, logics, formal systems) that does not explicitly address natural-language issues broadly construed (natural-language processing, computational linguistics, speech, text retrieval, etc.) is not appropriate for this area.'}

}Créer de l'IA avec l'IA

De l'idée au lancement — accélérez votre développement IA avec le co-codage IA gratuit, un environnement prêt à l'emploi et le meilleur prix pour les GPU.