Command Palette

Search for a command to run...

La Version Animée De « Le Problème À Trois Corps » a Commencé À Être produite. Est-ce qu'il Sortira Vraiment En 2021 ?

Récemment, la bande-annonce officielle de la version animée de « The Three-Body Problem » a été publiée sur Bilibili, annonçant que le film final sortira en 2021. La courte vidéo de 3 minutes a attiré l'attention de millions de personnes. Cette fois, combien de temps faudra-t-il attendre pour voir « Le Problème à trois corps » ?

Cette semaine, le premier PV (vidéo promotionnelle) officiel de la version animée de « Le problème à trois corps » a été publié sur Bilibili. Dès sa sortie, la vidéo a gagné une popularité extrêmement élevée et un grand nombre de clics. À ce jour, cette vidéo a été lue près de 10 millions de fois sur Bilibili.

Le premier PV officiel de l'animation "Three Body"

Le très populaire « Problème à trois corps » a du mal à être adapté en film ou en série télévisée.

Le roman « Le problème à trois corps » a été publié pour la première fois en série dans « Science Fiction World » en 2006. En raison de sa merveilleuse histoire, de ses idées ambitieuses et de son thème grandiose, il est rapidement devenu un chef-d'œuvre de science-fiction recherché par des milliers de personnes.

Depuis lors, la trilogie a été publiée en volumes individuels et s'est bien vendue tant au pays qu'à l'étranger. Même Zuckerberg et Obama l’ont salué. En 2015, il a remporté le prix Hugo, la plus haute distinction dans le monde de la science-fiction, et est devenu l'un des romans chinois les plus influents au monde à l'époque moderne.

Cependant, le chemin vers l'écran pour « Le Problème à trois corps » semble être extrêmement difficile. Le tournage de la version cinématographique de « Le problème à trois corps » a commencé en 2015, mais il n'y a pas encore de nouvelles de sa sortie.

La complexité de l’histoire, les éléments de science-fiction hardcore et les scènes imaginatives extrêmement riches constituent tous d’énormes défis.

À une époque où la version cinématographique ne parvient pas à percer, la transformer en animation pourrait permettre d'éviter de nombreuses limitations. Parce que l’animation elle-même repose sur l’imagination, elle peut être utilisée de manière sauvage et imaginative, et il n’y a pas beaucoup de limites pratiques aux images et aux expressions visuelles.

C'est peut-être pour cette raison que Bilibili a décidé de s'associer à The Three-Body Universe et Yihua Kaitian pour créer conjointement une version animée de « The Three-Body Problem ».

Pourquoi l’animation est-elle si difficile à réaliser ?

Ces dernières années, les meilleures œuvres d’animation ont mis beaucoup de temps à sortir.

Le Roi Singe : Le Héros est de retour, qui a stimulé l'animation nationale.Il a fallu huit ans pour le peaufiner, et a finalement donné une réponse satisfaisante, et a également remporté un box-office de 956 millions.

Nezha : L'enfant du diable entre dans le monde a nécessité cinq ans de production et a impliqué plus de 1 600 personnes., et il a rapporté 4,9 milliards de dollars au box-office, devenant ainsi le deuxième film le plus rentable de l'histoire du cinéma chinois.

L'animation de haute qualité est un projet énorme et un travail difficile : beaucoup de création de personnages, d'animation de storyboard et de production d'effets spéciaux.Une courte vidéo d’un peu plus de dix secondes peut nécessiter les efforts de plusieurs équipes pendant plusieurs mois.

Heureusement, le développement de la technologie de l’IA apporte une certaine aide à la production d’animation. Peut-être que certaines nouvelles technologies d'IA peuvent aider à fournir des méthodes ou des idées plus efficaces pour créer une animation « The Three-Body » plus parfaite.

Technologie noire pour accélérer l'animation : faire bouger les images par elles-mêmes

Pour les animateurs qualifiés, il n’est pas difficile de réaliser une construction de personnage conforme à l’image de la personne, mais les faire bouger comme requis peut nécessiter beaucoup de travail supplémentaire.

Par exemple, dessiner plusieurs plans de mouvement dans une animation 2D ou utiliser la technologie de capture de mouvement dans une animation 3D. Mais désormais, l’IA peut « réveiller » automatiquement les photos et les faire bouger.

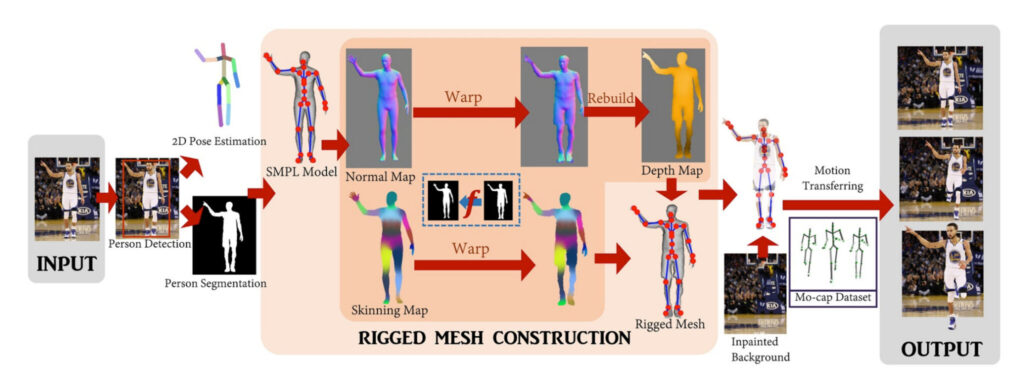

Des chercheurs de l'Université de Washington et de Facebook ont publié il y a quelque temps une étude utilisant l'IA pour transformer des personnages ou des figures d'images statiques ou de peintures en animations 3D.

Cette technologie est un modèle d'apprentissage profond développé sur le framework PyTorch. Le logiciel segmente la personne à partir de l'image, puis superpose un maillage 3D, qui est ensuite animé pour donner vie à la photo ou au tableau.

Effectuez la détection de personnes, l'estimation de poses 2D et la segmentation de personnes sur des images à l'aide d'algorithmes prêts à l'emploi. Ensuite, un modèle SMPL (Skinned Multi-Person Linear Model, un modèle de personnage 3D) est ajusté à une pose 2D et projeté dans l'image sous forme de carte normale et de carte de peau.

Le cœur de cette étape est de trouver la correspondance entre la silhouette de la personne et la silhouette SMPL, de transmettre la carte normale/peau SMPL à la sortie et de construire la carte de profondeur en intégrant la carte normale en mouvement.

Répétez ce processus pour simuler la vue arrière du modèle, en combinant la carte de profondeur et la carte de peau pour créer un maillage 3D entièrement gréé. Le maillage a été texturé et animé à l'aide d'une séquence de capture de mouvement sur un arrière-plan restauré.

En d’autres termes, tant que vous disposez d’une image frontale du corps entier du personnage, vous pouvez utiliser cette technologie pour obtenir une scène en mouvement. Il reconstitue le chemin vers la création d'une image virtuelle à partir d'une seule image, tout en explorant les possibilités techniques de modélisation de personnages à partir d'images.

Technologie noire pour accélérer l'animation : convertir automatiquement le texte en animation

Pour les œuvres adaptées, si vous souhaitez être totalement fidèle à l'œuvre originale et simplifier au maximum l'opération, le moyen le plus idéal peut être d'utiliser du texte pour générer directement l'animation. À ce stade, la technologie de l’IA s’améliore constamment.

En 2018, des chercheurs de l'Université de l'Illinois et de l'Allen Institute for Artificial Intelligence ont développé un modèle d'IA appelé CRAFT (Composition, Retrieval, and Fusion Network) qui peut générer des scènes animées correspondantes à partir d'images des Pierrafeu en fonction de descriptions textuelles (ou de titres).

Le modèle d’IA final a été formé sur plus de 25 000 clips vidéo. Chaque vidéo du film dure 3 secondes et 75 images et est étiquetée et annotée avec les personnages de la scène et le contenu de la scène.

Le modèle d’IA apprend à faire correspondre la vidéo avec la description textuelle et établit un ensemble de paramètres. En fin de compte, la description textuelle fournie peut être convertie en un dérivé créé par les fans de la série animée, comprenant les personnages, les accessoires, les emplacements des scènes, etc. appris à partir de la vidéo.

S’il s’agit simplement d’une simple édition et d’un simple collage, l’IA d’aujourd’hui peut faire bien plus.

En avril de cette année, des scientifiques de Disney et de l'Université Rutgers ont publié un article qui a alimenté le modèle d'IA avec 996 scripts et a finalement appris à l'IA à générer automatiquement des animations basées sur des descriptions textuelles.

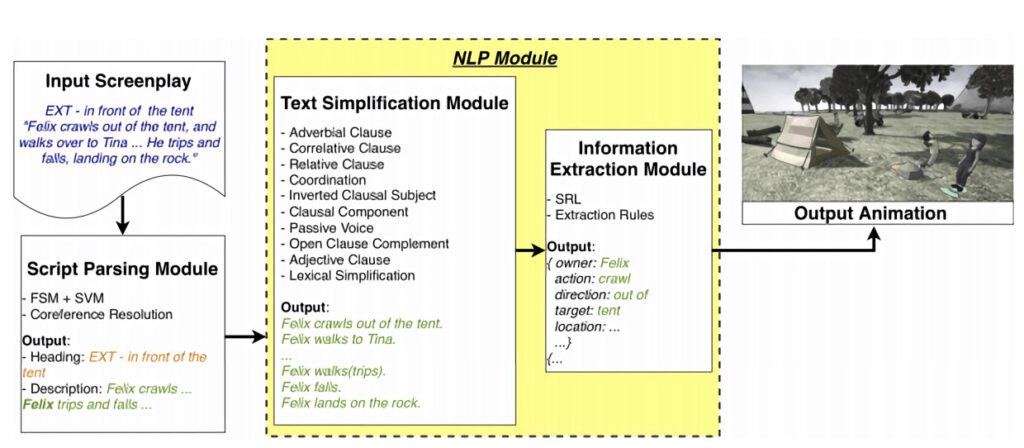

Pour que l’IA puisse générer une vidéo à partir de texte, elle doit « comprendre » le texte, puis générer l’animation correspondante. Pour ce faire, ils ont utilisé un réseau neuronal composé de plusieurs composants modulaires.

Le modèle se compose de trois parties : la première est un module d’analyse de script qui analyse automatiquement les scènes du texte du script ; le deuxième est un module de traitement du langage naturel qui permet d'extraire les principales phrases descriptives et d'affiner la représentation de l'action ; et le dernier est un module de génération qui convertit les instructions d'action en séquences d'animation.

Les chercheurs ont collecté et organisé des descriptions de scènes à partir de scénarios de films disponibles gratuitement et ont compilé un corpus. Il se compose de 525 708 descriptions contenant 1 402 864 phrases, dont 920 817 contiennent au moins une action.

Une fois la correspondance entre le langage de description et la vidéo établie, des clips d'animation simples peuvent être générés en saisissant le script. Dans l'expérience de test, la rationalité de l'animation générée est de 68%.

Si la technologie était plus mature, la déviation d’information qui se produirait pendant le processus d’adaptation n’existerait plus.

2021, animation « Le problème à trois corps » on vous attend

Bien qu'il reste encore un certain chemin à parcourir avant que ces technologies puissent être utilisées dans la production de l'animation « Le problème des trois corps », ces nouvelles idées apporteront de nouvelles idées à la production d'animation.

Du point de vue actuel, tant qu’il y a suffisamment de données et de formation, le jour où les modèles d’IA apprendront à générer des animations ne devrait pas être loin.

De retour à l'animation "Three-Body", avec la solide équipe de production de Three-Body Universe et Yihua Kaitian, ainsi que le solide soutien de Bilibili, de nombreuses puces ont été ajoutées à cette animation.

2021, qu'il pleuve ou qu'il fasse beau, on vous attend !

-- sur--