Command Palette

Search for a command to run...

Ne Retournez Pas À L’école, Les Méthodes Des Enseignants Sont Devenues Plus astucieuses.

Par Super Neuro

Aujourd'hui, c'est la Journée internationale des enseignants. Mes cercles d’amis ont été inondés de bénédictions pour les enseignants. Tout le monde rend hommage aux enseignants et regrette le campus. Mais si vous connaissiez la situation « désespérée » dans laquelle vivent les collégiens d’aujourd’hui, je me demande ce que vous penseriez.

Récemment, le collège n° 11 de Hangzhou a testé le système Smart Eye, qui installe une combinaison de caméras dans la salle de classe pour capturer les expressions et les mouvements des élèves en classe. Grâce à la technologie de reconnaissance faciale, il collecte 6 types de comportements en classe et 7 types d'expressions en classe des élèves.

Le système d'enseignement qui a fait sensation s'appelle le « Smart Classroom Behavior Management System » ou « Smart Eye » en abrégé.

On dit qu'il peut capturer avec précision les étudiantsLisez, levez-vous, levez la main, allongez-vous sur la table, écoutez et écrivezEt 6 autres comportements, combinés aux expressions faciales des élèves à analyserNeutre, heureux, triste, en colère, effrayé, dégoûté et surpris 7 émotions.

Smart Eyes - L'élève qui aime le plus raconter des histoires en classe

Une fois que le système a simplement traité ces informations, il génère une chaîne de codes, tels que A pour écouter attentivement la classe, B pour s'allonger pour dormir et C pour répondre aux questions, et l'utilise pour juger du statut de l'élève. Un bon état, comme écouter attentivement en classe, ajoutera des points, tandis qu'un mauvais état, comme dormir en classe, en déduira des points.

Ces données seront transmises directement aux enseignants après le cours, afin qu'ils puissent comprendre l'effet de classe et les réactions des élèves.

Les enseignants peuvent l’utiliser pour optimiser leurs méthodes d’enseignement, et les écoles peuvent l’utiliser pour juger de la qualité de l’enseignement des enseignants. Cependant, en raison de la présence de caméras, il est inévitable que les étudiants se sentent un peu mal à l’aise, ce qui est compréhensible.

En ce qui concerne les problèmes de confidentialité et de fuite de données qui préoccupent le public, il est dit que les informations générées par ce système ne peuvent être consultées que par les enseignants et les cadres supérieurs de l'école, et que les autres enseignants ou personnes extérieures n'ont pas le droit de les consulter.

(Le cercle rouge ci-dessus est le dispositif de reconnaissance faciale, et le cercle rouge ci-dessous est la caméra qui collecte les informations)

La partie matérielle se compose d'une caméra rotative et d'un dispositif de reconnaissance faciale. Il y en a environ trois dans chaque classe, qui scannent toutes les 30 secondes.

Toutes les caméras sont uniquement utilisées pour collecter des informations comportementales et ne seront pas utilisées à des fins de surveillance ou d'enregistrement. Il n’y aura aucun problème de confidentialité ou de fuite de données.

Le collège n°11 prévoit d'installer ce système dans toutes les salles de classe cette année, qui permettra non seulement de surveiller les émotions des élèves en classe, mais également d'enregistrer leur présence par reconnaissance faciale. Cependant, le système en est encore à ses débuts et a besoin de davantage de données pour apprendre et améliorer la précision de la reconnaissance des émotions.

À l'avenir, ils prévoient de remplacer tous les lecteurs de cartes dans l'école par un scanner facial, créant ainsi le premier campus sans carte du pays. Je me demande si cela a été inspiré par Jack Ma d'Alibaba, le voisin.

La surveillance des classes peut être une bonne chose

L'école secondaire n° 11 de Hangzhou devrait être la première à introduire la haute technologie sur le campus, mais nous espérons également que l'école n'utilisera pas la reconnaissance émotionnelle, qui est utilisée pour améliorer la qualité de l'enseignement, comme outil de surveillance en temps réel. Après tout, même si le campus est un lieu public, chaque étudiant doit néanmoins conserver une certaine intimité personnelle dans certaines limites.

En fin de compte, la raison pour laquelle le système Smart Eye a attiré l’attention et suscité des discussions est que tout le monde a le sentiment que les étudiants sont surveillés. Mais pensez-y dans l’autre sens. Huiyan affirme que les données ne sont ni stockées ni rendues publiques, ce qui est en fait similaire aux yeux d’un enseignant au sens traditionnel du terme.

Par conséquent, la chose la plus importante est le « Contrat d'utilisation ». Ce que l’école devrait clarifier maintenant, c’est l’utilisation et la portée de l’autorisation du contenu vidéo dans Huiyan.

Mise en œuvre technique de la reconnaissance des émotions

Il est devenu une réalité que les machines peuvent reconnaître les émotions humaines, mais la complexité des données de formation massives et de la construction de modèles a découragé de nombreux chercheurs.

Aujourd'hui, cinq grands noms ont mis au point un modèle léger de reconnaissance des émotions qui peut non seulement compléter automatiquement la classification des ensembles d'entraînement, mais également simplifier le processus de création de modèles, réduisant considérablement le seuil de création de modèles de reconnaissance des émotions.

La reconnaissance des émotions est basée sur des technologies telles que la reconnaissance d’images et de visages, et identifie les états émotionnels humains en analysant les comportements physiques des personnes (tels que la reconnaissance des expressions faciales, de la voix et de la posture).

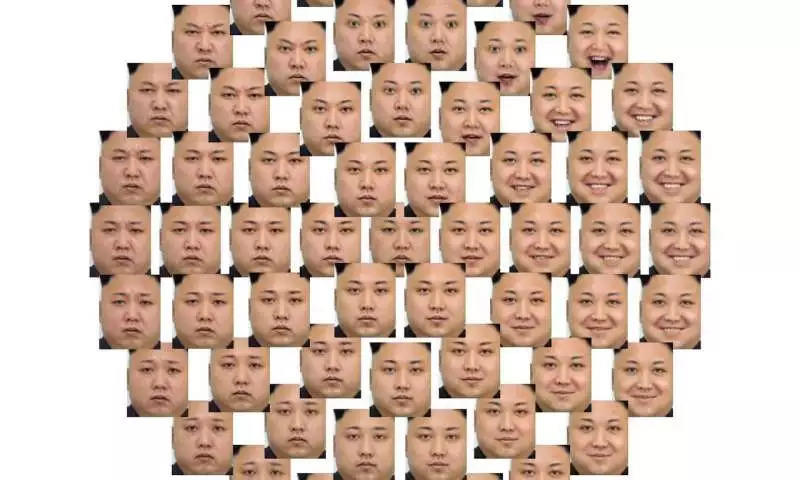

La diversité des émotions faciales humaines

Bien que les réseaux neuronaux pour la reconnaissance des émotions aient été largement utilisés dans des domaines tels que les soins de santé et l'analyse des clients, la plupart des modèles de reconnaissance des émotions ne sont toujours pas en mesure de comprendre en profondeur les émotions humaines, et la construction d'un tel modèle est très coûteuse et difficile à développer.

Modèle léger de reconnaissance des émotions, jetons un œil

Pour résoudre ce problème, cinq ingénieurs d'Orange Labs et de l'Université de Caen Normandie (UNICAEN) en France ont publié conjointement un article « Un regard sur l'apprentissage des émotions audiovisuelles ».

Dans leur article, ils ont proposé un modèle de réseau neuronal profond léger basé sur la reconnaissance des émotions audiovisuelles (c'est-à-dire la reconnaissance des émotions utilisant l'audio et la vidéo). Le modèle est réputé pour être facile à former, capable de classer automatiquement l'ensemble de formation, et doté d'une grande précision, et capable d'atteindre de bonnes performances même avec un petit ensemble de formation.

Le modèle proposé dans cet article suitLe rasoir d'Occamet formés sur la base de l'ensemble de données AFEW. L'audio et la vidéo sont prétraités et leurs caractéristiques analysées simultanément via plusieurs couches de traitement (utilisées pour l'extraction de caractéristiques, l'analyse, etc.), et enfin les deux sont combinés pour produire le résultat de la reconnaissance des émotions.

AFEW signifie « Expressions faciales réalisées dans la nature ». Il s'agit d'une collection de données de reconnaissance d'expression qui fournit des données de test pour la formation du modèle de reconnaissance des émotions et la série EmotiW de défis de reconnaissance des émotions.

Toutes les données proviennent de clips vidéo contenant des expressions faciales éditées à partir de films et de séries télévisées, y compris les six expressions de base que sont « le bonheur, la surprise, le dégoût, la colère, la peur et la tristesse », ainsi que des expressions neutres.

Afin de permettre au modèle de mieux reconnaître les données d'entraînement dans AFEW, les cinq membres du personnel de R&D ont également apporté quelques innovations au modèle :

1) Réduisez les dimensions des fonctionnalités et simplifiez les processus d’analyse des modèles grâce à l’apprentissage par transfert et à l’intégration spatiale à faible dimension ;

2) Échantillonnage par notation de chaque image pour réduire la taille de l'ensemble d'apprentissage ;

3) Utilisez un mécanisme simple de sélection d’images pour pondérer la séquence d’images ;

4) Différentes formes de fusion de fonctionnalités sont effectuées dans l'étape de prédiction, c'est-à-dire que la vidéo et l'audio sont traités séparément puis fusionnés.

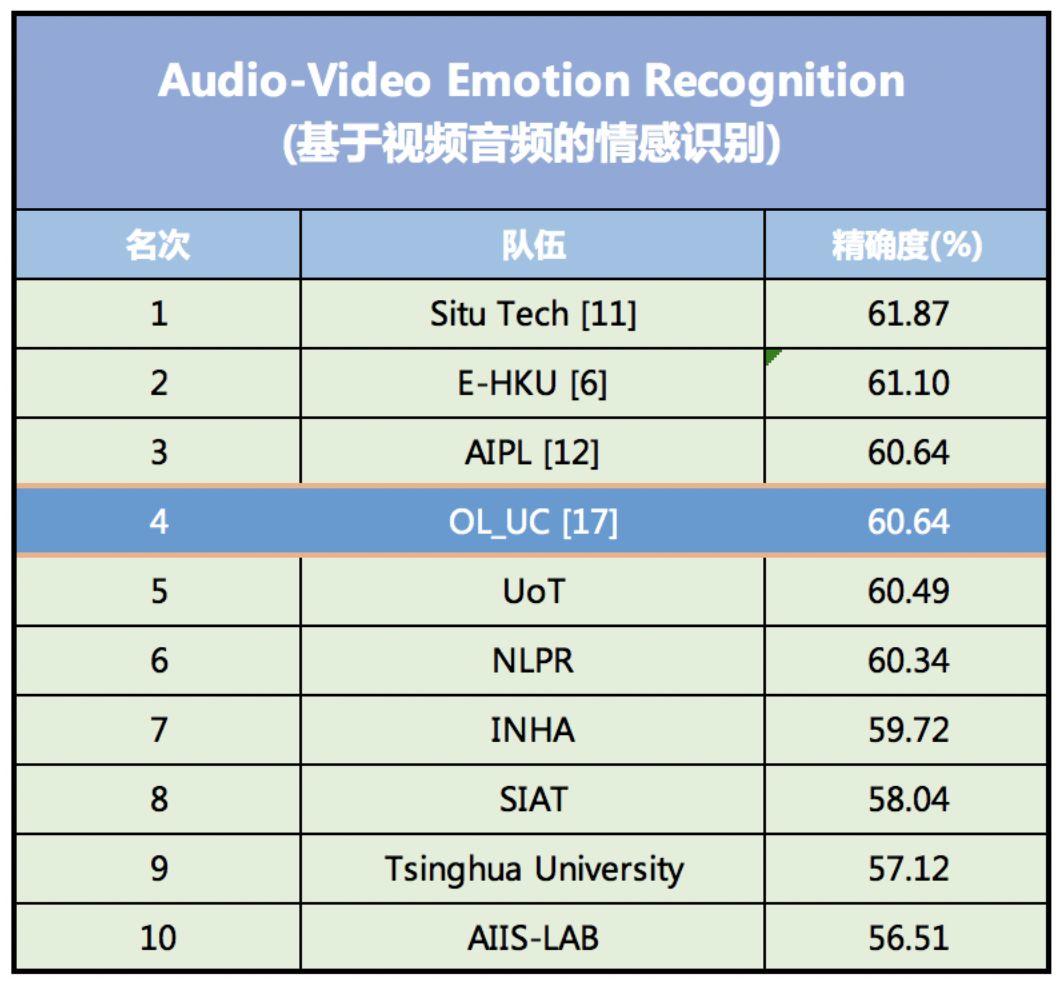

Cette série d’innovations réduit considérablement le nombre de paramètres qui caractérisent les caractéristiques de l’ensemble de données, simplifie le processus de formation du modèle et améliore la précision de la reconnaissance des émotions. Lors du concours de reconnaissance des émotions EmotiW (Emotion Recognition In The Wild Challenge) de 2018, le modèle a atteint une précision de reconnaissance de 60,64 %, se classant quatrième.

Le modèle s'est classé quatrième dans le classement de précision du modèle de reconnaissance des émotions audiovisuelles EmotiW 2018.

Le modèle de reconnaissance des émotions le mieux classé a été développé par SEEK TRUTH, une société nationale de technologie financière d'IA, avec un taux de précision de 61.87%. Le deuxième modèle classé a été développé par DeepAI, une startup d'IA en Californie, aux États-Unis, avec un taux de précision de 61.10%.

Le modèle peut ajouter automatiquement des étiquettes à l'ensemble d'apprentissage

Comparé à d’autres modèles de reconnaissance des émotions, le plus grand avantage de ce modèle est qu’il est facile à construire et à former. Cela peut permettre aux ordinateurs de percevoir plus facilement les micro-expressions humaines, y compris le langage corporel.

À l’heure actuelle, la plupart des modèles de reconnaissance des émotions sont formés à partir des expressions faciales des personnages de films et de séries télévisées. Premièrement, le coût d’acquisition est faible et deuxièmement, les expressions sont riches.

Cependant, lorsque ces données sont introduites dans l’ensemble d’entraînement, elles ne sont pas classées (c’est-à-dire que des étiquettes d’émotion sont ajoutées à chaque vidéo). Par conséquent, avant la formation, ils doivent être classés manuellement ou par d'autres méthodes, ce qui est difficile à mettre en œuvre et peut facilement conduire à une distorsion de l'ensemble de formation.

Le modèle de reconnaissance des émotions audiovisuelles développé par Frédéric Jurie et d'autres peut classer automatiquement les expressions dans l'ensemble d'entraînement via un réseau neuronal profond à utiliser par le modèle.

De cette manière, la difficulté de formation du modèle est réduite tandis que la précision de la reconnaissance est améliorée.

Ce modèle prouve également que les modèles de réseaux neuronaux légers peuvent obtenir de bons résultats et sont plus faciles à former, contrairement aux modèles de réseaux neuronaux de plus en plus complexes d’aujourd’hui.

À l’avenir, ils étudieront plus en détail comment mieux intégrer les données dans des formats non vidéo et reconnaître les données avec moins de classifications, voire aucune.