Command Palette

Search for a command to run...

Tutoriel En Ligne | Le Premier Modèle Audio Open Source De Mistral AI. Les Versions Voxtral, 24B Et 3B Prennent En Compte La Compréhension Approfondie De La Parole multi-scénarios.

Mode d'interaction le plus naturel pour les humains, la voix devient progressivement le scénario central de l'interaction homme-machine. Avec la popularisation de l'interaction vocale, les modèles audio sont également en constante innovation et optimisation pour répondre à la demande.Cependant, ce développement rapide s'accompagne d'une polarisation de l'offre sur le marché : les modèles open source à faible coût sont plus sujets à des problèmes tels que des taux d'erreur élevés et une faible compréhension sémantique, tandis que les modèles à code source fermé coûteux sont généralement coûteux et présentent des limitations de déploiement. Dans les deux cas, il est difficile de répondre à des besoins divers.

Sur cette base,Mistral AI a récemment officiellement lancé son premier modèle audio avancé, Voxtral, qui se concentre sur les points faibles du marché de l'intelligence vocale avec des performances open source élevées et un faible coût.Le modèle est disponible en deux versions : 24B et 3B. La première est adaptée aux déploiements à grande échelle en entreprise, tandis que la seconde abaisse le seuil d'entrée pour un déploiement individuel léger. En termes de fonctionnalités, grâce à une excellente transcription vocale et à des capacités de compréhension approfondie, Voxtral prend en charge plusieurs langues, le traitement contextuel des textes longs, des fonctions intégrées de questions-réponses et de résumé. Ses performances surpassent celles des modèles audio open source existants dans de nombreux benchmarks. Parallèlement, son coût est plus faible et sa large utilisation dans divers scénarios contribue à populariser l'interaction vocale.

Voxtral utilise la technologie pour promouvoir le changement qualitatif des modèles d'interaction vocale de « utilisable » à « facile à utiliser ».Il répond non seulement à la demande du marché en modèles audio hautes performances, mais élargit également les scénarios d'application de l'interaction vocale, construisant véritablement la pierre angulaire écologique intelligente du dialogue naturel.

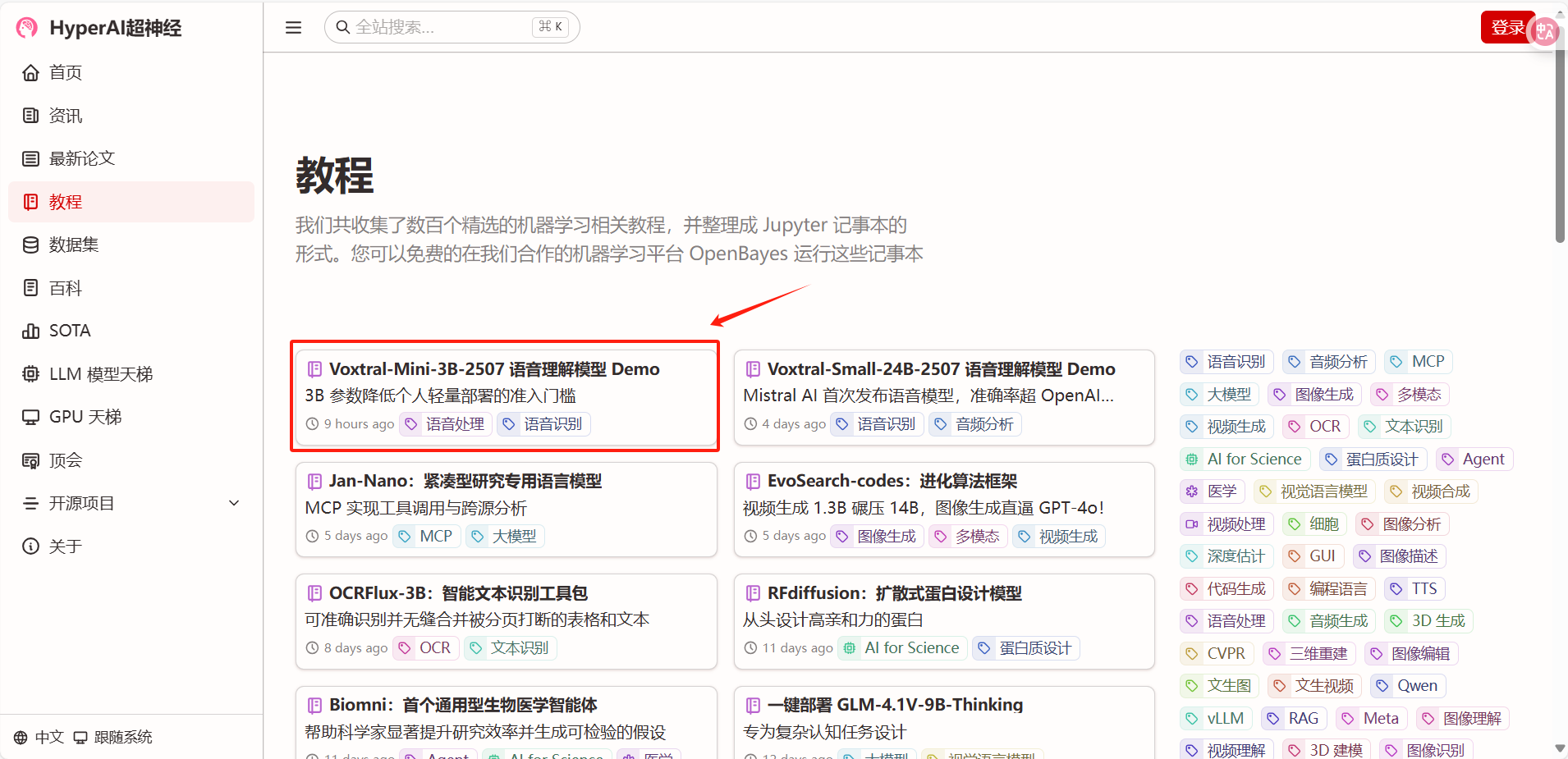

« Démo du modèle de compréhension de la parole Voxtral-Small-3B/24B-2507 »La section « Tutoriel » du site officiel d'HyperAI (hyper.ai) est désormais en ligne.Commençons une expérience immersive d’interaction vocale où nous pourrons « entendre plus précisément et comprendre plus profondément » et assister à de nouvelles avancées dans les modèles audio avancés !

Lien du tutoriel :

* Démo du modèle de compréhension de la parole Voxtral-Mini-3B-2507 :

* Démonstration du modèle de compréhension de la parole Voxtral-Small-24B-2507 :

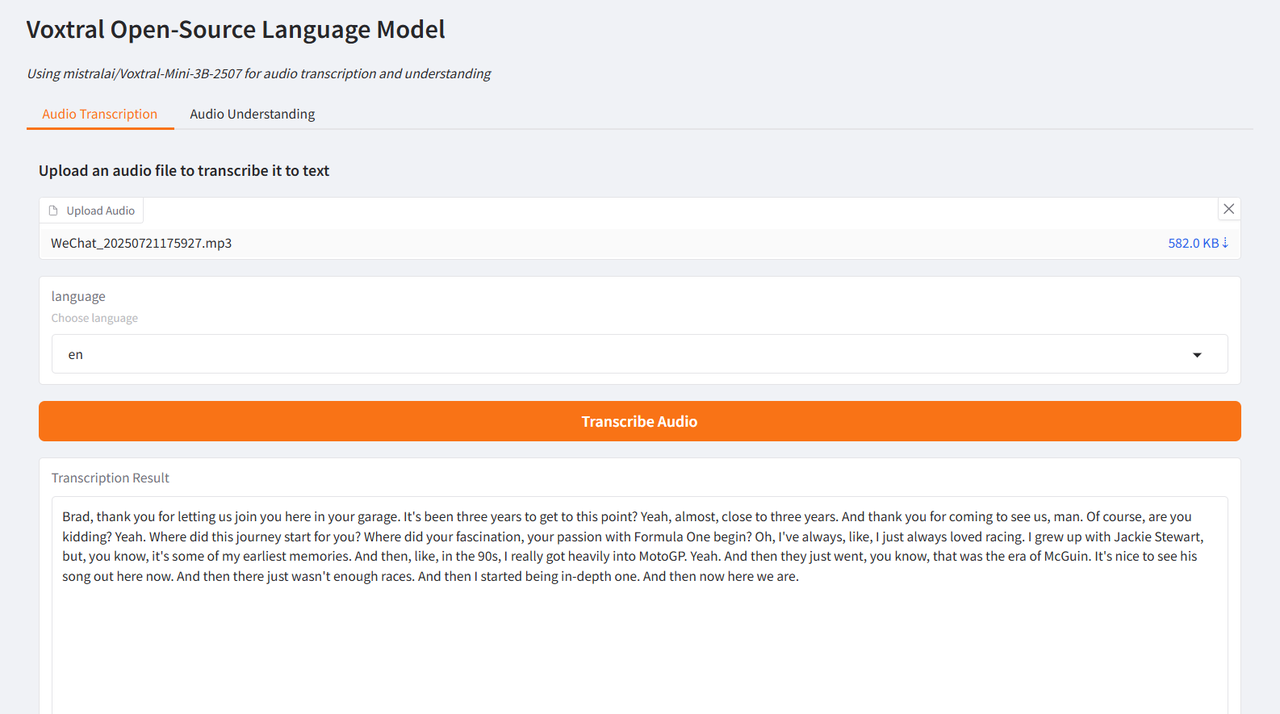

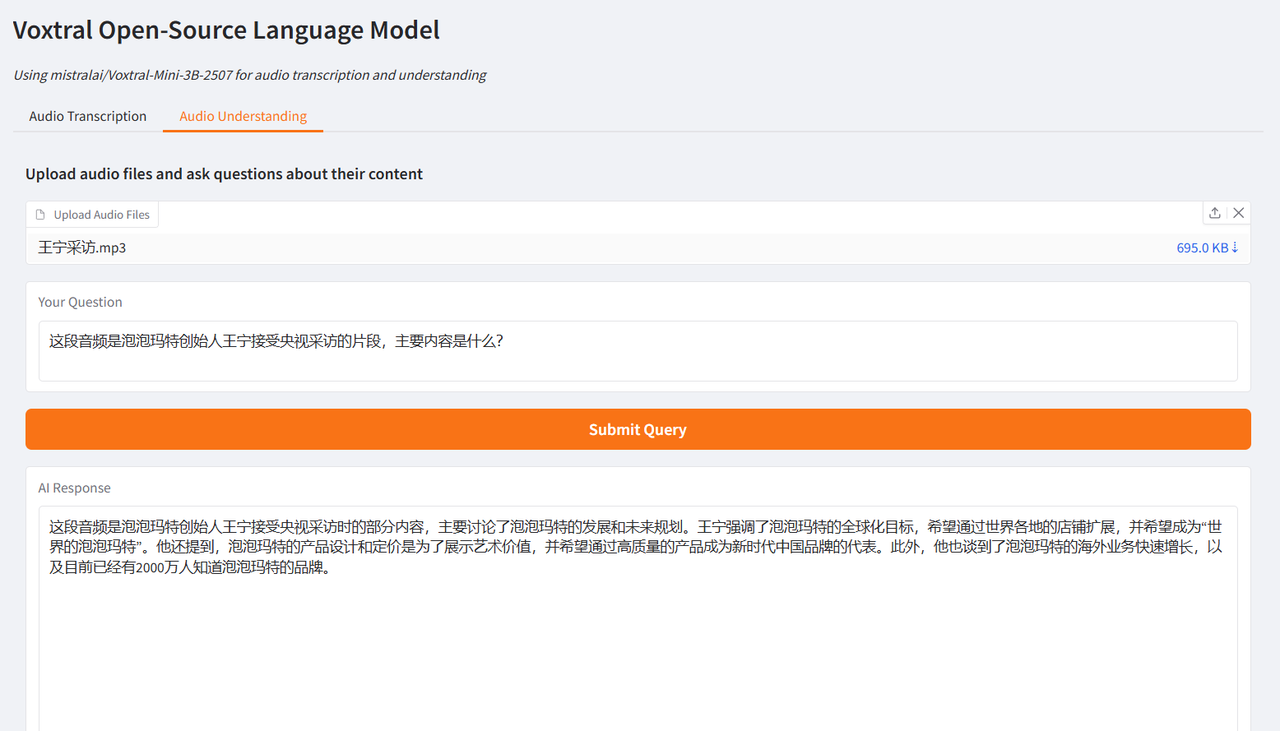

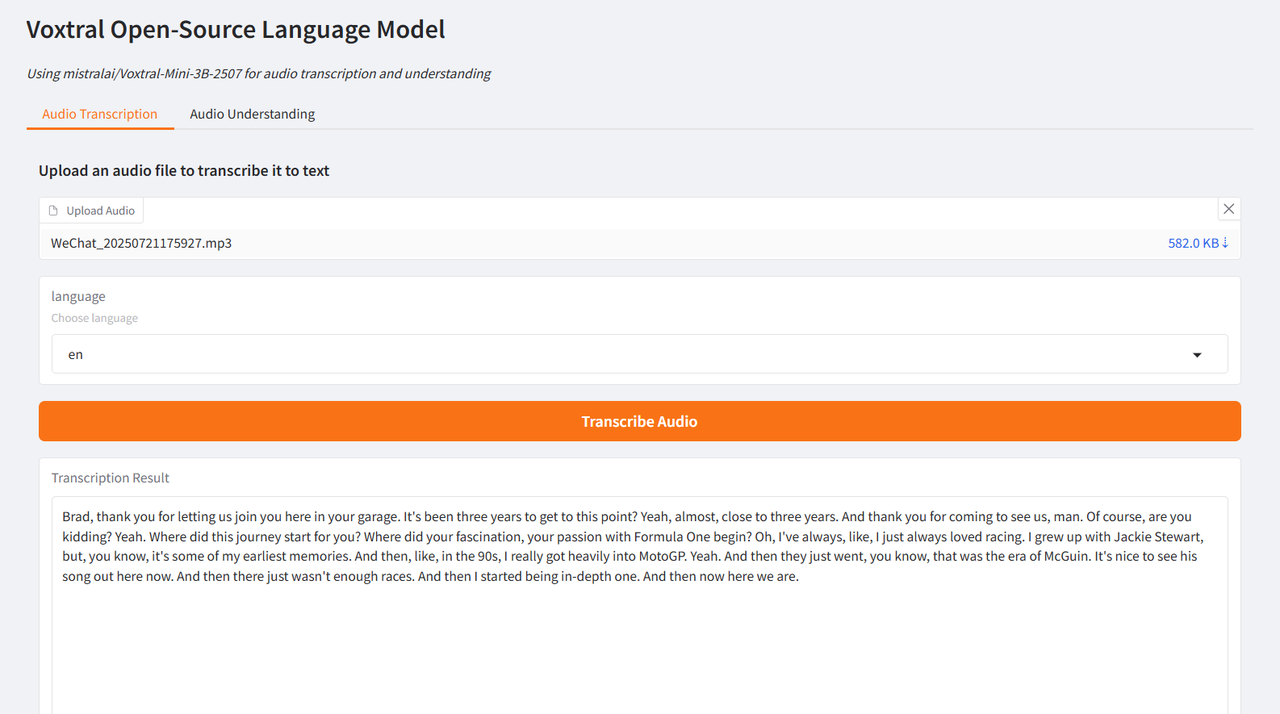

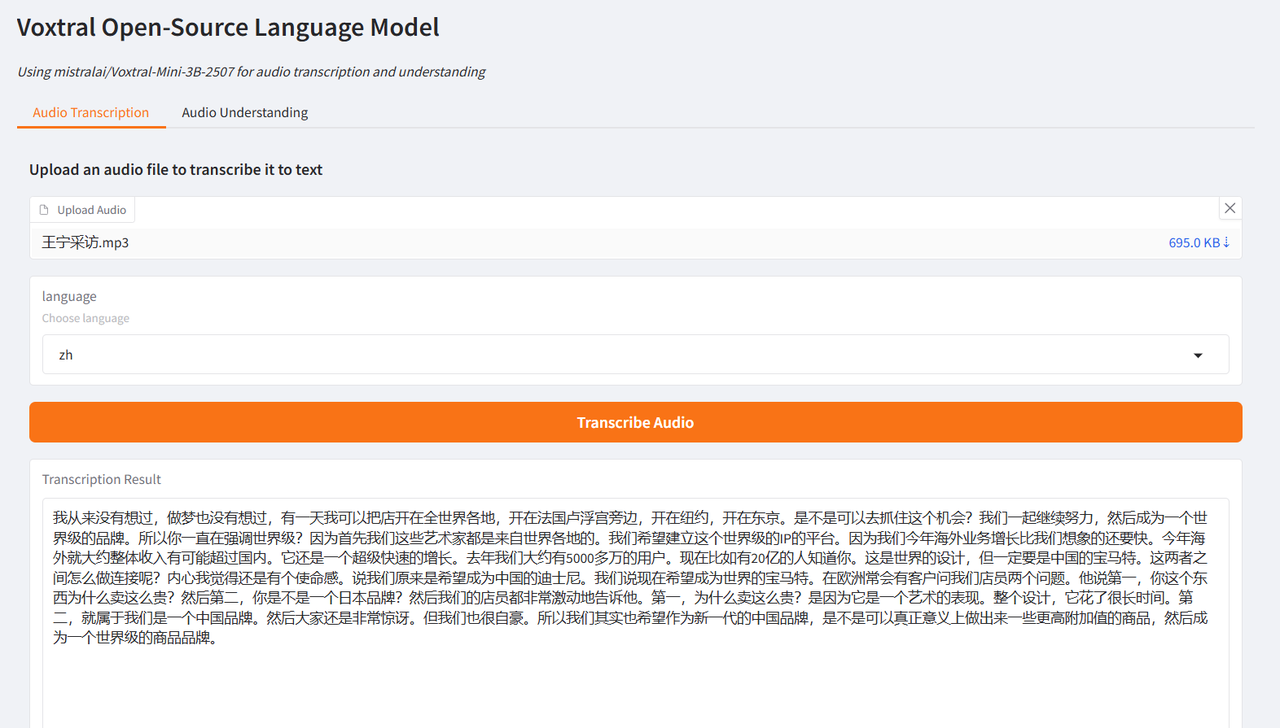

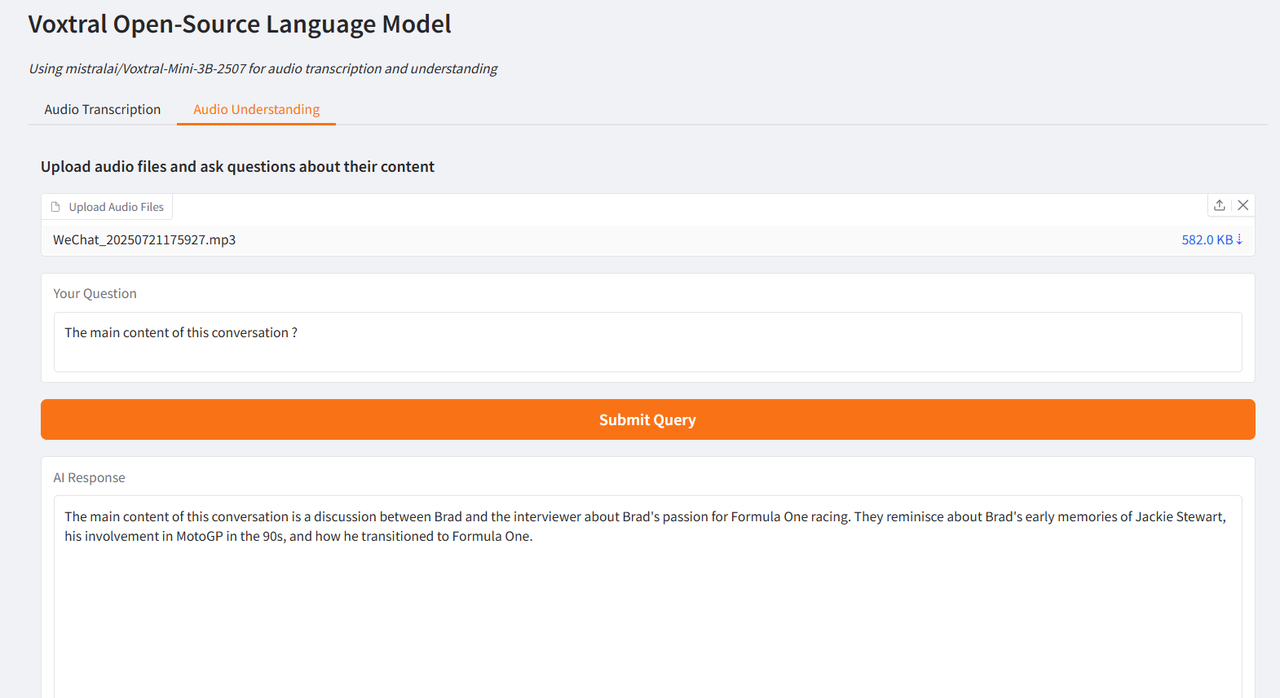

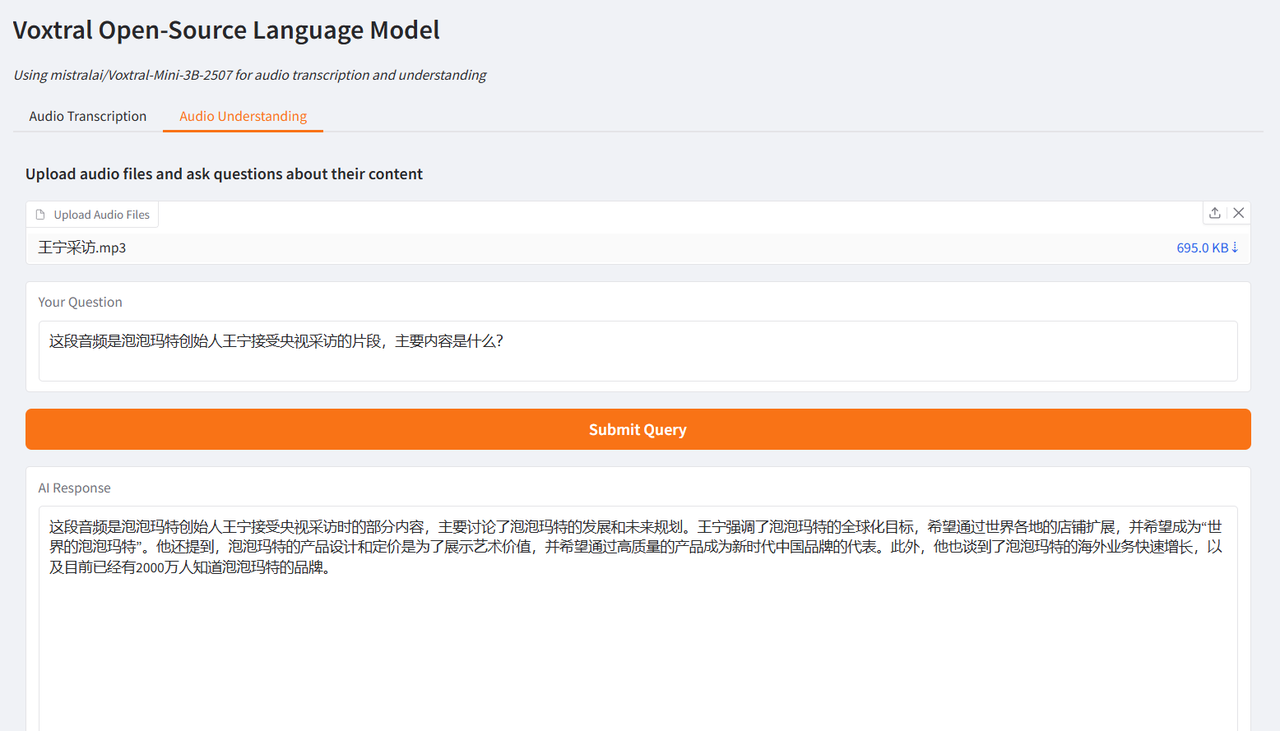

L'auteur a testé le produit à l'aide d'extraits d'interviews de Brad Pitt, l'acteur principal de « F1 : Wild Race », et de Wang Ning, le fondateur de Pop Mart, interviewés par CCTV. Les résultats obtenus étaient excellents, confirmant les puissantes fonctionnalités de Voxtral.

Essai de démonstration

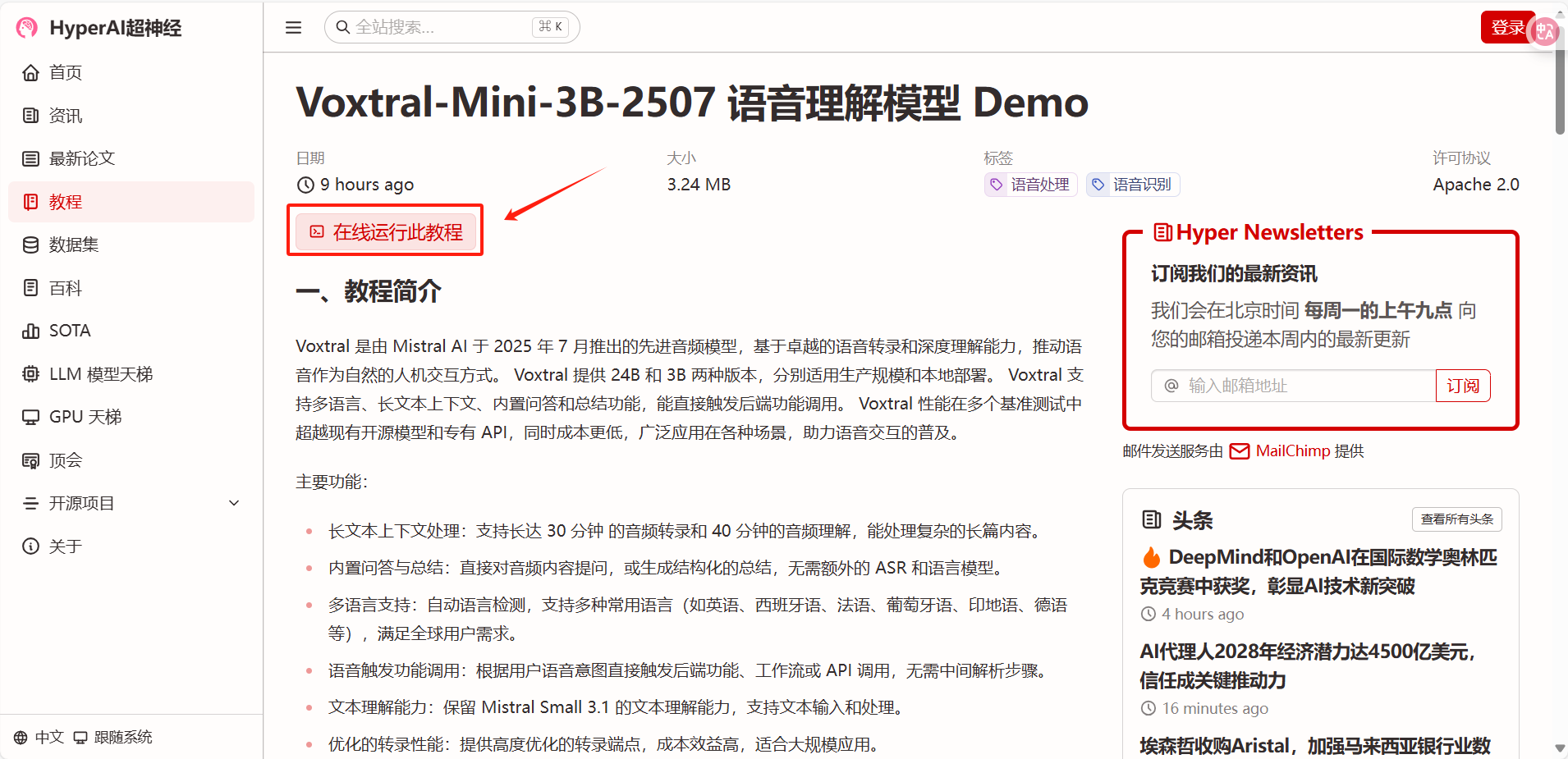

1. Après avoir accédé à la page d'accueil de hyper.ai, sélectionnez la page « Tutoriel », sélectionnez « Voxtral-Mini-3B-2507 Speech Understanding Model Demo » et cliquez sur « Exécuter ce tutoriel en ligne ».

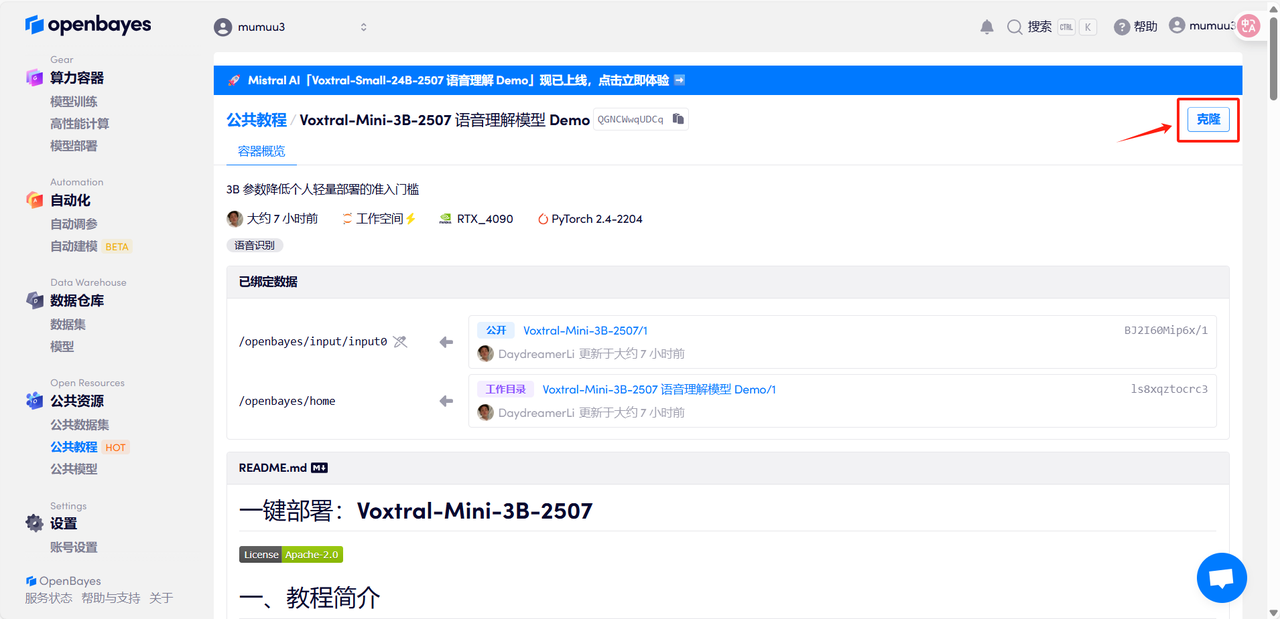

2. Une fois la page affichée, cliquez sur « Cloner » dans le coin supérieur droit pour cloner le didacticiel dans votre propre conteneur.

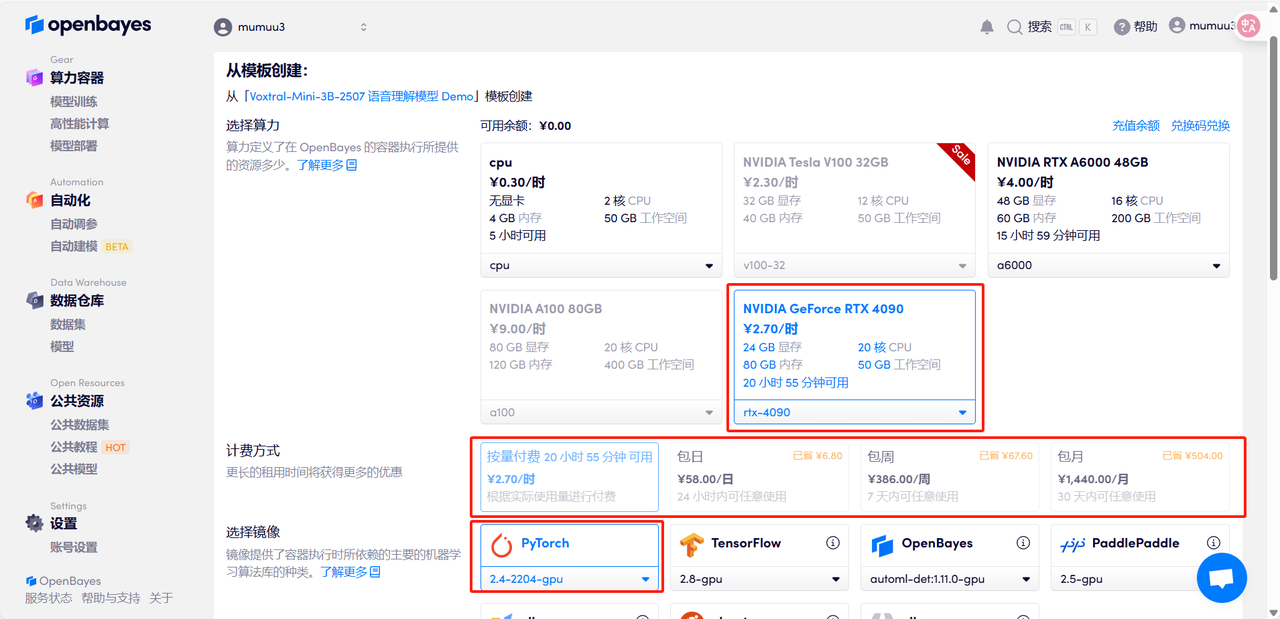

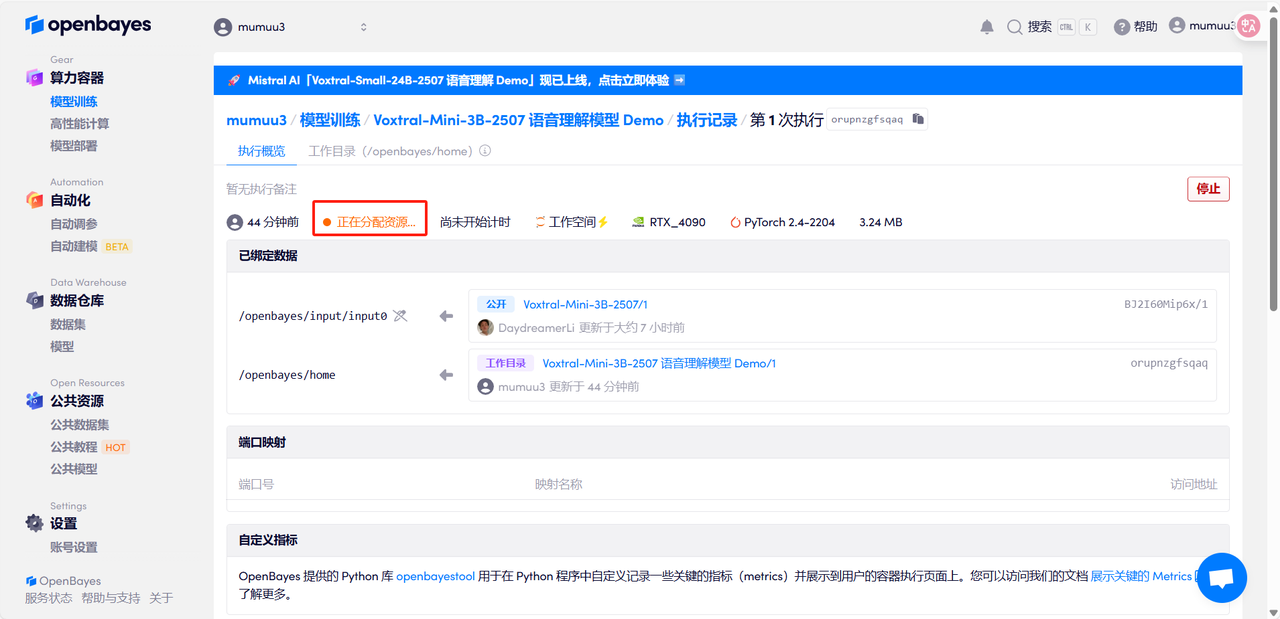

3. Sélectionnez les images « NVIDIA GeForce RTX 4090 » et « PyTorch », puis choisissez « Paiement à l'utilisation » ou « Forfait journalier/hebdomadaire/mensuel » selon vos besoins, puis cliquez sur « Continuer ». Les nouveaux utilisateurs peuvent s'inscrire via le lien d'invitation ci-dessous pour obtenir 4 heures de RTX 4090 et 5 heures de temps processeur gratuit !

Lien d'invitation exclusif HyperAI (copier et ouvrir dans le navigateur) :

https://openbayes.com/console/signup?r=Ada0322_NR0n

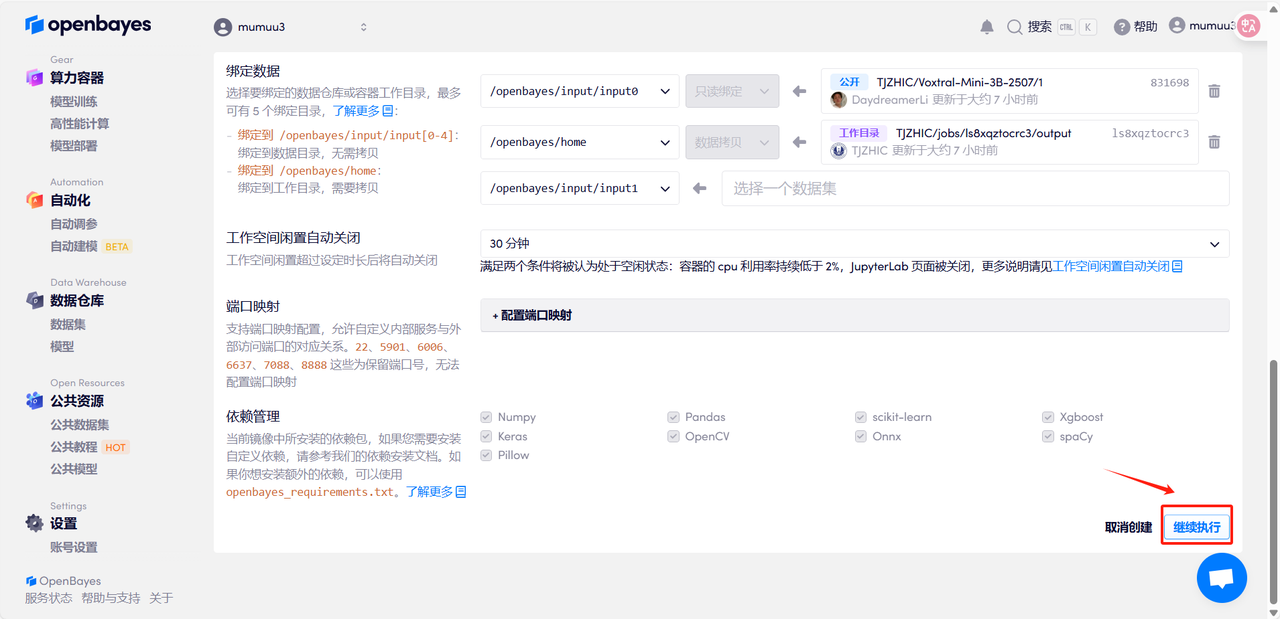

4. Attendez que les ressources soient allouées. Le premier clonage prendra environ 3 minutes. Lorsque le statut passe à « En cours d'exécution », cliquez sur la flèche de saut à côté de « Adresse API » pour accéder à la page de démonstration. Veuillez noter que les utilisateurs doivent s'authentifier par nom réel avant d'utiliser la fonction d'accès à l'adresse API.

Démonstration d'effet

L'auteur a testé le produit à l'aide d'extraits d'interviews de Brad Pitt, l'acteur principal de « F1 : Wild Race », et de Wang Ning, le fondateur de Pop Mart, interviewés par CCTV. Les résultats obtenus étaient excellents, confirmant les puissantes fonctionnalités de Voxtral.

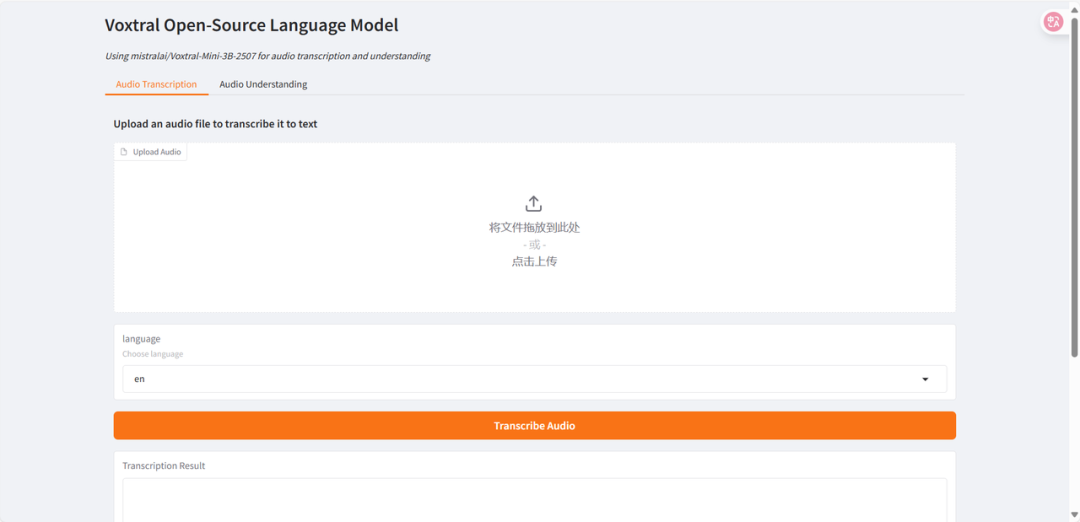

Sélectionnez la fonction de test « Transcription audio », importez un extrait audio, sélectionnez la langue et cliquez sur « Transcrire l'audio ». Le résultat sera généré au bout d'un moment.

Sélectionnez la fonction de test « Compréhension audio », téléchargez un clip audio, saisissez la question, cliquez sur « Soumettre la requête » et les résultats seront générés après un certain temps.

De plus, la version 24B fournie par Voxtral est adaptée aux déploiements à grande échelle en entreprise. Elle est désormais disponible dans la section « Tutoriel » du site officiel d'HyperAI (hyper.ai) et les utilisateurs peuvent l'essayer selon leurs besoins !

Lien du tutoriel :

* Démo du modèle de compréhension de la parole Voxtral-Mini-3B-2507 :

* Démonstration du modèle de compréhension de la parole Voxtral-Small-24B-2507 :