Command Palette

Search for a command to run...

Tutoriel En Ligne | Voici Le CSM, Écartez-vous ! Génération De Discours Plus Vivant, Fini Les Discours Retardés, Ternes Et Mécaniques

Lorsque je discute avec l'assistant vocal IA, j'ai toujours l'impression que quelque chose ne va pas. Ils répondaient facilement aux questions, mais il leur manquait un peu « d’humanité ». Le ton de la voix est terne, les pauses sont brusques et elle se fige parfois à des endroits inexplicables. Ce sentiment inhumain et inhumain est en réalité l’effet « vallée de l’étrange » à l’œuvre. Lorsque la voix de l’IA est très similaire à la voix humaine mais pas parfaitement cohérente, les utilisateurs se sentiront mal à l’aise.

Récemment, le modèle de génération de parole CSM (Conversational Speech Model) lancé par l'équipe Sesame s'est distingué parmi de nombreux modèles de parole.Le modèle utilise l'architecture dorsale Llama et un décodeur audio léger, combiné à un framework Transformer de bout en bout, pour générer des codes audio RVQ basés sur des entrées de texte et d'audio, puis produire un discours fluide, naturel et émotionnel.Créez un assistant vocal capable de répondre aux besoins émotionnels des utilisateurs.

Comparé aux modèles traditionnels de génération de parole par IA, CSM fait bien plus que simplement générer de l'audio :

*Une meilleure compréhension émotionnelle :Capable d'analyser en profondeur le contexte et d'ajuster avec souplesse le ton et l'intonation.

*Rythme de conversation plus naturel :Ajustez les détails tels que les pauses, l’accentuation, les interruptions, etc. pour rendre les conversations plus fluides.

*Expérience presque sans délai :L'architecture d'inférence efficace rapproche la génération de la parole du temps réel et améliore l'efficacité de l'interaction.

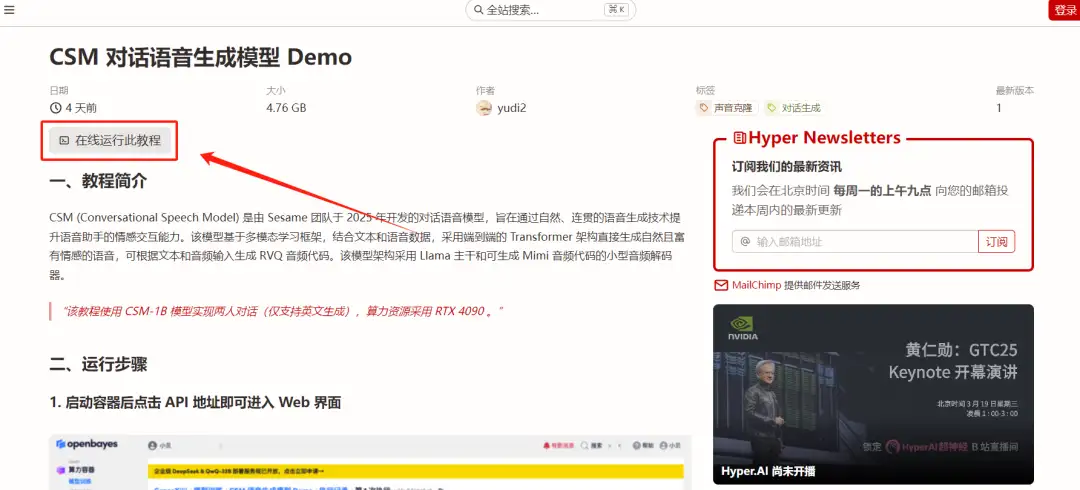

Le didacticiel « CSM Conversational Speech Generation Model Demo » est désormais disponible sur le site officiel d'HyperAI. Venez le découvrir !

Adresse du tutoriel :

Essai de démonstration

1. Connectez-vous à hyper.ai, accédez à la page Tutoriels, sélectionnez Démo du modèle de génération de discours conversationnel CSM et cliquez sur Exécuter ce tutoriel en ligne.

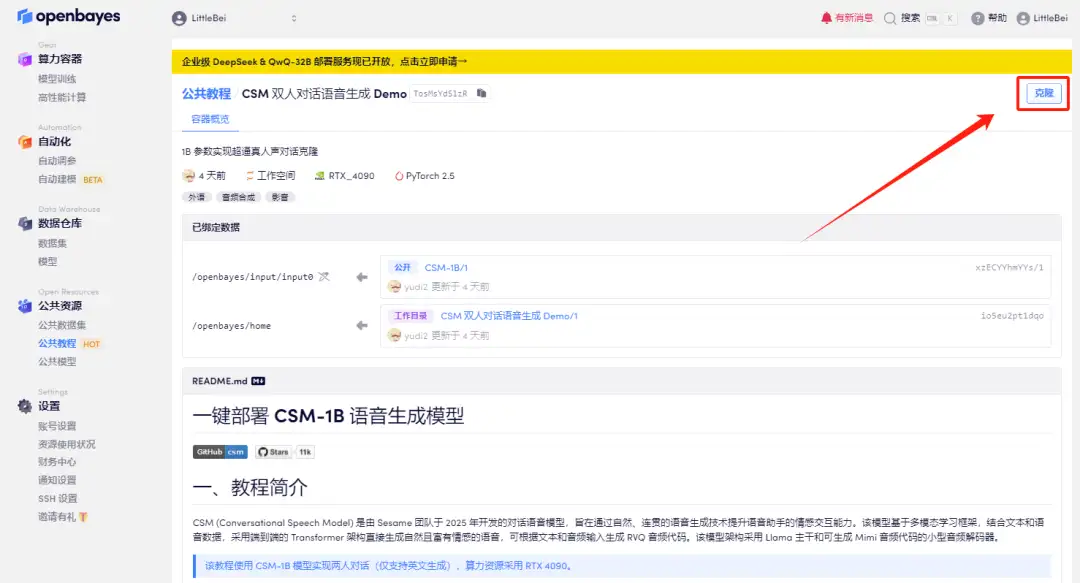

2. Une fois la page affichée, cliquez sur « Cloner » dans le coin supérieur droit pour cloner le didacticiel dans votre propre conteneur.

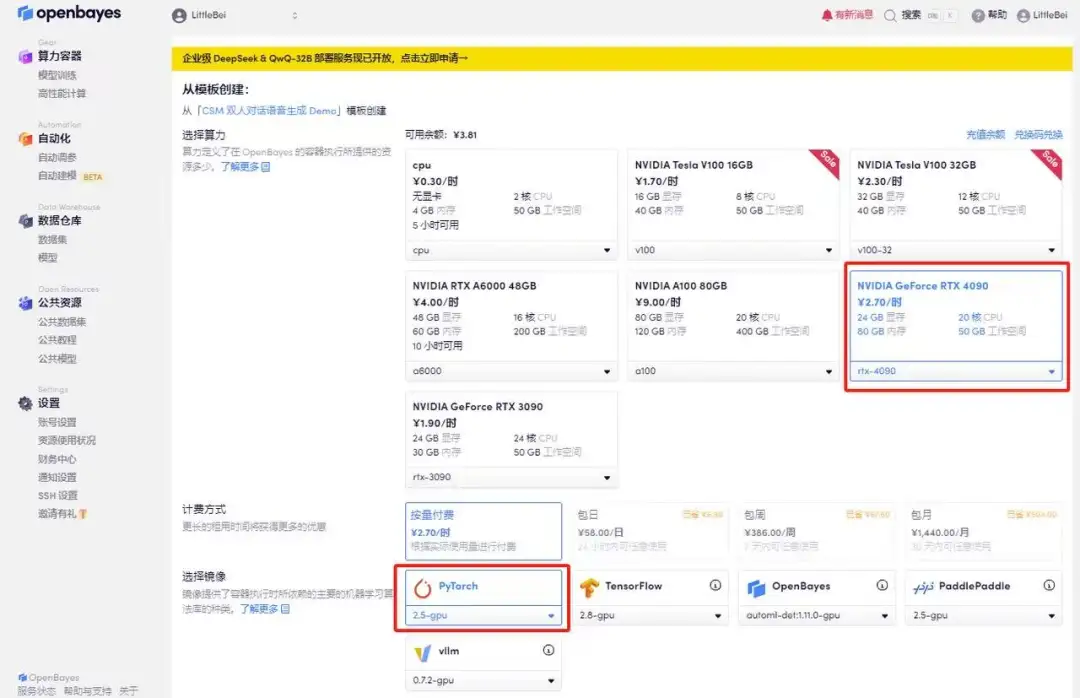

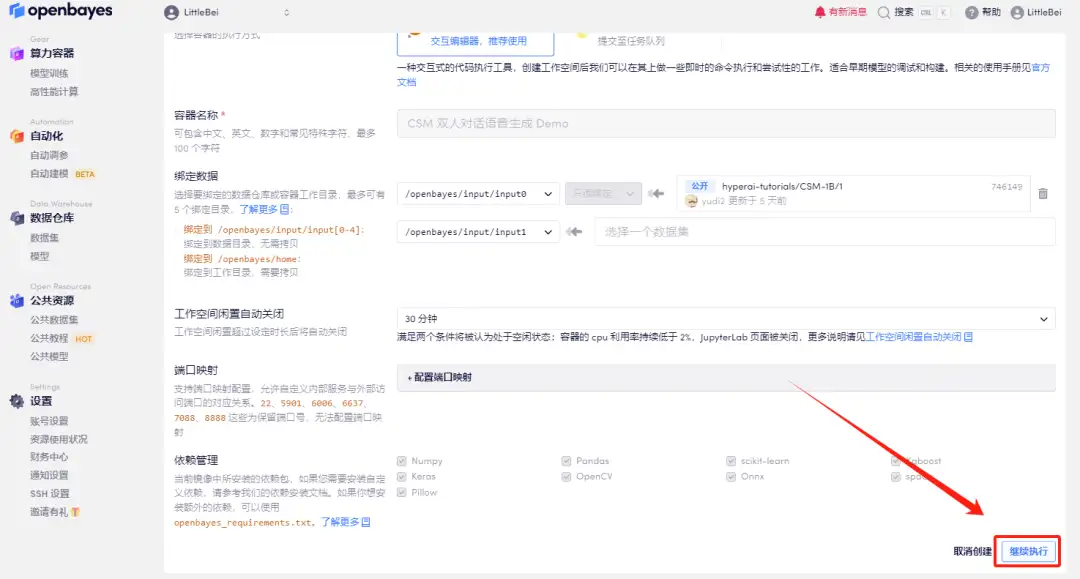

3. Sélectionnez les images « NVIDIA RTX 4090 » et « PyTorch ». La plateforme OpenBayes a lancé une nouvelle méthode de facturation. Vous pouvez choisir « Payer au fur et à mesure » ou « Forfait journalier/hebdomadaire/mensuel » selon vos besoins. Cliquez sur « Continuer ». Les nouveaux utilisateurs peuvent s'inscrire en utilisant le lien d'invitation ci-dessous pour obtenir 4 heures de RTX 4090 + 5 heures de temps CPU gratuit !

Lien d'invitation exclusif HyperAI (copier et ouvrir dans le navigateur) :

https://go.openbayes.com/9S6Dr

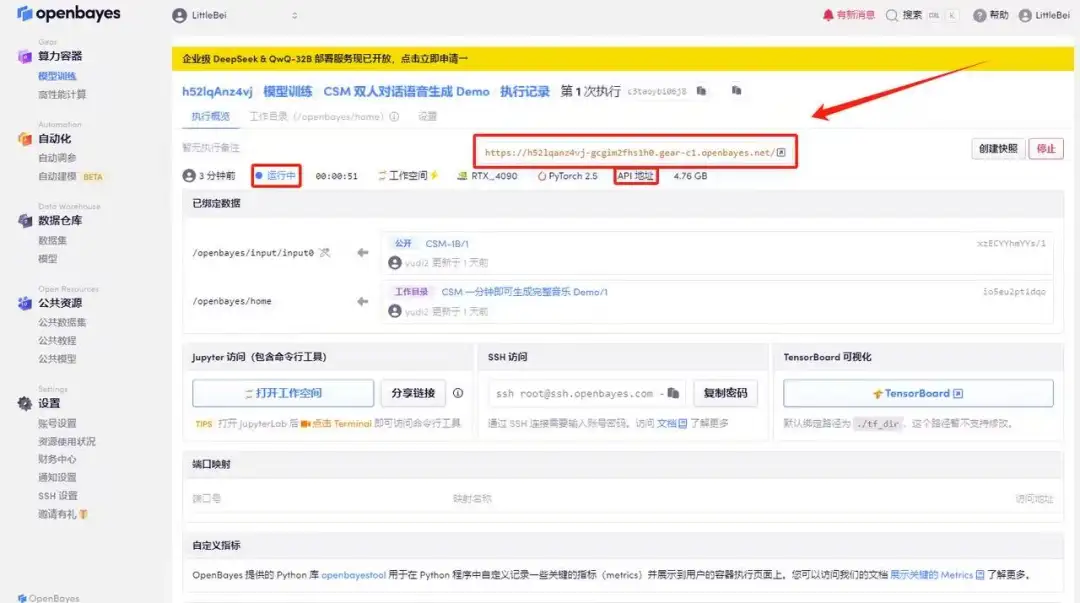

4. Attendez que les ressources soient allouées. Le premier processus de clonage prend environ 2 minutes. Lorsque le statut passe à « En cours d'exécution », cliquez sur la flèche de saut à côté de « Adresse API » pour accéder à la page de démonstration. Étant donné que le modèle est volumineux, il faut environ 3 minutes pour afficher l'interface WebUI, sinon « Bad Gateway » s'affichera. Veuillez noter que les utilisateurs doivent effectuer l'authentification par nom réel avant d'utiliser la fonction d'accès à l'adresse API.

Affichage des effets

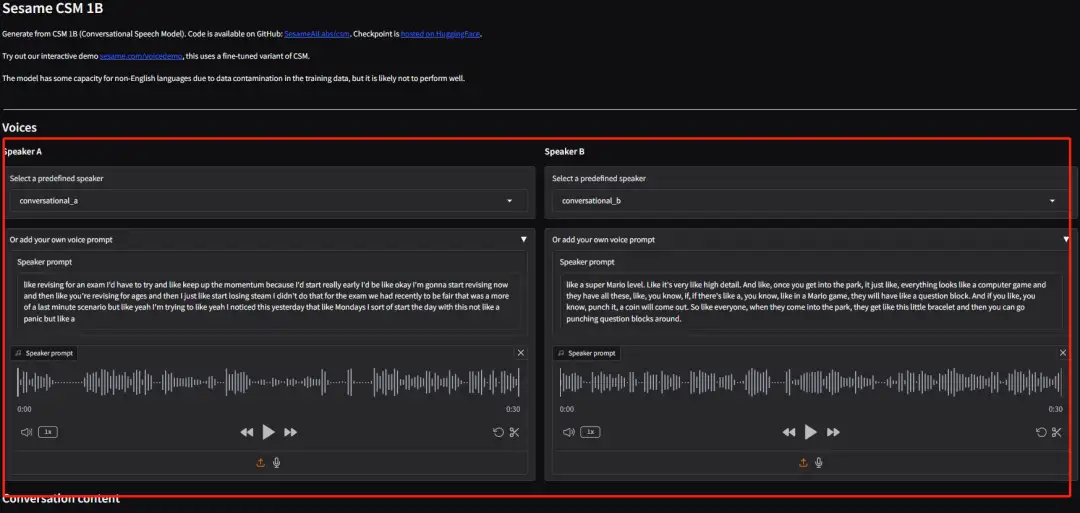

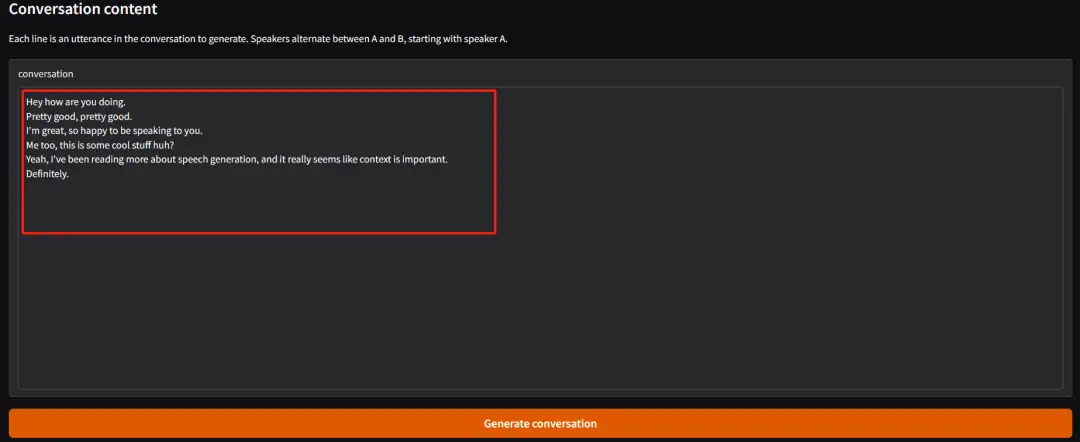

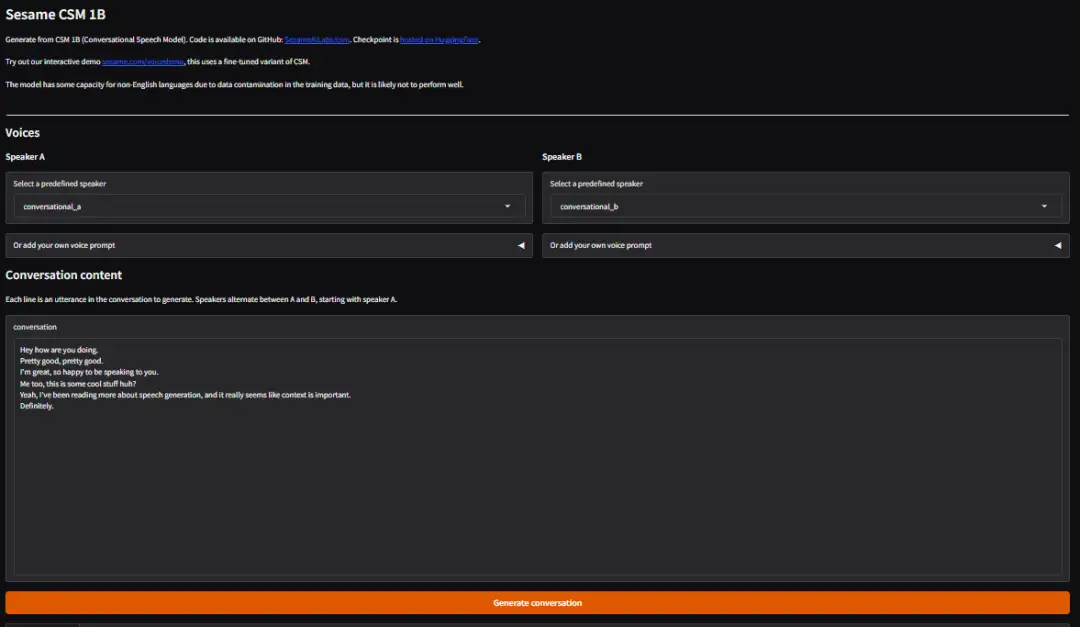

Sélectionnez ou téléchargez un fichier audio personnel, saisissez le contenu de la conversation et cliquez sur « Générer la conversation » pour générer la conversation.

*Par défaut, l'orateur A commencera le premier tour de parole, suivi par l'orateur A et l'orateur B qui communiqueront à tour de rôle (actuellement, ne prend en charge que la génération de contenu en anglais).