Command Palette

Search for a command to run...

La Première Documentation Complète En Chinois Sur Triton Est En Ligne ! Ouvrir Une Nouvelle Ère D’accélération D’inférence GPU

Trois ans après sa sortie, Triton est à la tête de la nouvelle vague de compilateurs d'IA

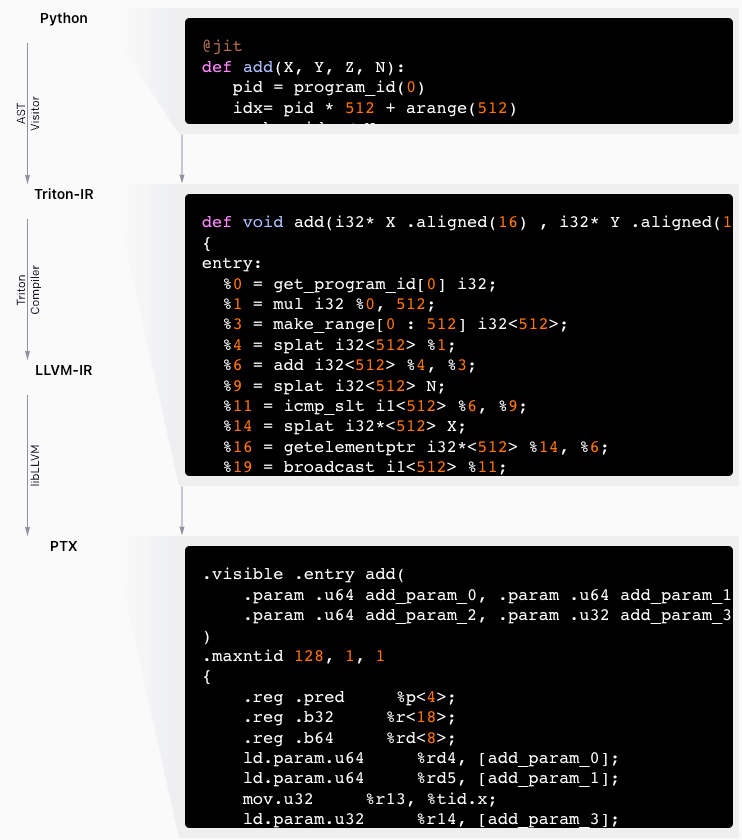

En 2019, Philippe Tillet et al. a proposé Triton pour la première fois dans l'article « Triton : un langage intermédiaire et un compilateur pour les calculs de réseaux neuronaux tuilés ». En 2020, Philippe Tillet a rejoint OpenAI et a continué à diriger le développement du projet Triton, et en 2021, le compilateur Triton a été publié publiquement pour la première fois.

Adresse du document :https://dl.acm.org/doi/10.1145/3315508.3329973

Le compilateur Triton est conçu pour permettre aux chercheurs et aux développeurs d'atteindre des performances CUDA de niveau expert avec moins de code.Il a suscité beaucoup d’attention dans le développement de l’apprentissage en profondeur, tant à l’étranger qu’au niveau national.

Utilisé pour spécifier un programme en bloc et le compiler en code GPU efficace

Depuis sa sortie open source en 2021,Triton est connu pour ses performances et sa flexibilité exceptionnelles.Il a rapidement gagné une large attention et une large application dans le monde entier. Il est non seulement utilisé dans de nombreux projets open source tels que PyTorch, Unsloth, FlagGems, etc., mais a également reçu un fort soutien de la part de géants des puces tels que NVIDIA, AMD, Intel et Qualcomm.

De plus, des sociétés d’IA de premier plan telles que Google, Microsoft, OpenAI, AWS et Meta ont également utilisé Triton comme technologie clé pour créer des piles de logiciels d’IA ouvertes. Triton devient progressivement une nouvelle option pour les compilateurs d’IA avec des barrières à l’entrée plus faibles et une disponibilité plus élevée.

La première version complète de la documentation chinoise de Triton est en ligne

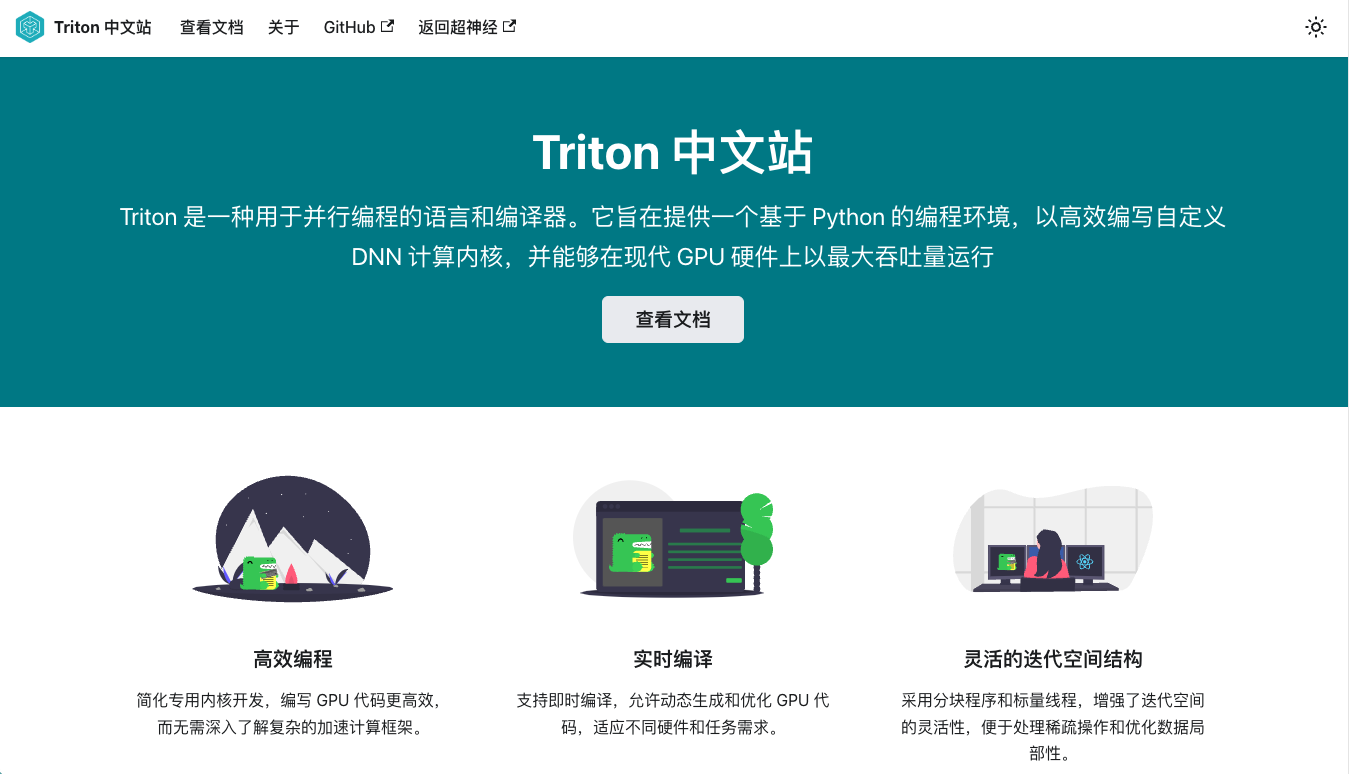

Bien que l’influence de Triton dans le domaine mondial de l’IA augmente rapidement,Cependant, dans le domaine chinois, les informations et les ressources liées à Triton sont relativement rares.L’étendue et la profondeur de son application et de ses recherches doivent être élargies. Sur cette base,Les bénévoles de la communauté HyperAI, de manière collaborative open source, ont passé 3 mois et ont procédé à une révision stricte de la première traduction et à une deuxième relecture pour terminer la localisation de tous les documents Triton. Il est désormais entièrement en ligne. https://triton.hyper.ai/.

La documentation chinoise de Triton est basée sur la documentation anglaise et a été adaptée à une structure localisée.Il correspond davantage aux habitudes de lecture des développeurs chinois et propose une série de guides détaillés et pratiques allant de l'installation de Triton au développement d'applications.

Triton | Avec ce document, vous pouvez :

* Démarrez avec Triton à partir de zéro et comprenez facilement ses concepts et applications de base

* Acquérir une compréhension approfondie des fonctionnalités avancées de Triton et explorer des voies innovantes

* Identifier rapidement les problèmes pratiques et obtenir des solutions pour améliorer l'efficacité

* Suivez les tendances technologiques de pointe de Triton et restez au courant des mises à jour technologiques

* Participer aux discussions communautaires sur les documents chinois et collaborer pour créer un écosystème technique

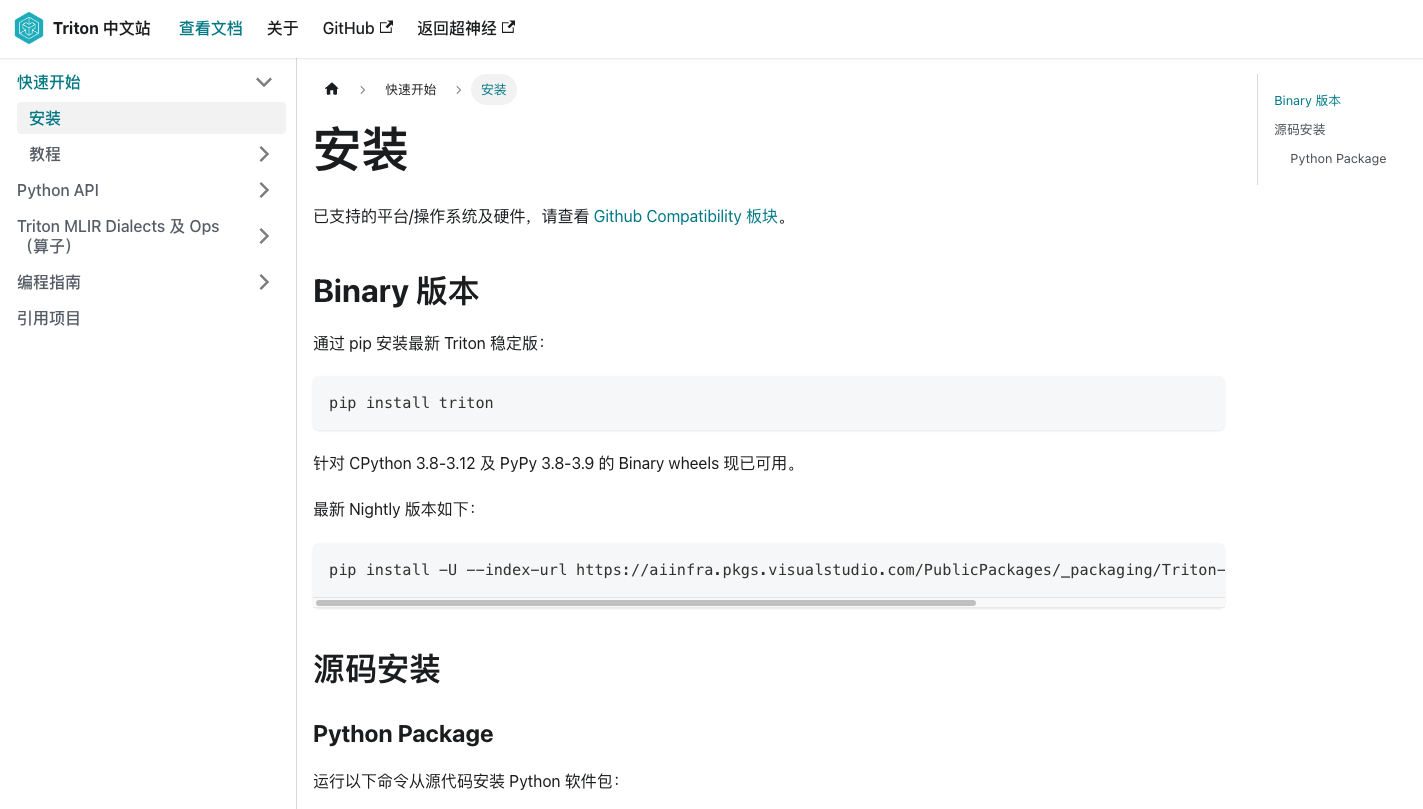

Installation via pip et code source

La section « Projets de référence » du document rassemble certains projets Star open source et closed source qui utilisent Triton. Grâce à ces cas réels, les développeurs peuvent avoir une compréhension plus approfondie de l’application de Triton dans des projets réels et maîtriser ses techniques d’optimisation et d’intégration.

De TVM à Triton :

Construire une communauté de compilateurs d'IA diversifiée et inclusive

En 2022, HyperAI a lancé la première documentation chinoise d'Apache TVM en Chine (Cliquez pour voir le texte original : Le site Web chinois de TVM est officiellement lancé ! Le « livre de référence » le plus complet sur le déploiement de modèles d'apprentissage automatique est ici), alors que les puces nationales progressent rapidement, nous fournissons aux ingénieurs compilateurs nationaux l'infrastructure nécessaire pour comprendre et apprendre TVM.Dans le même temps, nous nous sommes également associés à Apache TVM PMC Dr. Feng Siyuan et d'autres pour former la communauté chinoise TVM la plus active de Chine.Grâce à des activités en ligne et hors ligne, nous avons attiré la participation et le soutien des principaux fabricants de puces nationaux, couvrant plus d'un millier de développeurs de puces et d'ingénieurs compilateurs.

Adresse de la documentation chinoise de TVM :

Deux ans plus tard, nous espérons continuer à élargir les limites techniques et la portée du contenu de la communauté, et à créer une communauté de compilateurs d'IA plus ouverte, diversifiée et inclusive.En plus d'Apache TVM, nous adoptons activement les anciennes technologies de compilateur telles que LLVM et MLIR ainsi que les ingénieurs et projets associés. Le lancement du site Web chinois Triton montre également notre détermination à élargir le « cercle d'amis » de la communauté des compilateurs d'IA.

La documentation chinoise pour TVM et Triton est toujours en cours de mise à jour. En tant qu’infrastructure, la documentation chinoise n’est que la première étape dans la construction d’un écosystème. En amont de l’écosystème, on ne peut pas se passer des outils de développement et des systèmes d’exploitation autour du compilateur d’IA. En aval de l’écosystème, nous ne pouvons pas nous passer des fabricants de matériel et des fournisseurs de services. Ce n’est qu’en construisant un partenariat complet, en reliant chaque maillon et les besoins réels de chaque partenaire, en abaissant les barrières et en leur apportant de la valeur, que nous pourrons créer davantage de possibilités de progrès coopératif.

Nous sommes impatients que davantage de partenaires d’entreprise nous rejoignent pour bâtir une communauté de compilateurs d’IA plus ouverte, diversifiée et inclusive !

Consultez la documentation complète de Triton en chinois :https://triton.hyper.ai/

Sur GitHub 🌟 Triron chinois :https://github.com/hyperai/triton-cn