Command Palette

Search for a command to run...

Tutoriel En Ligne | Générez Un Roman À Suspense De 10 000 Mots En 1 Minute, LongWriter-glm4-9b Brise Le Goulot d'étranglement De La Sortie De Texte Long

Ces dernières années, les grands modèles linguistiques (LLM) ont montré de grandes capacités de compréhension et de génération de textes complexes, étant capables de traiter des entrées allant jusqu'à 100 000 jetons, mais ont souvent du mal à générer des sorties cohérentes de plus de 2 000 mots.

L’une des principales raisons est la rareté des échantillons de sortie longs dans l’ensemble de données SFT (réglage fin supervisé).L’étude montre que la longueur de sortie maximale du modèle a une corrélation positive significative avec la longueur des échantillons auxquels il est exposé dans l’étape SFT. En d’autres termes, même si les modèles ont appris à comprendre et à traiter des textes longs, ils n’ont pas encore complètement appris à générer des textes de même longueur.

Pour résoudre ce problème, l'Université Tsinghua et Zhipu AI ont construit un ensemble de données appelé LongWriter-6k basé sur la technologie AgentWrite, qui contient 6 000 échantillons de données SFT avec des longueurs de sortie allant de 2 000 à 32 000 mots.L'ensemble de données est actuellement disponible sur la section Ensemble de données du site Web officiel HyperAI et prend en charge la saisie en un clic.

Adresse du jeu de données :

Par la suite, l'équipe de recherche a également utilisé LongWriter-6k et s'est entraînée sur la base de GLM-4-9B pour obtenir un modèle LongWriter-glm4-9b capable de générer plus de 10 000 mots de texte cohérent, augmentant considérablement le potentiel de sortie des grands modèles linguistiques et montrant une grande polyvalence dans des applications pratiques telles que la création littéraire et le reportage d'actualité.

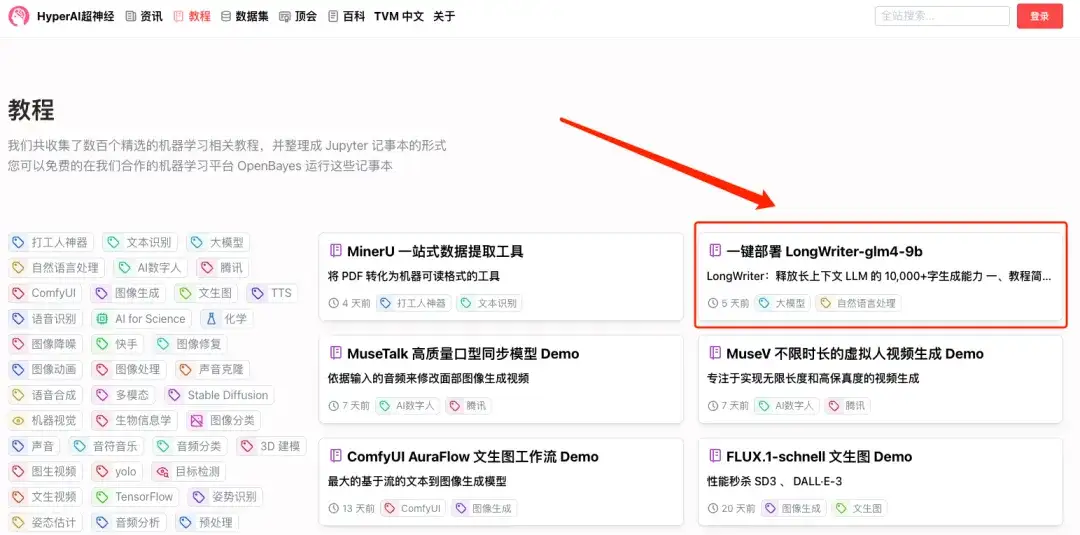

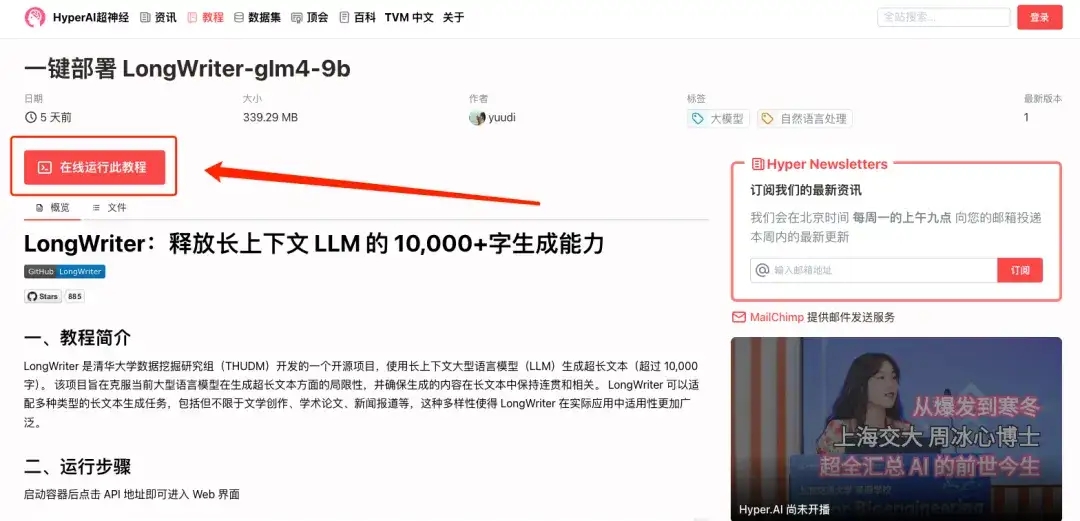

Actuellement, « Déploiement en un clic de LongWriter-glm4-9b » a été lancé dans la section Tutoriel HyperAI Super Neural.Le clonage en un clic lance la conversation.

Adresse du tutoriel :

Essai de démonstration

1. Connectez-vous à hyper.ai, recherchez « Déploiement en un clic de LongWriter-glm4-9b » sur la page « Tutoriel » et cliquez sur « Exécuter ce tutoriel en ligne ».

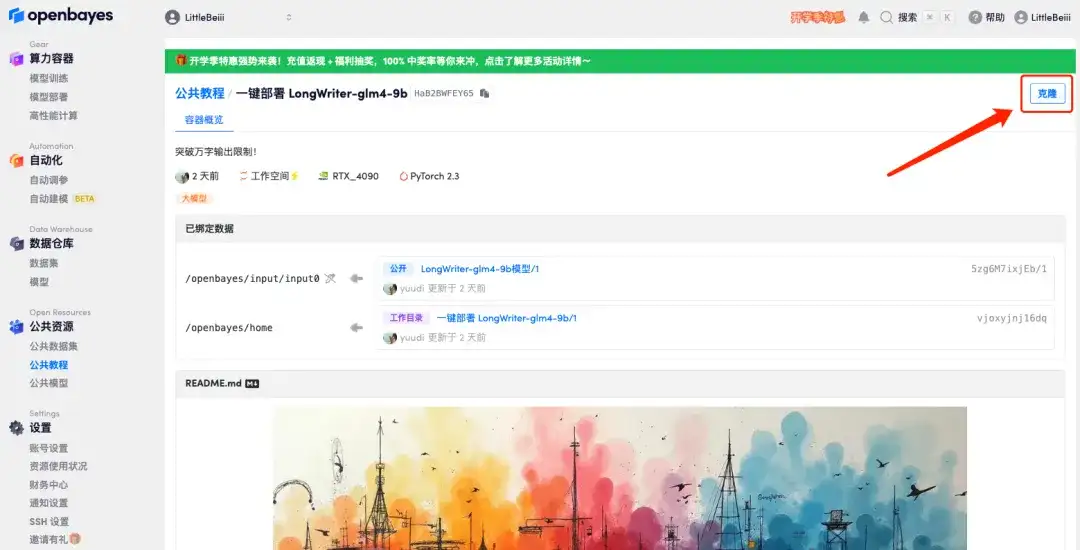

2. Une fois la page affichée, cliquez sur « Cloner » dans le coin supérieur droit pour cloner le didacticiel dans votre propre conteneur.

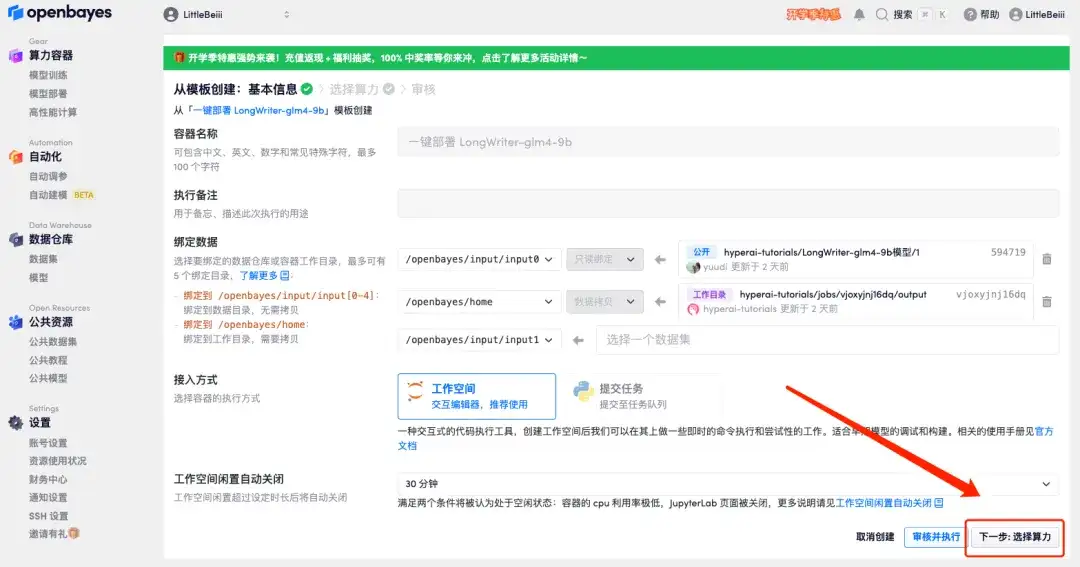

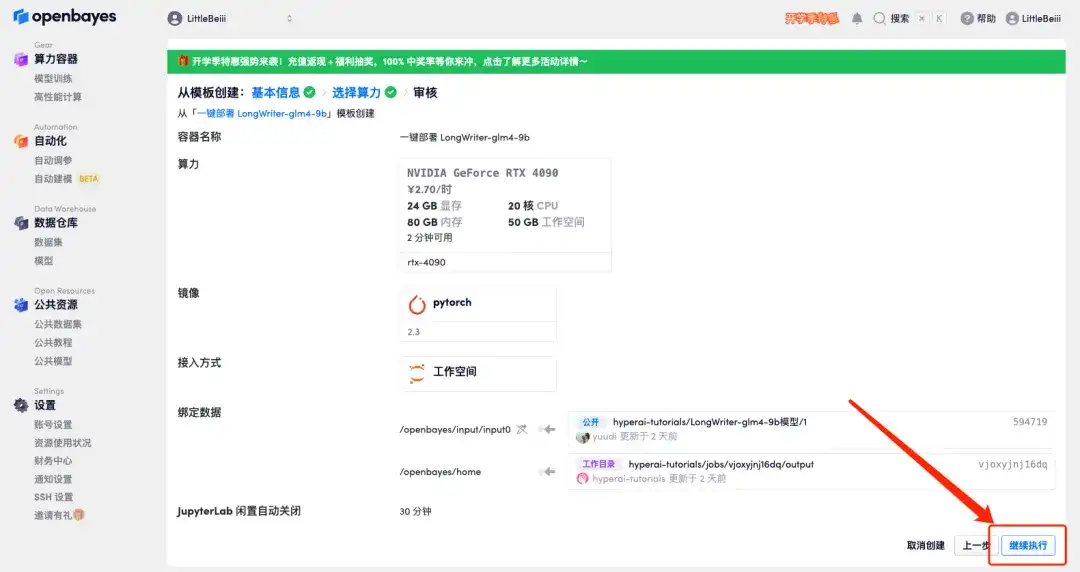

3. Cliquez sur « Suivant : sélectionner le taux de hachage » dans le coin inférieur droit.

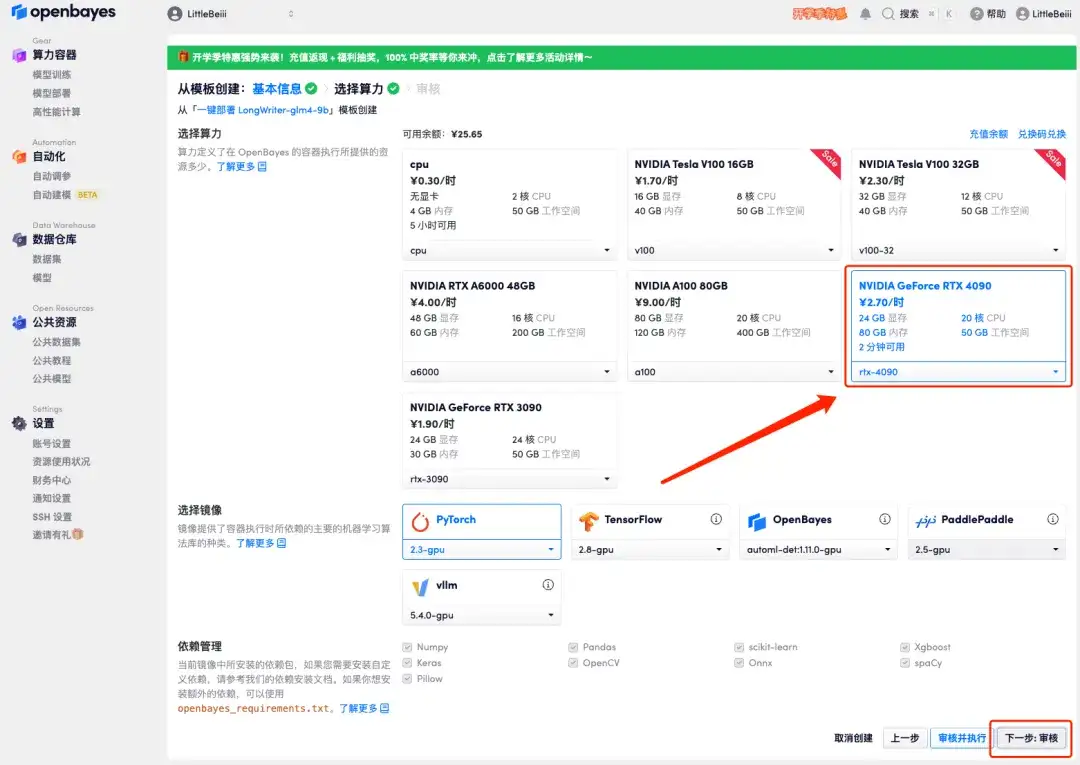

4. Une fois la page affichée, sélectionnez « NVIDIA RTX 4090 » et l'image « PyTorch », puis cliquez sur « Suivant : Réviser ».Les nouveaux utilisateurs peuvent s'inscrire en utilisant le lien d'invitation ci-dessous pour obtenir 4 heures de RTX 4090 + 5 heures de temps CPU gratuit !

Lien d'invitation exclusif HyperAI (copier et ouvrir dans le navigateur) :

https://openbayes.com/console/signup?r=6bJ0ljLFsFh_Vvej

5. Après confirmation, cliquez sur « Continuer » et attendez que les ressources soient allouées. Le premier processus de clonage prendra environ 2 minutes. Lorsque le statut passe à « En cours d'exécution », cliquez sur la flèche de saut à côté de « Adresse API » pour accéder à la page de démonstration.Veuillez noter que les utilisateurs doivent effectuer l'authentification par nom réel avant d'utiliser la fonction d'accès à l'adresse API.

Aperçu de l'effet

1. Ouvrez l’interface de démonstration et laissez-la générer un roman à suspense de 10 000 mots.

2. Vous pouvez voir qu’il produit rapidement un long roman à suspense.