Command Palette

Search for a command to run...

Aperçu De l'événement | La Première De Meet AI Compiler 2024 À Pékin Est Prévue Pour Le 6 Juillet !

La série d'événements Meet TVM 2023 a organisé un total de 4 Meetups.L'événement s'est tenu dans 3 villes différentes et 19 experts en compilateurs d'IA de différents secteurs ont été invités à partager de merveilleux enseignements, attirant plus d'un millier de participants du monde universitaire et de l'industrie.

Après une nouvelle mise à niveau en 2024, Meet AI Compiler est prêt à fonctionner. Le premier Meetup hors ligne aura lieu le 6 juillet à l'Institut de technologie informatique de l'Académie chinoise des sciences.Pour ce Meetup, nous avons la chance d'avoir invité de nombreux experts seniors en compilateurs d'IA de l'Université Jiao Tong de Shanghai, de l'Institut de technologie informatique de l'Académie chinoise des sciences, de Microsoft Research Asia, etc. Ils nous apporteront de merveilleux discours d'ouverture et des tables rondes, et discuteront avec nous de l'application et des avancées de la technologie des compilateurs d'IA dans des scénarios pratiques.

Détails de l'événement

⏰ Heure : 6 juillet (samedi) 13h30-17h40

Lieu : Salle de conférence, 1er étage, Institut de technologie informatique, Académie chinoise des sciences, n° 6, route Kexueyuan Sud, district de Haidian, Pékin

Institut de technologie informatique, Académie chinoise des sciences

N° 6, route sud de Kexueyuan, Zhongguancun, district de Haidian, Pékin

Nombre de personnes : 200 (Les places sur place sont limitées, veuillez vous inscrire le plus tôt possible)

Inscription : Scannez le code QR ci-dessous pour vous inscrire

Scannez le code QR et notez « AI Compiler » pour rejoindre le groupe d'événements :

Ordre du jour:

Invités et ordre du jour

Partage d'invités

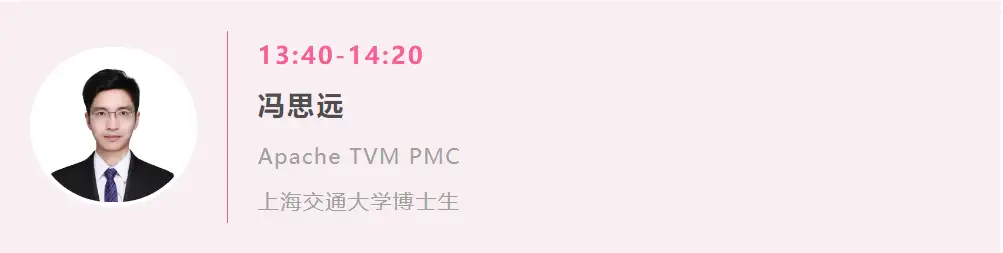

Partager le sujet:MLCEngine : un moteur de déploiement LLM universel

Introduction au contenu : Ce partage présentera MLCEngine, un moteur LLM qui peut être déployé universellement sur différentes plates-formes. MLCEngine dispose non seulement de capacités de service LLM à haut débit et à faible latence sur le serveur, mais prend également en charge le déploiement transparent des modèles linguistiques volumineux de haute qualité d'aujourd'hui dans divers environnements locaux.

Regardez cette séance de partage et vous apprendrez :

1. Concept de conception et utilisation de MLCEngine

2. L’importance du déploiement universel

3. Réflexions sur le développement du moteur de raisonnement LLM

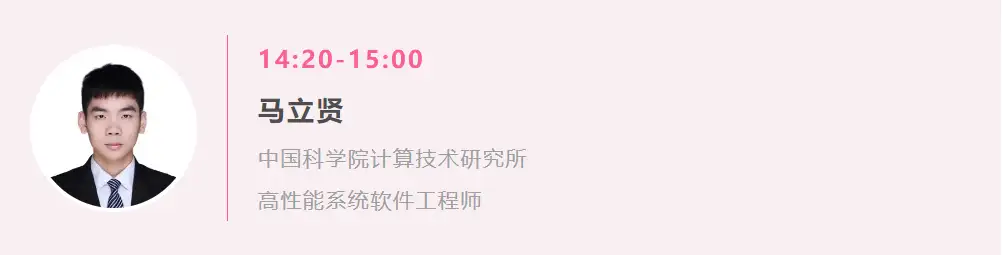

Partager le sujet:ElasticRoom : moteur d'inférence DNN multi-locataire via co-conception avec compilation à ressources limitées et planification prioritaire renforcée

Contenu:Les mécanismes de partitionnement des ressources GPU dans les logiciels d'exécution ont été largement utilisés dans les planificateurs de tâches et les systèmes informatiques multi-locataires pour améliorer l'utilisation des ressources et le débit. Cependant, le mécanisme de partitionnement des ressources GPU existant ne peut pas simultanément améliorer l'utilisation des ressources GPU et garantir une faible latence pour les requêtes en temps réel face à des requêtes d'inférence DNN hétérogènes par lots.Nous proposons un moteur d'inférence DNN multi-locataire innovant, ElasticRoom, qui construit une compilation à ressources limitées basée sur TVM et permet à la fois une utilisation élevée du GPU et une faible latence pour les requêtes en temps réel grâce à la planification prioritaire.

Regardez cette séance de partage et vous apprendrez :

1. Gestion des ressources GPU et planification des tâches

2. Compilation à ressources limitées basée sur TVM

Partager le sujet:Système de compilation d'apprentissage profond efficace basé sur l'abstraction des tuiles

Contenu:Avec le développement rapide des algorithmes et du matériel d’apprentissage en profondeur, l’industrie a des exigences plus élevées en matière de déploiement de modèles efficace et rapide. Les compilateurs d’apprentissage profond sont devenus un nouveau moyen de connecter l’expression informatique du modèle et l’exécution matérielle sous-jacente. Cependant, il reste encore de nombreux défis à relever pour soutenir efficacement le développement rapide d’applications d’apprentissage profond sur différents matériels.Ce partage présentera notre série de travaux exploratoires dans le domaine de la compilation d'apprentissage profond basée sur une abstraction de tuiles unifiées.

Regardez cette séance de partage et vous apprendrez :

1. Pile de compilation d'apprentissage profond basée sur l'abstraction de tuiles

2. Dans les scénarios d'application d'apprentissage profond, comment optimiser l'efficacité de l'accès à la mémoire globale grâce à l'abstraction des tuiles

3. Dans les scénarios d'application d'apprentissage profond, comment prendre en charge les calculs d'apprentissage profond de faible précision grâce à l'abstraction des tuiles

Organisateurs et partenaires

HyperAI est une communauté leader en matière d'intelligence artificielle et de calcul haute performance en Chine.Son objectif est d'aider les développeurs et les passionnés de l'industrie chinoise de la science des données et de l'intelligence artificielle à apprendre, comprendre et pratiquer en fournissant une variété d'infrastructures telles que des téléchargements accélérés d'ensembles de données, des démonstrations de tutoriels en ligne, une interprétation approfondie des articles et une intégration du calendrier des conférences de haut niveau, et de construire l'avenir de l'intelligence artificielle avec la communauté. Actuellement, le site Web officiel de SuperNeural a lancé des milliers d'ensembles de données et de tutoriels publics classiques et de haute qualité, et gère la communauté de compilateurs d'IA la plus active en Chine.

Visitez le site officiel :https://hyper.ai/

OpenBayes Bayesian Computing est un fournisseur leader de services de calcul haute performance en ChineEn greffant des écosystèmes logiciels classiques et des modèles d’apprentissage automatique sur des puces hétérogènes de nouvelle génération, il fournit aux entreprises industrielles et à la recherche scientifique universitaire des produits de calcul de science des données plus rapides et plus faciles à utiliser. Ses produits ont été adoptés par des dizaines de grands scénarios industriels ou d’instituts de recherche scientifique de premier plan.

Visitez le site officiel :https://openbayes.com/

La communauté MLC.AI a été créée en juin 2022. Chen Tianqi, le principal inventeur d'Apache TVM et un jeune chercheur bien connu dans le domaine de l'apprentissage automatique, a dirigé l'équipe pour lancer le cours en ligne MLC, qui a systématiquement présenté les éléments clés et les concepts de base de la compilation de l'apprentissage automatique.

En novembre 2022, grâce aux efforts conjoints des bénévoles de la communauté MLC.AI, la première documentation chinoise complète de TVM a été lancée et hébergée avec succès sur le site Web officiel d'HyperAI, fournissant ainsi aux développeurs nationaux intéressés par la compilation d'apprentissage automatique les paramètres de base pour accéder et apprendre une nouvelle technologie - la documentation.

Cours en ligne MLC :https://mlc.ai/

Documentation chinoise de TVM :https://tvm.hyper.ai/

L'Institut de technologie informatique de l'Académie chinoise des sciences (ICT) a été fondé en 1956 et est la première institution universitaire en Chine dédiée à la recherche complète en informatique et en technologie.L'Institut de technologie informatique a développé avec succès le premier ordinateur électronique numérique à usage général de mon pays et a constitué une base de recherche et développement pour les ordinateurs hautes performances de mon pays. La première puce CPU à usage général de mon pays est également née ici.

L'Institut de technologie informatique est le berceau de l'industrie informatique de mon pays. Parallèlement au développement de l'Institut de technologie informatique, des centaines de professionnels de la technologie informatique parmi les plus anciens de mon pays ont été formés et plus de 20 universitaires ont travaillé ou étudié ici. Avec le développement des disciplines et des technologies, plusieurs instituts de recherche tels que l'Institut de microélectronique de Xi'an, le Centre de calcul, l'Institut de logiciel, le Centre de réseau, l'Institut de microélectronique et l'Institut d'ingénierie de l'information ont été séparés de l'Institut de technologie informatique, et des entreprises de haute technologie telles que Lenovo, Dawn, Loongson et Cambrian ont été incubées.

Le Comité technique de HPC (China Computer Federation, en abrégé CCF TCHPC) a été créé en 2005 avec l'approbation de la China Computer Federation. En tant que comité professionnel de la Fédération chinoise de l'informatique, il s'agit d'une organisation faisant autorité pour la recherche universitaire sur le calcul haute performance, organisant des conférences universitaires dans le domaine du calcul haute performance et fournissant des services d'application industrie-université.

Sur la base du principe et de la mission de « construire une plate-forme académique, promouvoir les échanges industriels, faire progresser la mise en œuvre des applications, équilibrer l'écosystème logiciel et matériel, servir le développement de l'industrie et connecter l'industrie, le monde universitaire, la recherche et l'application », nous nous engageons à promouvoir la recherche et le développement du domaine du calcul haute performance en Chine et à construire une plate-forme de coopération et d'échange académique et industrielle en matière de calcul haute performance. Il joue un rôle irremplaçable et important dans le soutien au développement scientifique et technologique et à l’innovation, dans la promotion du progrès social et dans le renforcement de la force nationale globale et de la compétitivité internationale de mon pays.

En juin 2011, l'Académie chinoise des sciences a officiellement créé l'Association pour la promotion de l'innovation des jeunes (ci-après dénommée « Association pour la promotion de la jeunesse »), qui est une initiative innovante de l'Académie chinoise des sciences visant à dispenser une formation complète aux jeunes talents scientifiques et technologiques de moins de 35 ans au sein de l'académie. Son objectif est d'unir et de consolider les jeunes travailleurs scientifiques et technologiques de l'académie grâce à une organisation et un soutien efficaces, d'élargir leurs horizons académiques, de promouvoir les échanges mutuels et les études interdisciplinaires, d'améliorer la capacité d'organiser des activités de recherche scientifique et de cultiver une nouvelle génération de leaders académiques et techniques.

Ligne active :Scannez le code QR pour accéder à l'inscription à l'événement

Scannez le code QR et notez « 2024 AI Compiler » pour rejoindre le groupe de l'événement

Compte tenu des conditions d'espace de cet événement, nous n'avons ouvert que 200 places pour y assister. Nous vous recommandons de vous inscrire le plus tôt possible pour garantir une place.

Au plaisir de vous rencontrer tous à Pékin de 13h30 à 17h40 le 6 juillet !