Command Palette

Search for a command to run...

Vous Vous Battez À Google I/O ? OpenAI Sera Diffusé En Direct Un Jour À l'avance, ChatGPT Pourrait Avoir Une Fonction d'appel

Le cercle de l’IA s’annonce très animé cette semaine.

Le 13 mai, heure locale, OpenAI diffusera en direct la sortie des mises à jour pour ChatGPT et GPT-4. Le lendemain, Google I/O est arrivé comme prévu. Contrairement à la conférence I/O qui est l'événement annuel de Google, la sortie temporaire d'OpenAI cette fois-ci est un peu un battage médiatique. Comment ce « vieux rival » de longue date agira-t-il cette fois-ci ? Passons en revue les origines des deux partis et faisons quelques suppositions audacieuses !

Plusieurs rounds de confrontation, la bataille bat son plein

Depuis qu'OpenAI a fait sensation, Google a été qualifié de « déçu », « en démarrage lent » et « en train de rattraper son retard ».Le titre le plus digne d'exploration est « Académie militaire AI Huangpu ».Cela ressemble à un éloge, mais en fait, ce sont les « larmes d’amertume » de Google.

Comme nous le savons tous, ChatGPT, qui a jeté les bases d’OpenAI, est basé sur l’architecture Transformer.Transformer est l'architecture phare proposée par Google dans l'article « Attention Is All You Need ».De plus, de nombreux anciens patrons de Google sont apparus dans les remerciements sur l'interface de publication de ChatGPT, et par la suite, de nombreux employés clés de Google sont passés à OpenAI... Ce qui est plus intéressant, c'est qu'à chaque fois que Google essaie de « riposter », il y a toujours de petits épisodes.

En février 2023, Google a proposé à Bard de gérer ChatGPT.Mais peu de temps après la publication, il a été révélé que la démonstration contenait des erreurs factuelles.

En réponse à la question : « Que puis-je dire à mon enfant de 9 ans sur le télescope spatial James Webb (JWST) et ce qu'il a découvert ? » Bard a donné une réponse : La première photo d'une exoplanète a été prise par JWST. Mais Grant Tremblay, chercheur au Centre d'astrophysique Harvard-Smithsonian, souligne que c'est le Very Large Telescope (VLT) de l'Observatoire européen austral qui a pris la première photo d'une exoplanète en 2004.

Lors de la conférence I/O en mai 2023, Google a présenté les mises à niveau des produits de Bard.Par exemple, il prend en charge davantage de langues, reconnaît les informations d'image, se connecte aux applications Google et à certaines applications externes, etc. Dans le même temps, Google a également publié PaLM2, un produit comparable à GPT-4, qui présente des améliorations en mathématiques, en codage, en raisonnement et en génération de langage naturel.

Sur cette base, l'équipe de recherche de Google Health a également créé Med-PaLM 2, qui dispose de fonctions telles que la récupération de connaissances médicales et le décodage de termes médicaux. Comme prévu, Google a intégré ses capacités d'IA dans des scénarios de bureau tels que la rédaction et la création de feuilles de calcul, et a lancé Google Workspace, qui est comparable à GPT en termes de modèle et à Microsoft en termes d'application.

Par la suite, de nombreux internautes ont comparé PaLM 2 avec GPT-4 sous diverses formes, et OpenAI était encore plus susceptible d'être en tête.

En décembre 2023, Google a publié Gemini, son modèle d'IA « le plus grand et le plus puissant ».L'effet de démonstration est en effet étonnant, et la version haut de gamme peut rivaliser avec le GPT-4 en termes de performances. Cependant, il a été révélé que la vidéo de démonstration avait été post-traitée et que l'effet était partiellement exagéré.

Le 8 février 2024, Google a annoncé que Bard serait officiellement renommé Gemini.Le chatbot Gemini Advanced, qui est alimenté par son modèle le plus puissant Gemini Ultra, est également officiellement disponible, avec le même « loyer mensuel » de 20 $ que ChatGPT, ce qui semble être une concurrence. L’importance la plus importante de cette version est que l’IA de Google sera unifiée dans Gemini, qui est à la fois le nom du modèle et le nom du produit.

Le 16 février 2024, quelques jours seulement après la sortie de son plus puissant Gemini 1.0 Ultra, Google a lancé Gemini 1.5 d'un seul coup.Parmi eux, Gemini 1.5 Pro peut prendre en charge jusqu'à 1 million de jetons de contexte ultra-long, écrasant GPT-4 en termes de nombre de jetons, obtenant ainsi d'excellentes performances dans des tâches telles que le traitement audio et vidéo. S'il n'y avait pas Sora, Gemini 1.5 serait probablement un sujet brûlant dans le cercle de l'IA pendant longtemps.

Quelques heures seulement après la sortie de Gemini 1.5, OpenAI a publié le modèle vidéo Vincent Sora.Grâce à ses capacités de génération vidéo sans précédent, il a immédiatement pris le devant de la scène et la vidéo de démonstration d'une minute a directement volé la vedette à Gemini.

Dans ce tour, il n’y a pas de comparaison en termes de technologie, mais le gagnant est clairement décidé en termes de popularité. OpenAI a également consolidé sa position avec l’aide de Sora.

OpenAI va-t-il à nouveau voler la vedette ?

Il convient de noter que le 1er mai, l'internaute de X Jimmy Apples a annoncé la nouvelle :Le moteur de recherche d'OpenAI pourrait être lancé le 9 mai.Cet internaute a prédit avec précision la date de sortie de GPT-4. Il a ensuite déclaré que la date de sortie avait été repoussée au 13 mai.

Le 8 mai, Bloomberg a également rapporté qu'OpenAI développait en interne un nouveau moteur de recherche, qui apportera une nouvelle expérience de recherche grâce à des méthodes de réponse aux questions génératives de l'IA. Bloomberg a déclaré que l'une des caractéristiques du moteur de recherche est qu'il peut répondre à des questions en utilisant du texte écrit et des images. Bloomberg a rapporté que le produit de recherche d'OpenAI est une extension de son produit phare ChatGPT, permettant à ChatGPT d'obtenir directement des informations sur le Web, y compris des citations. Dans des rapports précédents, The Verge a annoncé la nouvelle.OpenAI recrute des ingénieurs du département de recherche de Google pour accélérer le lancement de ses produits de recherche IA.

La décision d’OpenAI de cibler le secteur de la recherche déjà stable ressemble un peu à « attaquer directement le dragon » ?

Cependant, le 11 mai, OpenAI a officiellement tweeté que la conférence de presse du 13 n'apporterait que des mises à jour de ChatGPT et GPT-4, sans mentionner du tout le « moteur de recherche ». Mais la date du 13 mai est assez intéressante car Google a déjà annoncé qu'il tiendrait la conférence Google I/O le 14 mai.

Puis, Sam Altman a révélé ses cartes directement -Pas GPT-5, pas un moteur de recherche,Mais nous travaillons toujours sur de nouvelles choses que nous pensons que les gens adoreront ! C'est comme de la magie pour moi.

Après que Sam Altman ait supprimé deux mauvaises réponses, les internautes étaient toujours enthousiastes à l'idée de deviner « ce qu'OpenAI va publier », et de nouveaux indices ont été révélés, notamment l'interaction vocale.

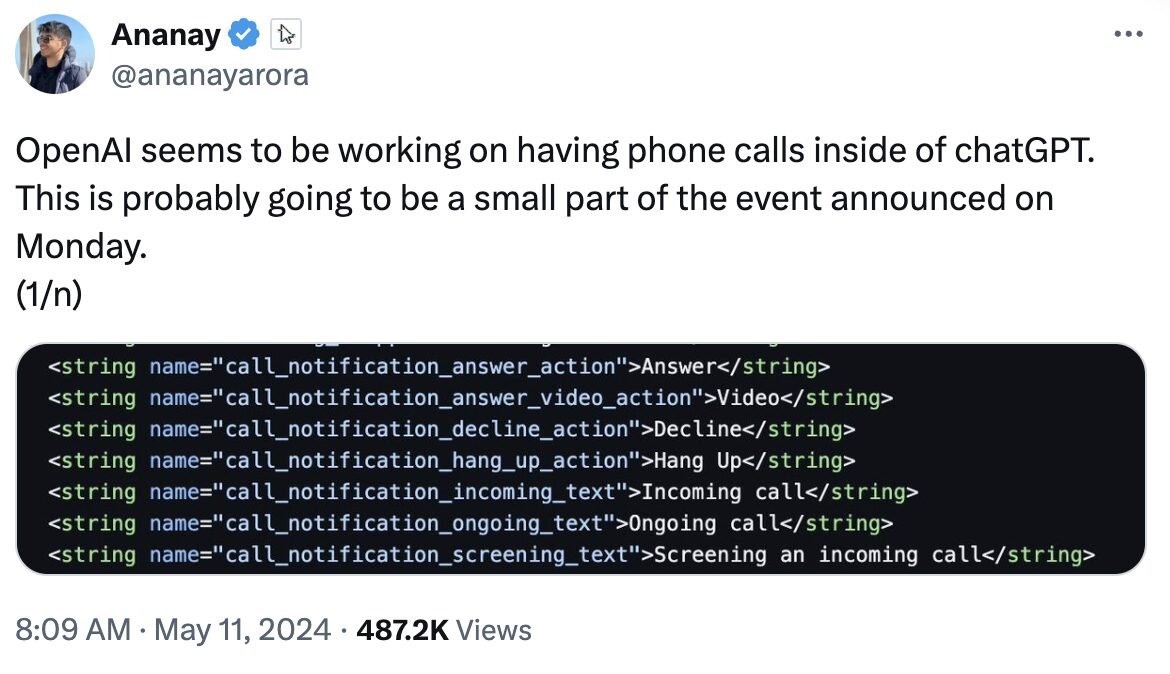

Selon The Information, OpenAI a démontré à ses utilisateurs un nouveau modèle capable à la fois de dialoguer et de reconnaître des objets, offrant une compréhension plus rapide et plus précise des images et des sons. Selon The Verge, le développeur Ananay Arora a déclaré que ChatGPT pourrait avoir une fonction d'appel. Arora a également trouvé des preuves qu'OpenAI fournissait des serveurs pour les communications audio et vidéo en temps réel.

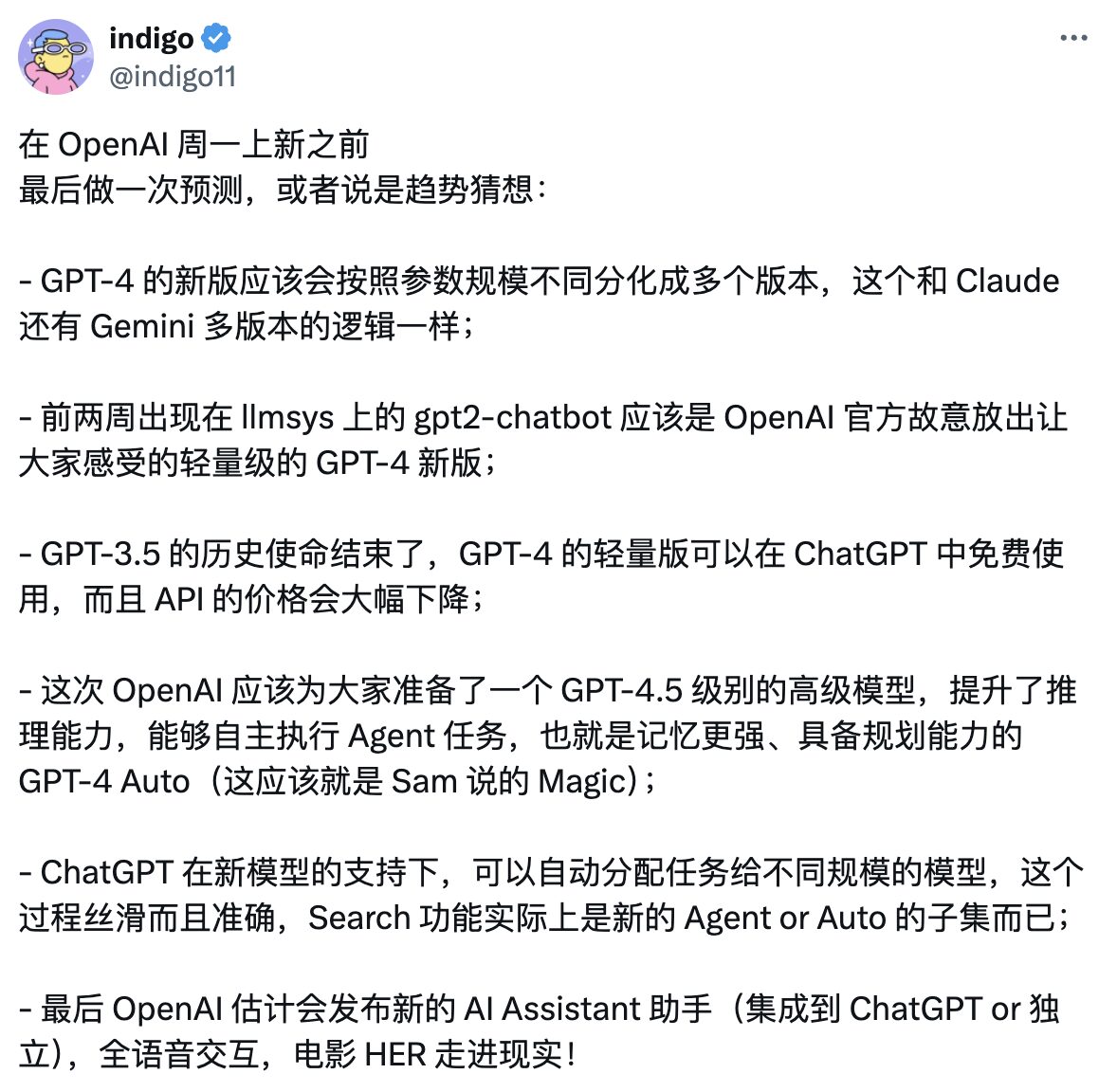

De plus, le cofondateur de Halliday, Indigo, a publié une prédiction plus détaillée sur son compte Twitter (X), mentionnant non seulement GPT-4.5, mais prédisant également que le nouvel assistant IA d'OpenAI prendra en charge l'interaction vocale complète.

Cependant, d’un certain point de vue,Bien que Sam Altman ait nié le « moteur de recherche », il n'a pas dit qu'il n'ajouterait pas un « buff de recherche » à ChatGPT.En fait, ces derniers temps, les internautes ont déterré de nombreuses preuves montrant qu’OpenAI est entré dans le domaine de la recherche.

Tout d’abord, Lior S, ancien chercheur de Mila et professeur au MIT, a annoncé la nouvelle.Le dernier journal des certificats SSL d'OpenAI montre que le sous-domaine search.chatgpt.com a été créé.

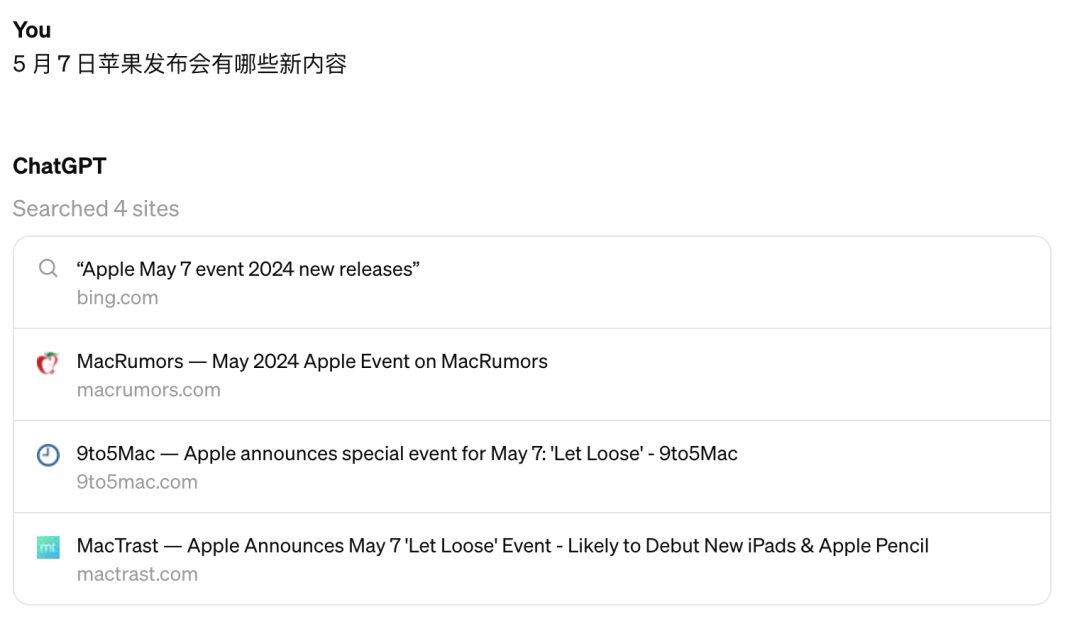

Certains internautes en Chine ont reçu le test en niveaux de gris, et « Cyber Zen Heart » a publié les résultats de l'essai sur son compte officiel :

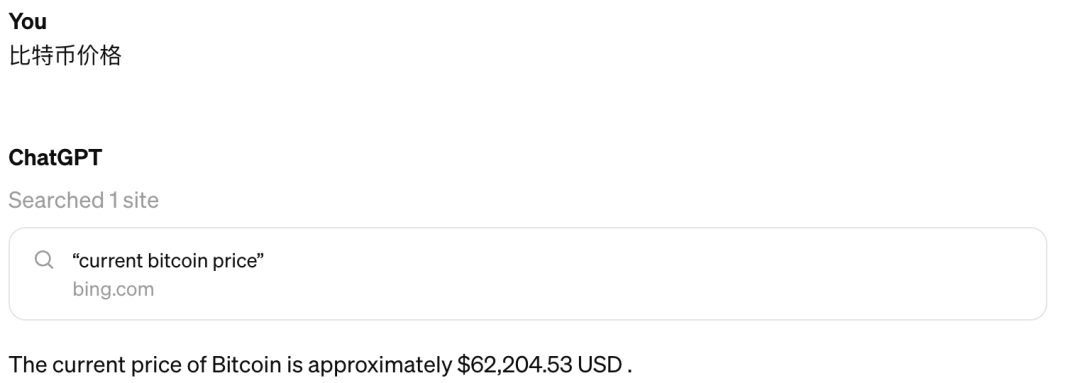

Comme vous pouvez le voir, les réponses de ChatGPT sont assez précises et Cyber Zen Heart affirme que sa vitesse de réponse est également acceptable. Cependant,ChatGPT n’est pas efficace pour obtenir des informations en temps réel.Cyber Zen a recherché les prix du Bitcoin et les a comparés avec les prix trouvés sur Google :

De plus, un internaute a directement publié une démo sur Twitter prétendant être la page de recherche officielle d'OpenAI AI, mais elle est très différente de l'interface de test en niveaux de gris :

À l'heure actuelle, on ne sait pas encore si le produit de recherche d'OpenAI sera finalement publié au public sous la forme d'un test en niveaux de gris. Dans l’ensemble, les concurrents auxquels il est confronté ne sont pas seulement Google, mais aussi Perplexity AI. en fait,En un sens, Perplexity AI est le produit avec lequel OpenAI devrait concurrencer directement dans le secteur de la recherche.

Aujourd'hui, cet outil d'IA, qui se présente comme « le premier moteur de recherche conversationnel au monde », est sous les feux de la rampe et a reçu le soutien de Jensen Huang et des investissements de gros bonnets comme Bezos. Sa particularité réside dans la combinaison de questions et réponses de style ChatGPT et de la liste de liens des moteurs de recherche traditionnels.

Sous quelle forme OpenAI participera-t-il à la concurrence du marché des moteurs de recherche à l'ère de l'IA ? Attendons de voir si la fonction de recherche de ChatGPT sera révélée lors de la conférence de presse du 13 mai.

Google I/O peut-il uniquement compter sur Gemini pour prendre la tête ?

Il reste à voir si la conférence de presse d’OpenAI révélera des mises à jour majeures, intentionnellement ou non, mais je pense que Google regardera certainement la diffusion en direct à temps. S’il y a une surprise, je me demande si Pichai sera capable de réagir rapidement et de riposter à temps lors de la conférence Google I/O un jour plus tard ?

En comparaison, la conférence annuelle Google I/O manque un peu de mystère. Les thèmes de la conférence annoncés sur sa page officielle sont : le mobile, le Web, le ML/AI et le cloud.

Comme d'habitude, le PDG de la société, Sundar Pichai, partagera les mises à jour Android, les produits matériels de nouvelle génération, les derniers progrès et réalisations de Google dans le domaine de l'IA et l'intégration de ses capacités d'IA avec l'ensemble de l'écosystème de Google dans son discours d'ouverture.

* Gemini renforce l'ensemble de l'écosystème de Google

Il ne fait aucun doute que Gemini sera le point culminant de la conférence Google I/O de cette année. Gemini 1.5, qui n'a été mis à jour qu'en février de cette année, a augmenté la longueur du contexte à des millions, et ses performances peuvent déjà rivaliser avec GPT-4. Par conséquent, la prochaine étape pour Google est d’examiner la question de l’application pratique : comment intégrer Gemini à ses outils de recherche, de photo et de vidéo, à Google Maps et à ses outils d’espace de travail tels que Gmail et Google Docs.

De plus, Google a progressivement injecté ses capacités d’IA dans Google Assistant. Les puissantes capacités de Gemini peuvent-elles créer un assistant vocal en langage naturel plus avancé et plus proche de l’humain ?

Il convient de noter qu'en tant qu'entreprises possédant à la fois des modèles avancés de grande taille et des activités matérielles, quel genre d'étincelles Gemini et le Pixel de Google peuvent-ils créer ? L’année dernière, des rapports ont indiqué qu’un assistant IA appelé Pixie pourrait apparaître sur le Pixel 9.

Le Pixel 8, qui a été dévoilé lors de la conférence Google I/O de l'année dernière, dispose déjà des capacités d'IA de Google. Il est équipé du processeur Tensor G3 développé par Google et dispose de fonctions telles que la gomme magique audio, Best Take, la traduction et la lecture de pages Web, etc. Par exemple, la fonction Best Take peut combiner plusieurs photos de groupe et sélectionner les expressions de différentes personnes à partir de différentes images pour créer une photo de groupe parfaite.

Comme d'habitude, le Pixel 9 sortira lors de la conférence de cette année, mais il n'a pas été vu dans les fuites actuelles. Au lieu de cela, le Pixel 8a a été plus populaire. Quant à savoir si l'assistant IA Pixie fera son apparition, nous ne pouvons qu'attendre et voir.

De plus, en avril de cette année, les médias étrangers ont annoncé qu'Apple et Google travaillaient ensemble pour intégrer Gemini dans le système iOS. Aucune des deux sociétés n’a officiellement confirmé la nouvelle. Si la nouvelle est vraie, elle peut être considérée comme une « collaboration centenaire » entre deux géants en concurrence dans de nombreux secteurs. Je me demande si Pichai annoncera les nouvelles pertinentes lors de la conférence Google I/O.

* Android et AR/XR

En tant que pierre angulaire de Google, Android est toujours un élément indispensable de la conférence Google I/O. Cette année, Android 15 a été dévoilé, avec des aperçus pour les développeurs et des versions bêta initiales déjà publiées. Pichai devrait présenter plus en détail les principales mises à jour du système dans son discours. Selon les informations divulguées précédemment, il introduira également un logiciel de voiture et de montre intelligente Wear OS basé sur Android Auto.

En outre, certains médias ont rapporté que Pichai partagerait des informations sur le logiciel AR de Google et présenterait la plate-forme Android XR qu'il a développée pour Samsung et d'autres fabricants d'écrans frontaux. Selon des rapports publiés plus tôt cette année, l'équipe chargée du matériel AR a été la plus durement touchée par la vague de licenciements de Google. Certains médias ont donc émis l'hypothèse qu'elle avait renoncé au développement de son propre matériel AR et qu'elle était pleinement engagée dans le modèle de coopération OEM. En d’autres termes, Google se concentrera sur le niveau logiciel.

En plus du discours d'ouverture de Pichai Ge, la conférence Google I/O de cette année comprend également plusieurs forums thématiques, tels que les derniers développements de l'IA de Google, les nouveaux développements d'Android, les cadres ML pour l'ère de l'IA générative, etc. Cependant, aucune diffusion en direct ne sera fournie. Des vidéos pertinentes seront diffusées après le discours. HyperAI continuera également à prêter attention et à produire des rapports approfondis autour de l'IA. Restez à l'écoute~

Derniers mots

Dans le passé, l’industrie était une mesure importante de la force d’un pays. Aujourd’hui, la puissance scientifique et technologique est également entrée sur la table des négociations et est même devenue un atout dans le jeu entre les grandes puissances. D’autant plus que la popularité des grands modèles reste élevée, chaque mouvement des géants de la Silicon Valley attire beaucoup d’attention. Je me souviens encore qu'à la fin de 2022, OpenAI, Microsoft, Google, etc. publiaient toujours soudainement des mises à jour majeures, et les internautes s'exclamaient - après le réveil, le cercle de l'IA a encore changé ?

Alors que nous entrons en 2024, la bataille continue de faire rage, de la course au niveau technique au développement de scénarios d'application, des anciennes puissances aux nouvelles licornes, les entreprises qui peuvent continuer à dominer la tendance doivent être celles qui ont des douves. Quant à la façon dont les grands au sommet de la pyramide se battront, déplaçons tous nos petits tabourets et regardons le combat entre les dieux !

Références :

1.https://36kr.com/p/2660898993824512

2.https://techcrunch.com/2024/05/09/google-i-o-2024-what-to-expect/

3.https://www.spiceworks.com/tech/tech-general/articles/google-io-2024-expectations

4.https://www.theverge.com/2024/5/11/24154307/openai-multimodal-digital-assistant-chatgpt-phone-calls