Command Palette

Search for a command to run...

Aperçu De l'événement | 2023 Meet TVM · Shenzhen Station Est Prévu, Vous Invitant À Nous Rejoindre Dans Un Voyage Technologique De Pointe En Matière De Compilateur d'IA !

Contenu en un coup d'œil :La troisième étape du rassemblement hors ligne Meet TVM 2023 se tiendra au Tencent Building à Shenzhen le 16 septembre ! Ce Meetup comprend 5 merveilleuses conférences sur les compilateurs d'IA. Nous avons hâte de vous rencontrer tous à Shenzhen !

Mots-clés:Événement hors ligne du compilateur 2023MeetTVM

Cet article a été publié pour la première fois sur la plateforme publique HyperAI WeChat~

En mars et juin de cette année, la série d'événements Meet TVM 2023 s'est déroulée avec succès respectivement à Shanghai et à Pékin.Plus de 300 partenaires issus de grands industriels et d'instituts de recherche se sont réunis pour des échanges et des discussions approfondis en ligne et hors ligne.

Lire les articles précédents :

À la mi-septembre, le 3e TVM Meetup hors ligne se tiendra à Shenzhen.Cette fois, nous avons invité 5 experts seniors en compilateurs d'IA, qui feront de merveilleuses présentations aux amis présents au Tencent Building à Shenzhen.

Cet événement est organisé par MLC.AI et HyperAI, et sponsorisé par OpenBayes et Tencent AI Lab. Nous avons également préparé de superbes cadeaux périphériques et des pauses thé pour tous sur place. Tout le monde est le bienvenu pour venir s'amuser !

Informations sur l'événement Meet TVM Shenzhen 2023

⏰ temps:16 septembre (samedi) 13h30-17h30

📍 Lieu:Salle multifonctionnelle, 2e étage, immeuble Tencent, 10000 Shennan Road, district de Nanshan, Shenzhen

👬 Nombre de personnes :200 (Les places sur place sont limitées, veuillez vous inscrire le plus tôt possible)

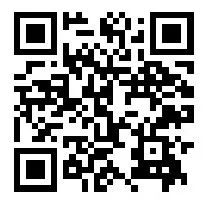

🙌🏻 S'inscrire:Scannez le code QR ci-dessous pour vous inscrire

Rappel chaleureux : des informations pour les visiteurs sont requises pour entrer dans le bâtiment Tencent. Veuillez vous assurer de remplir vos informations personnelles avec précision afin d'éviter d'affecter votre inscription. Merci pour votre coopération.

Scannez le code QR et notez « TVM Shenzhen » pour rejoindre le groupe de l'événement :

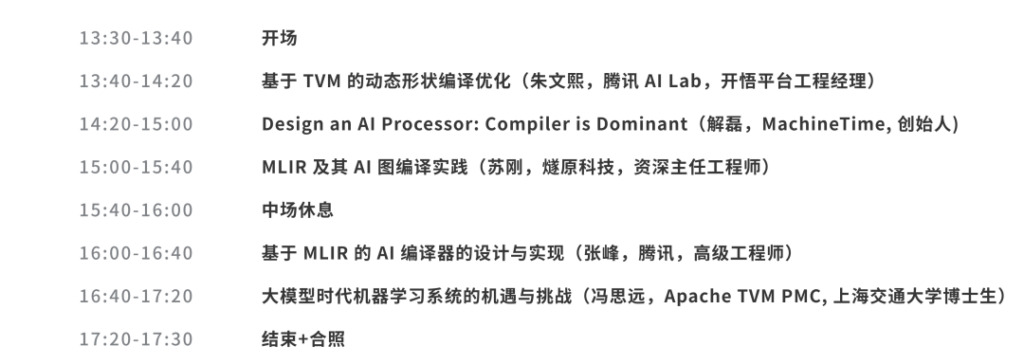

📝 Horaire :

Brève présentation des invités et du contenu

Partager le sujet:Optimisation de la compilation de formes dynamiques basée sur TVM

Contenu:Les compilateurs d'apprentissage profond traditionnels (y compris TVM) ne prennent pas en charge les formes dynamiques et sont moins capables de gérer les grands modèles de langage (longueur de séquence dynamique) et les modèles de détection (largeur/hauteur dynamique). Sur la base de cette situation, nous avons conçu et mis en œuvre une solution d'optimisation d'opérateur de forme dynamique côté CPU basée sur TVM, qui surpasse la solution de forme statique existante et ne nécessite presque aucun temps de recherche.

Regardez cette séance de partage et vous apprendrez :

1. Défis de l'optimisation dynamique des formes

2. Le travail de la communauté TVM lié au plaisir

3. Difficultés et solutions pour l'optimisation dynamique des formes côté CPU

Partager le sujet:Concevoir un processeur d'IA : le compilateur est dominant

Contenu:Avec le développement et la popularisation de l’AIGC représenté par de grands modèles de langage, la demande de puissance de calcul augmente de façon exponentielle. Par conséquent, la conception des puces de processeurs d’IA et la programmation correspondante sont devenues plus compliquées.

Comment rendre à la fois plus simple et plus efficace ? La conception conjointe d’une architecture de calcul et de compilateur automatisée est une solution potentielle.

Regardez cette séance de partage et vous apprendrez :

1. Paysage des produits des processeurs d'IA

2. État récent de la recherche sur la conception automatisée de processeurs d'IA

3. Cadre de compilation de base pour la conception automatisée de processeurs d'IA

Partager le sujet:MLIR et sa pratique de compilation de graphes IA

Contenu:Avec le développement fulgurant des puces et des frameworks d'IA, des compilateurs d'IA se sont également développés, tels que XLA, TVM, etc. En tant que framework de compilation général et réutilisable, MLIR est actuellement largement utilisé dans les systèmes de compilation d'IA car il peut aider les fabricants de matériel à créer rapidement des compilateurs DS AI.

Ce partage présente principalement quelques éléments de connaissances de base du MLIR, le processus Codegen du MLIR et les étapes pratiques pour créer un compilateur d'IA. De plus, nous discuterons également avec vous des idées de MLIR pour résoudre les problèmes clés des compilateurs d'IA.

Regardez cette séance de partage et vous apprendrez :

1. Éléments constitutifs d'un compilateur d'IA

2. Connaissances de base et utilisations du MLIR

3. Étapes de base pour créer un compilateur d'IA à l'aide de MLIR

Partager le sujet:Conception et implémentation d'un compilateur d'IA basé sur MLIR

Contenu:Il existe de nombreux frameworks logiciels différents dans le domaine de l'IA et de l'apprentissage automatique (tels que TensorFlow, PyTorch, etc.), et les périphériques matériels sont de plus en plus diversifiés (CPU, GPU, TPU, etc.). En tant que pont reliant les deux, les compilateurs d’IA sont confrontés à de nombreux défis.

En tant qu'infrastructure de compilateur, MLIR fournit une série de composants de base réutilisables et facilement extensibles pour créer des compilateurs spécifiques à un domaine. Tencent a construit un compilateur d'IA de bout en bout basé sur MLIR pour fournir une optimisation de compilation pour les modèles d'IA des utilisateurs, simplifiant ainsi le déploiement de modèles sur une variété de puces d'IA et obtenant des performances maximales.

Regardez cette séance de partage et vous apprendrez :

1. Le processus global du compilateur Tencent AI

2. Introduction à certaines infrastructures MLIR et à la commodité qu'elles offrent

3. Introduction au pavage et à la fusion basés sur le dialecte Linalg

Partager le sujet:Opportunités et défis des systèmes d'apprentissage automatique à l'ère des grands modèles

Contenu:Des progrès significatifs ont été réalisés dans le domaine de l’IA générative et des grands modèles linguistiques (LLM), qui ont des capacités remarquables et le potentiel de changer fondamentalement de nombreux domaines. Dans le même temps, cela apporte de nouvelles opportunités et de nouveaux défis aux systèmes d’apprentissage automatique. D’une part, l’énorme demande de puissance de calcul a conduit à une augmentation du besoin d’optimisation des systèmes ; D'autre part, la structure du modèle unique et les exigences matérielles de haute performance ont conduit l'écosystème d'apprentissage automatique initialement ouvert à commencer à converger.

Regardez cette séance de partage et vous apprendrez :

1. L'état actuel des systèmes d'apprentissage automatique à l'ère des grands modèles

2. Progrès récents et mises à jour du MLC-LLM

3. Perspectives des systèmes d'apprentissage automatique à l'ère post-grand modèle

Présentation des organisateurs et des partenaires

En tant qu'organisateur de cet événement, la communauté MLC.AI a été créée en juin 2022. Dirigée par Chen Tianqi, le principal inventeur d'Apache TVM et un jeune chercheur bien connu dans le domaine de l'apprentissage automatique, l'équipe a lancé le cours en ligne MLC, qui a systématiquement présenté les éléments clés et les concepts de base de la compilation de l'apprentissage automatique.

En novembre 2022, grâce aux efforts conjoints des bénévoles de la communauté MLC.AI,Le premier document TVM chinois complet a été lancé et hébergé avec succès sur le site officiel d'HyperAI.Il fournit également aux développeurs nationaux intéressés par la compilation d'apprentissage automatique les paramètres de base - la documentation - pour accéder et apprendre une nouvelle technologie.

Au quatrième trimestre 2023, la série d'événements « 2023 Meet TVM » se tiendra à Hangzhou, et les entreprises et les partenaires communautaires sont invités à participer à la co-création.

Cours en ligne MLC :https://mlc.ai/

Documentation chinoise de TVM :https://tvm.hyper.ai/

La principale communauté chinoise d'intelligence artificielle et de calcul haute performance,Nous nous engageons à fournir des ressources publiques de haute qualité dans le domaine de la science des données aux développeurs nationaux.Jusqu'à présent, il a fourni des nœuds de téléchargement nationaux pour plus de 1 200 ensembles de données publiques, pris en charge plus de 300 requêtes de termes liés à l'intelligence artificielle et au calcul haute performance, hébergé la documentation chinoise complète de TVM et lancera bientôt plusieurs didacticiels de base et populaires.

Visitez le site officiel :https://orion.hyper.ai/

OpenBayes est l'un des principaux fournisseurs de services de calcul haute performance en Chine.En greffant des écosystèmes logiciels classiques et des modèles d’apprentissage automatique sur la nouvelle génération de puces hétérogènes, il fournit aux entreprises industrielles et à la recherche scientifique universitaire des produits de calcul de science des données plus rapides et plus faciles à utiliser. Ses produits ont été adoptés par des dizaines de grands scénarios industriels ou d’instituts de recherche scientifique de premier plan.

Visitez le site officiel :https://openbayes.com/

Tencent AI Lab est le laboratoire d'IA de niveau entreprise de Tencent. Elle a été créée à Shenzhen en avril 2016 et compte actuellement plus de 100 chercheurs scientifiques de haut niveau et plus de 300 ingénieurs d'application. Grâce à l'accumulation à long terme de scénarios d'application riches, de big data, de puissance de calcul et de talents de premier ordre de Tencent,AI Lab s'engage pour l'avenir, l'ouverture à la collaboration et l'amélioration continue de la cognition, de la prise de décision et de la créativité de l'IA, en s'orientant vers la vision « Make AI Everywhere ».

Tencent AI Lab met l’accent sur le développement de la recherche et de l’application.La recherche fondamentale se concentre sur quatre grandes directions : l’apprentissage automatique, la vision par ordinateur, la technologie de la parole et le traitement du langage naturel ; Les applications technologiques se concentrent sur quatre domaines principaux : les jeux, les humains numériques, le contenu et l'interaction sociale, et explorent dans un premier temps la recherche et l'application de l'IA dans l'industrie, l'agriculture, les soins de santé, la médecine, les sciences de la vie et d'autres domaines.

Ligne active :Scannez le code QR pour accéder à l'inscription à l'événement

Notes sur le code de numérisation TVM ShenzhenRejoignez le groupe d'activités

Compte tenu de l'espace disponible pour cet événement,Nous n'avons ouvert que 200 places pour accueillir les participants.Il est recommandé de s'inscrire le plus tôt possible pour garantir une place.

La série d'événements Meet TVM 2023 est désormais ouverte.Au plaisir de vous rencontrer tous à Shenzhen de 13h30 à 17h30 le 16 septembre !

Cet article a été publié pour la première fois sur la plateforme publique HyperAI WeChat~