Command Palette

Search for a command to run...

Le Site Web Chinois De TVM Est Officiellement Lancé ! Le « livre De Référence » Le Plus Complet Sur Le Déploiement De Modèles d'apprentissage Automatique Est Ici

Contenu en un coup d'œil : Récemment, le document chinois TVM, traduit et relu par des bénévoles de la communauté MLC, a été officiellement publié et est désormais hébergé sur le site officiel de Hyper.AI.

Mots-clés: Compilateur d'apprentissage automatique open source TVM

Cet article a été publié pour la première fois sur le compte officiel de WeChat : HyperAI

Cinq ans après son lancement, TVM est devenu une pile de compilation d'apprentissage profond populaire

En août 2017, Chen Tianqi, alors doctorant à l'Université de Washington, et les membres de son équipe ont officiellement lancé TVM.

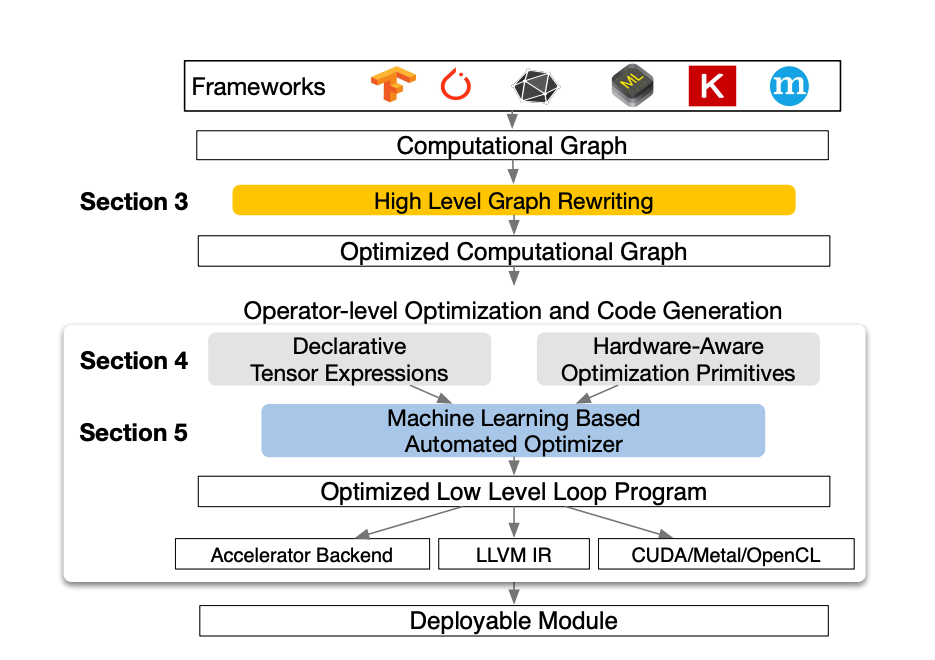

Il s'agit d'un framework de compilation de modèles open source, dont le nom complet est Tensor Virtual Machine, ce qui signifie machine virtuelle tenseur.Son objectif est de compiler automatiquement des algorithmes d’apprentissage automatique en langage machine pouvant être exécutés par le matériel sous-jacent, exploitant ainsi plusieurs types de puissance de calcul.

Présentation du système TVM : applicable au processeur, au GPU et à diverses puces d'accélération d'apprentissage automatique

papier:

TVM : un compilateur d'optimisation automatisé de bout en bout pour l'apprentissage profond

Dans la question de Zhihu « Comment évaluez-vous le nouveau TVM open source de l'équipe de Chen Tianqi ? », Chen Tianqi l'a personnellement expliqué en disant :

TVM tente de résumer l'expérience d'optimisation manuelle des opérations d'apprentissage en profondeur à un niveau d'abstraction plus élevé, afin que les utilisateurs puissent explorer rapidement un espace d'implémentation d'opérations efficace de manière automatique ou semi-automatique.

Cette question a reçu près de 260 000 vues sur Zhihu.

Depuis son ouverture au public il y a près de 5 ans,TVM présente les avantages de la flexibilité, des hautes performances et de l'adaptabilité à tout matériel. Il est privilégié par de nombreux grands fabricants, tels que NVIDIA, AMD, ARM, AWS, Facebook, etc., qui utilisent tous TVM, une pile de compilation matérielle d'apprentissage profond de bout en bout open source, pour améliorer la prise en charge du matériel arbitraire.

Il a fallu 3 mois pour publier la documentation chinoise pour la version 0.10.0

Actuellement, les supports d’apprentissage du chinois liés à la TVM sur Internet sont relativement dispersés. Les quelques documents chinois disponibles sont pour la plupart compilés et produits par des praticiens ou des passionnés de secteurs connexes en fonction de leurs propres besoins d'études ou de travail.

Afin d'aider les développeurs nationaux à apprendre systématiquement TVM et de promouvoir le développement de la compilation d'apprentissage automatique en Chine,Les bénévoles de la communauté MLC (Machine Learning Compilation) ont commencé avec la documentation et localisé la documentation officielle TVM v0.10.0 de manière collaborative open source.

La documentation chinoise de TVM est hébergée par Hyper.AI

Portail →https://tvm.hyper.ai/

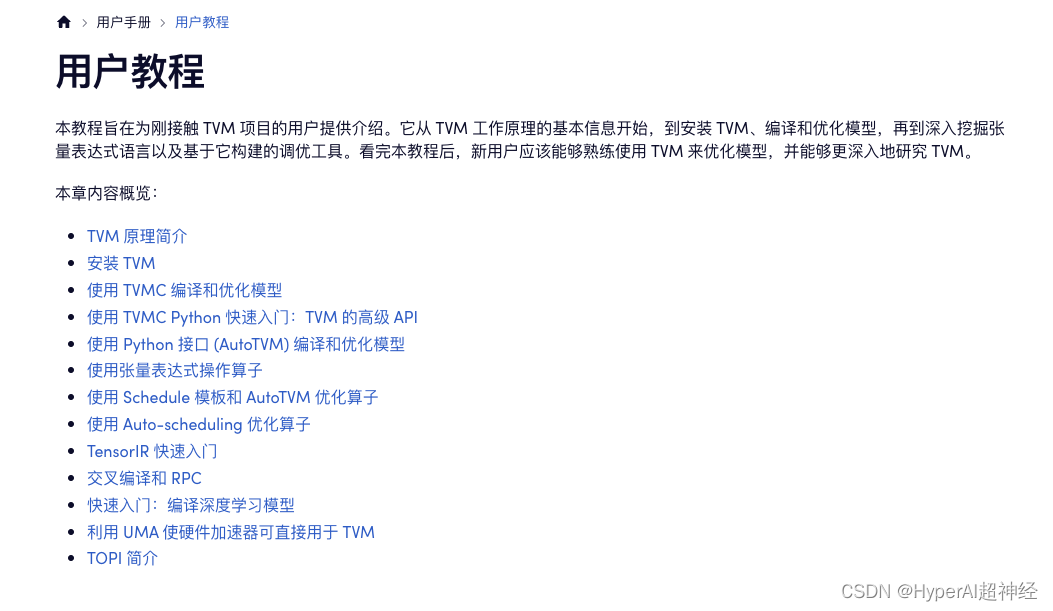

La documentation chinoise est basée sur la structure de la documentation anglaise sur le site officiel de TVM.Des ajustements ont été apportés pour mieux s'adapter aux habitudes de lecture des Chinois, en fournissant une série de documents pratiques de référence, depuis l'installation de TVM jusqu'à son utilisation pour le développement.

Il existe 3 façons d'installer TVM : l'installation du code source, l'installation de l'image Docker et l'installation de NNPACK Contrib.

Dans la section didacticiel utilisateur, plus de dix didacticiels sont également fournis aux développeurs pour qu'ils puissent rechercher et localiser rapidement des éléments d'apprentissage.

Actuellement, la documentation chinoise de TVM est toujours en cours de mise à jour. , Nous espérons que davantage de développeurs qui se soucient et se concentrent sur la compilation de l’apprentissage automatique se joindront à nous, tireront profit de la communauté et créeront de la valeur pour la communauté.

Nous acceptons toutes les formes de contributions, y compris, mais sans s'y limiter :

- Réclamez la traduction et la révision des documents TVM en anglais

- Soumettez un problème ou une PR pour rendre les documents chinois plus standardisés

- Promouvez les tutoriels de projets, les articles de blog et participez activement aux activités communautaires

- Plus

Communauté Open Source Tout vient de la communauté et tout revient à la communauté. Visitez maintenant le référentiel GitHub de la documentation chinoise de TVM. Nous espérons que vous deviendrez membre de nous et contribuerez au développement des compilateurs d'apprentissage automatique dans le domaine chinois !

⭐️ TVM sur GitHub :

⭐️ TVM chinois sur GitHub :

https://github.com/hyperai/tvm-cn

Remerciements :

Le lancement réussi du site chinois TVM est indissociable du solide soutien de la communauté MLC.AI. Nous remercions sincèrement tous les membres de la communauté pour leur participation active et leur aide :

-- sur--