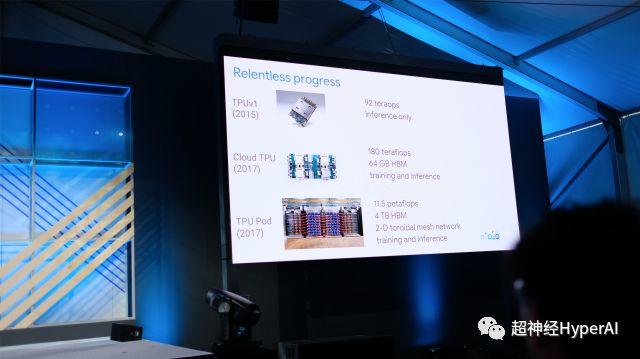

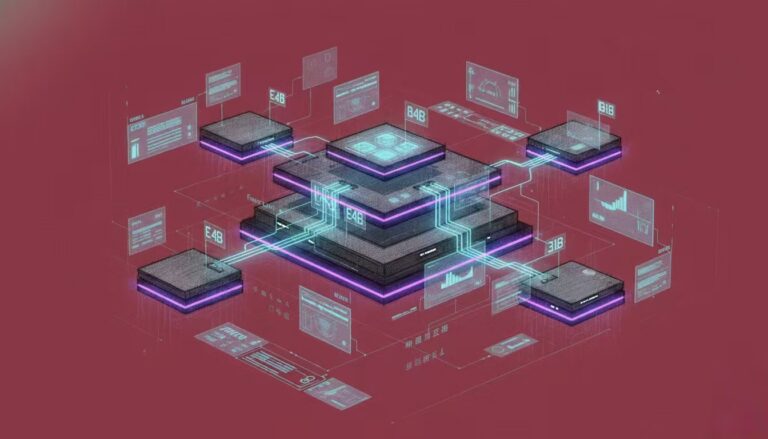

Lors de l'ouverture de Google 2018, Sundar Pichai a brièvement présenté la capacité de Google à utiliser l'intelligence artificielle pour participer au diagnostic et au traitement, et à traiter l'audio et la vidéo. Comme prévu, il a donné la position C de toute la conférence à TPU - ce processeur tenseur construit par Google pour l'apprentissage en profondeur est devenu le muscle le plus fort de Google dans le domaine de l'intelligence artificielle.

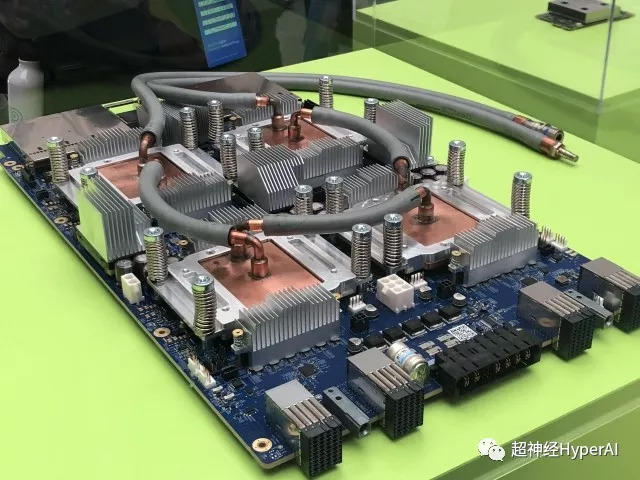

TPUv3 a considérablement amélioré les performances par rapport à TPUv2, qui a été publié l'année dernière mais n'est pas encore disponible au public. Sa puissance de calcul maximale est huit fois supérieure à celle de la version 2.0. L’amélioration des performances a également un prix considérable. L’augmentation considérable de la production de chaleur a obligé les ingénieurs à remplacer le radiateur par un tube en laiton. Comme on pouvait s’y attendre, Sundar Pichai a également admis que la solution de refroidissement pour cette génération de TPU est le refroidissement liquide.

La puissance de calcul maximale du TPUv2 est de 180 Tflops, avec 64 Go de cache HBM, ce qui augmente la capacité de formation par rapport au TPU de première génération. Zak Stone, l'orateur du sujet TPU dans la branche, a démontré le processus de formation de plusieurs modèles à l'aide de Tensor2Tensor, et les performances ont été en effet très impressionnantes. En réponse aux questions de Zak Stone après la réunion, Super Neuro a posé des questions sur l'adaptabilité du TPU à d'autres cadres de développement. Malheureusement, mais comme prévu, TPU ne peut prendre en charge que les chaînes d'outils liées à TensorFlow et ne prend pas en charge d'autres frameworks de développement, dirigés par Pytorch. Zak a également mentionné que le projet open source Tensor2Tensor progresse très rapidement (Very faaaast).

Frank Chen, un ingénieur de Google travaillant au même endroit, a déclaré à Super Neuro que la version 3.0 du TPU présentait une « légère augmentation » de la consommation d'énergie. Dans le même temps, les modules TPU de la salle informatique communiquent entre eux à l’aide de câbles hautement personnalisés, et non de solutions à fibre optique telles qu’Infinity Band. La bande passante et le cache suffisants améliorent les capacités de l'ensemble du cluster, mais ils entraînent bien sûr également une certaine charge sur la consommation d'énergie. Lorsqu'on lui a demandé si les développeurs pourraient avoir accès à la version 3.0 cette année, il a souri de manière anormale et a répondu : « J'espère que oui. »

Bonjour, quel service n’a pas encore de retard ? Mais attendez, si la version 3.0 ne peut pas être utilisée immédiatement, quand TPUv2 sera-t-il disponible sans demander de quota ? Zak Stone a déclaré que dès son retour au bureau, tous les développeurs dont les applications sont en attente d'examen recevront immédiatement un e-mail et seront autorisés à utiliser le service.

Eh bien, espérons que Zak se remettra sur pied et retournera bientôt à son bureau.

Articles historiques (cliquez sur l'image pour lire)

Google I/O, connu sous le nom de « Gala du Festival du Printemps pour les Programmeurs »

Quels grands tueurs ont été libérés ? 》

« Les Japonais ont des idées étranges, et même leur travail sur l'IA n'est pas sérieux. »

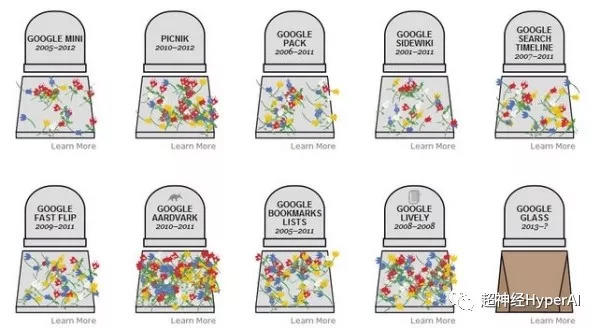

« Une liste détaillée des produits non conformes publiés lors de la conférence Google I/O »》