Command Palette

Search for a command to run...

Après 80 000 Peintures + Un Entraînement d'annotation Manuelle, l'algorithme a Appris À Apprécier Les Peintures Célèbres

Les œuvres d’art incarnent souvent les émotions intérieures de l’auteur, et les gens ressentiront également une résonance émotionnelle lorsqu’ils apprécieront un morceau de musique ou une peinture. Les ordinateurs peuvent-ils comprendre les émotions dans les œuvres d’art ? Une équipe de recherche de l’Université de Stanford développe cet algorithme.

Léon Tolstoï a dit : « L'art est une activité humaine dans laquelle une personne transmet consciemment ses sentiments aux autres à travers des symboles externes, et d'autres sont également infectés par ces sentiments et les ressentent véritablement. »

Prenons l’exemple des peintures d’art. Derrière chaque œuvre, il y a une certaine émotion du peintre. Des peintres célèbres tels que Van Gogh et Picasso ont exprimé leurs humeurs et émotions uniques à différentes époques à travers différentes couleurs et compositions.

Les ordinateurs peuvent-ils comprendre les émotions contenues dans ces œuvres d’art ? Une équipe de recherche en informatique de l'Université de Stanford a collecté un nouvel ensemble de données appelé ArtEmis, qui contient un grand nombre de peintures d'art et d'expériences émotionnelles correspondantes annotées manuellement, et a formé un modèle informatique capable de produire des réponses émotionnelles à l'art visuel.

Comprendre les peintures, en commençant par les ensembles de données d'étiquetage des sentiments

WikiArt : Musée en ligne de peintures célèbres

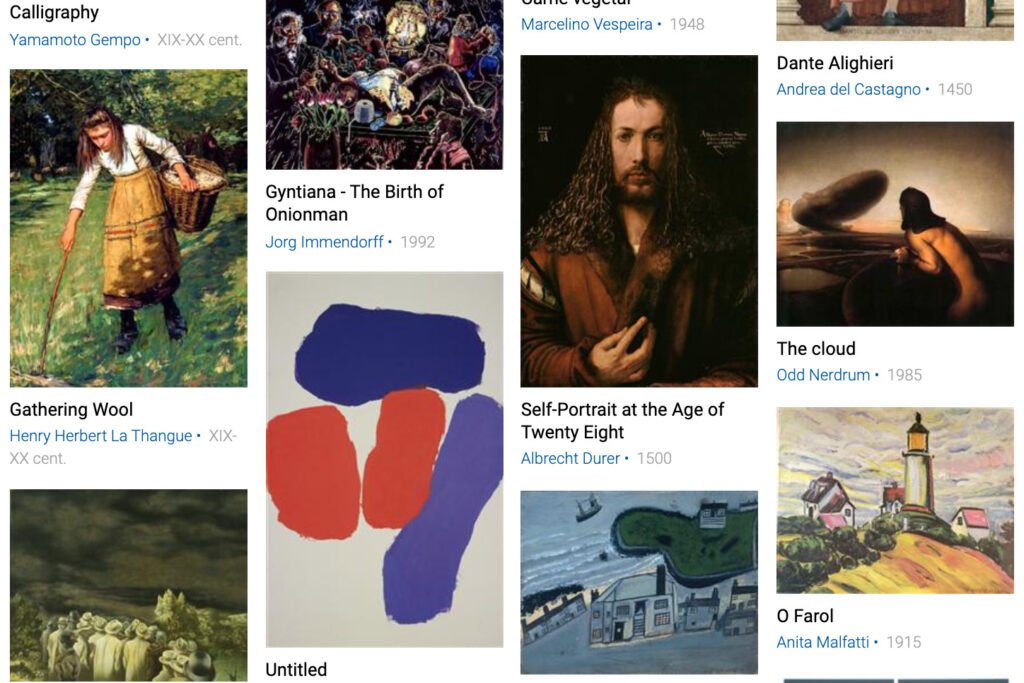

WikiArt, un projet bénévole à but non lucratif, a collecté des œuvres d'art visuel du monde entier depuis son lancement en 2010 et peut être considéré comme un grand musée en ligne de peintures célèbres.

Selon le site Web, en janvier 2020,Le site contient 169 057 peintures de 3 293 artistes, répartis dans 61 genres.

WikiArt contient un grand nombre de peintures avec une classification claire, il est donc devenu un ensemble de données utilisé par de nombreux chercheurs en IA pour former des algorithmes.

En 2015, des chercheurs de l'Université Rutgers et du Facebook AI Lab ont collaboré pour développer GAN (Generative Adversarial Network) et l'ont formé sur des données WikiArt, permettant à GAN de distinguer différents styles d'art.

ArtEmis : Un nouvel ensemble de données né de WikiArt

L'équipe de l'Université de Stanford a créé un nouvel ensemble de données d'annotation d'art visuel ArtEmis basé sur les œuvres de WikiArt.

Ils ont annoté 81 446 œuvres d'art de 1 119 artistes sur WikiArt.Ces œuvres vont des œuvres créées au XVe siècle aux peintures d'art modernes créées au XXIe siècle, couvrant 27 styles artistiques (abstrait, baroque, cubisme, impressionnisme, etc.) et 45 genres (paysages urbains, paysages, portraits, natures mortes, etc.), apportant un impact visuel très diversifié au public.

Chaque œuvre nécessite au moins 5 annotateurs pour écrire leurs émotions dominantes lorsqu'ils voient le tableau et expliquer les raisons de ces émotions.

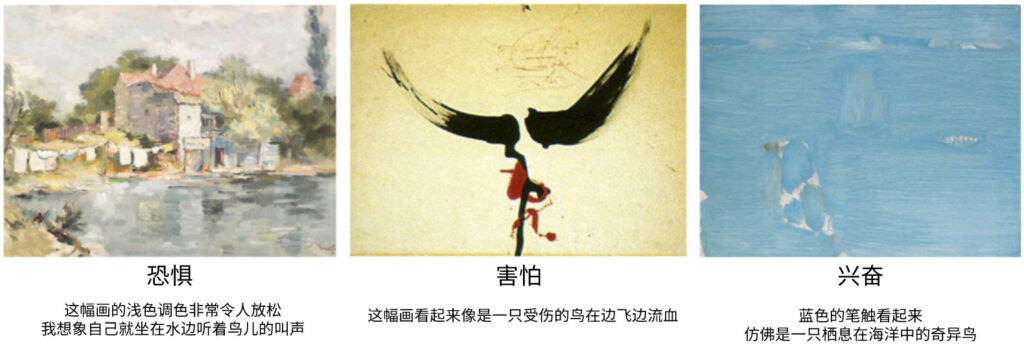

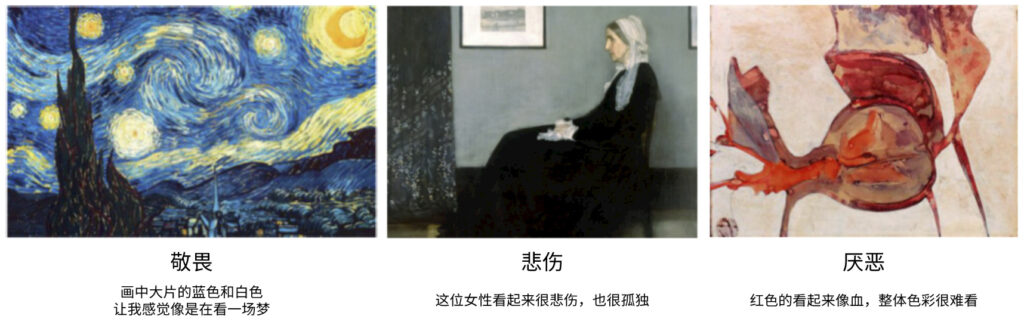

Spécifiquement,Après avoir observé une œuvre d’art, l’annotateur doit d’abord choisir l’un des huit états émotionnels de base (colère, dégoût, peur, tristesse, amusement, émerveillement, satisfaction et excitation) comme émotion principale qu’il ressent. S'il ne s'agit d'aucune des huit émotions ci-dessus, vous pouvez également la marquer comme « autre ».

Après avoir étiqueté les sentiments émotionnels, l’annotateur doit utiliser des mots pour expliquer plus en détail pourquoi il ou elle ressent cela ou pourquoi il n’y a pas de réaction émotionnelle forte.

Vous trouverez ci-dessous les étiquettes de sentiment que les annotateurs humains ont attribuées aux peintures, ainsi que des explications détaillées :

Le travail d'étiquetage a finalement été réalisé par 6 377 étiqueteurs sur la plateforme de crowdsourcing d'Amazon, ce qui a nécessité un total de 10 220 heures.

L'équipe a déclaré que par rapport à d'autres ensembles de données similaires existants,Les annotations ArtEmis utilisent un langage plus riche, plus émotionnel et plus diversifié, et le corpus formé par ces annotations contient un total de 36 347 mots différents.

ArtEmis(Ensemble de données d'étiquetage des sentiments pour les arts visuels) Détails:

Agence d'édition :Université de Stanford, École Polytechnique et Université des sciences et technologies du roi Abdallah

Quantité incluse :Au total, 439 121 peintures ont été annotées

Format des données :csv Taille des données :21,8 Mo

adresse:https://orion.hyper.ai/datasets/14861

Comment créer un algorithme capable de percevoir les émotions

Afin de permettre aux ordinateurs d’avoir des réponses émotionnelles à l’art visuel comme les humains et d’utiliser le langage pour justifier les raisons de ces émotions, l’équipe a formé un locuteur neuronal basé sur cet ensemble de données à grande échelle.

Guibas, professeur à l'Institut HAI de l'Université de Stanford, a déclaré qu'il s'agissait d'une nouvelle exploration dans le domaine de la vision par ordinateur. Les méthodes classiques de vision par ordinateur précédentes indiquaient souvent ce qui se trouvait dans l'image, par exemple : il y a trois chiens ; quelqu'un boit du café... et son travail consiste à définir les émotions dans l'art visuel.

Après une formation sur le jeu de données ArtEmis,L'algorithme reconnaît les émotions contenues dans différentes peintures et génère automatiquement la base d'un tel jugement.Les exemples de résultats sont les suivants :

Le document présente les idées de formation spécifiques.Tout d’abord, ArtEmis est utilisé pour former le modèle à résoudre le problème de l’interprétation émotionnelle des peintures d’art.Il s'agit d'un problème classique de classification de texte à 9 voies, et l'équipe a utilisé une optimisation basée sur l'entropie croisée appliquée à un classificateur de texte LSTM formé à partir de zéro, tout en envisageant également d'affiner un modèle BERT pré-entraîné pour cette tâche.

De plus, laissez l’ordinateur prédire les réactions émotionnelles que les humains ont généralement face à l’œuvre.

Pour résoudre ce problème, l’équipe a peaufiné un encodeur ResNet32 pré-entraîné sur ImageNet en minimisant la divergence KL entre la sortie et les annotations utilisateur d’ArtEmis.

Pour un tableau donné, le classificateur détermine d’abord si l’émotion qu’il transmet est positive ou négative, puis détermine de quelle émotion spécifique il s’agit.

Présentation de l'équipe,Pour un tableau, l’algorithme peut non seulement percevoir la couleur émotionnelle globale, mais également distinguer les émotions des différents personnages du tableau.Prenant comme exemple « La Décapitation de Saint Jean-Baptiste » de Rembrandt, l'algorithme d'IA a non seulement capturé la douleur de la décapitation de Jean, mais a également perçu la « satisfaction » de Salomé, la femme dont la tête était offerte dans le tableau.

Quand les algorithmes ont de l'empathie

Les émotions humaines sont très riches, complexes et subtiles. Même nous, les humains, ne pouvons pas pleinement comprendre les sentiments que certains artistes veulent exprimer. Il y aura donc forcément certains défis à relever pour permettre à l’IA de comprendre avec précision les intentions de l’artiste.

Cependant, la publication de l’ensemble de données ArtEmis a permis à l’IA de faire le premier pas dans le traitement des attributs émotionnels des images.

L'équipe a déclaré qu'après des recherches et des améliorations supplémentaires, l'algorithme pourrait être capable de percevoir les joies et les peines humaines, et les artistes peuvent utiliser l'algorithme pour évaluer si leurs œuvres peuvent atteindre l'effet d'expression émotionnelle attendu. De plus, une fois que l’algorithme sera capable de comprendre la nature humaine, le processus d’interaction homme-ordinateur deviendra plus naturel et harmonieux.

Source de l'information :

https://techxplore.com/news/2021-03-artist-intent-ai-emotions-visual.html

Document sur l'ensemble de données : https://arxiv.org/pdf/2101.07396.pdf

Page d'accueil du projet : https://www.artemisdataset.org/#videos