Command Palette

Search for a command to run...

Je Pensais Que Deepfake Aurait Un Impact Sur Les Élections Américaines, Mais Il s'avère Que Les Internautes s'inquiétaient trop.

Avant les élections américaines de 2020, les gens craignaient que les fausses nouvelles et les fausses vidéos puissent affecter les résultats des élections. Maintenant que les résultats préliminaires des élections ont été publiés, il semble que les craintes de tous ne se soient pas réalisées.

Les élections américaines, qui ont attiré l'attention du monde entier, ont finalement abouti à un résultat provisoire le 7 novembre, heure locale aux États-Unis. Après quatre jours de dépouillement intense des votes, Biden a reçu plus de 270 votes électoraux et plusieurs grands médias américains ont déclaré Biden vainqueur.

Bien avant les élections, de nombreuses personnes avaient prédit que les vidéos Deepfake joueraient un rôle majeur dans les élections américaines de 2020 et interféreraient avec les élections. De nombreuses plateformes sociales et même la Chambre des représentants des États-Unis recherchent des stratégies pour lutter contre les Deepfakes à l’avance.

Maintenant que les élections de 2020 sont terminées, en repensant à l’ensemble du processus électoral, Deepfake a-t-il vraiment eu un impact sur les élections américaines comme tout le monde l’inquiétait ?

Vous embellissez-vous et vilipendez-vous votre adversaire ? Trump adore les Deepfakes

La technologie Deepfake semble vouée à être utilisée à mauvais escient depuis sa création, notamment dans le domaine politique.

Selon un rapport publié en septembre par Creopoint, une société américaine de renseignement économique, à l'approche des élections américaines,Publier sur InternetLe nombre de fausses vidéos a été multiplié par 20 au cours de l’année écoulée.

Parmi eux, les principales cibles des fausses vidéos sont les célébrités et les cadres. Creopoint a dit :60% des fausses vidéos trouvées sur sa plateforme visaient des hommes politiques.

Ces fausses vidéos ciblant la politique américaine glorifient généralement un parti et vilipendent l’autre. Ce type de vidéo est également celui qui est le plus susceptible de laisser une impression profonde sur les gens et est facile à diffuser, ce qui peut finalement influencer le jugement des électeurs sur les candidats.

Trump est glorifié

En mai de cette année, l’utilisateur de Twitter @mad_liberals a publié une vidéo Deepfake. Dans la vidéo, Trump a été photographié dans une scène du film de science-fiction « Independence Day ». Dans la pièce, Trump s'est « transformé » en président Thomas Whitmore et a prononcé un discours disant « Nous devons lutter pour notre survie », ressemblant à un héros. Le public a également été « remplacé » pour devenir l’équipe de la Maison Blanche soutenant Trump.

Trump a joyeusement retweeté cette fausse vidéo à l'époque, et la vidéo a été diffusée plus de 10 millions de fois cette nuit-là.

Biden est vilipendé

Trump est également très désireux de transmettre certaines vidéos Deepfake qui vilipendent son rival Biden.

En avril de cette année, Trump a retweeté une fausse vidéo de Biden tirant la langue sur Twitter, avec la légende « sloppy joe » pour nuire à l'image de Biden.

Cependant, la diffusion par Trump de fausses vidéos ou images qui vilipendent ses adversaires n’a pas toujours eu un impact favorable sur lui-même. Certains électeurs ont commenté avec déception : « Un vrai président ne transmettrait pas un contenu aussi étrange. »

En fait, toute personne dotée d’un certain degré de jugement ne croira pas ces faux contenus vidéo. Mais il est difficile d’éviter qu’un certain groupe de personnes soit encore confus et induit en erreur, ce qui pourrait finalement affecter leurs choix de vote lors des élections générales.

Les médias publient une vidéo Deepfake et mettent en garde les internautes contre de graves conséquences

En avril 2018, l'acteur américain Jordan Peele a collaboré avec la société de médias d'information en ligne américaine BuzzFeed pour utiliser la technologie de l'IA afin de créer une fausse vidéo du discours d'Obama.

La vidéo utilise le discours de Peele comme source vidéo et transfère ensuite ses mouvements à l'image d'Obama.

Les expressions faciales et le comportement d'Obama dans la vidéo semblent très naturels, sans aucun signe de changement de visage. Si le producteur Jordan Peele et BuzzFeed n'avaient pas personnellement révélé la vérité, beaucoup de gens auraient probablement été trompés.

L'équipe de production a déclaré qu'il ne leur avait fallu que 60 heures au total pour réaliser la vidéo, en utilisant Adobe After Effects et l'outil de changement de visage IA FakeApp.

Ils ont dit qu'ils avaient réalisé et publié cette vidéo.Il s’agit d’appeler et de rappeler à chacun de ne pas faire confiance à ce qu’il voit ou entend sur Internet, en particulier aux vidéos Deepfake.

Grâce à la technologie de l'IA et à divers logiciels gratuits de changement de visage et de doublage, le seuil de falsification de vidéos a été abaissé, et certains experts techniques craignent les conséquences possibles de ces technologies.

« Si quelqu'un utilise cette technologie pour créer de fausses vidéos réalistes afin de diffuser de fausses informations, ou même si les médias et les équipes du parti l'utilisent pour mener une fausse propagande, les conséquences seront désastreuses. »

Ce n’est pas une inquiétude infondée.

En février de cette année, lors des élections législatives de l'État de Delhi en Inde, Manoj Tiwari, l'un des candidats du Bharatiya Janata Party (BJP), a utilisé une technologie de fraude vidéo pour « parler » une langue qu'il ne connaissait pas afin de solliciter des votes afin de gagner les électeurs de langues minoritaires.

Cette vidéo a obtenu de bons résultats. La plupart des gens n'y ont vu aucun défaut, donc non seulement on ne s'en doutait pas au début, mais la réponse a été très enthousiaste, ce qui a permis au candidat de gagner plus de voix.

Au final, les internautes prudents ont encore douté de l’authenticité de la vidéo. Plus tard, le média technologique Vice a confirmé qu'il s'agissait bien d'une vidéo Deepfake, et qu'elle avait été produite par le Parti du peuple indien lui-même et en collaboration avec une société de relations publiques (voir les détails).« Élections parlementaires indiennes : les candidats utilisent DeepFake pour falsifier des vidéos en dialecte afin de solliciter des votes »).

C'est pourquoi Jean-Claude Goldenstein, PDG de Creopoint, la société américaine de renseignement d'affaires mentionnée plus haut, a exprimé un jour de profondes inquiétudes concernant cette élection américaine.

Il a dit :« Il existe bien plus de fausses vidéos que vous ne pouvez l'imaginer, et ce qui est encore plus effrayant, c'est que la technologie et les outils permettant de créer ces vidéos se développent plus rapidement que la vitesse à laquelle elles sont décryptées. » Goldenstein a même déclaré que « l’élection présidentielle devrait être qualifiée de fausse élection vidéo ».

Comment éliminer les conséquences du Deepfake : renforcer la détection et la législation

Heureusement, Deepfake n’a pas seulement causé de problèmes lors des élections américaines de cette année, mais il n’a même pas joué un rôle secondaire. Certains professionnels ont analysé que cela peut être attribué aux deux raisons principales suivantes.

Les plateformes sociales se préparent à un jour pluvieux : frappes de précision

Au cours des mois précédant les élections, les principales plateformes de médias sociaux ont pris davantage de mesures publiques pour examiner et identifier le contenu et supprimer rapidement le contenu faux, comme les fausses vidéos.

Facebook:

En septembre dernier, Facebook a lancé une Défi de détection de deepfake,L’objectif est d’utiliser les outils développés pour détecter les fausses vidéos des gouvernements, des médias, des entreprises, etc.

En janvier de cette année, Facebook a publié un article de blog indiquant qu'il supprimerait les vidéos Deepfake et le contenu contenant des informations trompeuses avant les élections.

Gazouillement:

En février de cette année, Twitter a annoncé une nouvelle politique sur les médias synthétiques et manipulés, affirmant qu'il sévirait contre le contenu médiatique qui a été gravement modifié ou falsifié, y compris le montage, le recadrage, le doublage ou toute image fictive de personnes réelles. Twitter placera un avertissement sur ce type de contenu.

Par exemple,Auparavant, un utilisateur qui soutient Trump avait publié une vidéo utilisant la technologie Deepfake pour donner à Biden un air un peu dément.Il a dit : « Pouvez-vous imaginer Biden devenir président des États-Unis ? Il ne peut pas répondre à une question simple, ni même faire une déclaration simple ? » et a ensuite reçu un avertissement de la part de Twitter.

Les institutions de recherche scientifique travaillent activement à l’amélioration des algorithmes de détection

Afin d’éviter que les élections ne soient perturbées par les Deepfakes, les principaux instituts de recherche et les géants de la technologie développent également activement des algorithmes pour aider à lutter contre le contenu Deepfake.

Google:

En septembre dernier, Google a publié une base de données open source de 3 000 vidéos générées par l'IA et créées à l'aide de divers algorithmes accessibles au public. Google a créé cet ensemble de données dans le but de créer un grand nombre d'exemples pour aider à former et à tester les outils de détection automatique Deepfake.

Intel et l'Université de Binghamton :

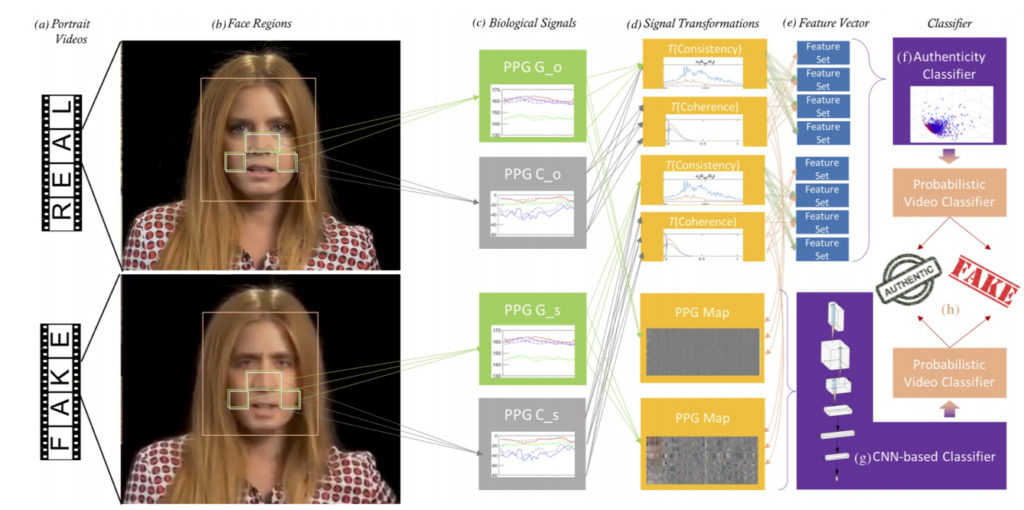

En septembre de cette année, des chercheurs de l'Université de Binghamton et d'Intel ont développé un algorithme quiIl affirme pouvoir utiliser le signal de battement de cœur dans la vidéo pour détecter si la vidéo est fausse, avec un taux de précision allant jusqu'à 90%.De plus, l'algorithme peut également découvrir les modèles de génération spécifiques derrière les vidéos Deepfake (tels que Face2Face, FaceSwap, etc.).

Microsoft :

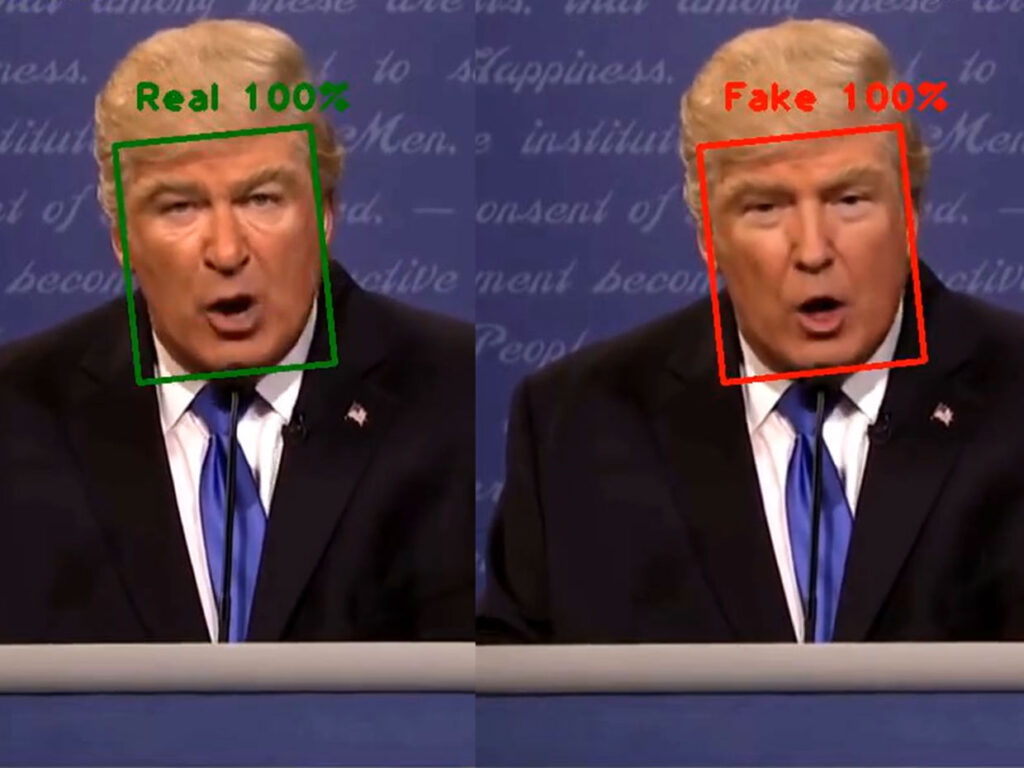

En septembre de cette année, à la veille des élections, Microsoft a publié un outil de détection de Deepfake appelé « Video Authenticator », qui indique si une vidéo est un contenu Deepfake en affichant un score de confiance ou le « pourcentage » de manipulation et de modification.

Par conséquent, à mesure que les plateformes sociales et médiatiques deviennent de plus en plus capables d’identifier les faux contenus, ces vidéos finiront par être étouffées dans l’œuf.

Dans le même temps, les lacunes juridiques existantes sont progressivement comblées et le fait de tenir responsables les auteurs de falsifications de vidéos des conséquences néfastes permettra également de clarifier les choses.

Par exemple, le Code civil de mon pays, qui a été voté et adopté en mai de cette année, stipule clairement que l'utilisation de la technologie pour falsifier des vidéos constitue une violation du droit à l'image, et cela est clairement inscrit dans l'article 1019 du Code (voir« Le changement de visage par l'IA, la falsification de la voix, etc. sont clairement inscrits dans la nouvelle version du Code civil. »).

Article 1019 [Pouvoir négatif du droit à l'image] Aucune organisation ni aucun individu ne peut diffamer, dégrader, Ou utiliser les technologies de l'information pour falsifier ou enfreindre les droits d'image d'autrui.Nul ne peut produire, utiliser ou divulguer le portrait d’un titulaire de droit sur un portrait sans le consentement de ce dernier, sauf disposition contraire de la loi.

Sous la double surveillance de la technologie et du droit, les producteurs et diffuseurs de fausses vidéos risquent de payer un prix plus élevé pour leurs actes. S’ils veulent s’impliquer en politique, ce ne sera peut-être pas si facile.

À ce stade, les questions soulevées au début de notre article ont trouvé une réponse. Deepfake n'a pas provoqué de vagues lors des élections américaines de cette année, et encore moins n'a interféré dans le processus électoral. Les inquiétudes précédentes des internautes étaient donc purement excessives. Toutefois, à l’avenir, la surveillance ne doit pas être relâchée et nous devons toujours empêcher la technologie de faire le mal.

-- sur--