Command Palette

Search for a command to run...

Bei Den Indischen Parlamentswahlen Nutzten Kandidaten DeepFake, Um Dialektvideos Zu Fälschen Und so Stimmen Zu gewinnen.

Bei der jüngsten Wahl zur gesetzgebenden Versammlung in Delhi in Indien nutzte ein Kandidat die DeepFake-Technologie, um Werbevideos in anderen Sprachen zu erstellen und so Stimmen für sein Team zu gewinnen. Obwohl diese Methode eine gute Publizitätswirkung hatte und einige Stimmen einbrachte, waren die endgültigen Wahlergebnisse unerwartet.

Kürzlich tauchte DeepFake erstmals bei der indischen Wahl auf und wurde von Kandidaten in Wahlkampfmaterialien verwendet.

Bei der gerade zu Ende gegangenen Wahl zur Legislaturperiode des Bundesstaates Delhi in Indien nutzte Manoj Tiwari, einer der Kandidaten der Bharatiya Janata Party (BJP), eine Videobetrugstechnologie, um eine ihm unbekannte Sprache zu „sprechen“ und so Wähler mit Minderheitssprachen für sich zu gewinnen.

Leider hat ihnen das Schicksal einen Streich gespielt. Auch mit Hilfe der KI konnte die Propaganda einen gewissen Aufschwung verzeichnen, doch die BJP verlor die Wahl am Ende trotzdem und errang lediglich acht (von insgesamt 70) Parlamentssitzen im Bundesstaat.

Fließendes Dialektsprechen hilft Kandidaten, Unterstützung zu gewinnen

Am 7. Februar, einen Tag vor der Parlamentswahl in Delhi, veröffentlichte Manoj Tiwari von der Bharatiya Janata Party zwei kurze Videos in den sozialen Medien, in denen er Werbung für seine Partei machte.

Erstes Video (Englisch)

Zweites Video (Haryana)

Die beiden Videos, eines auf Englisch und das andere in Haryanvi (einem indischen Dialekt), kritisierten hauptsächlich den derzeitigen Ministerpräsidenten Delhis, Arvind Kejriwal, und forderten die Wähler auf, für die Bharatiya Janata Party zu stimmen.

In dem Video sprach Tiwari, der nicht gut Haryanvi spricht, fließend Haryanvi und rief alle dazu auf, für die BJP zu stimmen. Dieser Schritt rief bei den Menschen, die die Sprache sprechen, begeisterte Reaktionen hervor und das Video wurde auf WhatsApp weit verbreitet.

Der Vorsitzende der BJP behauptete in den Medien, dass mit diesem Schritt gute Ergebnisse erzielt worden seien. Viele Hausfrauen gaben an, dass sie sich den Kandidaten sehr nahe fühlten, weil sie ihren eigenen Dialekt sprächen, was auch die Wahlentscheidung mancher beeinflusste.

Doch dann entdeckten einige aufmerksame Leute etwas Seltsames in dem Video.

PR-Firmen nutzen DeepFakes im Auftrag politischer Parteien

Beim aufmerksamen Betrachten von Tiwaris Video stellten Internetnutzer fest, dass die Mundbewegungen der Figur seltsam wirken und nicht natürlich aufgenommen zu sein scheinen.

Später bemerkten auch Forscher des renommierten Technologiemediums Vice und des Rochester Institute of Technology (RIT) in New York Auffälligkeiten im Video.

Vice bestätigte den Sachverhalt später und enthüllte das Geheimnis hinter dem Video.

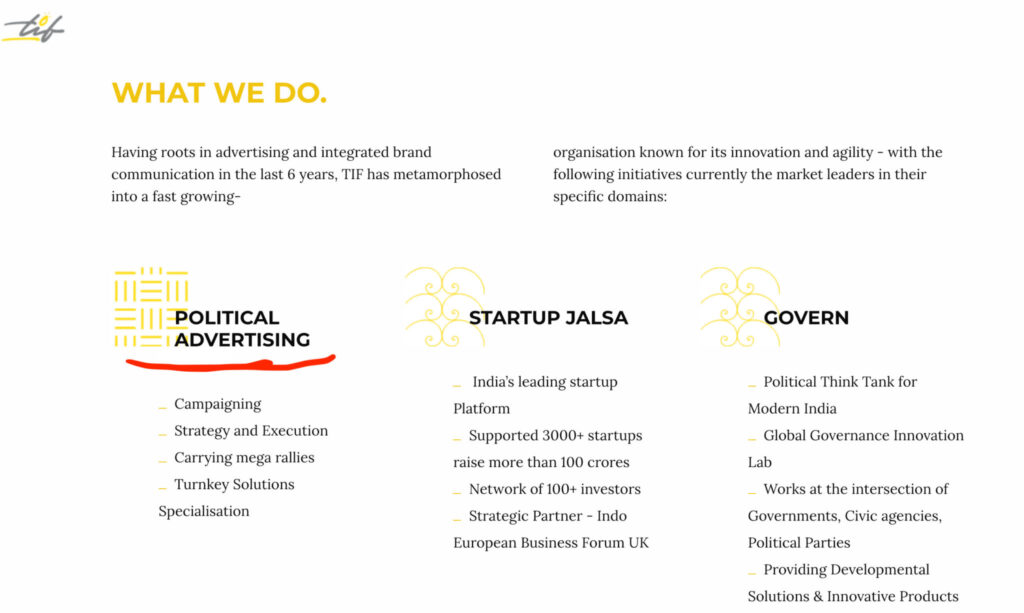

Es wurde bestätigt, dass das zweite Haryana-Video nicht tatsächlich gedreht wurde, sondern ein DeepFake-Produkt ist, das von der IT-Abteilung der BJP in Zusammenarbeit mit der PR-Firma The Ideaz Factory erstellt wurde.

Um es den Kandidaten angeblich zu ermöglichen, Wähler mit anderen Sprachen für sich zu gewinnen, haben sich die BJP und The Ideaz Factory zusammengetan, um Tiwari im Dialekt sprechen zu lassen und ihn auf dem Bildschirm „erscheinen“ zu lassen.

Bakshi, Medien- und Technologiechef der BJP im Bundesstaat Delhi, erklärte gegenüber Vice, das gefälschte Video des Kandidaten Tiwari sei auf die zahlreichen Haryana sprechenden Wanderarbeiter in Delhi abgezielt, um sie davon abzuhalten, ihre Stimme für seinen Rivalen abzugeben.

Bakshi erklärte außerdem stolz, dass durch den Einsatz der DeepFake-Technologie die harmlose Kommunikation der Kampagne in beispiellosem Maße erweitert worden sei.

Indien hat 30 Sprachen und 2.000 Dialekte

Es gibt einen Grund, warum sich das Kandidatenteam den Kopf zerbrochen hat, DeepFake im Dialekt sprechen zu lassen.

In Indien werden zwischen den verschiedenen ethnischen Gruppen viele Sprachen gesprochen. Aktuellen Statistiken zufolge gibt es mindestens 30 verschiedene Sprachen und 2.000 Dialekte.

Die indische Verfassung legt fest, dass Hindi, Sanskrit und Englisch die Amtssprachen der indischen Regierung sind, es gibt jedoch 14 weitere beliebte Sprachen (mit einer Bevölkerung von mehr als 5 Millionen). Das im Artikel erwähnte Haryanvi (normalerweise als Untertyp des Hindi angesehen) ist eines davon.

Statistiken zeigen, dass dieses kurze Video in der Sprache Haryanvi in 5.800 WhatsApp-Gruppen geteilt und von rund 15 Millionen Menschen angesehen wurde.

Tatsachen belegen, dass DeepFake einen großen Beitrag zu seiner Verbreitungswirkung geleistet hat.

Mithilfe von Algorithmen Videos mit „falschen Stimmen“ versehen

Wie wird diese Technologie implementiert?

Die Ideaz Factory behauptete, sie habe den Stimmabgleichsprozess auf Grundlage des Tiwari-Videos in anderen Sprachen durchgeführt.

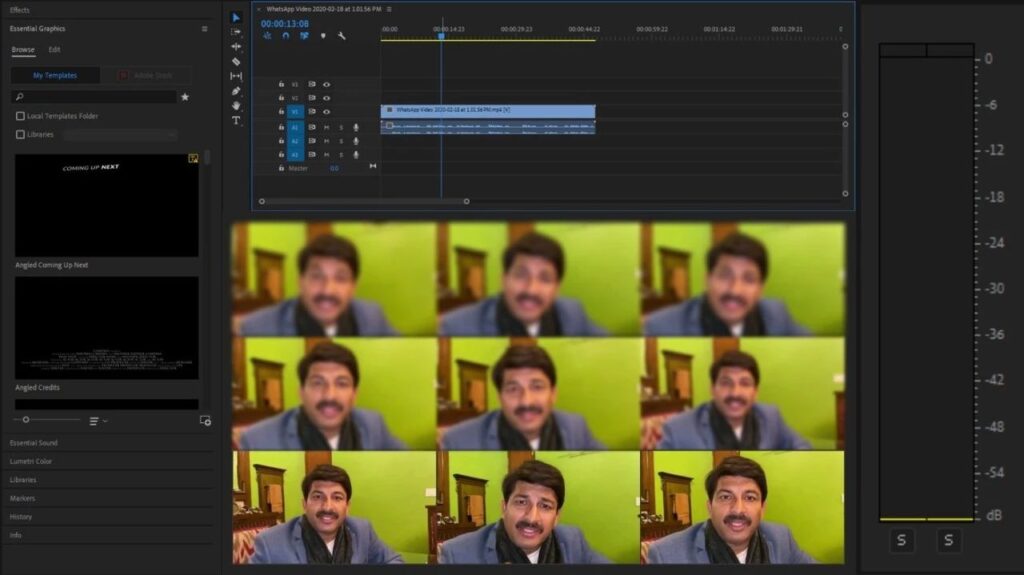

Konkret wurde ein Deepfake-Algorithmus mit Lippenbewegungstechnologie verwendet, mit Tiwaris Stimme trainiert und schließlich der externe Ton und die Mundbewegungen verschmolzen.

Nachdem das Unternehmen das trainierte Modell hatte, engagierte es einen Synchronsprecher, der Tiwari beim Vorlesen der geschriebenen Zeilen auf Haryanvi imitieren und die Stimme schließlich in das Video einfügen sollte.

Mit anderen Worten: Das Video, in dem Tiwari im Dialekt spricht, ist ein reales Bild von ihm selbst, dem die Stimme einer anderen Person hinzugefügt wurde, und die Lippenbewegungen wurden verändert, damit es echt aussieht.

Das Unternehmen behauptet außerdem, dass die aktuelle Technologie nicht ausgereift genug sei, um die Stimme der Zielperson direkt mithilfe eines Algorithmus zu generieren. Sie sind jedoch von der Technologie überzeugt und planen, sie in größerem Umfang zu fördern, beispielsweise bei den bevorstehenden Parlamentswahlen in Bihar und den US-Wahlen 2020.

Obwohl sich die Ideaz Factory weigerte, Einzelheiten zur verwendeten Technologie preiszugeben, vermuteten die RIT-Forscher aufgrund einiger Hinweise, dass sie möglicherweise das Vid2Vid-Modell von Nvidia verwendet haben.

Leider hat DeepFake ihnen nicht geholfen, den endgültigen Sieg zu erringen

Dies ist nicht das erste Mal, dass DeepFake in Wahlkämpfen eingesetzt wird, aber in Indien, wo die Situation relativ kompliziert ist, ist es ein beispielloses Novum.

Sowohl in Großbritannien als auch in den USA kam es bereits zu Vorfällen mit gefälschten Videos während der Wahlen. Aus diesem Grund haben viele Regionen strengere gesetzliche Regulierungsmaßnahmen eingeführt.

Sogar auf Social-Media-Plattformen wie Twitter, Facebook und Reddit wurden strenge Vorschriften erlassen, um gegen die Verwendung von DeepFakes im Wahlkampf vorzugehen.

Allerdings gibt es derzeit keine relevanten gesetzlichen Bestimmungen zu DeepFakes, die bei indischen Wahlen aufgetaucht sind. Manche glauben sogar, dass die Erklärung, es sei illegal, kurzfristig wahrscheinlich nicht durchgesetzt werden könne, weil sie von der Regierungspartei nicht auf öffentliche Unterstützung stoßen werde.

Es ist erwähnenswert, dass die BJP trotz des Einsatzes der DeepFake-Technologie bei dieser Wahl eine vernichtende Niederlage erlitt.

Am 11. Februar wurden die Wahlergebnisse in Delhi bekannt gegeben. Die BJP gewann lediglich acht der 70 Sitze, während die AAP (Common Man Party) die restlichen 62 Sitze gewann.

Daher scheint es derzeit unwahrscheinlich, dass Indien sich mit den Auswirkungen von DeepFake auseinandersetzen wird.

Quellen:

https://www.vice.com/en_in/article/jgedjb/the-first-use-of-deepfakes-in-indian-election-by-bjp?utm_source=reddit.com

http://www.fx361.com/page/2020/0210/6345716.shtml

-- über--